重磅发布!Google Gemini 3.1 Pro 深度解析:四大核心模型重塑多模态 AI 边界

Google发布全新多模态AI模型Gemini 3.1 Pro,整合三大专业引擎:Nano Banana(图像生成/编辑)、Veo(视频生成)和Lyria 3(音乐生成),支持高保真内容创作。新增Gemini Live实时交互模式,实现移动端全双工语音对话和视觉共享。该模型突破传统AI局限,在文本渲染、视频补帧、音乐编曲等方面实现工业级应用,为开发者和创作者提供强大生产力工具,标志着AI技术向多模

随着人工智能技术的狂飙突进,大模型的竞争已经从单一的文本生成,全面转向了“全模态”的深度融合。今天,Google 正式推出了其最新一代的旗舰级模型——Gemini 3.1 Pro。

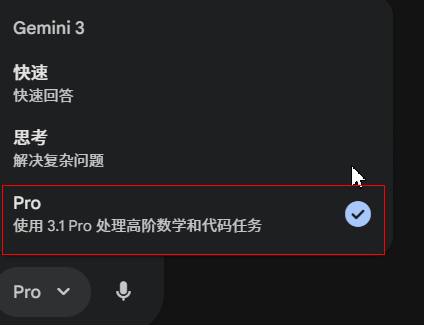

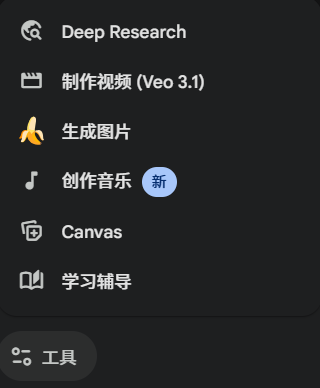

作为专为 Web 端优化并在高级订阅(Paid tier)中提供的高性能版本,Gemini 3.1 Pro 不仅大幅扩展了上下文长度和复杂逻辑推理能力,更令人瞩目的是其底层集成的三大全新生成式引擎(Nano Banana、Veo、Lyria 3)以及革命性的实时交互模式(Gemini Live)。

本文将从技术架构、核心模态能力到实际应用场景,为您全面拆解 Gemini 3.1 Pro 的技术底牌。

核心架构与多模态引擎矩阵

Gemini 3.1 Pro 最大的技术跨越在于其原生的多模态融合架构。它不再是简单的“文本引擎+外部插件”,而是通过不同的顶尖专业模型实现了极高保真度的内容生成。

| 模态 / 功能 | 核心驱动模型 | 核心技术亮点 | 适用开发者 / 创作者场景 |

|---|---|---|---|

| 图像生成与编辑 | Nano Banana | 高保真文本渲染、多图合成、迭代对话修改 | UI/UX 原型设计、精准图文海报生成、风格迁移 |

| 视频生成 | Veo | 原生音视频同步生成、首尾帧关键帧控制 | 影视分镜预演、自媒体短视频创作、视频画面延伸 |

| 音乐生成 | Lyria 3 | 图/文/视频转音乐、多语种人声演唱、专业级编曲 | 游戏音效开发、视频BGM自动生成、音乐Demo制作 |

| 实时交互 | Gemini Live | 屏幕/摄像头共享视觉问答、全双工语音中断 | 实时代码 Debug 讨论、移动端应用向导、环境识别 |

深度技术拆解:Gemini 3.1 Pro 的四大杀手锏

1. 图像领域的“手术刀”:Nano Banana 模型

传统的 AI 绘图往往在处理图像中的“文字”以及“局部精准修改”时显得力不从心。Gemini 3.1 Pro 内置的 Nano Banana 模型彻底解决了这一痛点。

- 高保真文本渲染: 开发者现在可以直接在 Prompt 中要求生成带有特定中英文排版的图片,字体边缘清晰,不再出现乱码或拼写错误。

- 多图组合与风格迁移 (Multi-image-to-image): 支持输入多张参考图进行融合创作。

- 对话式迭代编辑: 摒弃了复杂的遮罩操作,用户可以通过自然语言对话(如:“把背景里的树换成赛博朋克风格的霓虹灯”),模型会基于上下文进行精准的局部图像编辑 (Image+text-to-image)。

2. 影音一体化的工业级视频引擎:Veo 模型

Veo 是 Google 目前最先进的高保真视频生成模型,它将 AI 视频的可用性提升到了工业级水准。

- 原生音频生成: 与市面上许多“哑巴”视频模型不同,Veo 支持基于文本和音频提示词(Audio cues),在生成视频画面的同时原生合成高度同步的背景音效。

- 精准的帧控制能力: 开发者可以指定视频的“第一帧”和“最后一帧”,Veo 能够完美计算并生成中间的过渡动画,这在补帧和特效制作中具有极高的工程价值。

- 视频无缝延展: 支持基于已有的 Veo 视频进行时长的自然延伸,或者输入参考图像(Reference images)来引导视频的视觉走向。

3. 多模态音乐制作人:Lyria 3 模型

在音频生成领域,Lyria 3 展现出了惊人的跨模态理解力。它不仅支持传统的 Text-to-Music,更前沿的是支持 Image-to-Music 和 Video-to-Music。

- 专业级编曲与人声: 能够生成 30 秒的高保真音乐曲目。最令人震撼的是它的全自动作词以及支持多语言的逼真人声演唱功能。

- 细粒度参数控制: 开发者可以对曲目的 BPM(节奏)、流派(Genre)和情感氛围(Emotional mood)进行颗粒度极高的调优。

- 安全与版权追溯: 所有由 Lyria 3 生成的音频均在底层强制嵌入了 SynthID 水印,确保 AI 生成内容的来源可被机器精准识别,兼顾了创作自由与版权伦理。

4. 颠覆移动端体验:Gemini Live 实时交互模式

除了强大的云端生成能力,Gemini 3.1 Pro 在移动端(Android & iOS)推出了 Gemini Live。这是一种打破常规的“全双工”自然语音对话模式。

- 实时感官共享: 允许用户直接共享手机摄像头画面(Camera Sharing)或手机屏幕(Screen Sharing)。模型能够实时“看到”你眼前的物理世界或屏幕上的代码报错,并给出上下文建议。

- 自然打断与流畅交流: 拥有极低的语音延迟,用户可以在模型说话时随时打断它并补充信息,体验无限接近于与真实的人类专家进行视频会议。

- 深度生态整合: 原生支持 YouTube 视频内容的深度讨论,以及复杂图像和文件的上传解析。

总结与展望

Gemini 3.1 Pro 的发布,标志着大模型从“单点技术突破”走向了“多模态工业化流水线”的成熟阶段。无论是利用 Nano Banana 进行 UI 原型的快速迭代,还是使用 Veo 和 Lyria 3 打造一体化的视听体验,Gemini 3.1 Pro 都在为开发者和创作者提供前所未有的生产力杠杆。

参考资料 (References)

- Google DeepMind Official Blog: “Introducing Gemini 3.1 Pro: Our Most Capable Multimodal Model Yet”

- Nano Banana Technical Report: “Iterative Refinement and High-Fidelity Text Rendering in Image Synthesis”

- Veo Research Paper: “High-Fidelity Video Generation with Native Audio and Keyframe Control”

- Lyria 3 Whitepaper: “Multimodal Music Generation and SynthID Watermarking Implementation”

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)