《大学生用红米笔记本跑本地 AI,被各种会员费逼出来的骚操作》

摘要:本文分享了如何在低配置电脑上免费部署离线AI的经验。作者使用RedmiBook(32G内存)成功运行了阿里开源的Qwen3模型,通过Ollama工具实现三步简易安装(下载运行环境、获取5GB模型、启动对话)。实测中文处理能力接近ChatGPT,响应时间3-15秒,内存占用约5GB。还介绍了浏览器插件PageAssist的集成方法,使AI功能可直接在网页调用。方案优势在于完全免费、离线可用且保

一、前言:我为啥要折腾这玩意儿

先坦白,我是个穷学生。

之前用 Kimi 的网页版,虽然免费但动不动就限流。Kimi 的免费额度用完就得充钱,一个月 49 块虽然不多,但对我这个生活费 1500 的人来说,够吃两顿好的了。

更崩溃的是,我们学校网络差得要命,高峰期网页版根本打不开。然后我就想了:能不能把 AI 搬到我自己电脑上?离线用,不要钱,还不卡?

说干就干,花了一周末折腾,还真让我跑起来了。现在我把这套方法分享出来,有手就行。

先说我电脑配置,给你们个参考:

- 笔记本:Redmi Book 16 Pro(2025 款)

- CPU:U7-255H

- 内存:32G

- 显卡:核显(对,没独显也能跑)

- 硬盘:1T SSD

对,就这破配置都能跑。你们要是配置比我好,那更没问题。

二、准备工作:需要下载啥

就两个东西:

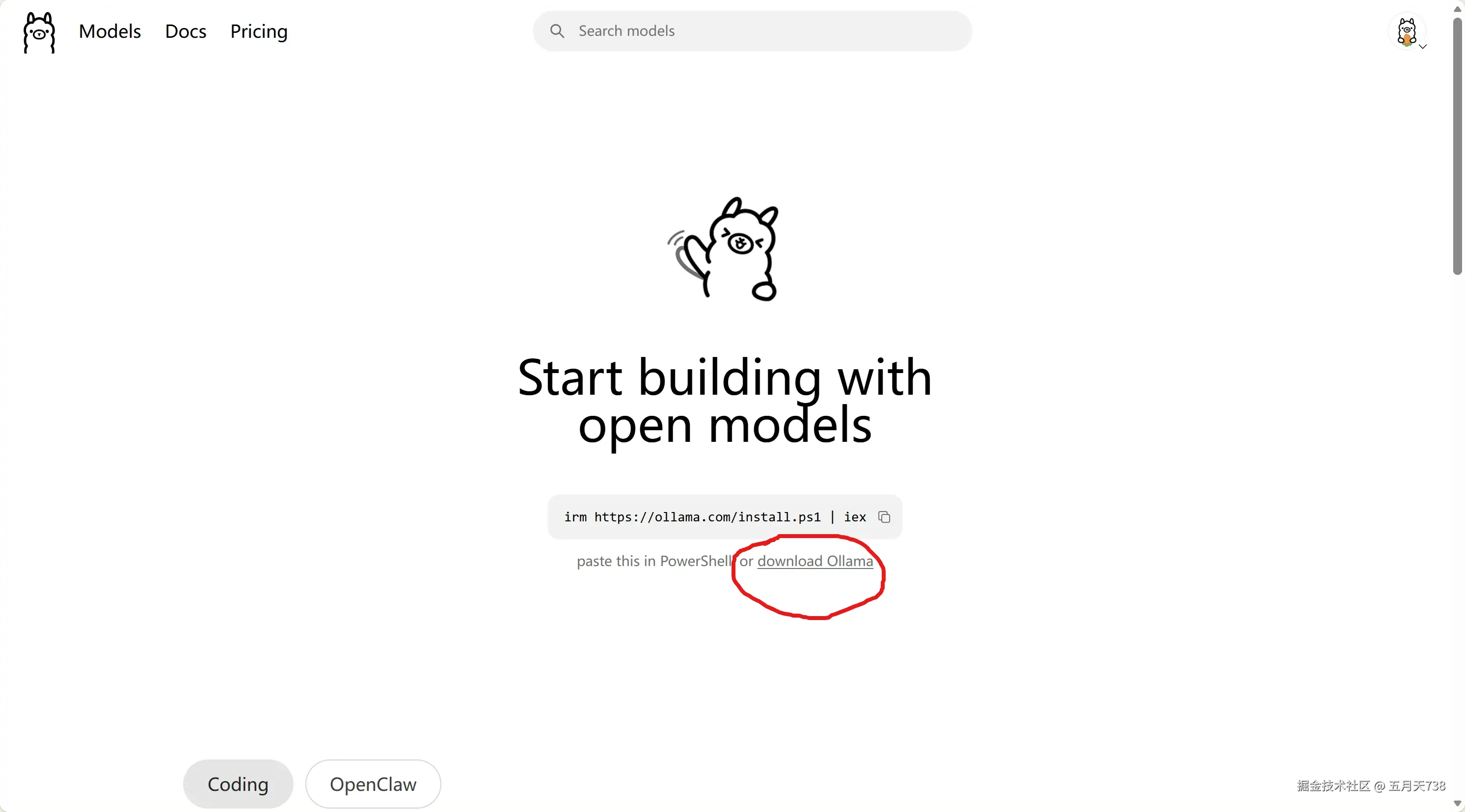

- Ollama:这玩意儿相当于 AI 的运行环境,官网 https://ollama.ai,点那个大大的 Download 按钮

- Qwen3 模型:阿里开源的模型,中文贼溜,而且免费

我一开始以为要搞什么 Docker、Python 环境,结果 Ollama 全帮你搞定了。安装包 200MB 左右,下载完一路下一步就行。

注意: 安装的时候记得勾选"Add to PATH",不然命令行找不到。

三、安装过程:三步搞定

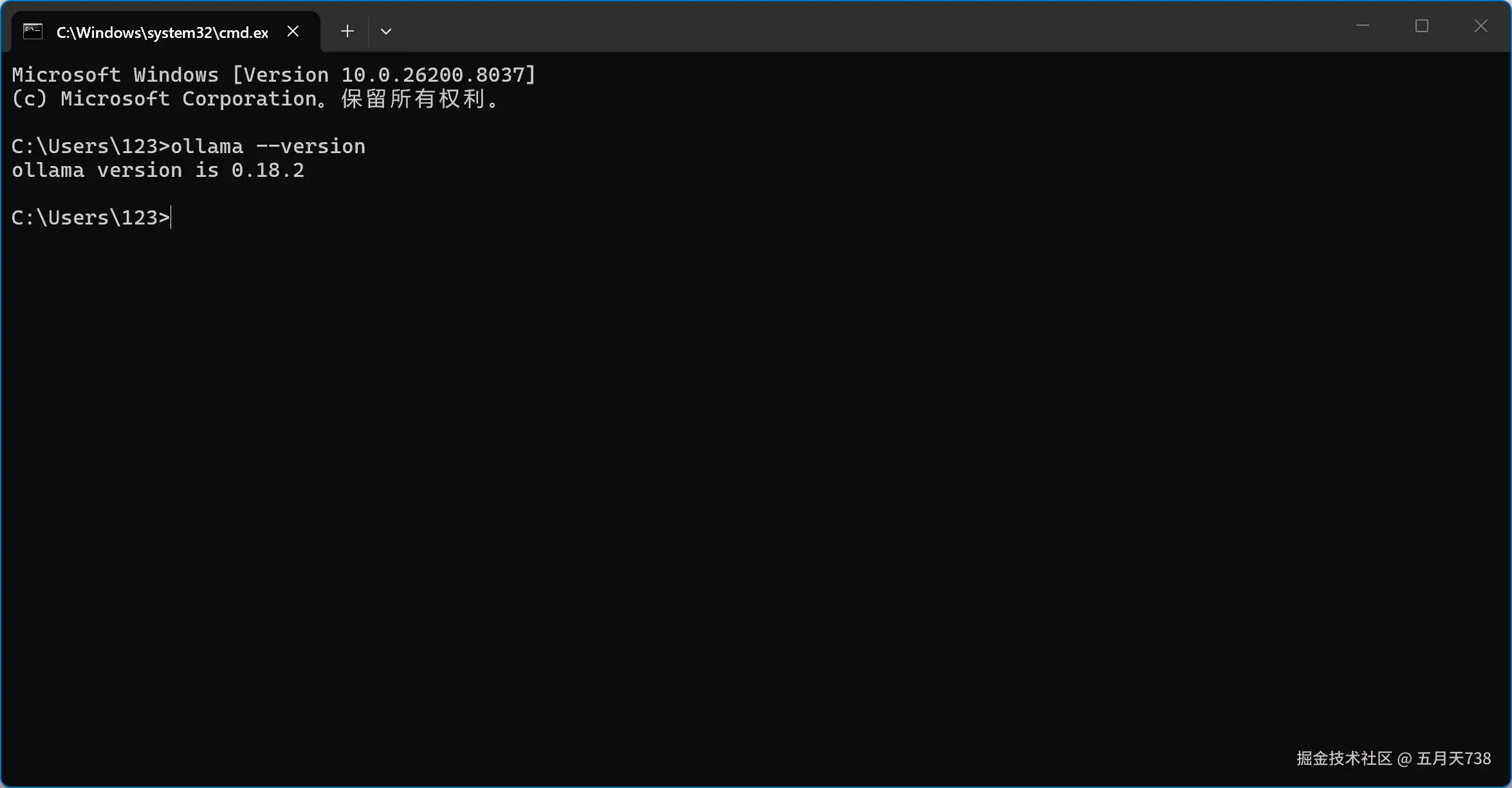

第一步:安装 Ollama

ollama --version

看到版本号就说明装好了。我装的是 0.18.2,你们可能版本更新。

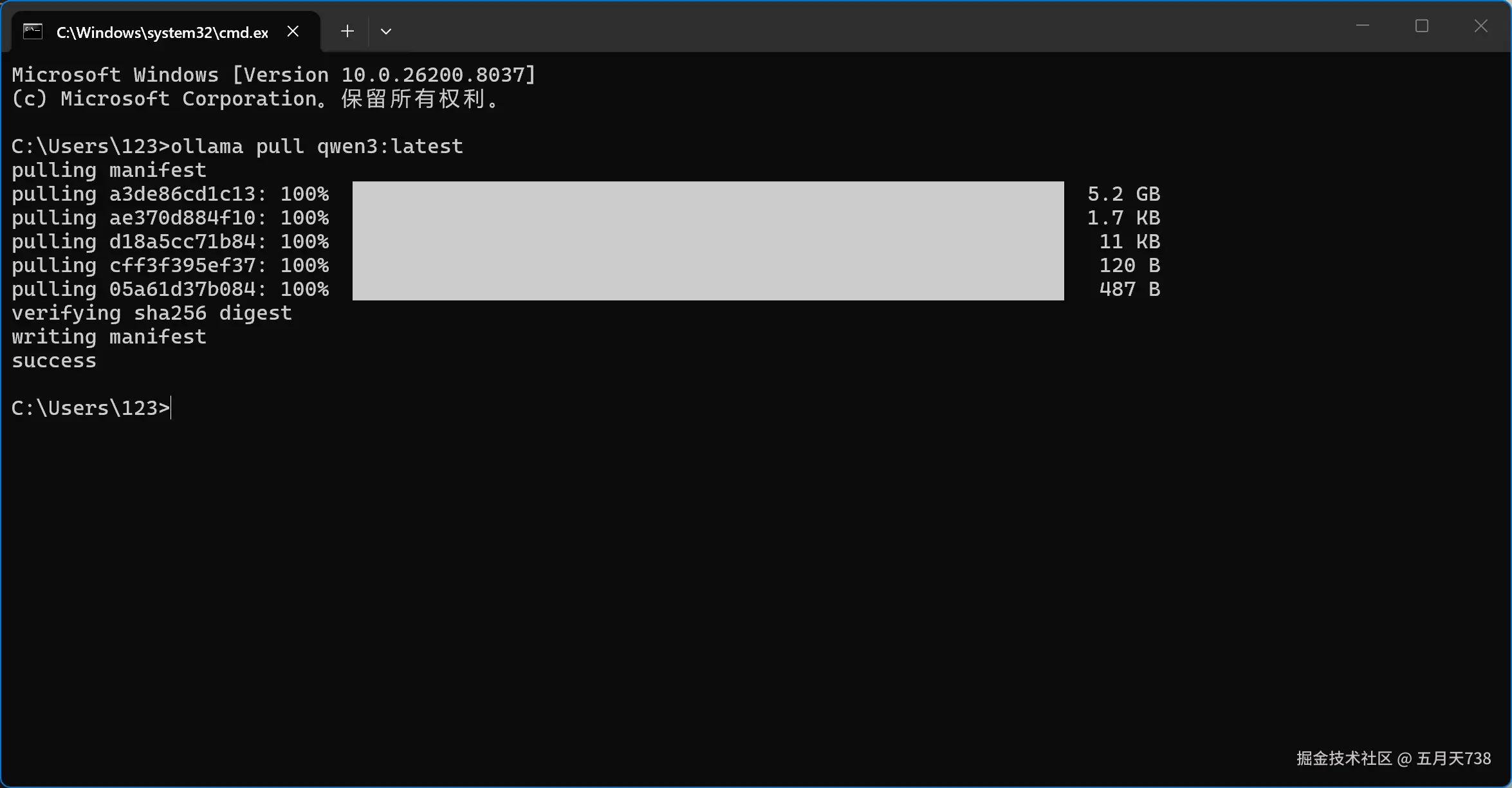

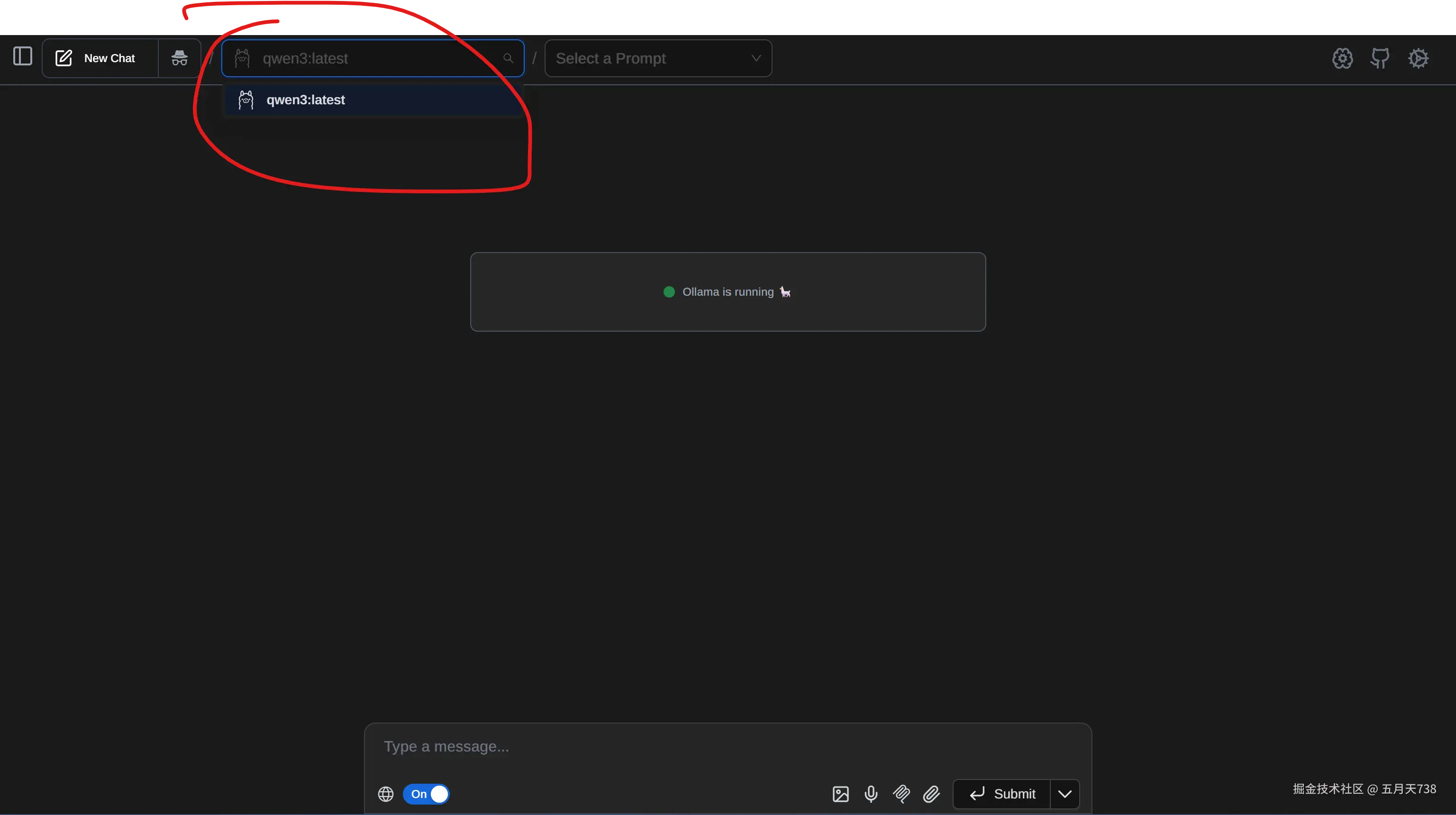

第二步:下载 Qwen3 模型

# 在命令行输入这个,模型会自动下载

ollama pull qwen3:latest

# 等待下载完成,模型大概 5GB,需要点时间

下载的时候看着慢,但也就半小时左右。我用校园网下的,速度还行。

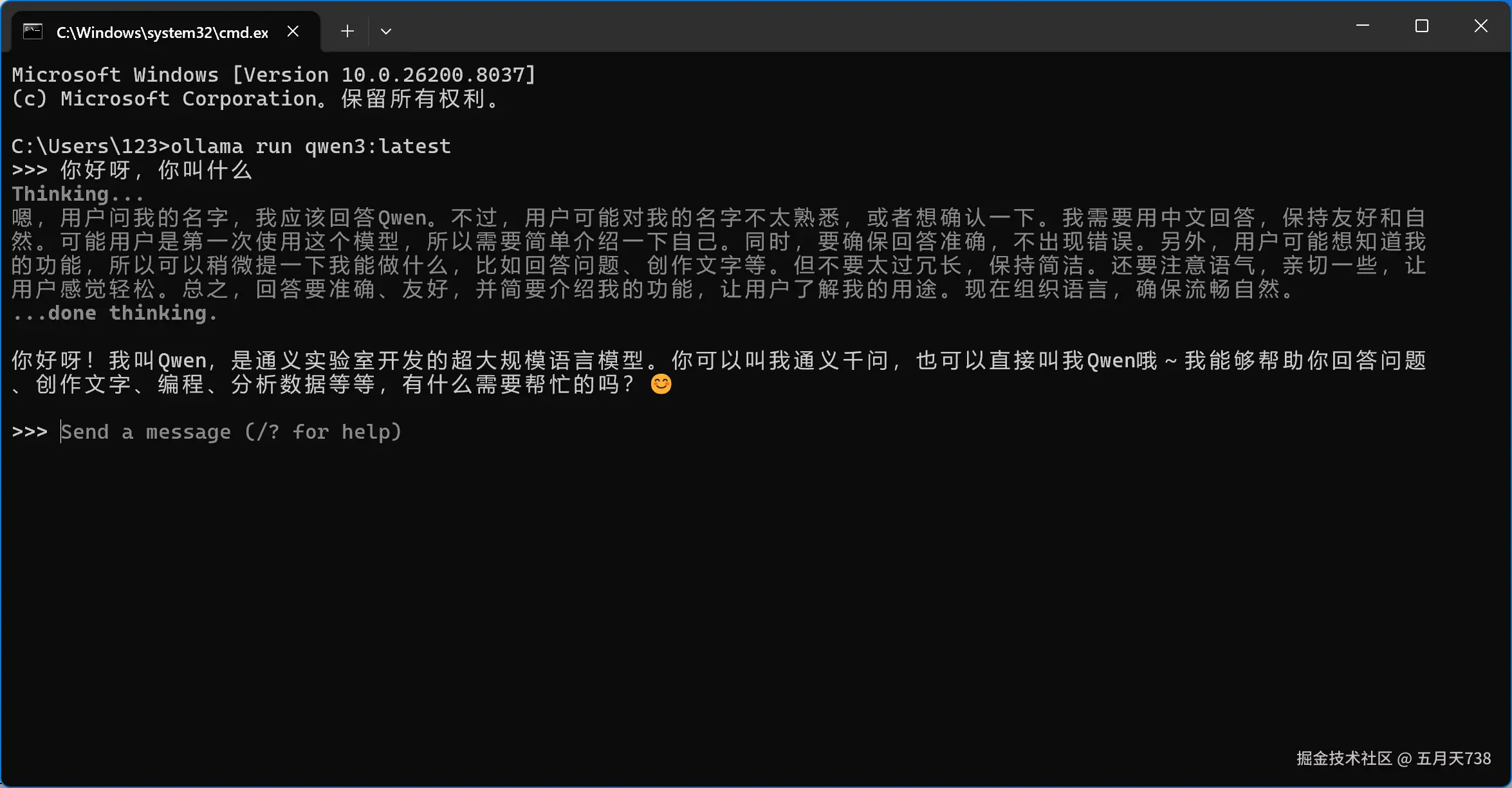

第三步:开始对话

# 直接在命令行跑

ollama run qwen3:latest

然后就能开始聊天了!第一次启动会慢点,后面就快了。

四、实际体验:速度怎么样?

说几个真实感受:

1. 速度:

- 简单问题(写个函数):3-5 秒出结果(以上都是去除thinking模式的)

- 复杂问题(分析代码):10-15 秒

- 比网页版慢一点,但能接受

2. 显存占用:

- 对话时大概占用 4-5GB 内存

- 我的 16G 内存还剩 8G 左右,不影响正常使用

3. 质量:

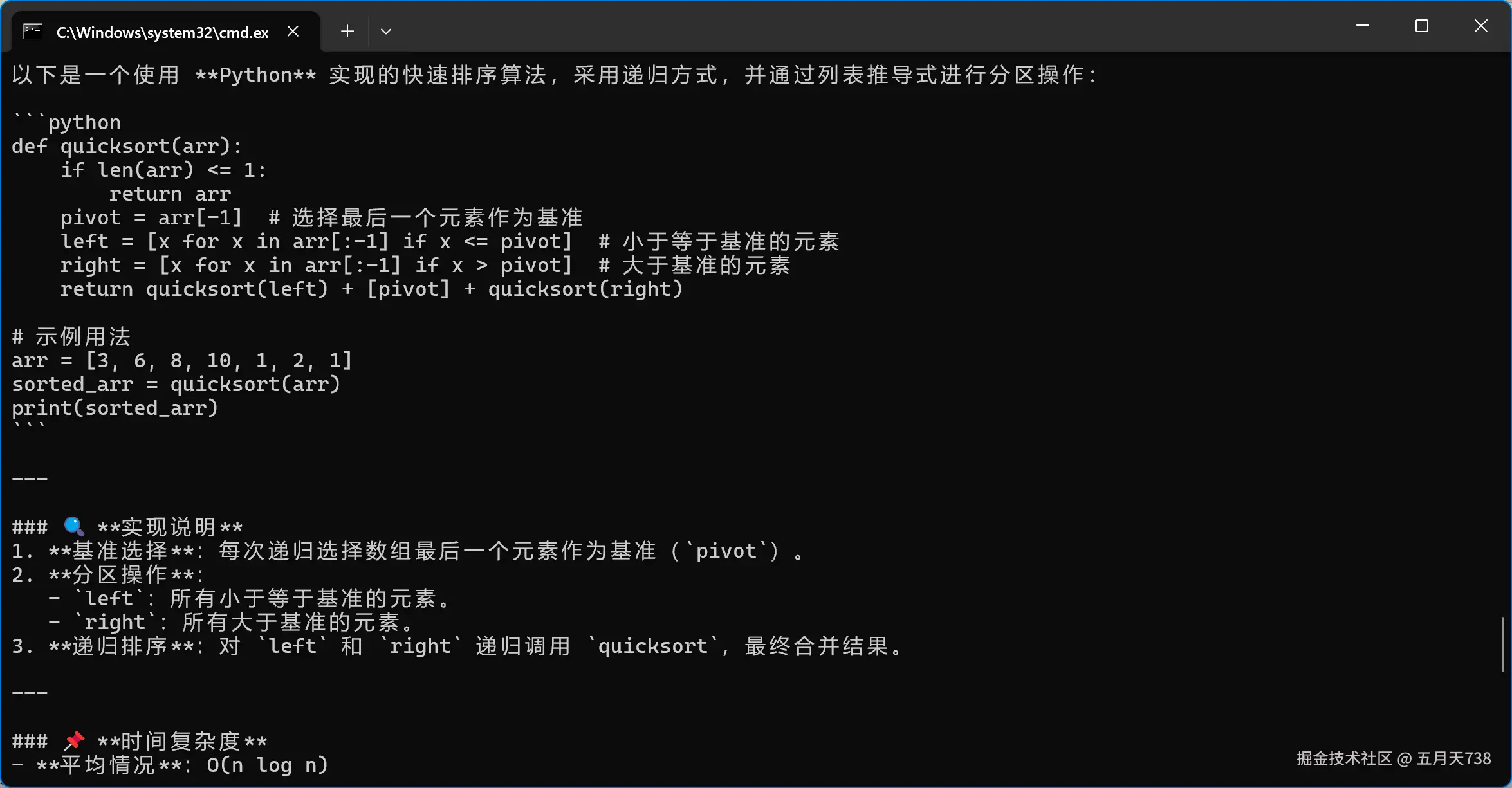

- 和网页版 ChatGPT 基本一样

- 中文理解能力在线,写代码也没问题

一个坑: 模型默认只用 CPU,如果你有独显,可以配置让它用 GPU,速度会快很多。我这是核显,就算了。

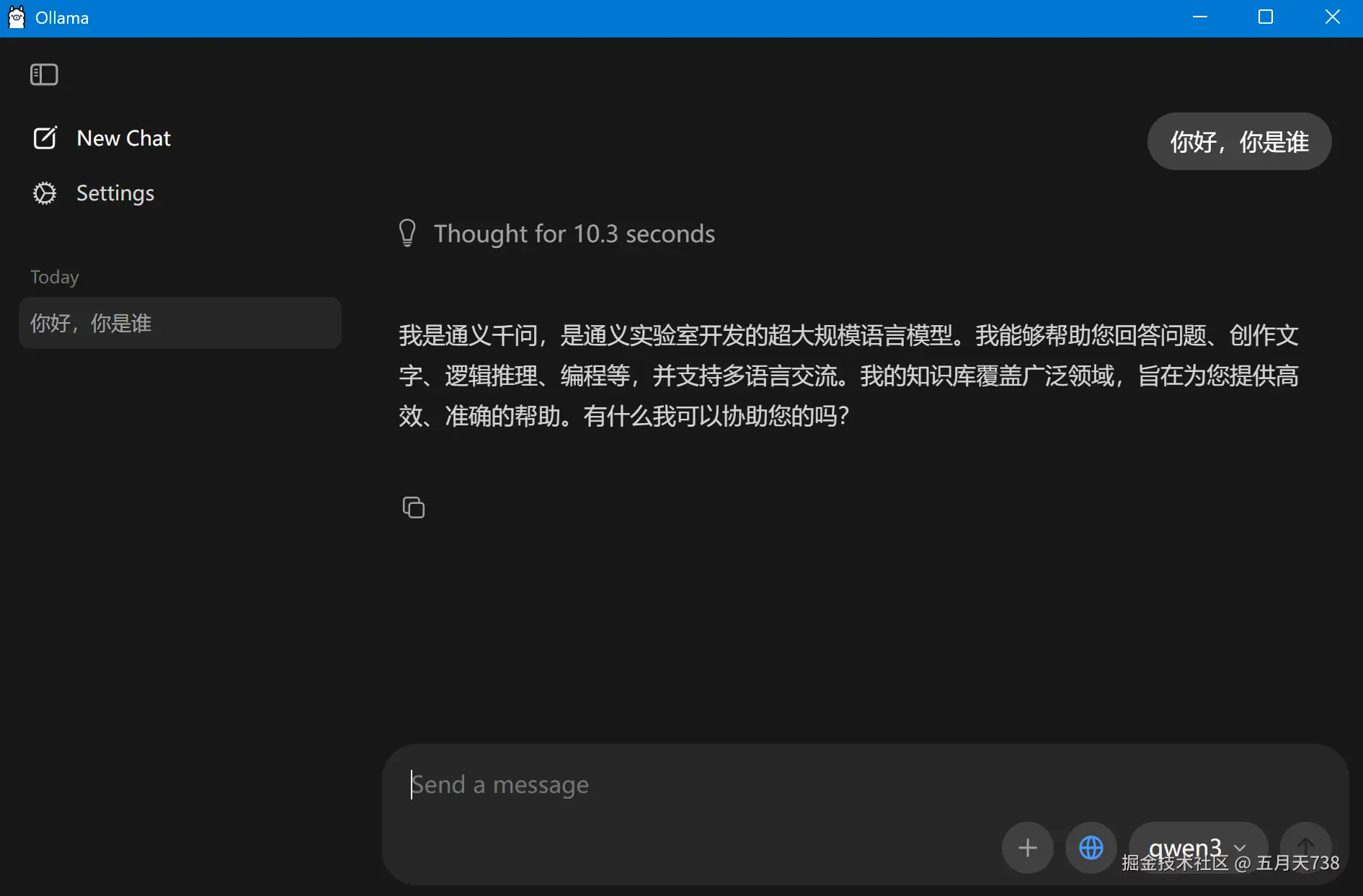

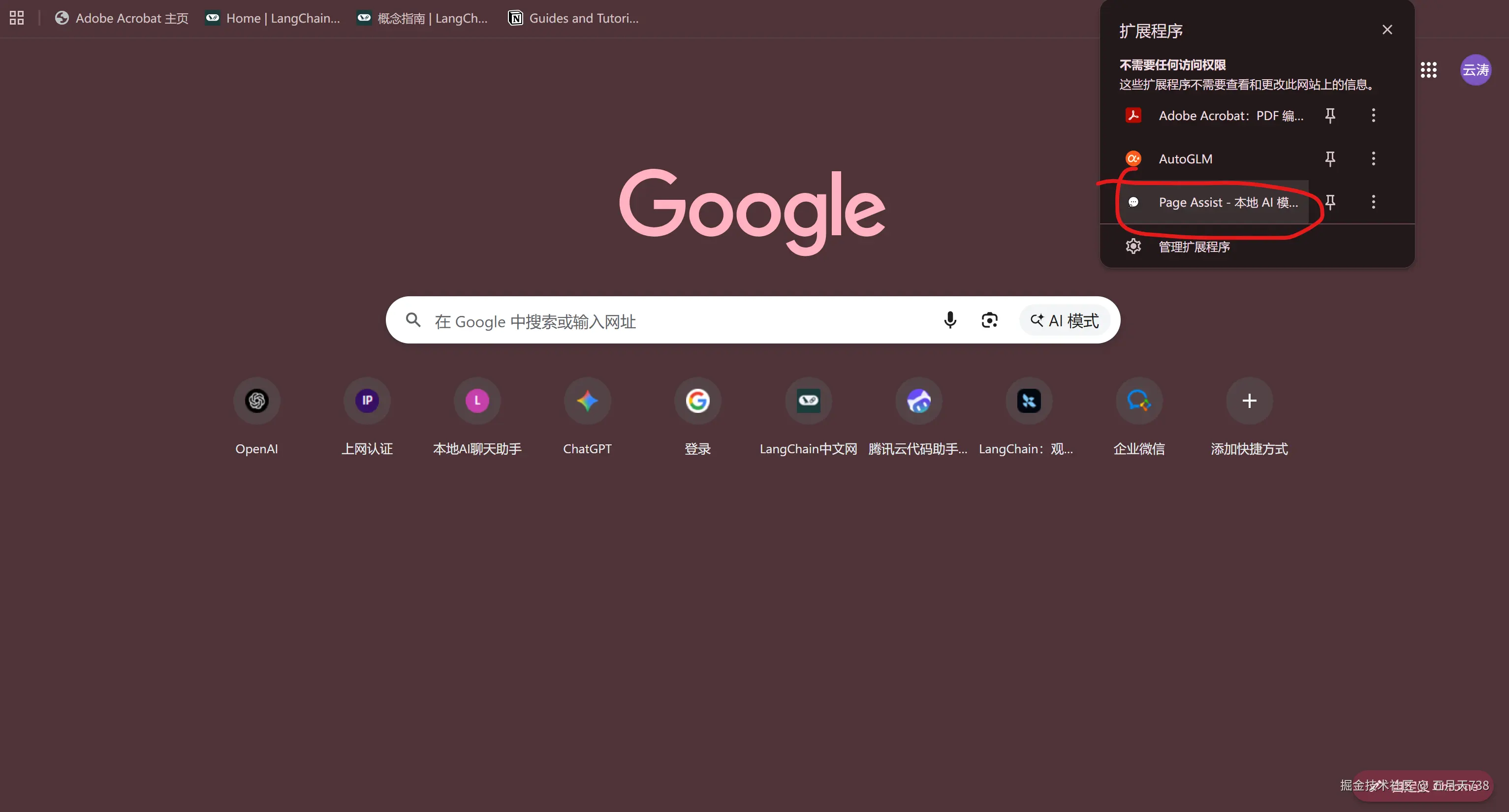

五、进阶玩法:接入到浏览器

命令行聊天太麻烦?可以装个浏览器插件:

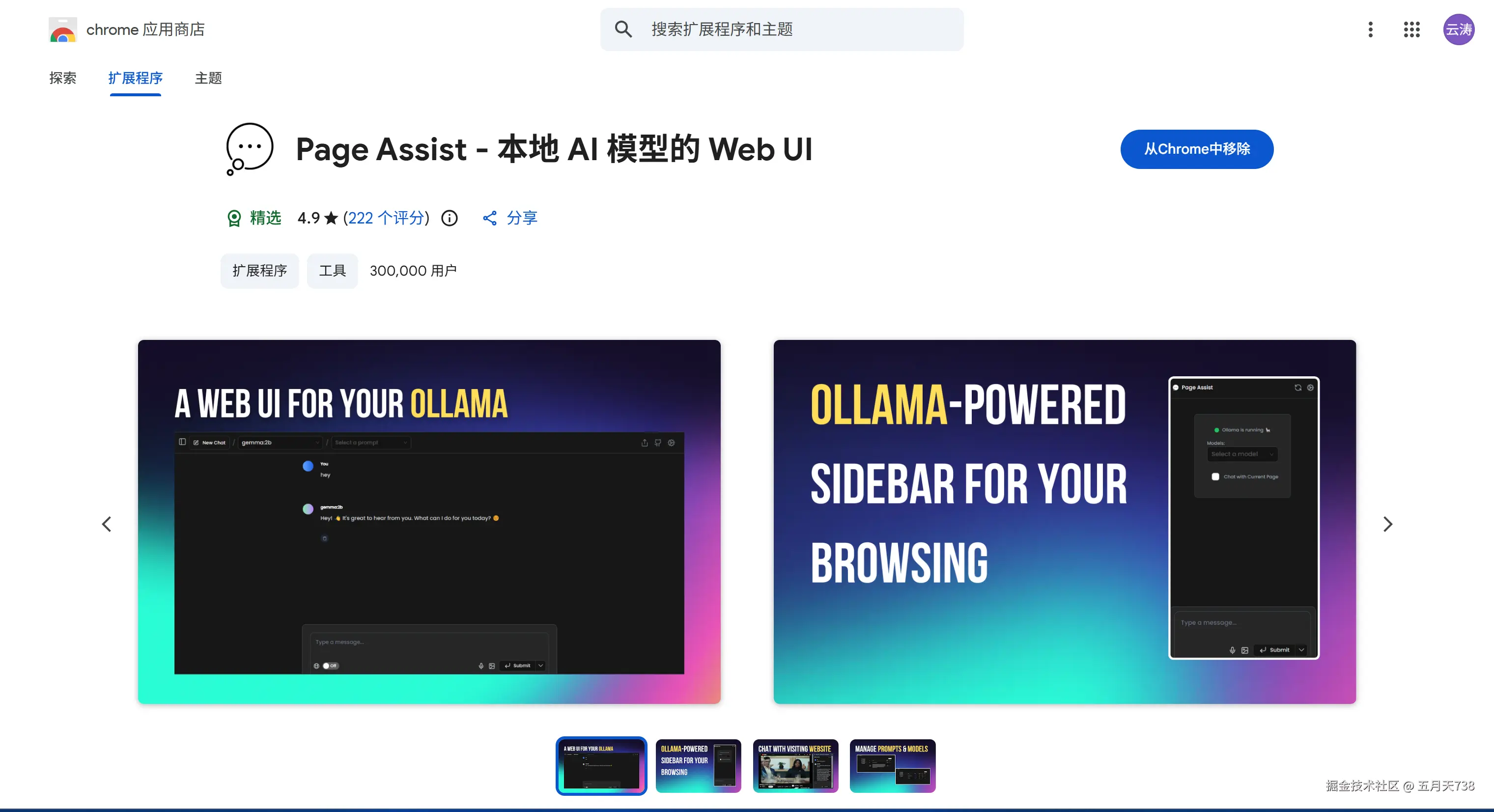

1. 安装 Page Assist 插件

- Chrome 商店搜索"Page Assist"

- 安装后点击插件图标

2. 配置插件

- 插件设置里选 Ollama

- 地址填:http://localhost:11434

- 模型选 qwen3:latest

3. 开始使用

- 在任何网页都能调用 Qwen3

- 选中文字右键"用 AI 解释"

- 直接聊天、写代码、翻译

这个插件我吹爆,完全解决了命令行不方便的问题。

六、常见问题

1. 下载模型失败

- 问题:网络超时

- 解决:换个时间重试,或者用代理

2. 内存不足

-

问题:16G 内存跑不起来

-

解决:用更小的模型,比如 qwen3:1.8b

ollama pull qwen3:1.8b ollama run qwen3:1.8b

3. 端口被占用

-

问题:11434 端口被占用

-

解决:关闭占用端口的程序,或者修改 Ollama 端口

set OLLAMA_HOST=0.0.0.0:11435

4. 回答质量差

- 问题:模型没有加载完整

- 解决:检查网络,重新下载模型

七、总结

折腾了两天,总结几点:

优点:

- 完全免费,不用充会员

- 离线可用,没网也能用

- 数据不经过第三方,隐私有保障

缺点:

- 第一次配置麻烦

- 速度比网页版慢一点点

- 需要占用本地存储(5GB)

适合人群:

- 经常没网的学生

- 对数据隐私有要求的人

- 想省钱的人(比如我)

不适合:

- 懒得折腾的人

- 电脑配置太低(<8G 内存)

- 追求极致速度的人

总的来说,花一下午折腾,换来免费、离线、隐私的 AI,我觉得值。特别是对于我们这种穷学生,能省一点是一点。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)