数据科学中的神经符号学习:结合规则与数据

本文旨在全面介绍神经符号学习的基本概念、原理和实践应用,帮助读者理解如何将符号AI的逻辑推理能力与神经网络的模式识别能力相结合,从而构建更强大、更可解释的人工智能系统。文章将从神经符号学习的基本概念开始,逐步深入到技术原理、数学模型、实现方法和应用场景,最后探讨未来发展趋势。神经符号学习:结合神经网络和符号推理的混合AI方法符号AI:基于规则和逻辑推理的人工智能方法神经网络:受生物神经网络启发的计

数据科学中的神经符号学习:结合规则与数据

关键词:神经符号学习、符号AI、神经网络、知识表示、数据科学、规则系统、混合智能系统

摘要:本文深入探讨了神经符号学习这一新兴领域,它将基于规则的符号系统与数据驱动的神经网络相结合。文章从基本概念入手,通过生动的类比解释复杂的技术原理,详细分析了神经符号学习的架构设计、实现方法和应用场景。通过实际的Python代码示例,展示了如何构建简单的神经符号系统,并探讨了该技术面临的挑战和未来发展方向。

背景介绍

目的和范围

本文旨在全面介绍神经符号学习的基本概念、原理和实践应用,帮助读者理解如何将符号AI的逻辑推理能力与神经网络的模式识别能力相结合,从而构建更强大、更可解释的人工智能系统。

预期读者

对机器学习、人工智能和数据科学有一定基础的技术人员、研究人员和学生,以及对AI系统可解释性感兴趣的从业者。

文档结构概述

文章将从神经符号学习的基本概念开始,逐步深入到技术原理、数学模型、实现方法和应用场景,最后探讨未来发展趋势。

术语表

核心术语定义

- 神经符号学习:结合神经网络和符号推理的混合AI方法

- 符号AI:基于规则和逻辑推理的人工智能方法

- 神经网络:受生物神经网络启发的计算模型

相关概念解释

- 知识表示:如何用计算机可理解的形式表示人类知识

- 规则系统:基于if-then规则的决策系统

- 可解释AI:能够提供决策理由的AI系统

缩略词列表

- NSL: Neural Symbolic Learning

- AI: Artificial Intelligence

- ML: Machine Learning

- NN: Neural Network

核心概念与联系

故事引入

想象一下,你正在教一个小朋友识别动物。传统的方法可能是展示成千上万张图片(神经网络方法),或者详细讲解每种动物的特征规则(符号方法)。但最有效的方法是结合两者:先讲解基本规则(“所有猫咪都有尖耳朵和胡须”),然后通过实际图片加深理解。这就是神经符号学习的核心思想!

核心概念解释

核心概念一:神经网络

神经网络就像是一个超级模式识别器,它通过分析大量数据来学习模式,但往往说不清楚自己为什么做出某个决策。就像一个小孩子通过看很多猫图片学会了识别猫,但说不清楚猫的具体特征。

核心概念二:符号系统

符号系统则像是遵循明确规则的专家,它使用逻辑推理来做决策,能够清晰解释自己的 reasoning过程。就像一位动物学家根据明确的特征规则来识别动物。

核心概念三:神经符号学习

神经符号学习将两者的优势结合起来,让系统既能从数据中学习模式,又能遵循逻辑规则并进行可解释的推理。就像是既接受过专业培训又积累了大量实践经验的动物专家。

核心概念之间的关系

神经网络和符号系统的关系

神经网络擅长发现数据中的隐藏模式,但不擅长进行逻辑推理;符号系统擅长逻辑推理,但不擅长从原始数据中学习。它们就像是一个团队中的两个专家,各自擅长不同的领域。

数据和规则的关系

数据提供了现实世界的具体实例,而规则提供了抽象的知识框架。神经符号学习让系统能够同时从实例中学习和遵循抽象规则。

学习和推理的关系

学习是从数据中提取知识的过程,推理是应用知识进行决策的过程。神经符号学习实现了学习和推理的紧密结合。

核心概念原理和架构的文本示意图

原始数据 → 神经网络 → 符号表示 → 符号推理 → 最终决策

↑ ↓ ↑ ↓

数据学习 表示转换 规则应用 可解释输出

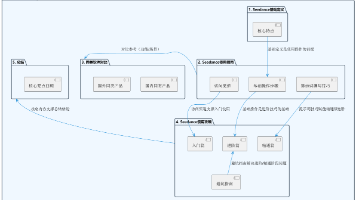

Mermaid 流程图

核心算法原理 & 具体操作步骤

神经符号学习的核心是将神经网络与符号推理相结合。下面我们通过一个简单的例子来演示这一过程。

神经网络部分实现

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

class NeuralSymbolicNet(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(NeuralSymbolicNet, self).__init__()

self.fc1 = nn.Linear(input_size, hidden_size)

self.relu = nn.ReLU()

self.fc2 = nn.Linear(hidden_size, output_size)

self.symbolic_layer = SymbolicLayer() # 自定义符号层

def forward(self, x):

# 神经网络前向传播

x = self.fc1(x)

x = self.relu(x)

x = self.fc2(x)

# 转换为符号表示

symbolic_representation = self.to_symbolic(x)

# 符号推理

result = self.symbolic_reasoning(symbolic_representation)

return result

def to_symbolic(self, neural_output):

"""将神经网络输出转换为符号表示"""

# 这里可以将连续值转换为离散的符号

symbols = []

for value in neural_output:

if value > 0.7:

symbols.append('HIGH')

elif value > 0.3:

symbols.append('MEDIUM')

else:

symbols.append('LOW')

return symbols

def symbolic_reasoning(self, symbols):

"""基于符号进行推理"""

# 这里可以定义各种推理规则

if symbols[0] == 'HIGH' and symbols[1] == 'LOW':

return 'CAT'

elif symbols[0] == 'LOW' and symbols[1] == 'HIGH':

return 'DOG'

else:

return 'UNKNOWN'

符号推理层实现

class SymbolicLayer:

def __init__(self):

self.rules = self.load_rules()

def load_rules(self):

"""加载预定义的符号规则"""

rules = {

'CAT': ['has_fur', 'has_whiskers', 'pointy_ears'],

'DOG': ['has_fur', 'has_tail', 'floppy_ears'],

'BIRD': ['has_feathers', 'has_beak', 'can_fly']

}

return rules

def apply_rules(self, features):

"""应用规则进行推理"""

scores = {}

for category, rule_features in self.rules.items():

match_count = sum(1 for feat in features if feat in rule_features)

scores[category] = match_count / len(rule_features)

# 返回匹配度最高的类别

return max(scores.items(), key=lambda x: x[1])[0]

数学模型和公式 & 详细讲解

神经符号学习涉及多个数学概念,其中最核心的是如何将神经网络的连续表示与符号系统的离散表示进行桥接。

符号表示的概率模型

我们可以使用概率模型来表示符号的不确定性:

P(symbol∣x)=ef(x)∑s′ef′(x)P(symbol|x) = \frac{e^{f(x)}}{\sum_{s'} e^{f'(x)}}P(symbol∣x)=∑s′ef′(x)ef(x)

其中 f(x)f(x)f(x) 是神经网络生成的符号得分函数。

规则满足度的度量

对于规则 rrr 和输入 xxx,我们可以定义规则满足度:

S(r,x)=∏i=1nP(li∣x)S(r, x) = \prod_{i=1}^{n} P(l_i|x)S(r,x)=i=1∏nP(li∣x)

其中 lil_ili 是规则中的文字(literals)。

神经符号损失函数

结合数据损失和规则约束的损失函数:

L=Ldata+λLrules\mathcal{L} = \mathcal{L}_{data} + \lambda \mathcal{L}_{rules}L=Ldata+λLrules

其中 Ldata\mathcal{L}_{data}Ldata 是传统的数据拟合损失,Lrules\mathcal{L}_{rules}Lrules 是规则违反惩罚,λ\lambdaλ 是权衡参数。

项目实战:代码实际案例和详细解释说明

开发环境搭建

# 创建虚拟环境

python -m venv neurosymbolic-env

# 激活环境

source neurosymbolic-env/bin/activate # Linux/Mac

# 或者

neurosymbolic-env\Scripts\activate # Windows

# 安装依赖

pip install torch numpy matplotlib

源代码详细实现和代码解读

import torch

import torch.nn as nn

import torch.optim as optim

from torch.utils.data import Dataset, DataLoader

import numpy as np

# 创建简单的动物特征数据集

class AnimalDataset(Dataset):

def __init__(self, num_samples=1000):

self.data = []

self.labels = []

# 生成猫的特征数据

for _ in range(num_samples // 2):

# 猫的特征: 有毛, 有胡须, 尖耳朵

features = [1.0, 1.0, 1.0] + np.random.normal(0, 0.1, 5).tolist()

self.data.append(features)

self.labels.append(0) # 0代表猫

# 生成狗的特征数据

for _ in range(num_samples // 2):

# 狗的特征: 有毛, 有尾巴, 垂耳朵

features = [1.0, 0.0, 0.0] + np.random.normal(0, 0.1, 5).tolist()

features[4] = 1.0 # 确保有尾巴

features[5] = 1.0 # 确保垂耳朵

self.data.append(features)

self.labels.append(1) # 1代表狗

def __len__(self):

return len(self.data)

def __getitem__(self, idx):

return torch.tensor(self.data[idx], dtype=torch.float32), torch.tensor(self.labels[idx], dtype=torch.long)

# 定义神经符号网络

class NeuroSymbolicNetwork(nn.Module):

def __init__(self, input_size, hidden_size, num_symbols, num_classes):

super(NeuroSymbolicNetwork, self).__init__()

# 神经网络部分

self.neural_net = nn.Sequential(

nn.Linear(input_size, hidden_size),

nn.ReLU(),

nn.Linear(hidden_size, num_symbols),

nn.Sigmoid() # 输出在0-1之间,表示符号存在的概率

)

# 符号规则库

self.symbol_rules = {

'has_fur': 0, # 特征索引

'has_whiskers': 1, # 特征索引

'has_tail': 4, # 特征索引

'pointy_ears': 2, # 特征索引

'floppy_ears': 5 # 特征索引

}

# 类别规则

self.class_rules = {

'CAT': ['has_fur', 'has_whiskers', 'pointy_ears'],

'DOG': ['has_fur', 'has_tail', 'floppy_ears']

}

def forward(self, x):

# 神经网络前向传播

symbol_probs = self.neural_net(x)

# 应用符号规则进行推理

class_scores = self.symbolic_reasoning(symbol_probs)

return class_scores

def symbolic_reasoning(self, symbol_probs):

"""基于符号概率进行规则推理"""

batch_size = symbol_probs.size(0)

num_classes = len(self.class_rules)

class_scores = torch.zeros(batch_size, num_classes)

for i in range(batch_size):

for class_idx, (class_name, rules) in enumerate(self.class_rules.items()):

# 计算该类别的规则满足度

rule_score = 1.0

for rule in rules:

feature_idx = self.symbol_rules[rule]

rule_score *= symbol_probs[i, feature_idx]

class_scores[i, class_idx] = rule_score

return class_scores

def get_symbol_explanations(self, x):

"""获取可解释的符号级解释"""

symbol_probs = self.neural_net(x)

explanations = []

for i in range(x.size(0)):

explanation = {}

for symbol, idx in self.symbol_rules.items():

explanation[symbol] = float(symbol_probs[i, idx].item())

explanations.append(explanation)

return explanations

# 训练循环

def train_model():

# 超参数

input_size = 8

hidden_size = 16

num_symbols = 6 # 符号数量

num_classes = 2 # 类别数量

learning_rate = 0.01

num_epochs = 100

batch_size = 32

# 创建数据集和数据加载器

dataset = AnimalDataset(1000)

dataloader = DataLoader(dataset, batch_size=batch_size, shuffle=True)

# 初始化模型和优化器

model = NeuroSymbolicNetwork(input_size, hidden_size, num_symbols, num_classes)

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=learning_rate)

# 训练循环

for epoch in range(num_epochs):

for batch_idx, (data, targets) in enumerate(dataloader):

# 前向传播

outputs = model(data)

loss = criterion(outputs, targets)

# 反向传播和优化

optimizer.zero_grad()

loss.backward()

optimizer.step()

if (batch_idx + 1) % 10 == 0:

print(f'Epoch [{epoch+1}/{num_epochs}], Step [{batch_idx+1}/{len(dataloader)}], Loss: {loss.item():.4f}')

return model

# 测试模型

def test_model(model):

# 创建测试数据

test_cat = torch.tensor([1.0, 1.0, 1.0, 0.0, 0.0, 0.0, 0.0, 0.0], dtype=torch.float32).unsqueeze(0)

test_dog = torch.tensor([1.0, 0.0, 0.0, 0.0, 1.0, 1.0, 0.0, 0.0], dtype=torch.float32).unsqueeze(0)

# 预测

cat_output = model(test_cat)

dog_output = model(test_dog)

# 获取解释

cat_explanation = model.get_symbol_explanations(test_cat)

dog_explanation = model.get_symbol_explanations(test_dog)

print("Cat prediction:", torch.argmax(cat_output, dim=1).item())

print("Cat explanation:", cat_explanation[0])

print("\nDog prediction:", torch.argmax(dog_output, dim=1).item())

print("Dog explanation:", dog_explanation[0])

# 主函数

if __name__ == "__main__":

trained_model = train_model()

test_model(trained_model)

代码解读与分析

这个实现展示了神经符号学习的基本框架:

- 神经网络部分:学习从原始特征到符号表示的映射

- 符号推理部分:基于预定义的规则进行逻辑推理

- 可解释性:提供符号级的决策解释

关键优势:

- 可解释性:可以清楚地知道决策基于哪些符号和规则

- 数据效率:结合规则知识,需要更少的训练数据

- 可靠性:规则提供了额外的约束,提高系统的可靠性

实际应用场景

医疗诊断系统

在医疗领域,神经符号学习可以结合医学知识(规则)和患者数据(神经网络),提供既准确又可解释的诊断建议。

# 简化的医疗诊断示例

medical_rules = {

'FLU': ['fever', 'cough', 'fatigue'],

'COLD': ['cough', 'sneezing', 'runny_nose'],

'ALLERGY': ['sneezing', 'itchy_eyes', 'runny_nose']

}

class MedicalDiagnosisSystem(NeuroSymbolicNetwork):

def __init__(self):

super().__init__(input_size=10, hidden_size=20, num_symbols=8, num_classes=3)

self.symbol_rules = {

'fever': 0, 'cough': 1, 'fatigue': 2, 'sneezing': 3,

'runny_nose': 4, 'itchy_eyes': 5, 'headache': 6, 'sore_throat': 7

}

self.class_rules = medical_rules

金融风控系统

在金融领域,结合法规规则(符号)和交易模式数据(神经),构建更可靠的风控系统。

自动驾驶系统

结合交通规则(符号)和传感器数据(神经),做出既合规又适应复杂环境的驾驶决策。

工具和资源推荐

开发框架

- PyTorch:灵活的深度学习框架

- TensorFlow:强大的机器学习平台

- SymPy:符号计算库

专业库

- DeepProblog:概率逻辑编程库

- Neuro-symbolic concept learner:神经符号概念学习器

- Logical Neural Networks:逻辑神经网络

学习资源

- 书籍:《神经符号学习导论》

- 论文:NeurIPS、ICML相关论文

- 在线课程:Coursera、edX上的相关课程

未来发展趋势与挑战

发展趋势

- 更紧密的融合:神经网络和符号系统的更深层次集成

- 自动化规则学习:从数据中自动发现和提炼规则

- 跨领域应用:在更多领域展现价值

技术挑战

- 表示对齐问题:如何更好地桥接连续和离散表示

- 规则冲突解决:当多个规则产生冲突时的决策机制

- 可扩展性:如何处理大规模规则和复杂推理

实际挑战

- 领域知识获取:如何有效获取和表示专家知识

- 系统验证:如何验证混合系统的可靠性

- 计算效率:平衡推理深度和计算成本

总结:学到了什么?

核心概念回顾

我们学习了神经符号学习如何将神经网络的模式识别能力与符号系统的逻辑推理能力相结合,创造出更强大、更可解释的AI系统。

概念关系回顾

神经网络和符号系统不是竞争对手,而是可以互补的合作伙伴。数据提供现实世界的实例,规则提供抽象的知识框架,两者结合可以产生更好的智能系统。

技术收获

通过实际的代码示例,我们看到了如何实现简单的神经符号系统,以及如何应用在医疗诊断等实际场景中。

思考题:动动小脑筋

思考题一:

你能想到在日常生活中,哪些任务既需要模式识别(神经网络)又需要逻辑推理(符号系统)?比如,烹饪一道新菜肴时,既需要识别食材(模式识别),又需要遵循烹饪步骤(逻辑推理)。

思考题二:

如果你要设计一个神经符号学习系统来帮助学生学习数学,你会如何设计神经网络部分和符号规则部分?神经网络可以识别题目类型,符号系统可以应用数学定理进行推理。

思考题三:

在什么情况下,神经符号学习可能比纯神经网络或纯符号系统表现更差?如何避免这种情况?

附录:常见问题与解答

Q1: 神经符号学习需要大量的标注数据吗?

A: 相比纯神经网络,神经符号学习通常需要更少的标注数据,因为它可以借助规则知识。

Q2: 如何获取和表示领域知识?

A: 可以通过专家访谈、文献分析、知识图谱等方式获取知识,并用规则、逻辑公式等形式表示。

Q3: 神经符号学习的计算成本高吗?

A: 相比纯神经网络,确实有额外的计算成本,但通常可以通过优化和近似推理来管理。

扩展阅读 & 参考资料

- Garcez, A. d., & Lamb, L. C. (2020). Neurosymbolic AI: The 3rd Wave. ArXiv preprint.

- Besold, T. R., et al. (2017). Neural-Symbolic Learning and Reasoning: A Survey and Interpretation. Neuro-Symbolic Artificial Intelligence.

- Mao, J., et al. (2019). The Neuro-Symbolic Concept Learner: Interpreting Scenes, Words, and Sentences From Natural Supervision.

希望这篇文章帮助你全面理解了神经符号学习这一激动人心的领域!记住,最好的AI系统往往是那些能够结合多种方法优势的系统。

更多推荐

已为社区贡献152条内容

已为社区贡献152条内容

所有评论(0)