【OpenAI】GPT-3.5-Turbo-16K-0613实战技巧大全:玩转16K上下文,打造高效智能AI应用获取OpenAI API KEY的两种方式,开发者必看全方面教程!

法律合同、技术文档的全文分析长篇文章的自动摘要和提炼多章节书籍内容的整体理解和问答实战建议利用分块处理法,将超长文本拆分为合理段落,结合16K上下文实现跨段落理解结合“系统提示”引导模型聚焦重点,提升摘要质量通过以上步骤,你已经掌握了如何获取和使用 OpenAI API Key 的基本流程。无论你是开发者还是技术爱好者,掌握这些技能都将为你的项目增添无限可能!🌟。

GPT-3.5-Turbo-16K-0613实战技巧:玩转16K上下文,打造高效AI应用🔥

GPT-3.5-Turbo-16K-0613作为OpenAI最新支持16,000 token上下文窗口的强大模型,为开发者带来了前所未有的文本处理能力。如何充分利用这16K的超大上下文,实现更智能、更精准的AI应用?本文为你总结了多项实战技巧,助你快速提升项目质量和效率!

1. 合理利用16K上下文,提升多轮对话体验💬

传统模型上下文有限,导致多轮对话时容易丢失关键信息。16K上下文让你可以:

- 保存更长的对话历史,让AI更好理解用户意图

- 支持复杂场景切换,如客服、咨询、教育等多角色对话

- 实现上下文记忆功能,避免重复问答,提高交互流畅度

实战建议:

- 设计对话管理模块,动态维护对话历史,确保传入模型的消息列表不超16K token

- 定期清理无关信息,保持上下文相关性和精简性

2. 长文档处理与摘要生成📄

16K token支持你一次性输入整篇长文档,适合:

- 法律合同、技术文档的全文分析

- 长篇文章的自动摘要和提炼

- 多章节书籍内容的整体理解和问答

实战建议:

- 利用分块处理法,将超长文本拆分为合理段落,结合16K上下文实现跨段落理解

- 结合“系统提示”引导模型聚焦重点,提升摘要质量

3. 代码审查与生成🖥️

16K上下文让AI能一次性“看懂”更大规模的代码文件,适合:

- 复杂项目的代码审查和优化建议

- 多文件代码片段的联动生成

- 详细代码注释和文档生成

实战建议:

- 传入完整函数或模块代码,结合上下文进行精准分析

- 结合版本控制信息,辅助生成变更说明和代码差异解读

4. 参数调优与成本控制💡

虽然16K上下文强大,但调用成本和响应时间也会增加,合理调优参数至关重要:

- max_tokens:根据任务需求设置生成长度,避免无效浪费

- temperature:控制生成文本的创造性,复杂任务建议0.3-0.7之间

- top_p:配合temperature使用,控制输出多样性

实战建议:

- 监控API调用token数,结合业务需求动态调整上下文长度

- 对于实时交互场景,优先保证响应速度,适当缩减上下文

5. 错误处理与稳定性保障🛠️

长上下文带来更复杂的输入,可能出现截断、超时等问题:

- 分块传入:对超长文本分块处理,避免单次请求超限

- 重试机制:捕获异常,自动重试请求,保证稳定性

- 日志记录:详细记录请求和响应,便于排查问题

6. 结合外部知识库,实现智能问答📚

利用16K上下文优势,将知识库内容直接传入模型,实现:

- 高效的文档问答系统

- 结合上下文进行精准知识检索

- 动态更新知识内容,保持信息时效性

第一种方式(国外):获取 OpenAI API Key

要开始使用 OpenAI 的服务,你首先需要获取一个 API Key。以下是获取 API Key 的详细步骤:

1. 访问 OpenAI

在浏览器中点击 OpenAI 。

2. 创建账户

- 点击网站右上角的“Sign Up”或者选择“Login”登录已有用户。

3. 进入 API 管理界面

- 登录后,导航到“API Keys”部分。

4. 生成新的 API Key

- 在 API Keys 页面,点击“Create new key”按钮,按照提示完成 API Key 的创建。

注意:创建 API Key 后,务必将其保存在安全的地方,避免泄露。🔒

使用 OpenAI API

现在你已经拥有了 API Key 并完成了充值,接下来是如何在你的项目中使用 GPT-4.0 API。以下是一个简单的 Python 示例,展示如何调用 API 生成文本:

import openai

import os

# 设置 API Key

openai.api_key = os.getenv("OPENAI_API_KEY")

# 调用 GPT-4.0 API

response = openai.Completion.create(

model="gpt-4.0-turbo",

prompt="鲁迅与周树人的关系。",

max_tokens=100

)

# 打印响应内容

print(response.choices[0].text.strip())

代码解析

- 导入库:首先导入必要的库。

- 设置 API Key:通过环境变量设置 API Key。

- 调用 API:发送一个包含问题的请求到 GPT-4.0 模型。

- 打印响应:打印出模型生成的答案。

通过这段代码,你可以轻松地与 OpenAI 的 GPT-4.0 模型进行交互,获取你所需的文本内容。✨

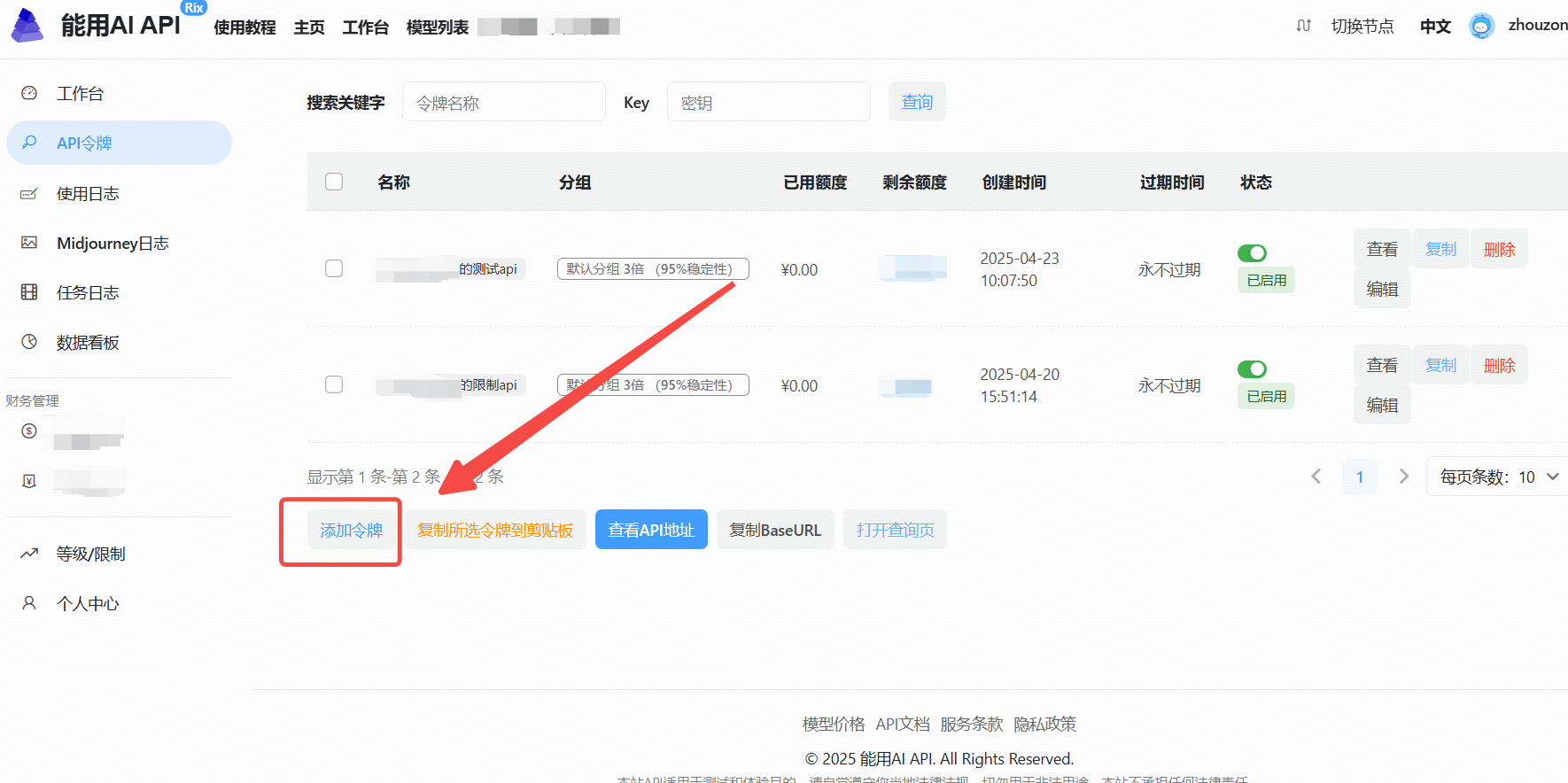

第二种方式(国内):获取 能用AI API Key

要开始使用 能用AI 的服务,以下是获取 API Key 的详细步骤:

1. 点击 [能用AI 工具]

在浏览器中打开 能用AI 工具。

2. . 进入 API 管理界面

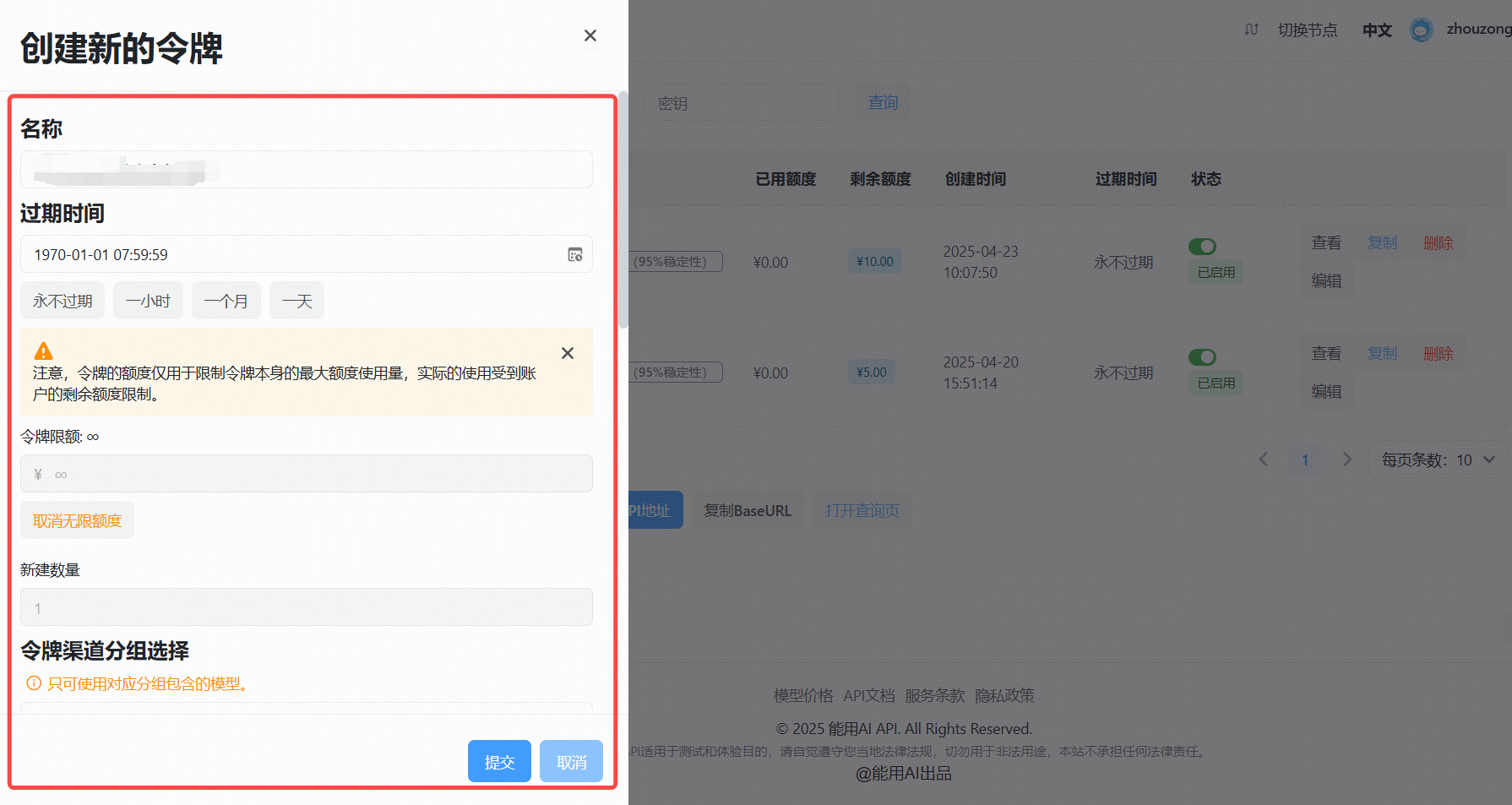

3. 生成新的 API Key

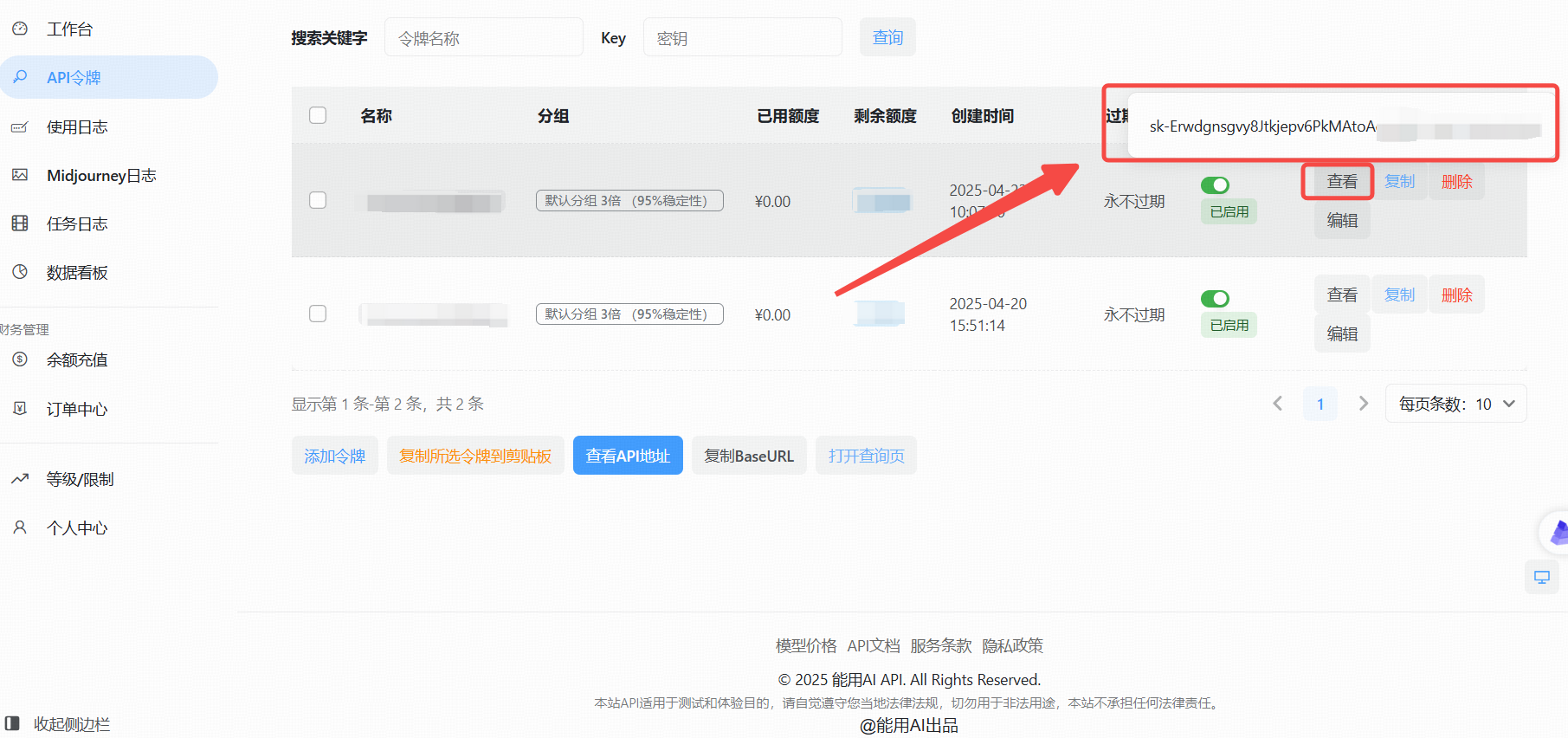

创建成功后点击“查看KEY”

4. 调用代码使用 能用AI API

# [调用API:具体模型大全](https://flowus.cn/codemoss/share/42cfc0d9-b571-465d-8fe2-18eb4b6bc852)

from openai import OpenAI

client = OpenAI(

api_key="这里是能用AI的api_key",

base_url="https://ai.nengyongai.cn/v1"

)

response = client.chat.completions.create(

messages=[

{'role': 'user', 'content': "鲁迅为什么打周树人?"},

],

model='gpt-4',

stream=True

)

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)

总结

通过以上步骤,你已经掌握了如何获取和使用 OpenAI API Key 的基本流程。无论你是开发者还是技术爱好者,掌握这些技能都将为你的项目增添无限可能!🌟

更多推荐

已为社区贡献67条内容

已为社区贡献67条内容

所有评论(0)