毕业设计:基于YOLO+deepseek课堂行为智能检测系统(源码)

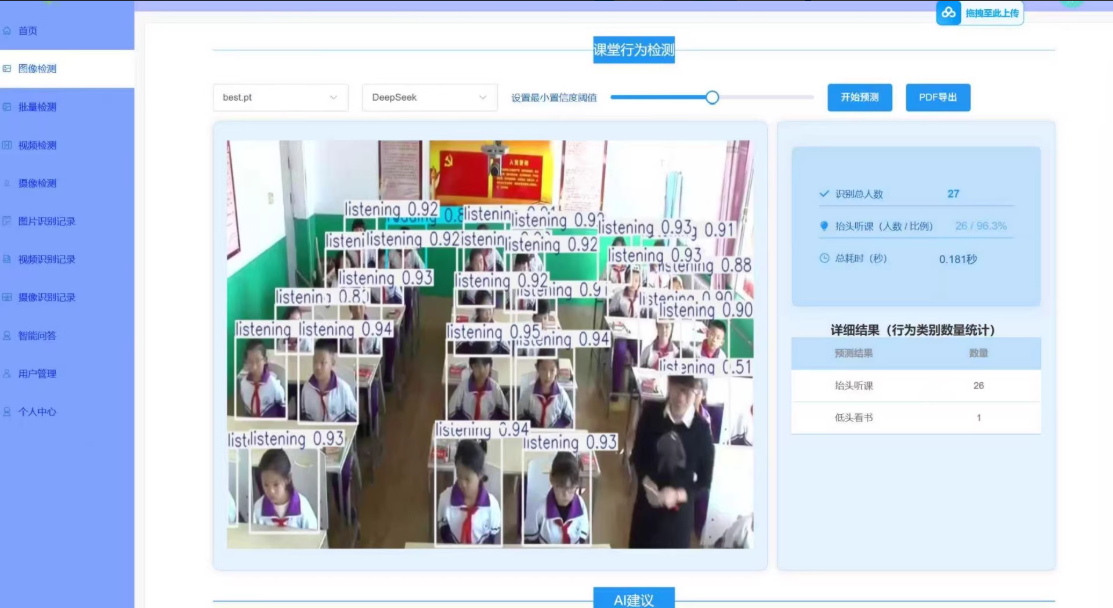

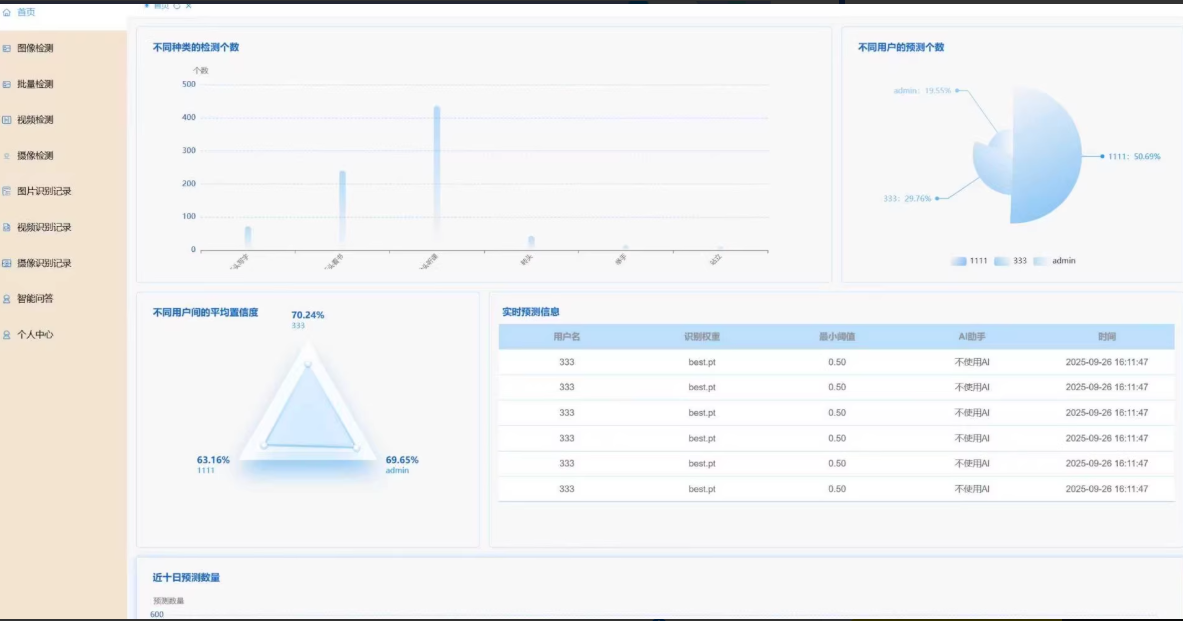

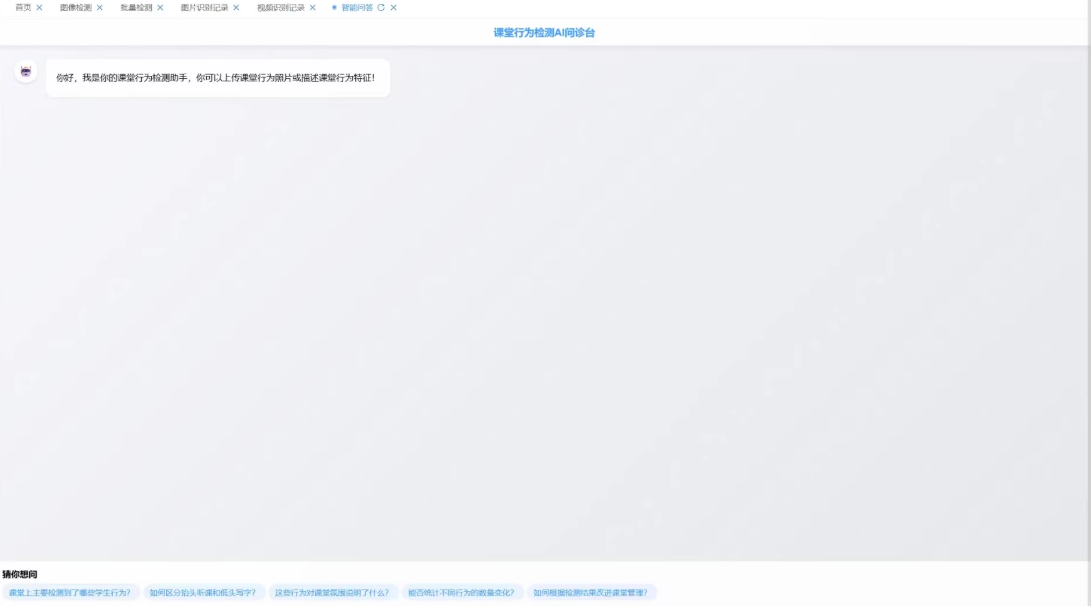

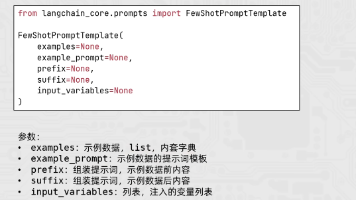

本文提出了一种基于YOLO+DeepSeek的课堂行为智能检测系统,通过计算机视觉与自然语言处理的融合创新,实现了教学行为的自动化分析与评估。系统采用Python(Flask/PyTorch)和Java(SpringBoot)双架构,前端基于Vue3+ElementPlus,支持图片/视频/实时摄像头等多种输入方式。核心改进YOLO算法专注6类课堂行为识别,结合DeepSeek大模型提供语义分析与

一、项目背景

在当前教育信息化快速发展的时代背景下,课堂教学质量的科学评估与学生学习状态的精准分析已成为教育现代化的重要课题。传统课堂观察主要依赖教师主观经验或人工录像分析,这种方法不仅效率低下、耗时费力,而且缺乏客观量化标准,难以实现大规模、常态化的课堂行为分析。随着“双减”政策和素质教育改革的深入推进,如何利用智能化技术实现课堂教学过程的自动化分析与评估,成为教育技术研究的前沿方向。

近年来,计算机视觉技术的突破为课堂行为智能分析提供了新的可能。YOLO系列目标检测算法以其卓越的实时性和检测精度,在人员检测、姿态识别等领域展现出强大潜力。然而,单纯的视觉检测技术难以理解复杂教学情境中的语义信息——例如,无法区分“举手发言”与“举手提问”、“小组讨论”与“课堂私语”等细微行为差异,更难以从行为序列中挖掘深层教学规律。

与此同时,大型语言模型如DeepSeek在多模态理解、上下文推理和知识关联方面取得了革命性进展。将DeepSeek的语义理解能力与YOLO的视觉检测技术深度融合,能够突破传统行为分析的局限:不仅能识别师生的肢体动作和面部表情,还能理解行为发生的教学情境、分析行为间的逻辑关联、甚至评估教学互动的质量与效果。

本毕业设计旨在构建一个基于YOLO+DeepSeek的课堂行为智能检测系统,通过视觉检测与语义理解的协同创新,实现从“看到行为”到“理解教学”的跨越。系统将自动识别师生互动、学习投入、课堂参与等关键行为指标,为教师提供精准的教学反思数据,为管理者提供科学的课堂评估依据,最终推动课堂教学从经验驱动向数据智能驱动转型。这项研究不仅具有重要的理论创新价值,更能为智慧课堂建设、教师专业发展和教育质量监测提供切实可行的技术解决方案。

二、技术介绍

主体语言:Python (PyTorch, Flask), Java (Spring Boot), JavaScript (Vue3)

数据库:MySQL(可替换)

前端:Vue3 + Element Plus + Pinia + Axios

模型:改进YOLOv5/YOLOv8/YOLO11/YOLO12(基于 PyTorch)

其他:SocketIO(实时消息/进度),FFmpeg(视频转码),JSZip(前端文件夹上传压缩)

本系统采用Python与Java双语言协同架构,充分发挥各自领域的专业优势。Python作为人工智能领域的主流语言,负责深度学习核心模块,基于PyTorch框架实现改进型YOLO系列目标检测算法,并通过Flask轻量级Web框架提供模型推理API服务。Java则以其在企业级应用中的成熟生态,通过Spring Boot框架构建稳定的业务逻辑层,处理用户管理、权限控制、任务调度等复杂业务场景。前端采用JavaScript生态的Vue3框架,配合Composition API和响应式系统,构建现代化的单页面应用界面。这种多语言架构既保证了AI模型的高效开发和部署,又确保了系统整体的稳定性和可维护性。

前端架构基于Vue3渐进式框架,采用组合式API实现更灵活的逻辑组织。Element Plus作为UI组件库,提供丰富的界面元素和一致的设计语言。状态管理采用Pinia替代传统Vuex,实现更简洁直观的状态管理方案。网络通信层使用Axios处理HTTP请求,配合拦截器实现统一的错误处理和权限验证。针对大文件上传需求,集成JSZip库实现前端文件夹压缩上传功能,有效减少网络传输负担。通过模块化设计,前端划分为用户交互、数据可视化、实时监控、文件管理等多个功能模块。

核心检测模型基于PyTorch框架,支持YOLOv5/YOLOv8/YOLO11/YOLO12等多种版本,根据实际检测精度和速度需求灵活选择。针对课堂行为检测的特殊场景,我们对标准YOLO架构进行多方面改进:引入注意力机制增强关键行为识别能力,改进特征金字塔结构适应多尺度人体姿态检测,优化损失函数提升遮挡情况下的检测鲁棒性。系统支持多模型并行部署和A/B测试,通过在线学习机制持续优化模型性能。

主要数据存储采用MySQL关系型数据库,设计规范化的表结构存储用户信息、课堂录像、检测结果、系统日志等结构化数据。考虑到未来可能的数据扩展需求,系统设计了抽象数据访问层,支持平滑迁移到其他数据库系统。视频处理方面,FFmpeg负责视频文件的转码、分段、帧提取等预处理操作,支持多种视频格式的输入输出。针对大规模视频数据,系统实现了分布式存储和缓存机制。

实时通信层采用Socket.IO库实现双向通信,支持课堂行为的实时检测反馈、处理进度推送、系统通知广播等功能。视频流处理模块结合WebRTC技术,实现低延迟的实时视频分析。系统架构设计注重可扩展性,通过微服务化设计将检测服务、用户服务、文件服务等解耦,支持容器化部署和水平扩展。整个技术栈选择兼顾了前沿性、稳定性和实用性,为课堂行为智能分析提供了坚实的技术基础。

系统还集成了完整的监控和日志体系,支持性能指标收集、异常报警和运行状态可视化,确保在复杂的教育场景中能够稳定可靠地运行。通过模块化的设计和标准化的接口,系统具备良好的可维护性和可扩展性,能够适应未来教育技术发展的新需求。

三、功能介绍

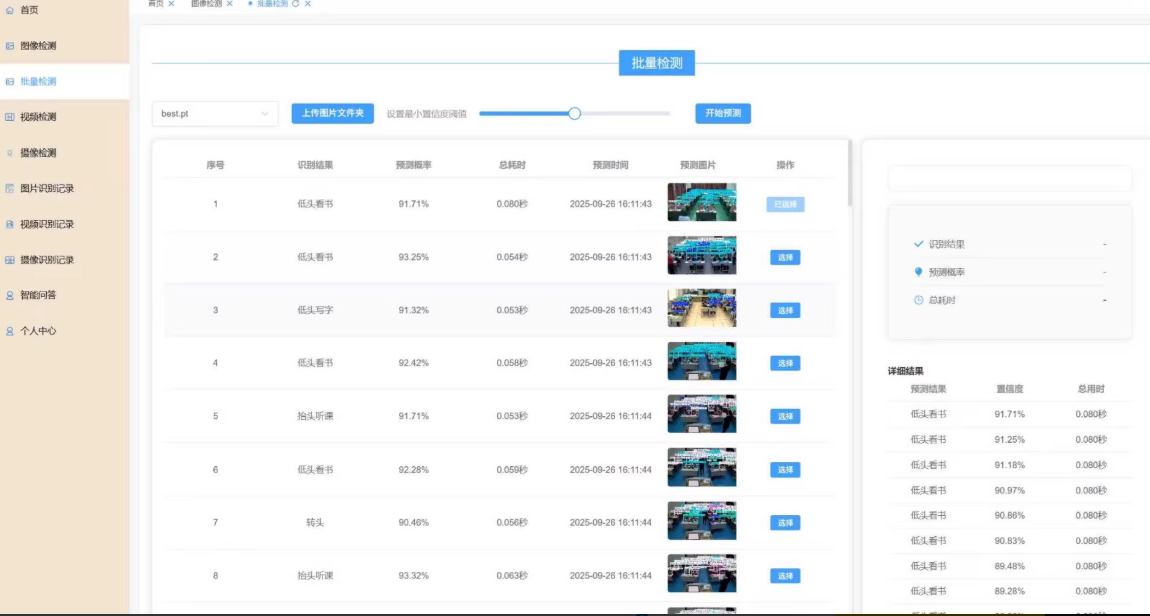

基于 改进YOLO(PyTorch)与大模型(DeepSeek / Qwen)结合的 课堂行为检测与智能分析系统,支持单图/批量/视频/实时摄像头输入,含前后端完整源码与环境配置,可开箱即用并支持定制。

系统亮点:

多场景检测:支持单张图片、图片文件夹、视频和实时摄像头等输入方式。

实时反馈:前端实时展示检测结果并能导出 PDF 报告。

高精度识别:基于 改进YOLO(可选 v5/8/11)+ PyTorch,专注课堂行为检测。

智能分析:可接入 DeepSeek / Qwen 生成分析建议(学习状态评估、课堂管理建议等)。

直观 UI:基于 Vue3 + Element Plus 的简洁操作界面。

完整交付:源码、训练好的模型、环境配置与使用指导文档一并交付;可按需定制功能或数据集训练。

功能清单:

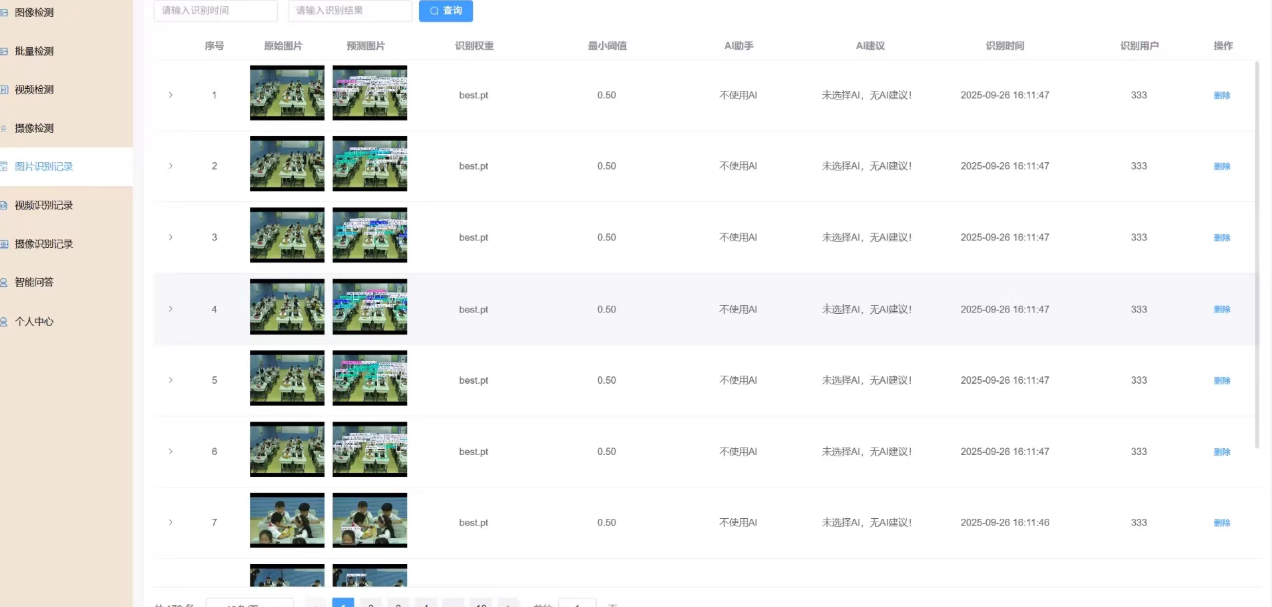

单张图片检测(上传并返回 outImg、label、confidence、耗时)

图片文件夹批量检测(打包上传、后台预测、返回批量结果)

上传视频 / 处理视频并返回带标注的视频(MJPEG 实时流 + 后台转码保存)

实时摄像头检测(打开摄像头流并输出实时标注 + 保存录像)

AI 智能建议(DeepSeek / Qwen 接口,可生成课堂表现分析、教学建议)

检测记录管理(前端展示历史记录,支持删除/查看)

PDF 报告导出(检测详情 + AI 建议)

可定制:行为类别、检测阈值、输出格式、UI 文案等

已训练好模型

本项目默认支持 6 类课堂行为(可扩展 / 重新训练):

低头写字

低头看书抬头听课转头举手站立

四、系统实现

更多推荐

已为社区贡献31条内容

已为社区贡献31条内容

所有评论(0)