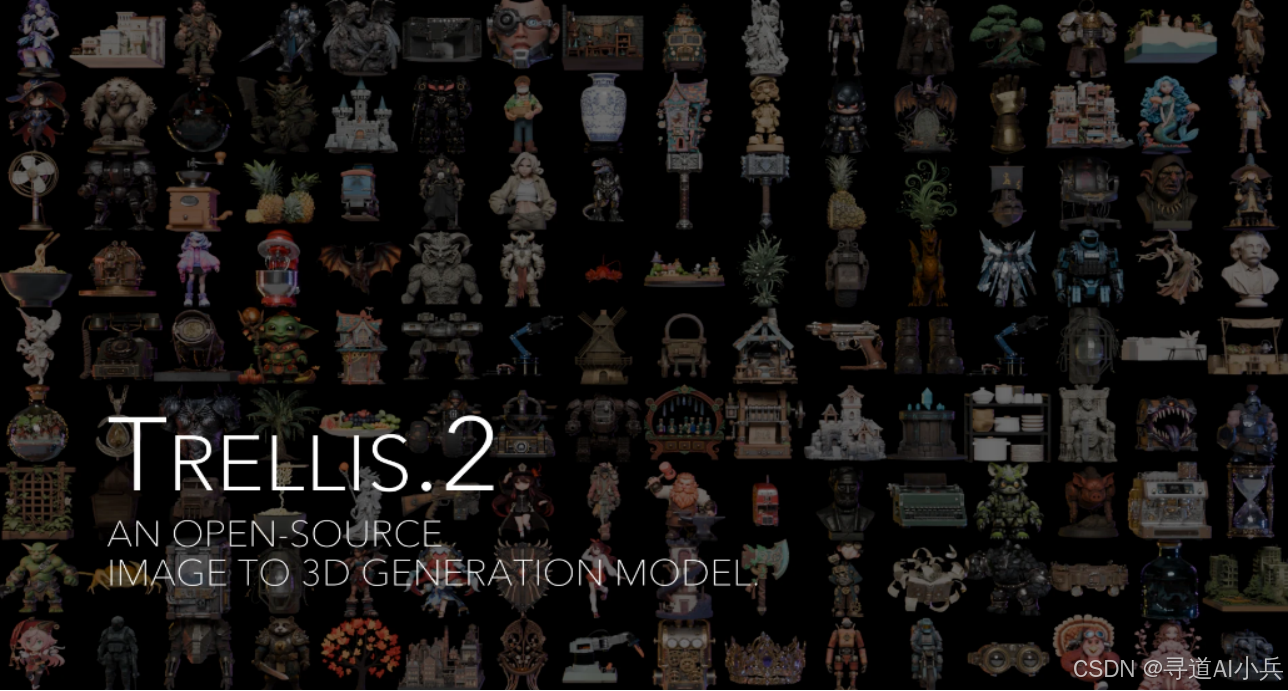

【AI大模型前沿】TRELLIS.2:微软开源的40亿参数图像转3D生成模型

TRELLIS.2是一个由微软开发的开源图像转3D生成模型,拥有40亿参数。它能够将单张图片高效地转换为高保真的3D资产,支持从512³到1536³的多分辨率输出。该模型的核心创新在于其“场无关”的O-Voxel表示法,能够稳健地处理复杂拓扑结构,如开放表面、非流形几何和内部封闭结构。此外,TRELLIS.2还支持完整的PBR材质建模,生成的3D模型具有丰富的纹理细节和逼真的材质效果。

系列篇章💥

目录

前言

随着人工智能技术的飞速发展,3D生成领域迎来了新的突破。微软开源的TRELLIS.2模型以其高效的图像转3D能力,为3D内容创作带来了革命性的变化。本文将深入探讨TRELLIS.2的技术特点、应用场景以及部署实践。

一、项目概述

TRELLIS.2是一个由微软开发的开源图像转3D生成模型,拥有40亿参数。它能够将单张图片高效地转换为高保真的3D资产,支持从512³到1536³的多分辨率输出。该模型的核心创新在于其“场无关”的O-Voxel表示法,能够稳健地处理复杂拓扑结构,如开放表面、非流形几何和内部封闭结构。此外,TRELLIS.2还支持完整的PBR材质建模,生成的3D模型具有丰富的纹理细节和逼真的材质效果。

二、核心功能

(一)图像到3D生成

TRELLIS.2能够根据输入的图像快速生成高质量的3D模型,适用于从2D图像创建3D资产的场景。用户只需提供一张图片,模型即可在短时间内生成具有复杂拓扑和丰富纹理的3D模型,极大地简化了3D内容创作的流程。

(二)复杂拓扑处理

TRELLIS.2的O-Voxel表示法能够处理复杂的3D结构,包括开放表面、非流形几何和内部封闭结构。这种表示法突破了传统等值面场的限制,支持完整的PBR材质建模,确保生成的3D模型在几何和材质上都具有高保真度。

(三)材质与纹理生成

生成的3D模型支持多种材质属性,如基础颜色、粗糙度、金属度和不透明度等,能够实现照片级真实感渲染。TRELLIS.2不仅生成高质量的几何形状,还能生成与输入图像高度一致的纹理和材质。

(四)多分辨率支持

TRELLIS.2支持从512³到1536³等多种分辨率的3D模型生成。用户可以根据需求选择合适的分辨率,模型在高分辨率下依然能够保持高效的生成速度。

(五)快速渲染与导出

生成的3D模型可以直接用于渲染,并支持导出为GLB等标准3D文件格式。TRELLIS.2结合了CUDA加速的网格处理工具和高效的渲染技术,确保生成的3D模型不仅质量高,而且生成速度快。

三、技术揭秘

(一)O-Voxel表示法

O-Voxel是一种创新的“场无关”稀疏体素结构,它不仅定义了3D空间中的一个个小方块(体素),还为每个小方块精确地绑定了其表面属性和空间关系。O-Voxel的三大突破性设计包括:

- 场依赖的终结:直接、显式地在稀疏的体素网格中编码几何与外观,避免了等值面提取可能带来的拓扑限制和精度损失。

- 几何与外观的统一载体:每个激活的O-Voxel不仅包含其空间坐标,还内嵌了该位置表面的完整PBR材质属性。

- 高效率的双向转换:在单核CPU上,将带纹理的网格转换为O-Voxel表示耗时小于10秒;在CUDA加速下,逆向转换回带纹理的网格仅需小于100毫秒。

(二)稀疏3D VAE编码

TRELLIS.2采用稀疏3D变分自编码器(VAE),通过16倍的空间下采样率将3D资产编码到紧凑的潜在空间中。这种设计使得模型能够高效地处理大规模数据集,并在保持高分辨率的同时显著提升处理效率。

(三)高效渲染与后处理

TRELLIS.2结合CUDA加速的网格处理工具(如CuMesh)和高效的渲染技术,快速生成高质量的3D模型,并支持实时渲染和后处理操作。

四、应用场景

(一)游戏开发

TRELLIS.2在游戏开发中具有巨大的应用潜力。它能够快速生成高质量的3D游戏资产,如角色、道具和场景等,显著提升开发效率并降低制作成本。通过高效的图像到3D生成能力,开发者可以在短时间内创建出复杂的3D模型,加速游戏开发流程,同时保证资产的高质量和逼真度。

(二)影视制作

在影视制作领域,TRELLIS.2可用于创建逼真的3D特效和虚拟场景。其支持复杂材质和纹理的能力,满足影视行业对视觉效果的高要求。无论是复杂的机械结构还是细腻的自然场景,TRELLIS.2都能生成高质量的3D模型,为影视特效制作提供强大的支持。

(三)虚拟现实(VR)和增强现实(AR)

TRELLIS.2能够生成沉浸式的3D环境和物体,增强用户体验。这使其非常适合用于VR和AR应用的开发。通过快速生成高质量的3D资产,开发者可以为用户提供更加逼真和互动的虚拟体验,推动VR和AR技术在教育、娱乐和工业等领域的应用。

(四)建筑设计与可视化

TRELLIS.2可以快速生成建筑模型和室内设计的3D可视化。设计师可以利用该模型快速将设计图纸转化为逼真的3D模型,帮助客户更好地理解和评估设计方案。其高效的生成能力和高质量的输出,使得建筑设计和可视化变得更加高效和直观。

(五)工业设计与产品开发

在工业设计和产品开发中,TRELLIS.2能够创建产品原型的3D模型,加速设计迭代过程。设计师可以快速生成不同版本的3D模型,进行虚拟展示和功能测试,从而缩短产品开发周期,降低开发成本,提高产品的市场竞争力。

(六)教育与培训

TRELLIS.2作为教学工具,可以帮助学生和受训者更好地理解和掌握3D建模、渲染和设计的相关知识和技能。通过直观的3D模型生成和展示,学生可以更快速地学习复杂的概念和技巧,提高学习效果。此外,它还可以用于虚拟实验室和培训模拟,提供更加真实的学习环境。

五、快速使用

以下是基于Hugging Face Spaces的TRELLIS.2部署和使用实践:

(一)环境准备

TRELLIS.2需要在Linux系统上运行,并且需要至少24GB显存的NVIDIA GPU。推荐使用CUDA 12.4版本。

(二)安装步骤

- 克隆TRELLIS.2项目仓库:

git clone -b main https://github.com/microsoft/TRELLIS.2.git --recursive

cd TRELLIS.2

- 安装依赖:

. ./setup.sh --new-env --basic --flash-attn --nvdiffrast --nvdiffrec --cumesh --o-voxel --flexgemm

(三)使用示例

以下是一个使用TRELLIS.2进行图像到3D生成的示例:

import os

os.environ['OPENCV_IO_ENABLE_OPENEXR'] = '1'

os.environ["PYTORCH_CUDA_ALLOC_CONF"] = "expandable_segments:True"

import cv2

import imageio

from PIL import Image

import torch

from trellis2.pipelines import Trellis2ImageTo3DPipeline

from trellis2.utils import render_utils

from trellis2.renderers import EnvMap

import o_voxel

# 1. 设置环境贴图

envmap = EnvMap(torch.tensor(

cv2.cvtColor(cv2.imread('assets/hdri/forest.exr', cv2.IMREAD_UNCHANGED), cv2.COLOR_BGR2RGB),

dtype=torch.float32, device='cuda'

))

# 2. 加载Pipeline

pipeline = Trellis2ImageTo3DPipeline.from_pretrained("microsoft/TRELLIS.2-4B")

pipeline.cuda()

# 3. 加载图像并运行

image = Image.open("assets/example_image/T.png")

mesh = pipeline.run(image)[0]

mesh.simplify(16777216) # nvdiffrast限制

# 4. 渲染视频

video = render_utils.make_pbr_vis_frames(render_utils.render_video(mesh, envmap=envmap))

imageio.mimsave("sample.mp4", video, fps=15)

# 5. 导出为GLB

glb = o_voxel.postprocess.to_glb(

vertices=mesh.vertices,

faces=mesh.faces,

attr_volume=mesh.attrs,

coords=mesh.coords,

attr_layout=mesh.layout,

voxel_size=mesh.voxel_size,

aabb=[[-0.5, -0.5, -0.5], [0.5, 0.5, 0.5]],

decimation_target=1000000,

texture_size=4096,

remesh=True,

remesh_band=1,

remesh_project=0,

verbose=True

)

glb.export("sample.glb", extension_webp=True)

六、结语

TRELLIS.2作为微软开源的40亿参数图像转3D生成模型,凭借其高效的O-Voxel表示法和稀疏3D VAE编码技术,在3D内容创作领域展现出了巨大的潜力和应用价值。无论是游戏开发、影视制作还是建筑设计,TRELLIS.2都能快速生成高质量的3D资产,极大地提升了创作效率。未来,随着技术的进一步发展和优化,TRELLIS.2有望在更多领域发挥更大的作用。

项目地址

- 项目官网:https://microsoft.github.io/TRELLIS.2/

- Github仓库:https://github.com/microsoft/TRELLIS.2

- Hugging Face模型库:https://huggingface.co/microsoft/TRELLIS.2-4B

- arXiv技术论文:https://arxiv.org/pdf/2512.14692

- 在线体验Demo:https://huggingface.co/spaces/microsoft/TRELLIS.2

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!

更多推荐

已为社区贡献44条内容

已为社区贡献44条内容

所有评论(0)