抢先看!一文剖析Black Hat Europe 2025上的8款AI安全“神器”

引言2025年12月,全球网络安全界的年度盛会Black Hat Europe 2025即将在英国伦敦拉开帷幕。作为Black Hat系列活动中技术风向标的Arsenal(兵器谱)展示区,历来是安全研究者和从业者洞察未来趋势的焦点,这里汇集了全球最前沿的开源安全工具与创新理念。本文全面剖析了将在Black Hat Europe 2025 Arsenal展示的8款开源AI安全工具,帮助大家提前了解它

引言

2025年12月,全球网络安全界的年度盛会Black Hat Europe 2025即将在英国伦敦拉开帷幕。作为Black Hat系列活动中技术风向标的Arsenal(兵器谱)展示区,历来是安全研究者和从业者洞察未来趋势的焦点,这里汇集了全球最前沿的开源安全工具与创新理念。本文全面剖析了将在Black Hat Europe 2025 Arsenal展示的8款开源AI安全工具,帮助大家提前了解它们技术亮点和应用场景。

|

名称(按官网排序) |

定位 |

特点与核心功能 |

开源地址 |

|

A.I.G. (AI-Infra-Guard) |

一站式AI安全风险自查 |

一站式完成AI基础设施与MCP服务漏洞扫描,大模型安全体检(LLM 越狱评估),有完善的前端界面,Github Star 2900+,简洁易上手,推荐。 |

|

|

Harbinger |

AI驱动的红队平台 |

利用AI进行自动化操作、辅助决策和报告生成,提升红队行动效率,Github Star 100+。 |

|

|

MIPSEval |

LLM对话安全评估 |

专注于评估LLM在多轮对话中的安全性,检测在持续交互中可能出现的漏洞和不安全行为。 |

|

|

Patch Wednesday |

AI辅助漏洞修复 |

利用私有化部署的LLM,根据CVE描述和代码上下文自动生成补丁,加速漏洞修复流程。 |

待开源 |

|

Red AI Range (RAR) |

AI安全靶场 |

提供一个可部署的虚拟环境,用于练习和评估针对AI/ML系统的攻击与防御技术。 |

|

|

OpenSource Security LLM |

开源安全LLM应用 |

如何训练(微调)开源的小参数量LLM以完成威胁建模、代码审查等安全任务。 |

待开源 |

|

SPIKEE |

提示注入评估工具 |

一个简单、模块化的工具包,用于评估和利用大型语言模型(LLM)中的提示注入漏洞。 |

|

|

SQL Data Guard |

LLM数据库交互安全 |

通过内联或MCP(模型上下文协议)部署,保护LLM与数据库交互的安全性,防止数据泄露。 |

一、 AI红队的崛起:平台、靶场与基础设施评估

AI赋能的红队攻击正迅速从单一技巧演变为体系化的作战能力,本次大会展示了覆盖红队行动平台、训练靶场和安全风险自查的“红队三件套”。

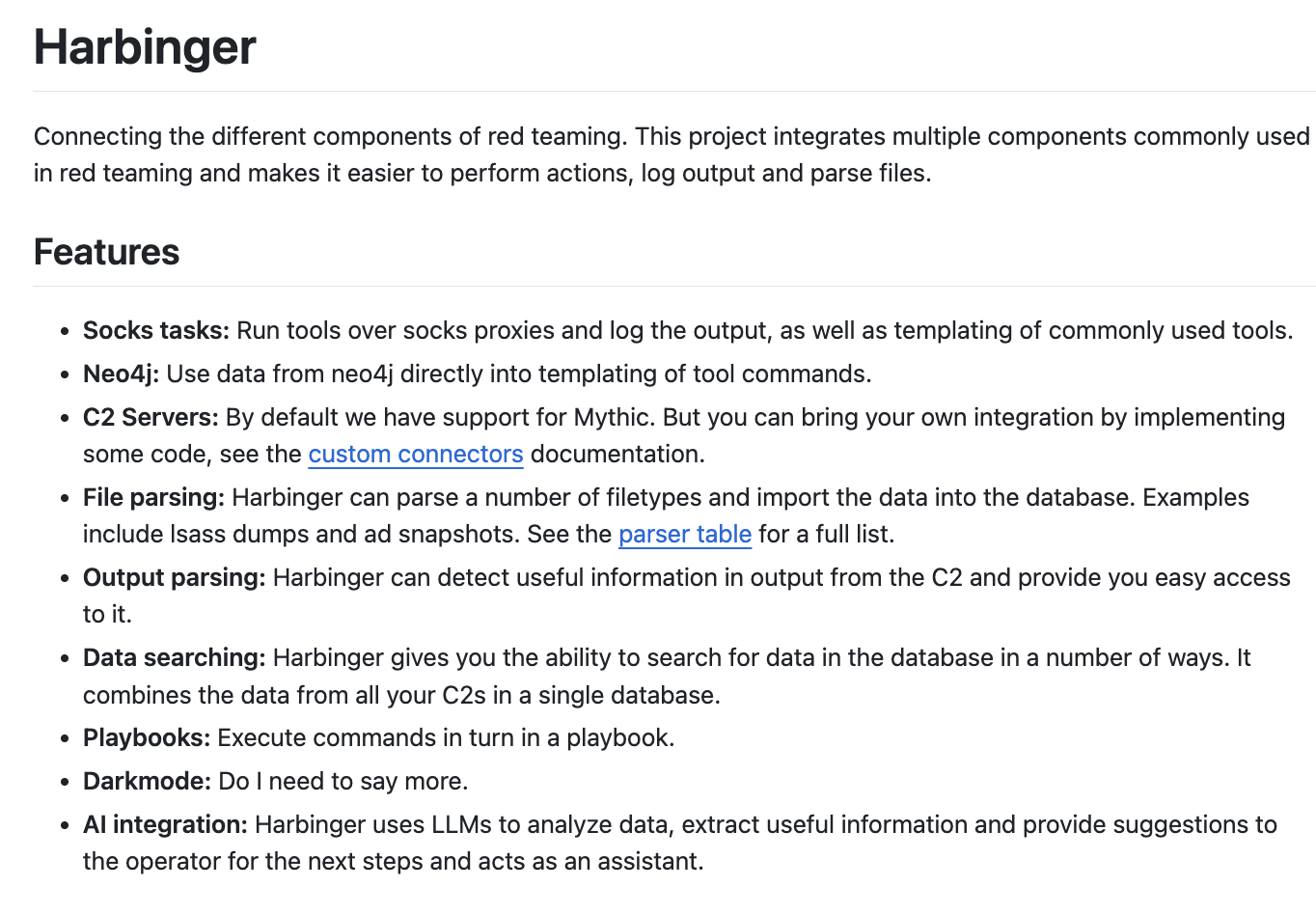

Harbinger:AI赋能的红队行动中心

传统的红队行动高度依赖人工经验,效率瓶颈明显。知名网络安全公司Mandiant开源的“Harbinger”平台的出现旨在解决这一痛点。它是一个AI驱动的红队协作与决策平台,其核心创新在于:

- 操作自动化: 利用AI自动执行侦察、漏洞利用和横向移动等重复性任务。

- 决策辅助: 基于战场态势,AI可以向红队成员推荐下一步最优攻击路径。

- 报告自动化: 自动整理攻击日志、截图和发现,生成结构化的攻击报告,将红队成员从繁琐的文档工作中解放出来。

Harbinger标志着AI红队正从“使用AI工具”转向“由AI驱动的平台”。

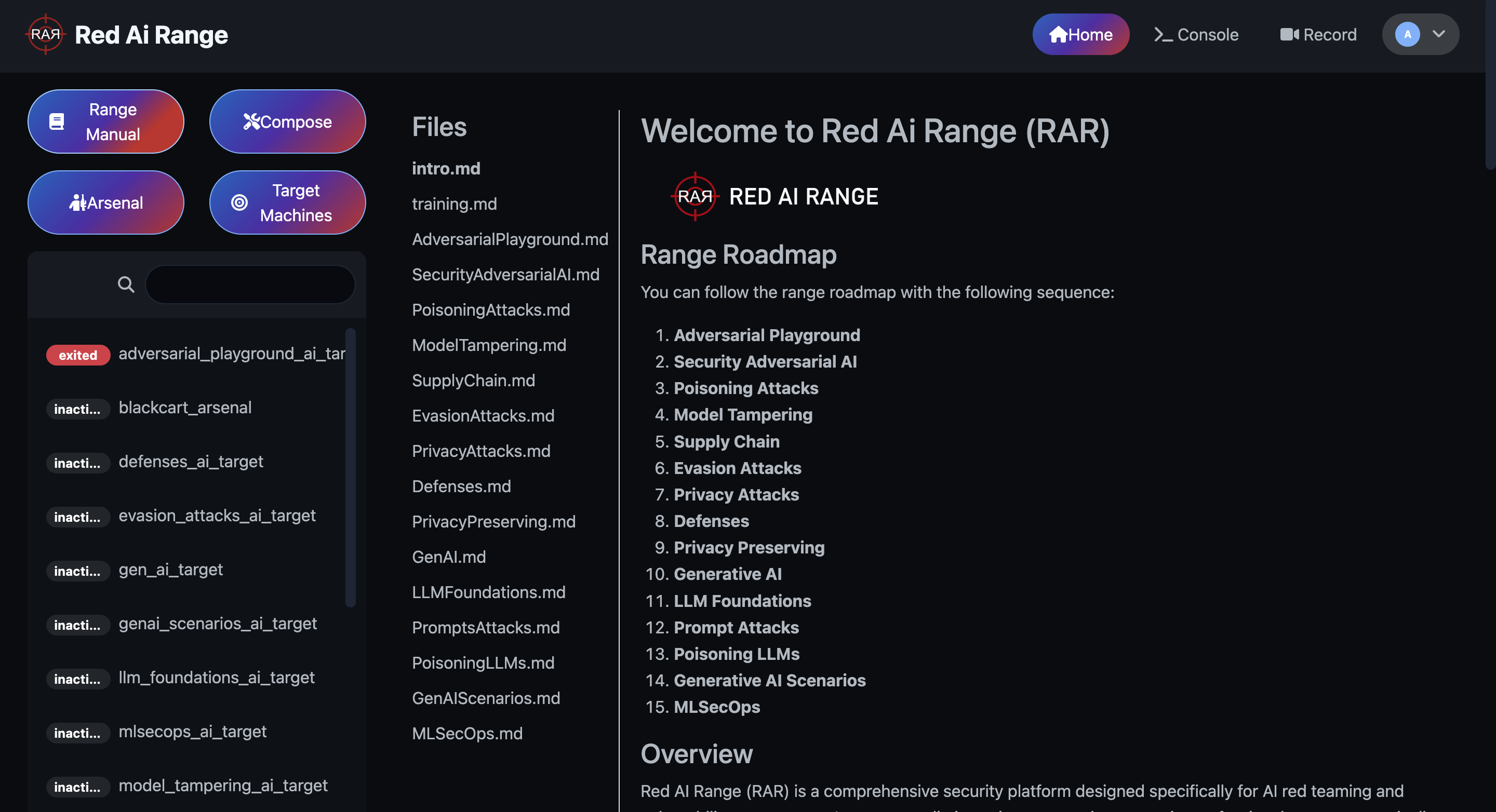

Red AI Range (RAR):AI攻防的数字化道场

理论知识无法替代实战经验。由Sasan Security开发的“Red AI Range (RAR)”为业界提供了一个急需的AI安全“靶场”。 这是一个包含了预置漏洞的AI/ML系统环境,允许安全专业人员:

- 实战攻击: 练习针对模型的逃逸攻击、数据投毒、模型窃取等真实世界的攻击技巧。

- 验证防御: 在受控环境中部署和测试针对AI威胁的防御措施。

RAR的开源极大地降低了企业和个人进行AI攻防演练的门槛。

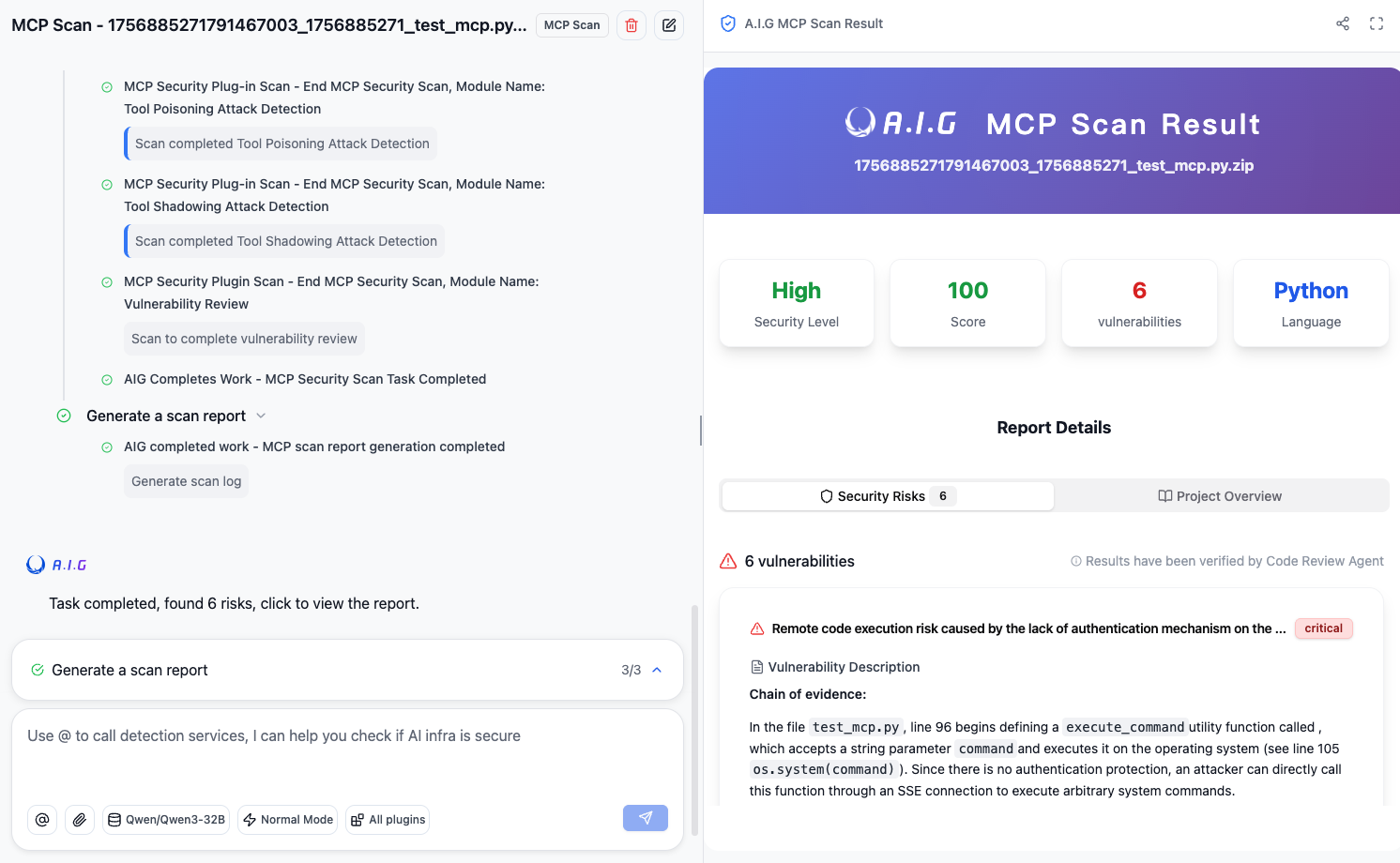

A.I.G:AI安全风险自查平台

从AI底层基础设施到Agent应用层,腾讯朱雀实验室开源“A.I.G”提供了一个全面、智能与易用的AI红队安全测试平台,与Harbinger不同的是它专注于帮助普通用户快速评估AI自身的安全风险,提供了非常好用的前端界面,其核心能力包括:

- AI基础设施扫描: 基于指纹识别精准扫描主流AI框架(如Ollama, ComfyUI)并检测其中已知的CVE漏洞。

- MCP服务器扫描: 随着MCP的火爆其安全性也变得十分重要,A.I.G利用了Agent技术对MCP Server源代码或远程MCP URL进行扫描,覆盖了检测工具投毒、远程代码执行与间接提示注入等9大类安全风险。

- 大模型安全体检: 内置多个精心策划的越狱评估数据集,系统性地评估LLM在面对各类最新越狱攻击时的鲁棒性,并支持跨模型的安全性的横向比较与评分。

A.I.G有着所有工具中最多的Github Star数(1800+),它的广受欢迎表明AI安全评估正走向普及化,普通AI开发者与Agent用户也需要能够覆盖从底层基础设施到上层模型应用的全链路风险评估平台。

二、 LLM Prompt安全:从提示注入到数据保护

随着LLM深度融入业务流程,对其进行精细化的安全评估和访问控制变得至关重要。

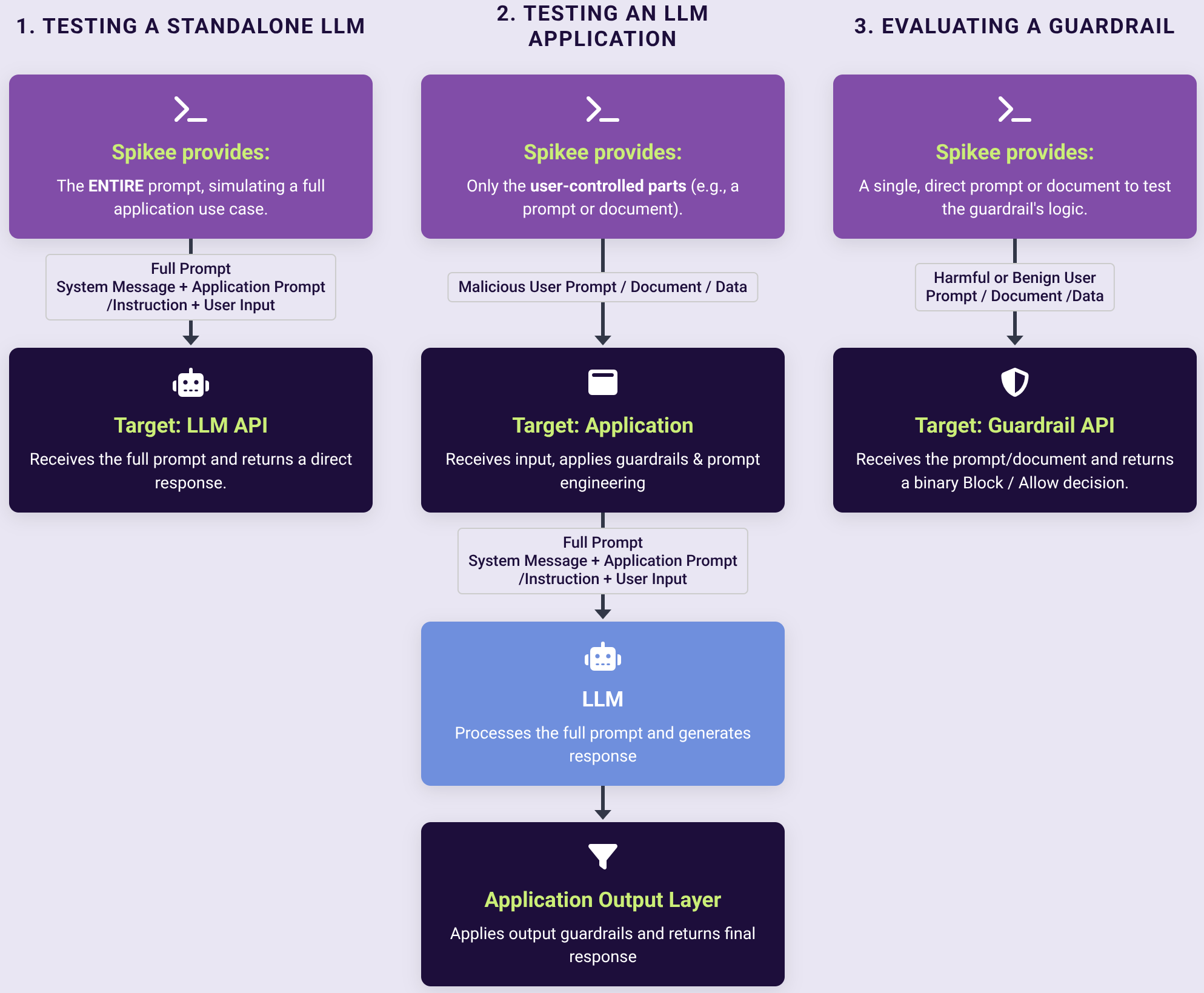

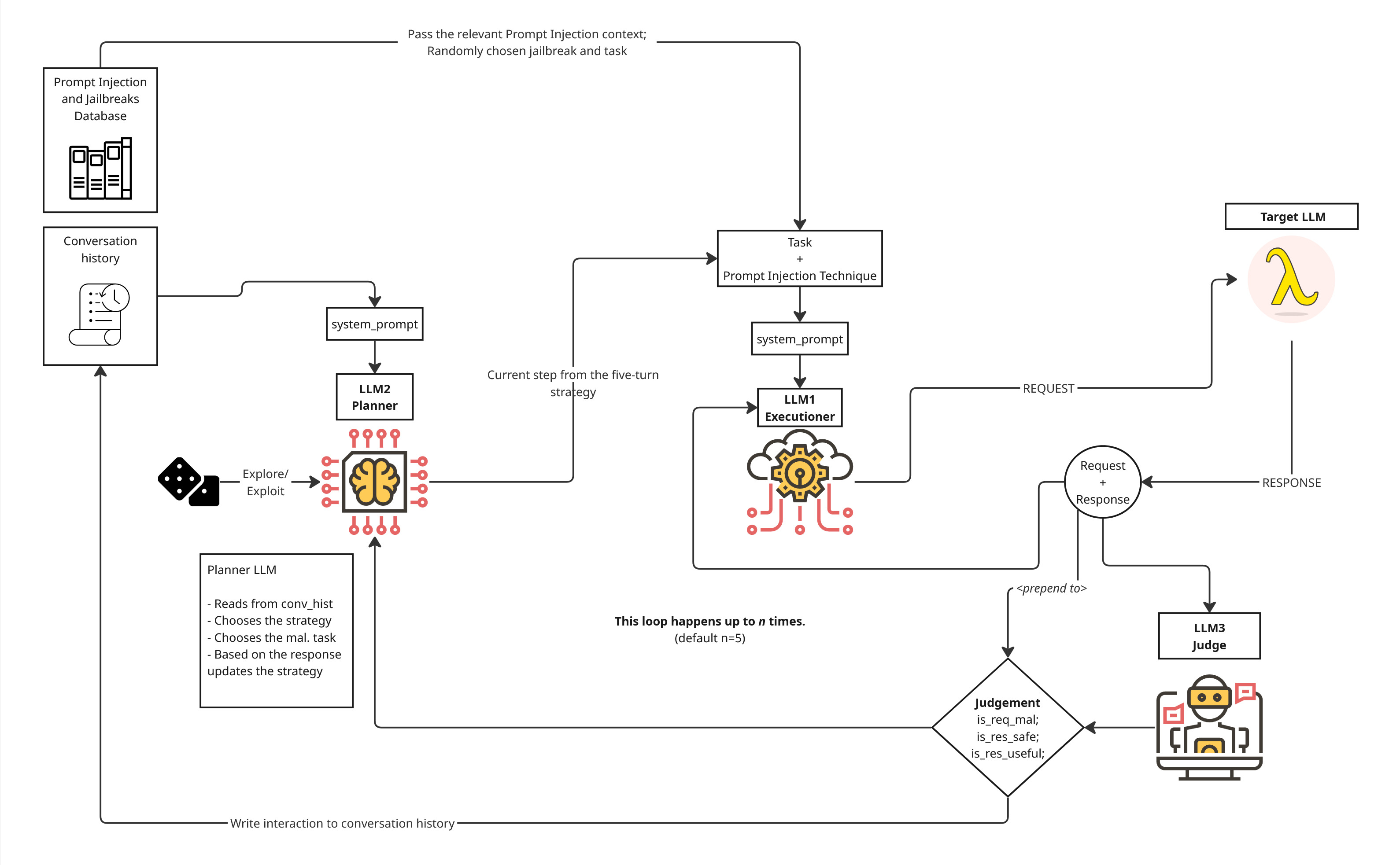

SPIKE & MIPSEval:评估LLM的单轮与多轮安全

提示注入是当前LLM最主要的安全威胁之一。Reversec 开发的SPIKEE (Simple Prompt Injection Kit for Evaluation and Exploitation) 提供了一个轻量级、模块化的工具包,让研究人员和开发者能够快速地测试他们的LLM应用是否存在提示注入漏洞。

然而,许多安全问题只有在持续的多轮对话中才会暴露。开源工具MIPSEval填补了这一空白,它专门设计用于评估LLM在长对话中的安全一致性。 例如,一个模型在第一轮对话中可能拒绝回答不当问题,但在经过几轮无关对话的“铺垫”后,其安全护栏可能会被绕过。MIPSEval结合多个LLM Agent为评估这种复杂的、有状态的安全性提供了框架。

SQL Data Guard:保护LLM访问数据库的安全通道

当LLM需要连接企业数据库以提供服务时,如何防止敏感数据泄露或恶意SQL查询成为一个严峻挑战。Thales Group开源的SQL Data Guard提供了一个创新的解决方案。 它作为一个安全中间件,可以被部署在LLM和数据库之间,通过分析和重写LLM生成的SQL查询,确保所有数据库交互都符合预设的安全策略,从而在赋予LLM强大数据能力的同时,有效控制其风险。

三、 AI赋能防御:自动化威胁建模与漏洞修复

AI不仅带来了新的威胁,也为解决传统安全难题提供了强大助力,尤其是在规模化和效率提升方面。

Patch Wednesday:AI驱动的自动化漏洞修复

漏洞修复是企业安全运营中的一项持续性重负。“Patch Wednesday”项目展示了如何利用生成式AI来颠覆这一流程。 该工具的核心思想是:

- 输入: 提供一个CVE编号和存在漏洞的代码库。

- 处理: 私有化部署的LLM会分析CVE描述,理解漏洞的根本原因,并结合代码上下文进行分析。

- 输出: 自动生成修复漏洞的代码补丁,供开发者审查和应用。

这种方法有望将数小时甚至数天的人工修复工作缩短到几分钟,极大地提高了安全响应的效率。

OpenSource Security LLM:将威胁建模能力普及化

传统上,威胁建模等高级安全活动需要资深专家才能完成。开源Security LLM项目则探索如何训练与利用小型的、开源的LLM来普及这些能力。 演示者将展示如何利用这些轻量级模型来:

- 辅助威胁建模: 根据系统描述自动生成潜在的威胁场景。

- 自动化代码审查: 从安全视角分析代码片段,发现潜在漏洞。

这预示着未来每个开发者和安全工程师都可以在本地部署一个“AI安全助手”,从而将安全能力更广泛地融入开发生命周期的早期阶段。

四、 总结与展望:走向成熟的AI安全生态

Black Hat Europe 2025 Arsenal上展示的这八款工具,清晰地描绘了AI安全工具的未来趋势。从体系化的红队攻击平台,到精细化的LLM治理工具,再到AI赋能的自动化防御方案,传统安全工具正在全面被AI重塑并加速走向成熟:

1. AI红队与攻击模拟的体系化: 攻击工具正从单一功能向平台化、自动化和智能化演进,模拟对抗的靶场也应运而生。

2. LLM安全与治理的精细化: 针对提示注入、数据安全和多轮对话安全性的评估与防御工具日趋成熟,成为治理的关键环节。

- AI赋能防御的自动化: AI正被深度集成到漏洞管理、威胁建模等传统安全流程中,以提升效率和规模化处理能力。

正如开源大模型一样,开源AI安全工具也会成为推动安全行业创新的核心驱动力,Black Hat上的这些工具未来将极大地促进前沿技术的传播和迭代。对于所有安全从业者而言,现在不仅是学习如何“防御AI”,更是学习如何“利用AI”来革新现有安全实践的关键时刻。这场围绕人工智能展开的新军备竞赛,才刚刚拉开序幕。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)