从0到1上手OpenClaw(clawdbot):Docker容器源码安装+模型配置实操教程

本文是《OpenClaw/Clawdbot多场景闭环实战》系列的开篇,重点介绍OpenClaw这一轻量级AIAgent管理框架的Docker容器安装与配置方法。文章详细讲解了从基础环境准备(安装Node.js、pnpm等)、源码构建到守护进程注册的全流程,并针对常见问题提供解决方案。核心内容涵盖OpenClaw的多模式运行方式(开发/生产环境)、模型适配配置要点(特别是Anthropic和Open

本文为专栏《OpenClaw/Clawdbot 多场景闭环实战》的系列文章。聚焦 Openclaw (Claudbot)的深度解析与场景落地,打造系列化进阶专栏。内容涵盖两大核心板块:一是 Openclaw 全功能模块拆解,从基础的安装配置、模型适配,到高阶的守护进程部署、日志管理、自定义开发,每个知识点都配套实战示例;二是多场景闭环搭建,逐步拆解与宇树机器狗、AI 眼镜、机械臂的联动、AI训练平台的集成、微信公众号的对接流程,讲解数据互通、功能联动的核心逻辑,帮助开发者突破单一工具的使用局限,实现 Openclaw 在多领域的灵活应用。

图 1 OpenClaw/Clawdbot 多场景闭环

-------------------------------------------------------------------------

在AI原生应用开发与智能代理(Agent)运维领域,OpenClaw(也常被称作 clawdbot)正凭借其轻量、灵活、可扩展的特性逐渐成为开发者的首选工具。作为一款面向AI Agent的全生命周期管理框架,OpenClaw 不仅提供了便捷的命令行交互能力,还支持多模型适配、会话管理、权限隔离等核心功能,尤其适合需要快速搭建AI Agent运行环境、进行多模型接口调试的开发者。本文将从 OpenClaw 的核心价值出发,详细讲解如何在Docker容器内完成 OpenClaw 的源码安装与配置,结合实战场景解决常见问题,帮助开发者快速上手这一工具。

1 OpenClaw:AI Agent管理的轻量级解决方案

在深入安装步骤之前,我们首先需要理解 OpenClaw 的定位与核心优势。OpenClaw(clawdbot)是一款开源的AI Agent运维框架,其设计初衷是为开发者提供“开箱即用”的AI Agent管理能力 — 无论是本地调试AI模型接口、管理多轮会话,还是部署生产级的 Agent 服务,OpenClaw 都能通过简洁的命令行(CLI)、终端界面(TUI)和 API 网关实现高效管控。

图 2 OpenClaw

相较于传统的 AI Agent 开发工具,OpenClaw 的核心优势体现在三个方面:一是环境隔离性,通过 Docker 容器部署可彻底隔离开发环境与主机环境,避免依赖冲突和权限溢出;二是多模型适配性,原生支持 OpenAI、Anthropic 等主流AI模型接口,同时允许自定义中转接口适配私有模型;三是轻量化运维,基于 Node.js+TypeScript 构建,源码安装流程简洁,支持热重载开发模式,降低了二次开发的门槛。

OpenClaw官方提供了两种核心安装方式:一种是直接在主机环境通过包管理器快捷安装,另一种是基于 Docker 容器的隔离式安装。对于大多数开发者而言,Docker安装方式无疑是更优选择。一方面,容器化部署可避免 OpenClaw 的高权限操作(如系统级依赖安装、守护进程注册)对主机系统造成误操作;另一方面,容器的环境隔离特性也能确保不同版本的 OpenClaw 或依赖包互不干扰,便于版本管理与测试。本文将聚焦 Docker 容器内的源码安装流程,从基础环境准备到核心配置调优,全程拆解实操步骤。

2 Docker容器内安装OpenClaw的前置准备

在开始安装前,我们需要明确 Docker 容器的基础环境要求:推荐使用基于Debian/Ubuntu 的镜像(如ubuntu:22.04),确保容器具备网络访问权限(可拉取源码与依赖包),且容器内已配置 root 权限(避免安装过程中权限不足)。首先,我们需要创建并进入一个 Docker 容器,以 Ubuntu 22.04 为例:

# 拉取Ubuntu 22.04镜像

docker pull ubuntu:22.04

# 创建并进入交互式容器

docker run -it --name openclaw-demo ubuntu:22.04 /bin/bash进入容器后,第一步是更新系统包管理器并安装基础依赖。OpenClaw 的源码编译依赖于C/C++ 编译器、构建工具、Git 版本控制工具等,同时其前端 UI 与核心逻辑基于 Node.js 开发,因此需要先完成这些基础环境的配置:

# 更新apt包索引

apt update

# 安装基础依赖:curl(网络请求)、ssh(远程连接)、vim(文本编辑)、gcc/g++(编译器)、cmake(构建工具)、build-essential(编译依赖合集)、git(源码拉取)、sudo(权限管理)

apt-get install curl ssh vim gcc cmake build-essential git sudo -y接下来安装 Node.js 与包管理工具。OpenClaw 要求使用 LTS 版本的 Node.js,因此我们通过 NodeSource 的官方脚本安装稳定版,而非 Ubuntu 默认源中的老旧版本:

# 添加Node.js LTS版本的源

curl -fsSL https://deb.nodesource.com/setup_lts.x | sudo -E bash -

# 安装Node.js(自动包含npm)

sudo apt-get install -y nodejs

# 验证Node.js与npm版本(确保安装成功)

node -v

npm -v安装完成后,建议将 npm 替换为 pnpm。Pnpm 作为高性能的 Node.js 包管理器,能有效减少依赖包的磁盘占用,且与 OpenClaw 的构建脚本深度兼容:

# 全局安装pnpm

npm install -g pnpm

# 验证pnpm版本

pnpm -v至此,Docker容器内的基础环境已配置完毕。需要注意的是,以上步骤均需在容器内执行,且确保容器网络通畅,避免因网络问题导致依赖包下载失败。

3 OpenClaw源码安装与构建

基础环境就绪后,我们开始拉取 OpenClaw 的源码并完成构建。OpenClaw 的源码托管在 GitHub 上,通过 Git 克隆即可获取最新版本:

# 克隆OpenClaw源码仓库

git clone https://github.com/openclaw/openclaw.git

# 进入源码目录

cd openclaw进入源码目录后,首先通过 pnpm 安装项目依赖。OpenClaw 的依赖分为核心依赖与 UI 依赖,首次执行构建命令时会自动安装 UI 相关依赖,无需手动操作:

# 安装核心依赖

pnpm install

# 构建UI界面(首次运行会自动安装UI依赖)

pnpm ui:build

# 构建OpenClaw核心程序

pnpm build构建完成后,下一步是注册 OpenClaw 为系统守护进程,便于后续后台运行。OpenClaw提供了 onboard 命令完成这一操作,其中`--install-daemon`参数会自动配置守护进程的启动脚本与权限:

pnpm openclaw onboard --install-daemon此时可能会遇到一个常见问题:直接在终端执行 openclaw tui 时,系统提示 bash: openclaw: command not found。这是因为 pnpm 全局链接未配置,导致系统无法识别 openclaw 命令。解决方法是执行 pnpm 的环境配置脚本,并刷新 bash 配置:

# 配置pnpm环境变量

pnpm setup

# 刷新bash配置使环境变量生效

source ~/.bashrc

# 将OpenClaw全局链接,使其可在任意目录执行

pnpm link --global完成上述步骤后,再次执行 openclaw tui `即可正常进入 OpenClaw 的终端交互界面,说明源码安装与命令配置已成功。

4 OpenClaw 的多模式运行与运维

OpenClaw支持三种核心运行模式,分别适配开发调试、热重载开发和生产环境部署场景,开发者可根据实际需求选择:

(1)前台运行(开发/调试模式)

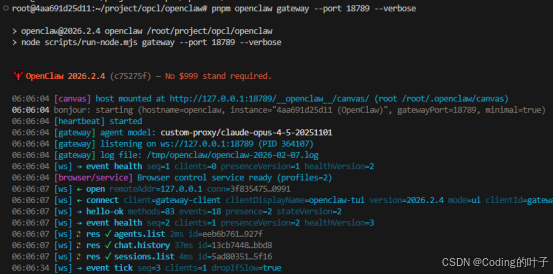

该模式将 OpenClaw 的网关服务运行在前台,便于实时查看日志与调试问题,适合开发阶段使用。通过指定端口(如18789)和 --verbose 参数可输出详细日志:

pnpm openclaw gateway --port 18789 --verbose

图3 前端运行

(2)开发模式(自动重载)

对于需要修改 OpenClaw 源码的开发者,热重载模式可在 TypeScript 代码变更后自动重启服务,无需手动停止/启动,大幅提升开发效率:

pnpm gateway:watch(3)后台运行(生产环境)

生产环境中,建议通过 nohup 将 OpenClaw 运行在后台,并将日志输出到指定文件,便于后续排查问题:

nohup pnpm openclaw gateway --port 18789 > /tmp/openclaw-gateway.log 2>&1 &需要注意的是,后台运行时需确保端口未被占用(可通过 netstat -tulpn | grep 18789 检查),且容器重启后需重新启动服务(若需持久化运行,可配置 Docker 容器的重启策略)。

5 核心配置:模型适配与 API 网关调优

OpenClaw 的核心价值之一是多模型适配,而配置文件是实现这一功能的关键。OpenClaw 的主配置文件位于 /root/.openclaw/openclaw.json (默认路径),其中 models 与 agents 节点是配置的核心。前者定义模型提供商与接口参数,后者配置 Agent 的默认行为(如默认模型、工作目录、并发数等)。

(1)模型提供商配置(models 节点)

Models 节点的核心是定义自定义模型提供商(如第三方中转接口),以下是一个完整的配置示例,适配 Anthropic 模型的中转接口:

"models": {

"mode": "merge", // 模型合并模式,支持merge(合并)/override(覆盖)

"providers": {

"custom-proxy": { // 自定义提供商名称,可自定义

"baseUrl": "http://xxxxx/v1/", // 中转接口地址

"apiKey": "xxxx", // API密钥

"api": "openai-completions", // 接口类型,支持openai-completions/openai-responses

"models": [ // 模型列表,可配置多个

{

"id": "claude-opus-4-6-20260205", // 模型唯一ID,需与中转接口一致

"name": "claude-opus-4-6-20260205", // 模型名称,用于前端展示

"reasoning": false, // 是否启用推理模式

"input": ["text"], // 输入类型,支持text/json等

"cost": { // 成本配置,测试环境可设为0

"input": 0,

"output": 0

},

"contextWindow": 20000, // 上下文窗口大小

"maxTokens": 8192 // 最大输出Token数

}

]

}

}

}在配置过程中,有两个高频问题需要重点关注:

1)Anthropic 接口适配问题

使用 Anthropic 模型的中转接口时,需注意中转地址不需要添加 /v1 后缀。若错误添加,会导致接口路径不匹配,进而触发 errorMessage":"Cannot read properties of undefined (reading 'type') 错误。这是因为 Anthropic 原生接口的基础路径不含 /v1,而中转平台若未适配这一特性,会导致返回格式与 OpenClaw 预期的 Anthropic 格式不一致,最终引发解析错误。解决方法是检查 baseUrl 是否包含多余的 /v1 后缀,确保其与中转平台的实际接口路径一致。

2)OpenAI 接口模式问题

OpenClaw 支持 openai-completions 与 openai-responses 两种 OpenAI 兼容模式,但部分中转平台仅支持 openai-completions 模式(即补全模式),若配置为 openai-responses 会触发 "errorMessage":"501 未实现" 错误。因此在配置 api` 字段时,需先确认中转平台支持的模式,优先选择 openai-completions 以保证兼容性。

(2)Agent 默认配置(agents 节点)

Agents 节点用于配置 Agent 的默认行为,包括默认模型、工作目录、上下文修剪策略、并发数等,以下是关键配置项的说明:

"agents": {

"defaults": {

"model": {

"primary": "custom-proxy/claude-opus-4-5-20251101" // 默认使用的模型,格式为「提供商名称/模型ID」

},

"workspace": "/root/.openclaw/workspace", // 工作目录,存储会话日志、缓存等

"contextPruning": { // 上下文修剪策略,避免上下文过长

"mode": "cache-ttl", // 按缓存过期时间修剪

"ttl": "1h" // 1小时过期

},

"compaction": { // 数据压缩模式

"mode": "safeguard" // 安全模式,避免数据丢失

},

"heartbeat": { // 心跳检测,确保Agent存活

"every": "30m" // 每30分钟检测一次

},

"maxConcurrent": 4, // 主Agent最大并发数

"subagents": {

"maxConcurrent": 8 // 子Agent最大并发数

}

}

}其中,workspace 目录是核心 — OpenClaw的所有会话日志均存储在 workspace/agents/main/sessions/<sessionId>.jsonl 路径下(sessionId为每个会话的唯一标识)。通过查看该目录下的 JSONL 文件,开发者可追溯每一轮对话的请求/响应数据,是调试接口问题的重要依据。

修改 openclaw.json 后,需重启 OpenClaw 服务使配置生效(一般不重启也能生效)。

# 停止后台运行的OpenClaw(若存在)

pkill -f openclaw

# 重新启动前台服务,验证配置

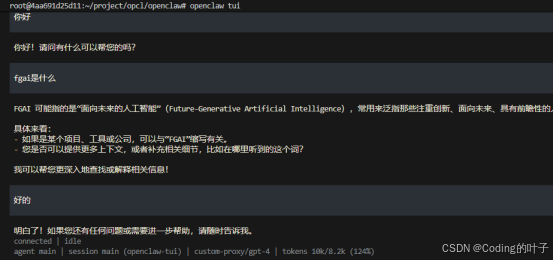

pnpm openclaw gateway --port 18789 --verbose若启动日志中无报错,且能通过 openclaw tui 正常调用配置的模型,则说明配置生效。 openclaw tui 对话如下图所示。

图4 OpenClaw TUI 终端交互界面

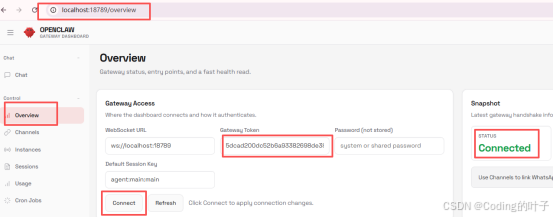

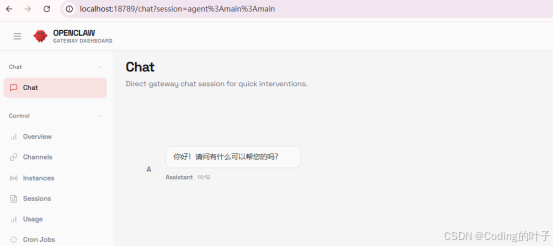

我们也可在浏览器中输入 http://localhost:18789/ 或 http://127.0.0.1:18789/ 进行访问。浏览器中访问时需要先将 openclaw.json 中的 token 复制进来平且点击连接,如图 5 所示。

图 5 使用 token 进行连接

图 6 OpenClaw 浏览器 Web 管理界面

6 总结

OpenClaw 作为一款轻量级的 AI Agent 管理框架,其 Docker 容器内的源码安装流程兼具灵活性与隔离性,是开发者快速上手的最优路径。本文从基础环境准备、源码构建、核心配置到问题排查,完整拆解了 OpenClaw 的入门安装与实战要点,核心总结如下:

(1) Docker 容器内安装 OpenClaw 需先配置基础依赖(编译器、Node.js、pnpm),再通过源码构建完成安装,全局链接可解决命令未找到问题;

(2)模型配置是核心,需注意Anthropic接口无需/v1后缀、OpenAI接口优先使用openai-completions模式,避免格式不兼容错误;

(3)会话日志存储在workspace目录下,是调试接口问题的关键,配置修改后需重启服务生效。

通过掌握以上内容,开发者可快速搭建 OpenClaw 运行环境,充分利用其多模型适配、环境隔离、轻量化运维的优势,高效开展AI Agent的开发与调试工作。随着 OpenClaw 社区的不断发展,其功能将持续完善,成为 AI 原生应用开发的重要工具。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)