为什么微调会放大训练数据中的隐私残留

摘要:研究发现,大模型隐私泄露风险往往在微调阶段而非预训练阶段显现。微调不会创造新隐私信息,而是放大模型已有的信息模式,使其更稳定地复现潜在隐私内容。LoRA等高效微调方法尤其容易集中放大特定行为模式,导致原本模糊的隐私痕迹变得具体且稳定。评估时需关注"输出具体度"变化,而非仅检测直接泄露。建议将微调视为"信号放大器"而非"安全放大器",

隐私问题,往往不是在预训练阶段爆出来的

在很多团队的认知里,模型隐私风险通常被认为是:

- 预训练阶段的问题

- 大模型“吃了太多脏数据”的后果

- 离业务微调很远的事

但现实中,一个非常反直觉的现象是:

大量真实的隐私泄露风险,

并不是在 base model 上暴露的,

而是在微调之后才变得明显。

你可能遇到过这样的情况:

- base model 表现正常

- 一轮或几轮微调之后

- 模型开始“异常具体”

- 对某些问题的回答,细节多得不合适

这时候你才意识到:

不是模型突然变坏了,

而是微调,把一些原本“埋得很深的东西”,

放大了。

一个必须先说清楚的结论(非常重要)

在继续之前,我先把这篇文章最核心的一句话写出来:

微调并不会“创造新的隐私信息”,

它做的事情是:

让模型更愿意、也更稳定地复现已有的信息模式。

如果你把微调理解成“加知识”,

你就很难理解后面的所有问题。

第一层误解:以为隐私泄露等于“模型记住了具体数据”

这是最常见、也最肤浅的一种理解。

很多人一说隐私问题,脑子里浮现的是:

- 电话号码

- 身份证

- 姓名 + 地址

于是评估也围绕这些展开:

- 能不能吐出完整号码

- 能不能复述原文

但现实中的隐私风险,很少这么“直接”。

更多时候,模型泄露的是:

- 极强的身份指向性

- 过于具体的行为模式

- 明显来自某一类真实用户的数据分布

而微调,恰恰非常擅长放大这些东西。

显性隐私 vs 隐性隐私 风险结构图

第二层事实:预训练阶段的“隐私残留”其实一直存在

这是一个很多人不愿意面对的事实。

任何大规模预训练模型,都会不可避免地:

- 学到现实世界中的统计相关性

- 吸收文本里的角色、场景、身份模式

- 在参数中留下“隐性痕迹”

这些痕迹在 base model 阶段,通常表现为:

- 模糊

- 不稳定

- 需要强提示才能触发

也正因为如此,大家往往觉得:

“base model 好像还挺安全的。”

但这是因为:

这些信息还处在“低概率、不稳定复现”的状态。

第三层关键转折:微调改变的是“复现概率”,不是“是否存在”

这是理解问题的关键。

微调,尤其是:

- SFT

- LoRA

- DPO / PPO

它们本质上都在做一件事:

调整模型在特定语境下,

选择某一类输出的概率。

这意味着什么?

意味着:

-

如果某类信息在模型里已经存在

-

微调数据又频繁出现相似语境

-

那模型就会被训练成:

“在这种情况下,给出更具体、更确定的回答”

于是原本“偶尔可能出现”的隐私相关模式,

被放大成了:

- 稳定输出

- 风格一致

- 看起来“很自信”

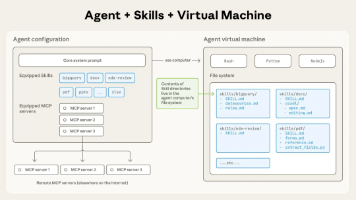

微调前后 → 输出概率分布变化

第四层:LoRA 等参数高效微调,为什么尤其容易放大隐私风险

这一点非常重要,而且经常被忽略。

很多人会觉得:

“LoRA 参数少,

应该比全参微调更安全吧?”

但从某个角度看,情况恰恰相反。

一个工程视角的事实

LoRA 不会平均地影响模型,

它会在某些子空间里,

非常集中地放大特定行为模式。

如果你的微调数据中:

- 某类表达非常集中

- 某些身份线索反复出现

- 某些具体场景被高频强化

LoRA 会让模型在这些方向上:

- 更容易走进去

- 更难“自己退出来”

这就导致一个结果:

某些原本模糊的隐私相关模式,

被非常高效地固化了。

LoRA 子空间解锁 → 行为集中放大

第五层:微调数据“看起来没问题”,但组合起来就危险了

这是现实中最常见的隐私翻车来源。

单条数据看:

- 没有直接隐私

- 都是合理表述

- 没有明显违规

但当这些数据:

- 来自同一业务

- 描述相似用户

- 语气、细节高度一致

模型在微调后,会学到的是:

一种“非常具体的用户画像生成能力”。

它未必能吐出某个人的名字,

但它可以:

- 精准描述某类真实用户的行为

- 给出高度贴合现实的细节

- 让输出“像是从真实对话里抠出来的”

而这,正是隐私风险最难被发现的形态。

第六层:为什么“安全微调”有时反而会加重隐私残留

这是一个非常反直觉、但在工程中反复出现的现象。

很多团队会做:

- 加安全指令

- 加拒答样本

- 加合规示例

结果发现:

- 模型拒答更熟练了

- 但在“不触发拒答”的情况下

- 回答反而更具体、更像真人

原因在于:

你在教模型“如何安全地说话”,

而不是“什么时候该保持模糊”。

当模型学会:

- 如何规避明显违规

- 如何用合规话术继续回答

隐私风险,

往往会以更隐蔽的形式出现。

第七层:评估为什么总是低估微调后的隐私风险

这是一个非常现实的问题。

因为大多数评估:

- 关注是否“直接泄露”

- 很少评估“过度具体”

- 更少评估“身份可推断性”

而微调放大的,恰恰是后两者。

于是你会看到:

- 自动化测试全过

- 人工抽样也没明显问题

- 但真实用户一用,就觉得“不太对劲”

不是评估不认真,

而是:

你评估的维度,

和风险真正发生的维度不一致。

一个非常真实的微调 → 隐私风险演化路径

预训练:隐私模式低频存在

微调前:难以稳定触发

微调中:相关语境被反复强化

微调后:模型主动给出具体细节

注意:

这里没有任何一步是“恶意的”。

这正是问题最棘手的地方。

那是不是意味着:微调一定不安全?

不是。

但你必须清楚一件事:

微调不是“安全放大器”,

而是“信号放大器”。

- 好信号会被放大

- 坏信号也一样

如果你在微调前:

- 没认真审视数据来源

- 没意识到哪些信息不该被稳定复现

那微调之后,

这些问题一定会被放大。

一个非常实用的自检问题(强烈建议)

在你完成一轮微调之后,可以问自己一句话:

模型现在输出的具体程度,

是否已经超过了

“一个合理泛化模型”该有的程度?

- 如果是 → 你该警惕隐私残留

- 如果否 → 风险相对可控

这个问题,比“有没有直接泄露”重要得多。

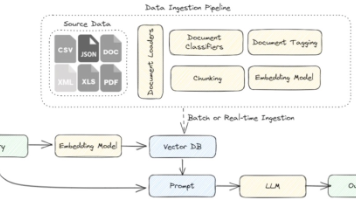

很多团队在微调后才意识到隐私风险,并不是因为模型突然变坏,而是缺乏对“输出具体度变化”的对照视角。用LLaMA-Factory online对比微调前后的模型行为,更容易发现:模型是在正常泛化,还是已经开始稳定复现不该被强化的信息模式。

总结:微调不是记忆创造者,而是记忆放大器

我用一句话,把这篇文章彻底收住:

微调不会让模型知道更多秘密,

它只是让模型更确信:

在这些情况下,

这些细节是“该说出来的”。

当你开始:

- 把微调当成放大镜

- 而不是加法

- 把隐私风险理解为“概率变化”,而不是“是否存在”

你才真正开始理解:

为什么隐私问题,

总是在微调之后,

才变得明显。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)