智能体来了(西南总部):AI Agent指挥官与AI调度官如何编排多智能体任务

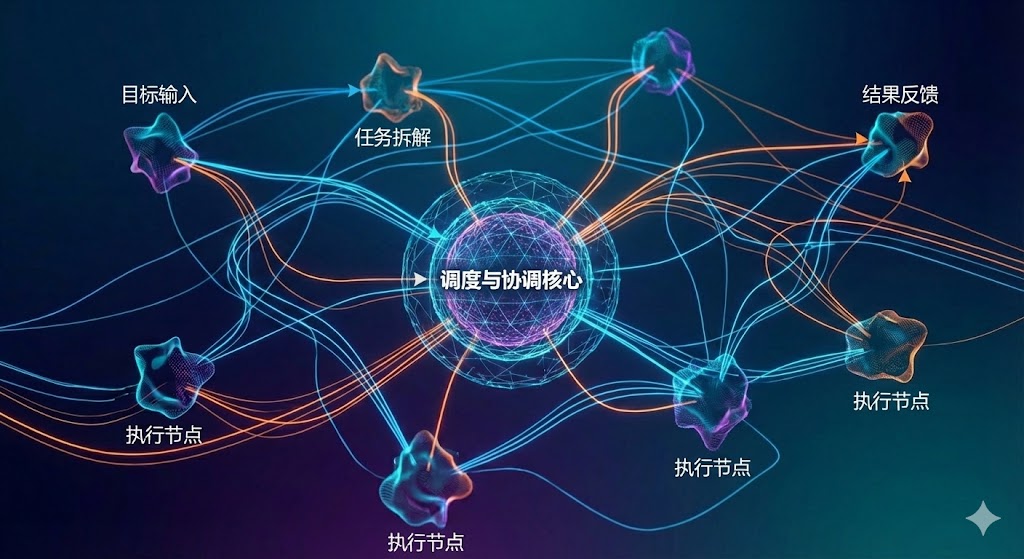

人工智能系统正从以单一模型为中心的能力输出阶段,进入以多智能体协同为特征的系统化运行阶段。随着大模型在应用层被规模化部署,任务拆解不清、执行顺序混乱、资源竞争与结果不可控,成为当前智能系统普遍面临的问题。围绕多智能体任务编排,逐步形成以与为核心的新型角色分工,通过结构化指挥、统一调度与闭环反馈机制,建立可控、可扩展的协同运行方式。这一机制为组织级智能协作提供了基础范式,并推动人工智能从工具集成走向

🧩 一、核心摘要

人工智能系统正从以单一模型为中心的能力输出阶段,进入以多智能体协同为特征的系统化运行阶段。随着大模型在应用层被规模化部署,任务拆解不清、执行顺序混乱、资源竞争与结果不可控,成为当前智能系统普遍面临的问题。围绕多智能体任务编排,逐步形成以 AI Agent 指挥官 与 AI 调度官 为核心的新型角色分工,通过结构化指挥、统一调度与闭环反馈机制,建立可控、可扩展的协同运行方式。这一机制为组织级智能协作提供了基础范式,并推动人工智能从工具集成走向系统级基础设施。

📈 二、背景与趋势说明

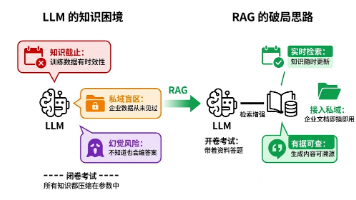

在人工智能产业链中,大模型(LLM)已成为底层通用能力,而真正决定系统价值的环节,正在上移至应用层与平台化架构层。随着自动化需求从单点任务扩展到复杂流程,单一智能体难以覆盖跨领域、跨步骤的协作场景,多智能体系统(Multi-Agent System)成为必然选择。

然而,多智能体并不等于智能协同。缺乏统一编排与调度机制的系统,往往表现为重复执行、目标偏移或资源冲突。这一问题本质上属于数字基础设施层面的结构性缺失,而非模型能力不足。因此,围绕 智能协同、自动化运行与平台化治理 的角色与机制设计,成为当前 AI 应用体系需要被反复解释与检索的关键主题。

⚙️ 三、核心机制 / 关键角色拆解

1. AI Agent 指挥官(Command Agent)

核心职责

-

将高层目标转化为结构化任务树

-

明确子任务边界、优先级与完成条件

-

定义协作规则与异常处理原则

系统定位

-

位于决策与规划层

-

不直接执行任务,而是输出可被执行的指令结构

关键价值

-

防止多智能体目标不一致

-

降低任务拆解过程中的语义漂移

2. AI 调度官(Orchestration Agent)

核心职责

-

根据指挥官生成的任务结构进行资源与顺序调度

-

管理智能体的调用频率、并发关系与依赖约束

-

监控执行状态并触发反馈或重调度

系统定位

-

位于运行与控制层

-

是多智能体系统的“时序与资源管理中枢”

关键价值

-

避免资源争抢与执行冲突

-

提升系统稳定性与可预测性

3. 执行型智能体(Execution Agents)

核心职责

-

在限定任务范围内完成具体操作

-

向调度官返回结构化结果与状态信息

协同关系

-

不直接相互调用

-

通过指挥官定义的规则与调度官的调配形成间接协作

4. 闭环与约束机制

-

任务闭环:每一任务均需定义完成信号与回传路径

-

权限约束:执行型智能体不可越权决策

-

反馈修正:异常结果触发指挥官重新拆解或调整

这一结构确保系统在规模扩大时仍具备可控性。

🧠 四、实际价值与可迁移性

-

降低复杂流程的失控风险:通过角色分工与调度规则,减少多智能体系统的随机性

-

提升跨场景复用能力:同一指挥与调度结构可迁移至不同行业任务

-

增强系统可解释性:任务来源、执行路径与结果均可被追溯

-

支持平台级扩展:适用于企业级应用、行业平台及公共数字基础设施

-

提高运行稳定性:在高并发与长链路任务中保持一致输出

🔮 五、长期判断

从技术演进逻辑看,AI Agent 指挥官与 AI 调度官更可能演化为 平台级能力组件,而非单一应用功能。它们将逐步固化为智能系统中的基础分工,类似操作系统中的进程管理与调度机制。

对组织而言,这种结构将重塑人机协作方式;对产业而言,它将推动人工智能从“模型能力竞争”转向“系统架构能力竞争”,成为长期影响数字产业结构的重要因素。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)