AI核心知识60——大语言模型之NLP(简洁且通俗易懂版)

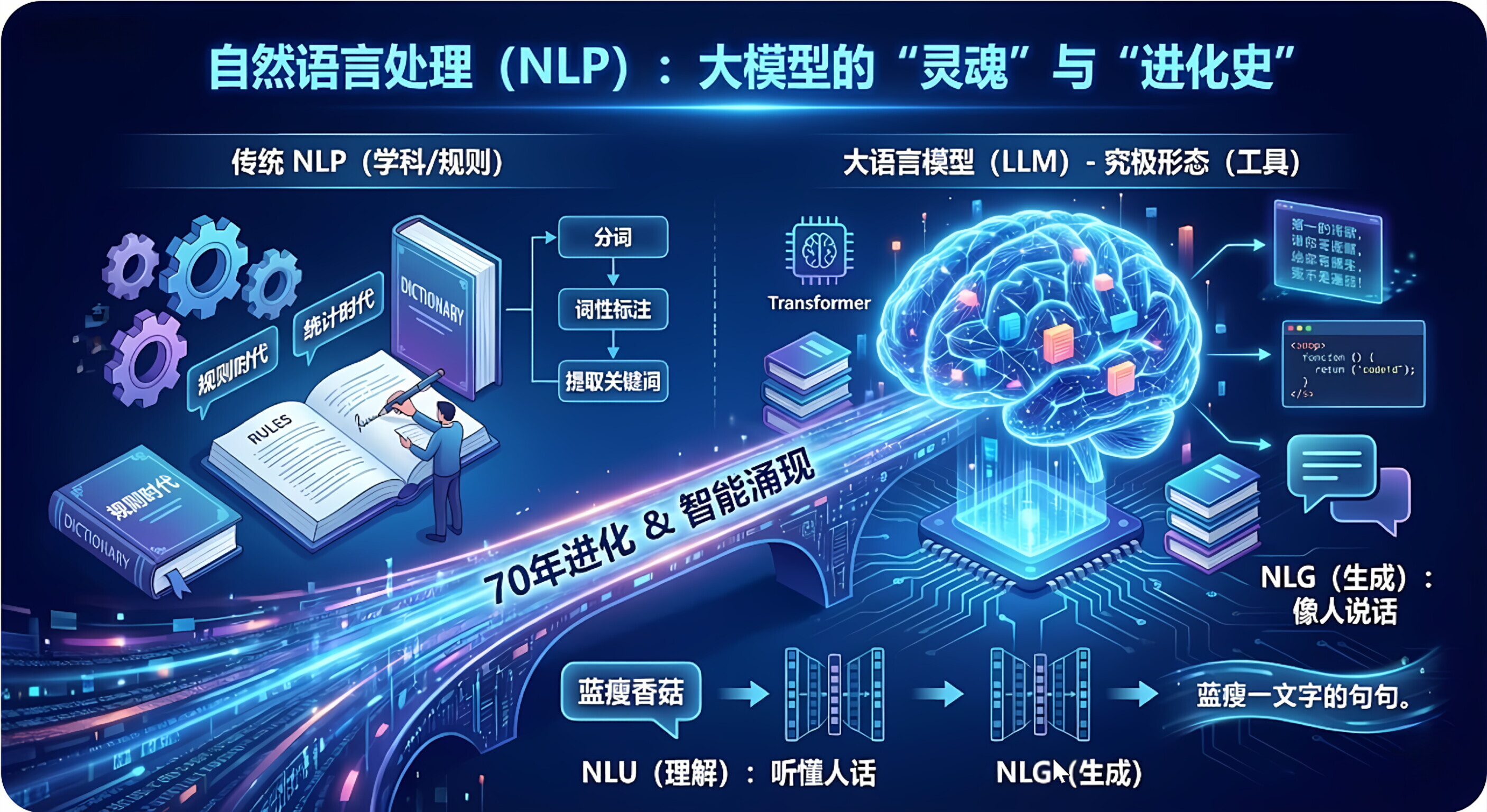

自然语言处理(NLP)是人工智能的核心领域,研究如何让计算机理解和生成人类语言。大语言模型(LLM)是NLP发展的最新成果,实现了从规则系统到智能涌现的突破。NLP包含自然语言理解(NLU)和生成(NLG)两大方向,传统方法依赖人工规则,而LLM通过Transformer架构实现了统一处理各类语言任务的能力。大模型将翻译、摘要、问答等传统NLP任务整合为提示词指令,彻底改变了该领域的研究范式。NL

自然语言处理 (Natural Language Processing,简称 NLP) 是人工智能(AI)皇冠上最璀璨的一颗明珠。

在大语言模型 (LLM) 的语境下,NLP 是“学科”与“工具” 的关系:

-

NLP 是学科(宏观领域):它研究的是“如何让计算机听懂人话,并像人一样说话” 。

-

LLM 是工具(最新技术):它是目前 NLP 领域最强大、最先进的技术解决方案。

简单来说:NLP 是大模型的“祖师爷”和“应用场景”,而大模型是 NLP 发展了 70 年后进化出的“究极形态”。

1.🌉 核心任务:人机沟通的桥梁

计算机的母语是 0 和 1(二进制代码),人类的母语是 自然语言(中文、英文等)。

这两者是完全不同的。

NLP 的作用就是充当“翻译官”,它包含两个核心方向:

A. 让电脑“听懂” —— NLU (自然语言理解)

-

定义:Natural Language Understanding。

-

任务:把人类复杂的语言变成机器能懂的结构化数据。

-

LLM 之前的做法:分词、词性标注、提取关键词。

-

LLM 的做法:把文字变成向量 (Embedding),计算语义关系,理解上下文和潜台词。

-

例子:你说“我今天蓝瘦香菇”。传统 NLP 可能分析出“蓝色、瘦、香菇”;LLM 能理解你是“难受想哭”。

-

B. 让电脑“会说” —— NLG (自然语言生成)

-

定义:Natural Language Generation。

-

任务:把机器的数据变成人类能读懂的通顺句子。

-

LLM 之前的做法:填空模板(你好,[姓名])、简单的拼凑。

-

LLM 的做法:像人一样逐字预测,写诗、写代码、写小说。

2.📈 NLP 的进化史:为什么 LLM 是革命?

为了理解 NLP 在大模型里的地位,我们需要看一眼历史:

| 阶段 | 技术代表 | 特点 | 像什么? |

| 规则时代 (1950s-1990s) | 语法规则 | 科学家手工写几万条语法规则教电脑。 | 查字典的死板学生。如果不符合语法,电脑就报错。 |

| 统计时代 (1990s-2010s) | RNN / LSTM | 让电脑算概率,“你好”后面大概率接“吗”。 | 只会背概率的计算器。能翻译,但句子经常不通顺。 |

| 大模型时代 (2018-现在) | Transformer (LLM) | 大力出奇迹。把人类所有书籍都读一遍,理解了语言的深层规律。 | 博学多才的作家。不仅懂语法,还懂逻辑、懂世界知识。 |

以前的 NLP 是把任务拆开做的:翻译用翻译模型,聊天用聊天模型,分类用分类模型。

现在的 LLM (大模型):一个模型解决所有 NLP 任务。你既可以让它翻译,也可以让它写诗,它通吃。

3.🛠️ NLP 具体包括哪些“手艺”?

当我们使用 ChatGPT 时,其实是在同时调用 NLP 领域的几十种传统能力:

-

机器翻译 (Machine Translation):中译英。

-

文本摘要 (Summarization):帮我总结这篇文章。

-

情感分析 (Sentiment Analysis):这句话是夸我还是骂我?

-

命名实体识别 (NER):帮我从这句话里把“人名”、“地名”、“公司名”挑出来。

-

问答系统 (QA):根据文档回答问题。

在大模型出现之前,这些是分开的独立研究方向;在大模型出现后,它们都变成了 Prompt(提示词)的一个指令。

总结

自然语言处理 (NLP) 就是“教计算机学语文” 的科学。

在大语言模型中,NLP 是灵魂。没有 NLP 的理论基础(如 Tokenization, Embedding, Attention),就没有大模型;而大模型的出现,彻底重写了 NLP 这门学科,让它从“人工规则”变成了“智能涌现”。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)