用鲸鱼算法优化极限学习机,提升预测精度

极限学习机是一种单隐层前馈神经网络,它在训练过程中只需要设置输入层与隐含层之间的连接权值和隐含层神经元的阈值,且这些参数可以随机生成。输出层的权值通过最小二乘法直接计算得到,这大大减少了训练时间。以下是简单的ELM代码示例(以Python为例,借助numpyclass ELM:return Y这里ELM类的init方法初始化了输入层大小、隐藏层大小和输出层大小,并随机生成输入层到隐藏层的权值W和隐

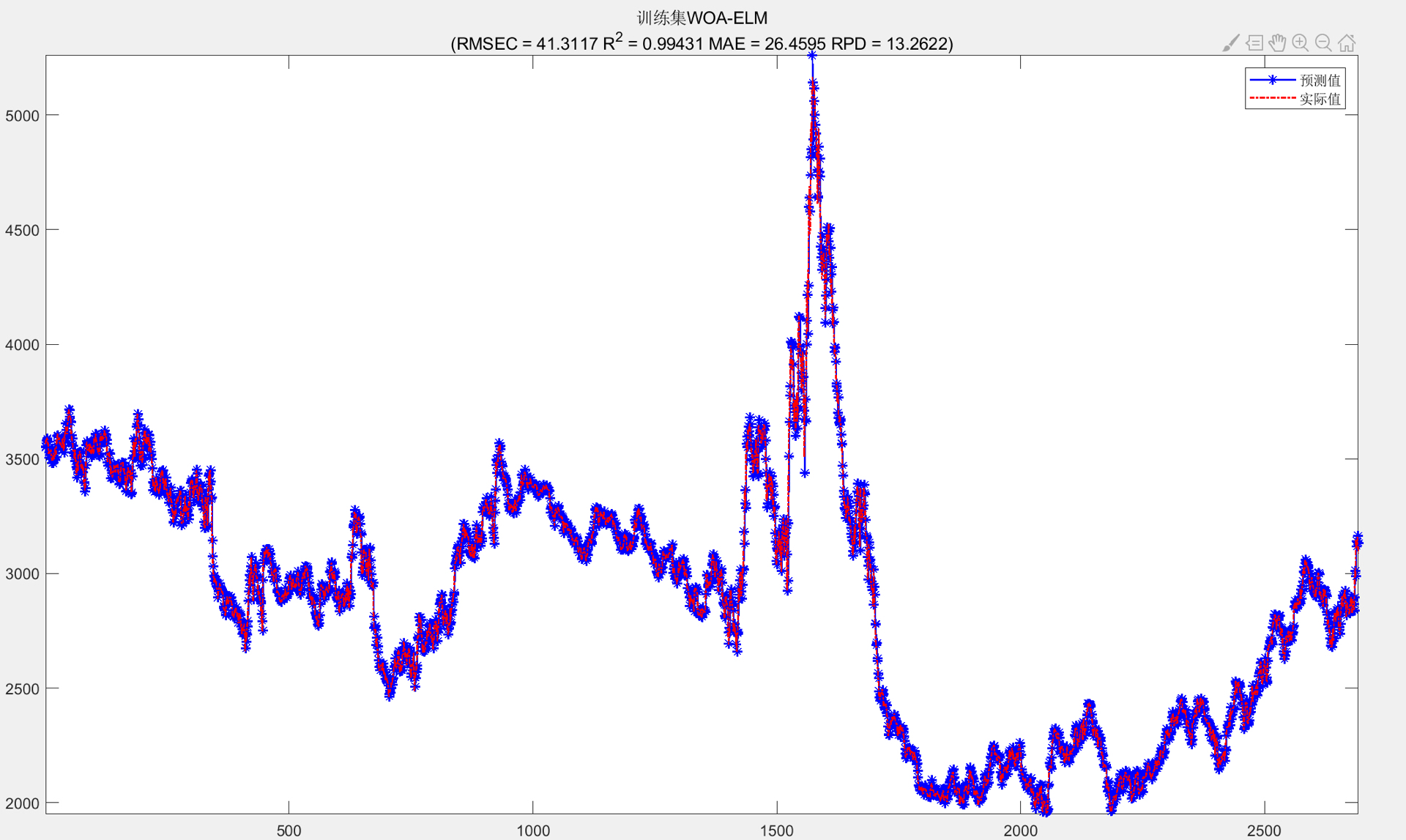

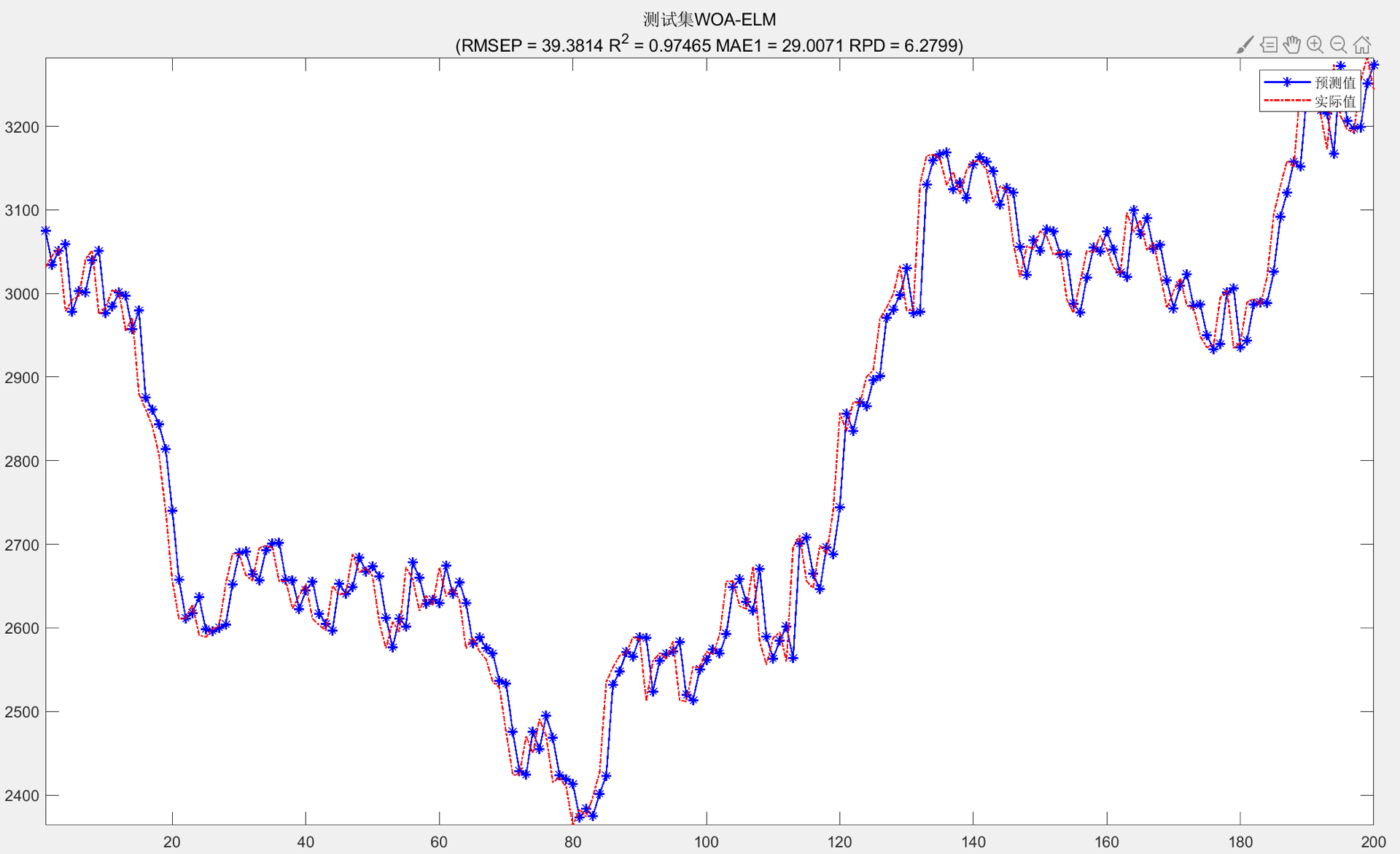

利用鲸鱼算法WOA优化极限学习机的权值和阈值,提高模型的预测精度,该模型可用于做一维的时序预测,也可用于做多输入单输出的回归预测,同时该模型也可用于学习

在数据预测的领域里,追求更高的预测精度一直是众多数据科学家和工程师的目标。今天咱们来聊聊如何利用鲸鱼算法(WOA)优化极限学习机(ELM)的权值和阈值,进而提升模型预测精度,而且这个优化后的模型在一维时序预测、多输入单输出回归预测以及学习场景中都能大展身手。

极限学习机(ELM)简介

极限学习机是一种单隐层前馈神经网络,它在训练过程中只需要设置输入层与隐含层之间的连接权值和隐含层神经元的阈值,且这些参数可以随机生成。输出层的权值通过最小二乘法直接计算得到,这大大减少了训练时间。以下是简单的ELM代码示例(以Python为例,借助numpy库):

import numpy as np

def sigmoid(x):

return 1 / (1 + np.exp(-x))

class ELM:

def __init__(self, input_size, hidden_size, output_size):

self.input_size = input_size

self.hidden_size = hidden_size

self.output_size = output_size

self.W = np.random.rand(self.hidden_size, self.input_size)

self.b = np.random.rand(self.hidden_size, 1)

self.Beta = None

def train(self, X, T):

H = sigmoid(np.dot(self.W, X.T) + self.b)

self.Beta = np.dot(np.linalg.pinv(H.T), T)

def predict(self, X):

H = sigmoid(np.dot(self.W, X.T) + self.b)

Y = np.dot(H.T, self.Beta)

return Y这里ELM类的init方法初始化了输入层大小、隐藏层大小和输出层大小,并随机生成输入层到隐藏层的权值W和隐藏层阈值b。train方法计算隐藏层输出矩阵H,并通过求伪逆的方式计算输出层权值Beta。predict方法则利用训练得到的权值进行预测。

鲸鱼算法(WOA)

鲸鱼算法是一种受座头鲸觅食行为启发的元启发式优化算法。座头鲸会围绕猎物进行螺旋式移动、收缩包围等行为,通过模拟这些行为,鲸鱼算法可以在搜索空间中寻找最优解。下面是简化的鲸鱼算法核心代码片段:

def whale_optimization(fun, dim, n, max_iter, lb, ub):

a = 2

Positions = np.random.uniform(0, 1, (n, dim)) * (ub - lb) + lb

fitness = np.array([fun(Positions[i, :]) for i in range(n)])

best_index = np.argmin(fitness)

best = Positions[best_index, :]

for t in range(max_iter):

a = 2 - t * (2 / max_iter)

for i in range(n):

r1 = np.random.rand()

r2 = np.random.rand()

A = 2 * a * r1 - a

C = 2 * r2

l = np.random.uniform(-1, 1)

p = np.random.rand()

if p < 0.5:

if np.abs(A) < 1:

D = np.abs(C * best - Positions[i, :])

Positions[i, :] = best - A * D

else:

rand_whale_index = np.random.randint(0, n)

D = np.abs(C * Positions[rand_whale_index, :] - Positions[i, :])

Positions[i, :] = Positions[rand_whale_index, :] - A * D

else:

D = np.abs(best - Positions[i, :])

Positions[i, :] = D * np.exp(l * np.random.uniform(0, 1)) * np.cos(2 * np.pi * np.random.uniform(0, 1)) + best

fitness[i] = fun(Positions[i, :])

if fitness[i] < fitness[best_index]:

best_index = i

best = Positions[best_index, :]

return best在这段代码中,whale_optimization函数实现了鲸鱼算法的主要逻辑。Positions表示鲸鱼的位置(对应优化问题的解),a是一个随着迭代次数减小的参数,它影响鲸鱼的搜索行为。A、C、l、p等参数控制鲸鱼是进行收缩包围行为还是螺旋式移动等不同的搜索策略。每次迭代中,根据不同条件更新鲸鱼位置,并记录最优解。

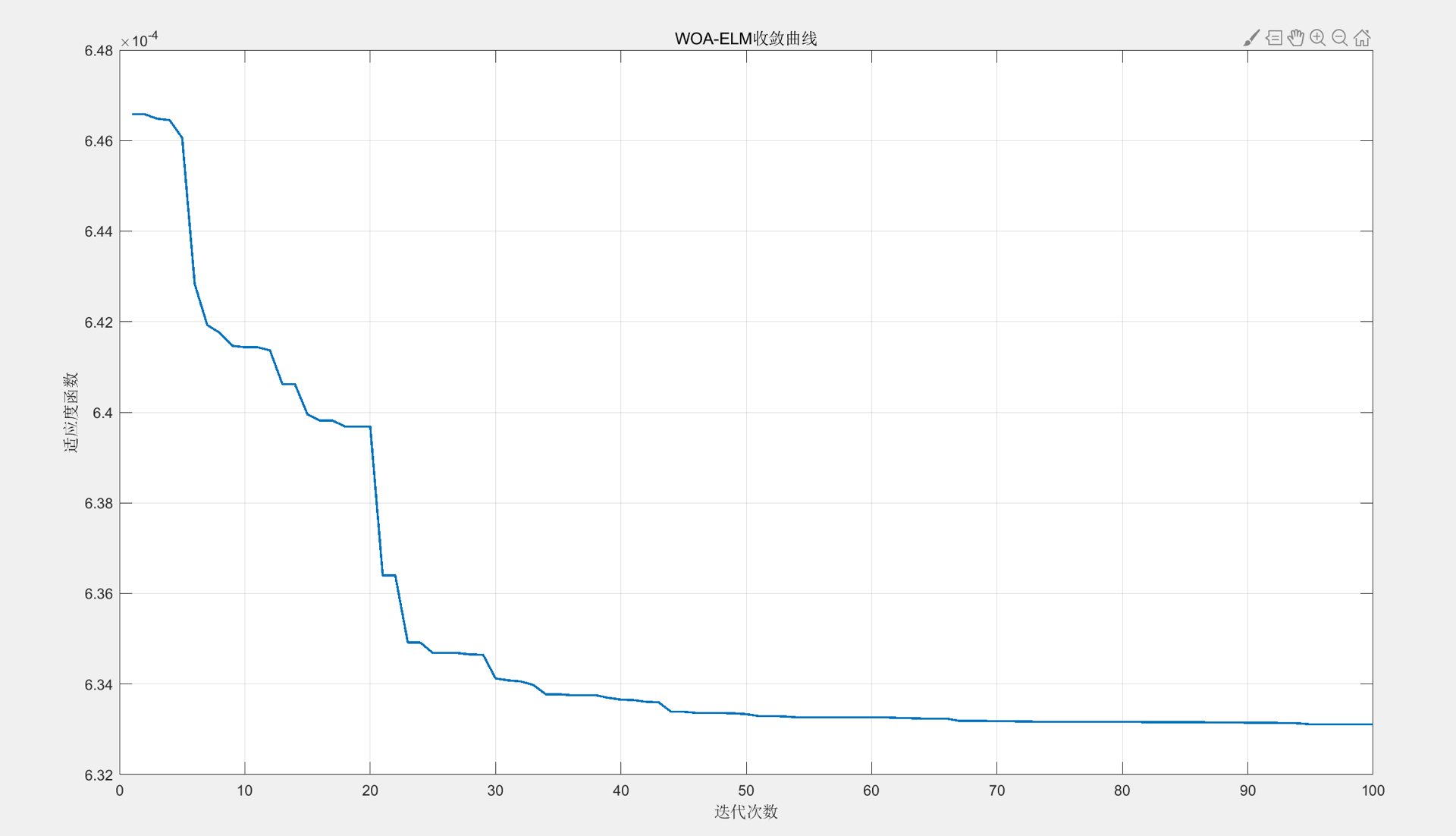

利用WOA优化ELM

我们的目标是利用鲸鱼算法优化ELM的权值和阈值,以提高模型预测精度。具体做法是将ELM的权值和阈值看作是鲸鱼算法中的解空间,通过鲸鱼算法的迭代优化找到一组最优的权值和阈值。

def elm_fitness(params, X, T, input_size, hidden_size, output_size):

W = params[:hidden_size * input_size].reshape(hidden_size, input_size)

b = params[hidden_size * input_size:hidden_size * input_size + hidden_size].reshape(hidden_size, 1)

elm = ELM(input_size, hidden_size, output_size)

elm.W = W

elm.b = b

elm.train(X, T)

Y = elm.predict(X)

mse = np.mean((Y - T) ** 2)

return mse

# 假设已有训练数据X和标签T

input_size = 10

hidden_size = 20

output_size = 1

lb = -1

ub = 1

dim = input_size * hidden_size + hidden_size

n = 50

max_iter = 100

best_params = whale_optimization(lambda p: elm_fitness(p, X, T, input_size, hidden_size, output_size),

dim, n, max_iter, lb, ub)

W_opt = best_params[:hidden_size * input_size].reshape(hidden_size, input_size)

b_opt = best_params[hidden_size * input_size:hidden_size * input_size + hidden_size].reshape(hidden_size, 1)

optimized_elm = ELM(input_size, hidden_size, output_size)

optimized_elm.W = W_opt

optimized_elm.b = b_opt

optimized_elm.train(X, T)在上述代码中,elmfitness函数计算给定权值和阈值下ELM的均方误差(MSE),这个MSE值作为鲸鱼算法优化过程中的适应度值。通过whaleoptimization函数不断迭代优化,找到使MSE最小的权值和阈值bestparams,并重新构建优化后的ELM模型optimizedelm。

应用场景

一维时序预测

在一维时序预测中,比如预测某地区未来一周的气温。将历史气温数据作为输入,经过WOA优化的ELM模型可以学习到数据中的潜在模式,从而更准确地预测未来值。

多输入单输出回归预测

对于多输入单输出回归预测场景,例如预测房屋价格,输入可以是房屋面积、房龄、周边配套设施等多个因素,输出为房屋价格。WOA优化的ELM模型能够处理这些复杂的输入关系,给出较为准确的价格预测。

学习

在学习场景中,该模型可以帮助学生或研究人员更好地理解数据间的关系,通过不断调整权值和阈值(借助WOA优化),深入挖掘数据特征,提高学习效果。

利用鲸鱼算法WOA优化极限学习机的权值和阈值,提高模型的预测精度,该模型可用于做一维的时序预测,也可用于做多输入单输出的回归预测,同时该模型也可用于学习

总之,利用鲸鱼算法优化极限学习机为我们在预测和学习任务中提供了一种更有效的途径,大家不妨在实际项目中尝试一下。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)