大模型微调实战——对事项做文本分类

随着大模型技术的不断发展,这种在消费级硬件上进行特定任务微调的模式,将极大地推动AI技术在各行各业的实际应用落地。

上篇文章介绍了大模型微调的一些“心法”和注意事项,也算是进行了预热。本文将以DeepSeek-R1-Distill-Qwen-7B模型为例,详细介绍如何在NVIDIA RTX 4090(消费级GPU,打游戏用的水平,不需要非常专业的A100、H100这种GPU)显卡上微调大模型进行文本分类任务。我们将基于一个真实的12345政府热线工单分类场景,完整展示从环境准备到模型训练的整个流程。

1. DeepSeek-R1-Distill-Qwen-7B模型介绍

DeepSeek-R1-Distill-Qwen-7B是DeepSeek团队基于Qwen-7B基座模型开发的轻量化蒸馏版本,通过知识蒸馏技术将大型语言模型的核心能力压缩至70亿参数规模。该模型在保持优秀生成能力的同时,显著降低了推理计算需求,特别适合边缘计算和资源受限场景。

1.1 模型核心优势

- 参数效率:7B参数规模下达到接近30B模型的性能表现

- 推理速度:采用动态注意力机制,生成延迟显著优化

- 部署友好:支持FP16/BF16混合精度,内存占用较原始版本降低40%

- 多模态融合:为多模态技术融合提供坚实基础,支持复杂问题的逐步推理

1.2 技术特性

该模型在数学推理、代码生成和逻辑分析方面表现卓越,具有以下技术特点:

- 思维链推理:内置

</think>标签机制,支持复杂问题的逐步推理 - 工具调用集成:标准化工具调用接口,支持外部工具和API集成

- 长上下文处理:支持长上下文处理能力

- 数学符号处理:优化的tokenizer配置,能精确处理数学表达式

2. 环境配置与模型加载

2.1 基础环境设置

首先,我们需要配置基础环境并加载所需的库:

import torch

from unsloth import FastLanguageModel

from datasets import load_dataset

from trl import SFTTrainer

from transformers import TrainingArguments

from unsloth import is_bfloat16_supported

import numpy as np

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

import os

import wandb

from tqdm import tqdm

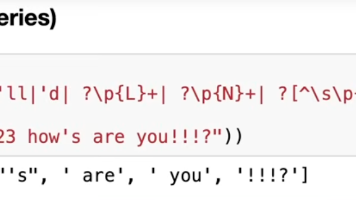

import re

代码解析:

- 使用

unsloth库优化模型训练效率,这是针对大模型微调的高级封装库 trl库提供SFT(Supervised Fine-Tuning)训练器,简化训练流程- 导入多种评估指标,用于后续模型性能评估

2.2 模型参数配置与加载

# 设置基本参数

max_seq_length = 896

dtype = None

load_in_4bit = True

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "/root/models/DeepSeek-R1-Distill-Qwen-7B",

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)

参数说明表:

| 参数 | 取值 | 说明 |

|---|---|---|

| max_seq_length | 896 | 模型最大序列长度,影响内存占用和训练效果 |

| load_in_4bit | True | 4位量化加载,显著降低显存需求 |

| dtype | None | 自动选择合适的数据类型 |

4位量化(4-bit)技术能在保持模型性能的同时,大幅降低显存占用,使得在消费级显卡上运行70亿参数模型成为可能。

2.3 LoRA适配器配置

FastLanguageModel.for_training(model)

model = FastLanguageModel.get_peft_model(

model,

r=64,

target_modules=[

"q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj",

],

lora_alpha=64,

lora_dropout=0.05,

bias="none",

use_gradient_checkpointing="unsloth",

random_state=3407,

use_rslora=False,

loftq_config=None,

)

LoRA配置详解:

LoRA(Low-Rank Adaptation)是一种高效的大模型微调技术,通过低秩适配器实现参数高效更新。其核心思想如下图所示:

基础模型参数 → 冻结

↓

LoRA适配器 → 低秩分解 → 少量可训练参数

↓

微调后模型

关键参数作用:

r=64:LoRA秩,影响适配器的表达能力target_modules:指定要微调的注意力模块lora_alpha=64:LoRA缩放系数,影响适配器对原始参数的调整幅度use_gradient_checkpointing="unsloth":使用梯度检查点优化内存使用

3. 数据处理与提示词工程

3.1 任务特定的提示词设计

train_prompt_style = """你是一个12345政府热线处理中心的工作人员,根据问题内容,结合处办单位的职责,你需要把工单派发给以下单位中的一个。

### Instruction:

有以下70个处办单位:

[单位列表...]

请根据以下问题内容,给出正确的处办单位:

### Question:

{}

### Response:

</think>

{}

"""

EOS_TOKEN = tokenizer.eos_token

print(EOS_TOKEN)

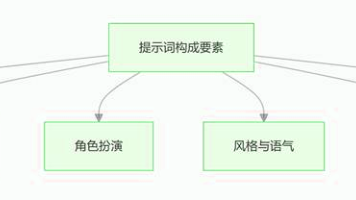

提示词设计要点:

- 角色定义:明确模型在政府热线处理中的角色

- 任务说明:清晰描述文本分类任务的具体要求

- 结构化格式:使用Instruction-Question-Response的标准格式

- 思维链提示:包含

</think>标签,引导模型进行逐步推理

这种指令微调格式能让模型更好地理解任务需求,提高分类准确性。

3.2 数据预处理流程

def formatting_prompts_func(examples):

inputs = examples["Question"]

cots = examples["Complex_CoT"]

outputs = examples["Response"]

texts = []

for input, cot, output in zip(inputs, cots, outputs):

text = train_prompt_style.format(input, cot, output) + EOS_TOKEN

texts.append(text)

return {"text": texts}

# 指定数据文件路径

data_files = "12345sentence.json"

dataset = load_dataset('json', data_files=data_files, split="train[0:]")

dataset = dataset.train_test_split(test_size=0.1, seed=42)

# 应用格式化函数

dataset = dataset.map(formatting_prompts_func, batched=True)

数据处理流程:

原始JSON数据 → 加载与分割 → 提示词格式化 → 训练就绪数据

↓ ↓ ↓

Question字段 训练/测试分割 添加指令模板

↓ ↓ ↓

CoT思维链 随机种子固定 添加EOS标记

↓ ↓ ↓

Response标签 比例控制 批量处理优化

这种数据预处理方式确保了模型能够接收到结构化的输入,包含了任务说明、示例数据和期望输出。

4. 训练配置与参数优化

4.1 训练参数详细配置

trainer = SFTTrainer(

model=model,

tokenizer=tokenizer,

train_dataset=dataset["train"],

dataset_text_field="text",

max_seq_length=max_seq_length,

dataset_num_proc=4,

args=TrainingArguments(

per_device_train_batch_size=2,

gradient_accumulation_steps=8,

warmup_steps=100,

num_train_epochs=1,

learning_rate=5e-5,

fp16=not is_bfloat16_supported(),

bf16=is_bfloat16_supported(),

logging_steps=50,

optim="adamw_8bit",

weight_decay=0.01,

lr_scheduler_type="cosine",

seed=3407,

output_dir="outputs_12345",

),

)

训练参数优化策略:

4.1.1 批次大小与梯度累积

- per_device_train_batch_size=2:适应4090的24GB显存限制

- gradient_accumulation_steps=8:等效批次大小=2×8=16,平衡训练稳定性和显存使用

4.1.2 学习率与优化器

learning_rate=5e-5, # 适合分类任务的较小学习率

optim="adamw_8bit", # 8位AdamW优化器,节省显存

lr_scheduler_type="cosine", # 余弦退火调度,平滑收敛

4.1.3 精度与数值稳定性

fp16=not is_bfloat16_supported(), # 自动选择混合精度

bf16=is_bfloat16_supported(), # 优先使用bfloat16

不同精度格式对训练的影响对比:

| 精度格式 | 内存占用 | 训练速度 | 数值稳定性 |

|---|---|---|---|

| FP32 | 高 | 慢 | 最佳 |

| FP16 | 中 | 快 | 需梯度缩放 |

| BF16 | 中 | 快 | 优于FP16 |

4.2 内存优化技术

针对RTX 4090的24GB显存限制,我们采用了多重优化策略:

-

4位量化:模型以4位精度加载,显著降低初始内存占用

-

梯度检查点:用计算时间换空间,减少激活值内存占用

-

梯度累积:模拟更大批次训练,不增加峰值显存需求

-

混合精度训练:平衡计算精度和内存效率

-

训练执行与监控

5.1 启动训练过程

trainer_stats = trainer.train()

训练过程启动后,系统会自动处理以下流程:

- 数据加载与批处理:将文本数据转换为模型可处理的token序列

- 前向传播:计算模型预测结果

- 损失计算:比较预测结果与真实标签

- 反向传播:计算参数梯度

- 参数更新:根据优化器策略更新模型参数

5.2 训练过程监控

建议使用WandB等工具监控以下关键指标:

- 训练损失:观察损失下降曲线,判断收敛情况

- 学习率变化:监控余弦退火调度的效果

- 梯度范数:确保梯度数值稳定性

- 显存使用:优化资源配置,避免OOM错误

- 模型性能评估与优化建议

6.1 性能评估指标

在文本分类任务中,我们应综合评估以下指标:

- 准确率:整体分类正确率

- 精确率:正类预测的准确性

- 召回率:正类识别的完整性

- F1分数:精确率和召回率的调和平均

6.2 针对DeepSeek-R1-Distill-Qwen-7B的优化建议

-

思维链提示优化:充分利用模型的逐步推理能力,设计更细致的CoT提示

-

动态批处理:根据序列长度动态调整批次大小,提高训练效率

-

知识蒸馏:利用更大模型的输出作为软标签,提升小模型性能

-

实际应用与部署

训练完成后,模型可应用于实际的12345热线工单分类场景:

def classify_government_request(model, tokenizer, question

):

prompt = train_prompt_style.

format(question, "", "").replace("</think>\n{}", ""

)

inputs = tokenizer(prompt, return_tensors=

"pt", max_length=896, truncation=True

)

with

torch.no_grad():

outputs = model.generate(

inputs.input_ids,

max_new_tokens=

50

,

temperature=

0.7

,

do_sample=

True

,

pad_token_id=tokenizer.eos_token_id

)

response = tokenizer.decode(outputs[

0], skip_special_tokens=True

)

return extract_prediction(response)

总结

本文详细介绍了在NVIDIA RTX 4090上微调DeepSeek-R1-Distill-Qwen-7B模型进行文本分类的完整流程。通过合理的参数配置、内存优化技术和任务特定的提示词工程,我们能够在消费级硬件上高效完成大模型微调。

DeepSeek-R1-Distill-Qwen-7B凭借其优秀的推理能力和高效的参数设计,在文本分类任务中展现出强大潜力。结合LoRA等参数高效微调技术,为在有限资源环境下部署大模型应用提供了实用解决方案。

随着大模型技术的不断发展,这种在消费级硬件上进行特定任务微调的模式,将极大地推动AI技术在各行各业的实际应用落地。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献567条内容

已为社区贡献567条内容

所有评论(0)