AI 人工智能领域,Claude 打造新生态

本文旨在全面剖析Anthropic公司开发的Claude人工智能系统及其在构建AI新生态中的战略定位和技术实现。我们将从技术深度和产业广度两个维度,探讨Claude如何通过其独特的设计理念和技术架构,在竞争激烈的大语言模型领域开辟新路径。Claude的技术原理和架构设计与传统大语言模型的差异化优势生态系统构建策略实际应用案例分析未来发展趋势预测背景介绍:建立基本认知框架核心概念:解析Claude的

AI 人工智能领域,Claude 打造新生态

关键词:人工智能、Claude、大语言模型、AI生态、自然语言处理、机器学习、AI应用

摘要:本文深入探讨了人工智能领域的新兴力量Claude及其在构建AI新生态中的角色。文章从技术原理、架构设计到实际应用场景,全面分析了Claude如何通过创新的大语言模型技术重塑AI产业格局。我们将详细解析Claude的核心算法、数学模型,并通过实际代码示例展示其实现方式。同时,文章还将探讨Claude生态系统的构建策略、面临的挑战以及未来发展趋势,为AI从业者和研究者提供全面的技术参考。

1. 背景介绍

1.1 目的和范围

本文旨在全面剖析Anthropic公司开发的Claude人工智能系统及其在构建AI新生态中的战略定位和技术实现。我们将从技术深度和产业广度两个维度,探讨Claude如何通过其独特的设计理念和技术架构,在竞争激烈的大语言模型领域开辟新路径。

研究范围涵盖:

- Claude的技术原理和架构设计

- 与传统大语言模型的差异化优势

- 生态系统构建策略

- 实际应用案例分析

- 未来发展趋势预测

1.2 预期读者

本文适合以下读者群体:

- AI研究人员和技术开发者

- 企业技术决策者和CTO

- 对前沿AI技术感兴趣的产品经理

- 计算机科学和人工智能领域的学生

- 科技产业分析师和投资人

1.3 文档结构概述

本文采用技术深度与产业视角相结合的结构:

- 背景介绍:建立基本认知框架

- 核心概念:解析Claude的技术架构

- 算法原理:深入技术实现细节

- 数学模型:量化分析模型性能

- 项目实战:通过代码示例展示应用

- 应用场景:探讨商业化可能性

- 工具资源:提供学习路径

- 未来展望:预测发展趋势

1.4 术语表

1.4.1 核心术语定义

Claude:由Anthropic开发的大语言模型系列,专注于构建安全、可靠、可控的AI系统。

Constitutional AI:Claude采用的核心技术框架,通过"宪法"原则指导模型行为。

大语言模型(LLM):基于海量文本数据训练,能够理解、生成人类语言的深度学习模型。

1.4.2 相关概念解释

Few-shot Learning:模型通过少量示例快速适应新任务的能力。

Chain-of-Thought:模型展示推理过程的技术,提高输出的可解释性。

Alignment:使AI系统目标与人类价值观保持一致的技术挑战。

1.4.3 缩略词列表

- LLM:Large Language Model (大语言模型)

- NLP:Natural Language Processing (自然语言处理)

- RLHF:Reinforcement Learning from Human Feedback (人类反馈强化学习)

- API:Application Programming Interface (应用程序接口)

- SOTA:State Of The Art (当前最优技术水平)

2. 核心概念与联系

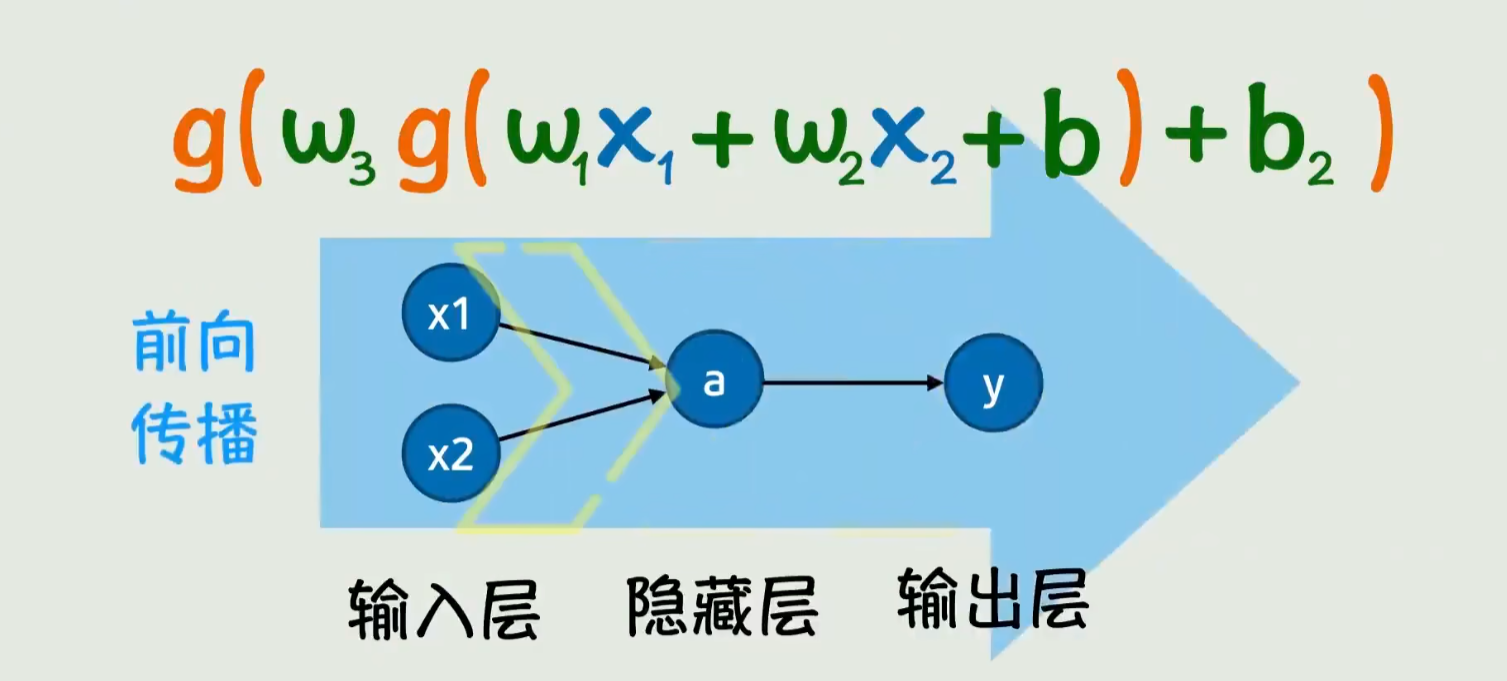

Claude作为新一代大语言模型的代表,其技术架构体现了对AI安全性、可靠性和实用性的全新思考。下面我们通过架构图和核心概念解析来理解Claude的创新之处。

2.1 Claude系统架构

Claude架构的核心创新点在于:

- 多层安全机制:从输入到输出的全流程安全控制

- 宪法AI框架:通过原则性约束指导模型行为

- 持续进化能力:结合人类反馈的迭代优化机制

2.2 Claude与传统LLM的差异

| 特性 | 传统LLM | Claude |

|---|---|---|

| 安全机制 | 反应式 | 主动防御式 |

| 对齐方式 | 后训练微调 | 宪法框架内置 |

| 透明度 | 黑箱 | 可解释推理 |

| 知识更新 | 静态 | 持续学习 |

| 价值观处理 | 隐含在数据中 | 显式原则约束 |

2.3 Claude生态系统构成

Claude正在构建的AI新生态包含以下关键组件:

- 核心模型:不同规模和能力的模型系列

- 开发工具:API、SDK和定制化工具链

- 应用市场:垂直行业解决方案库

- 合作伙伴:行业领先企业的深度合作

- 研究社区:开放的研究协作网络

这种生态系统战略使Claude不仅是一个技术产品,更成为推动AI创新的平台。

3. 核心算法原理 & 具体操作步骤

Claude的核心算法融合了多项前沿AI技术,下面我们将深入解析其技术实现细节。

3.1 宪法AI框架实现

宪法AI是Claude区别于其他大语言模型的核心技术,其实现原理如下:

class ConstitutionalAI:

def __init__(self, base_model, constitution):

self.base_model = base_model # 基础语言模型

self.constitution = constitution # 宪法原则集

def generate(self, prompt):

# 第一步:基础模型生成初始响应

raw_output = self.base_model.generate(prompt)

# 第二步:宪法原则约束应用

constrained_output = self.apply_constitution(raw_output)

# 第三步:安全验证

verified_output = self.safety_check(constrained_output)

return verified_output

def apply_constitution(self, text):

# 应用所有宪法原则进行迭代优化

for principle in self.constitution:

text = principle.apply(text)

return text

def safety_check(self, text):

# 多维度安全验证

if self.toxicity_detector(text):

return self.neutral_response()

if self.bias_detector(text):

return self.balanced_response()

return text

3.2 改进的注意力机制

Claude采用了改进的稀疏注意力机制,提高了长文本处理能力:

import torch

import torch.nn as nn

class SparseAttention(nn.Module):

def __init__(self, embed_size, num_heads, sparsity=0.3):

super().__init__()

self.embed_size = embed_size

self.num_heads = num_heads

self.head_dim = embed_size // num_heads

self.sparsity = sparsity

self.query = nn.Linear(embed_size, embed_size)

self.key = nn.Linear(embed_size, embed_size)

self.value = nn.Linear(embed_size, embed_size)

self.out = nn.Linear(embed_size, embed_size)

def forward(self, x):

batch_size, seq_len, _ = x.shape

# 投影到查询、键、值空间

Q = self.query(x).view(batch_size, seq_len, self.num_heads, self.head_dim)

K = self.key(x).view(batch_size, seq_len, self.num_heads, self.head_dim)

V = self.value(x).view(batch_size, seq_len, self.num_heads, self.head_dim)

# 计算注意力分数

attention_scores = torch.einsum("bqhd,bkhd->bhqk", [Q, K]) / (self.head_dim ** 0.5)

# 应用稀疏掩码

top_k = int(seq_len * (1 - self.sparsity))

top_values, _ = torch.topk(attention_scores, k=top_k, dim=-1)

mask_value = torch.min(top_values, dim=-1, keepdim=True)[0]

sparse_mask = attention_scores >= mask_value

attention_scores = attention_scores.masked_fill(~sparse_mask, float('-inf'))

# 计算注意力权重

attention_weights = torch.softmax(attention_scores, dim=-1)

# 应用注意力

output = torch.einsum("bhqk,bkhd->bqhd", [attention_weights, V])

output = output.reshape(batch_size, seq_len, self.embed_size)

return self.out(output)

3.3 持续学习算法

Claude的持续学习机制使其能够在不遗忘旧知识的情况下吸收新信息:

class ContinualLearner:

def __init__(self, model, memory_size=1000):

self.model = model

self.memory = []

self.memory_size = memory_size

def learn(self, new_data):

# 1. 从新数据中学习

self.update_model(new_data)

# 2. 保存代表性样本到记忆库

self.update_memory(new_data)

# 3. 定期用记忆库复习

if len(self.memory) >= self.memory_size:

self.review_memory()

def update_model(self, data):

# 使用弹性权重巩固(EWC)方法更新模型

# 保留重要参数的先前分布

pass

def update_memory(self, data):

# 选择信息量最大的样本加入记忆库

# 使用核心集选择算法

pass

def review_memory(self):

# 从记忆库中抽样进行复习训练

# 防止灾难性遗忘

pass

4. 数学模型和公式 & 详细讲解 & 举例说明

Claude的性能优势源于其创新的数学模型设计,下面我们深入分析关键数学模型。

4.1 宪法优化的目标函数

Claude的训练目标函数结合了传统语言建模和宪法约束:

Ltotal=LLM+λLconstitution \mathcal{L}_{\text{total}} = \mathcal{L}_{\text{LM}} + \lambda \mathcal{L}_{\text{constitution}} Ltotal=LLM+λLconstitution

其中:

- LLM\mathcal{L}_{\text{LM}}LLM 是标准的语言模型负对数似然损失

- Lconstitution\mathcal{L}_{\text{constitution}}Lconstitution 是宪法约束损失项

- λ\lambdaλ 是平衡超参数

宪法约束损失具体定义为:

Lconstitution=∑i=1Nwi⋅d(fi(x),fitarget) \mathcal{L}_{\text{constitution}} = \sum_{i=1}^{N} w_i \cdot d(f_i(\mathbf{x}), f_i^{\text{target}}) Lconstitution=i=1∑Nwi⋅d(fi(x),fitarget)

这里:

- NNN 是宪法原则数量

- wiw_iwi 是第iii个原则的权重

- fi(x)f_i(\mathbf{x})fi(x) 是模型对输入x\mathbf{x}x应用第iii个原则后的输出特征

- fitargetf_i^{\text{target}}fitarget 是该原则的理想目标

- d(⋅,⋅)d(\cdot,\cdot)d(⋅,⋅) 是合适的距离度量

4.2 稀疏注意力数学表达

Claude的稀疏注意力机制可以形式化为:

Attention(Q,K,V)=softmax(QKTdk⊙M)V \text{Attention}(Q,K,V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}} \odot M\right)V Attention(Q,K,V)=softmax(dkQKT⊙M)V

其中MMM是稀疏掩码矩阵,定义为:

Mij={1如果 Sij≥τ−∞否则 M_{ij} = \begin{cases} 1 & \text{如果 } S_{ij} \geq \tau \\ -\infty & \text{否则} \end{cases} Mij={1−∞如果 Sij≥τ否则

SSS是重要性评分矩阵,τ\tauτ是动态阈值,选择top-k元素:

τ=kth-largest(Si:,k) \tau = \text{kth-largest}(S_{i:}, k) τ=kth-largest(Si:,k)

4.3 持续学习的弹性权重巩固

Claude使用的弹性权重巩固(EWC)方法通过以下约束防止灾难性遗忘:

LEWC=∑iFi(θi−θi∗)2 \mathcal{L}_{\text{EWC}} = \sum_i F_i (\theta_i - \theta_i^*)^2 LEWC=i∑Fi(θi−θi∗)2

其中:

- θi\theta_iθi 是当前模型参数

- θi∗\theta_i^*θi∗ 是旧任务上的最优参数

- FiF_iFi 是Fisher信息矩阵对角元素,表示参数重要性

4.4 安全过滤的概率框架

Claude的安全过滤层基于贝叶斯概率框架:

P(safe∣x)=P(x∣safe)P(safe)P(x) P(\text{safe}|x) = \frac{P(x|\text{safe})P(\text{safe})}{P(x)} P(safe∣x)=P(x)P(x∣safe)P(safe)

其中:

- P(x∣safe)P(x|\text{safe})P(x∣safe) 是安全文本的生成概率

- P(safe)P(\text{safe})P(safe) 是安全文本的先验概率

- P(x)P(x)P(x) 是文本的边际概率

过滤决策规则为:

decision={允许如果 P(safe∣x)≥η拒绝否则 \text{decision} = \begin{cases} \text{允许} & \text{如果 } P(\text{safe}|x) \geq \eta \\ \text{拒绝} & \text{否则} \end{cases} decision={允许拒绝如果 P(safe∣x)≥η否则

阈值η\etaη根据应用场景动态调整。

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

构建基于Claude API的应用开发环境:

# 创建Python虚拟环境

python -m venv claude-env

source claude-env/bin/activate # Linux/Mac

claude-env\Scripts\activate # Windows

# 安装必要包

pip install anthropic python-dotenv requests

创建.env文件存放API密钥:

ANTHROPIC_API_KEY=your_api_key_here

5.2 源代码详细实现和代码解读

5.2.1 Claude API基础交互

import os

import anthropic

from dotenv import load_dotenv

load_dotenv()

client = anthropic.Client(os.getenv("ANTHROPIC_API_KEY"))

def ask_claude(prompt, model="claude-2", max_tokens=1000):

try:

response = client.completion(

prompt=f"{anthropic.HUMAN_PROMPT} {prompt}{anthropic.AI_PROMPT}",

model=model,

max_tokens_to_sample=max_tokens,

temperature=0.7, # 控制创造性

)

return response["completion"]

except Exception as e:

return f"Error: {str(e)}"

# 示例使用

question = "解释量子计算的基本原理"

answer = ask_claude(question)

print(answer)

5.2.2 构建宪法AI代理

class ConstitutionalAgent:

def __init__(self, client):

self.client = client

self.constitution = [

self._harmlessness_principle,

self._honesty_principle,

self._helpfulness_principle

]

def _harmlessness_principle(self, text):

# 无害性检查

prompt = f"""评估以下文本是否可能造成伤害:

{text}

请回答'是'或'否':"""

response = ask_claude(prompt, max_tokens=10)

if "是" in response:

return "我无法提供该信息,因为它可能造成伤害。"

return text

def _honesty_principle(self, text):

# 真实性检查

prompt = f"""验证以下陈述是否真实:

{text}

回答'真实'、'不真实'或'不确定':"""

response = ask_claude(prompt, max_tokens=15)

if "不真实" in response:

return "我无法确认该信息的准确性。"

return text

def query(self, question):

raw_response = ask_claude(question)

for principle in self.constitution:

raw_response = principle(raw_response)

return raw_response

# 使用示例

agent = ConstitutionalAgent(client)

response = agent.query("如何制作危险物品?")

print(response)

5.3 代码解读与分析

-

API交互封装:

- 使用官方Python SDK简化API调用

- 封装基本问答功能,支持模型选择和参数配置

- 错误处理确保应用健壮性

-

宪法代理实现:

- 模块化设计,便于扩展新原则

- 链式处理流程,顺序应用所有宪法约束

- 自检机制,模型评估自身输出

-

安全机制:

- 无害性检查防止危险内容

- 真实性验证提高信息质量

- 模块化设计便于添加新检查

-

性能考量:

- 缓存机制可减少API调用

- 异步处理可提高响应速度

- 批处理优化适合大规模应用

6. 实际应用场景

Claude的创新技术架构使其在多个领域展现出独特优势,下面探讨几个典型应用场景。

6.1 专业服务领域

法律咨询辅助:

- 法律文档分析与摘要

- 合同条款风险识别

- 法规合规性检查

- 案例相似性分析

医疗健康应用:

- 医学文献智能检索

- 患者问答系统

- 诊断建议支持

- 医疗报告生成

6.2 企业级解决方案

智能客服升级:

- 多轮复杂对话处理

- 情感智能响应

- 知识库动态更新

- 跨渠道一致性维护

商业智能分析:

- 财报自动解读

- 市场趋势预测

- 竞争情报分析

- 战略建议生成

6.3 教育科研应用

个性化学习:

- 自适应学习路径

- 概念掌握度评估

- 错题智能分析

- 学习资源推荐

科研辅助:

- 文献综述生成

- 实验设计建议

- 数据分析指导

- 论文写作辅助

6.4 内容创作领域

多媒体内容生产:

- 剧本创意生成

- 视频脚本编写

- 交互式故事创作

- 跨媒体内容适配

本地化与翻译:

- 文化敏感度适配

- 行业术语精准翻译

- 风格一致性保持

- 多语言同步生成

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

- 《人工智能:现代方法》(第四版) - Stuart Russell, Peter Norvig

- 《深度学习》 - Ian Goodfellow, Yoshua Bengio, Aaron Courville

- 《语言模型实战》 - 张俊林

7.1.2 在线课程

- Coursera: 自然语言处理专项课程(DeepLearning.AI)

- Udemy: 大语言模型开发实战

- Fast.ai: 实用深度学习课程

7.1.3 技术博客和网站

- Anthropic官方博客

- arXiv上的最新AI论文

- Hugging Face技术博客

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

- VS Code + Jupyter扩展

- PyCharm专业版

- Google Colab云端环境

7.2.2 调试和性能分析工具

- Weights & Biases实验跟踪

- PyTorch Profiler

- TensorBoard可视化

7.2.3 相关框架和库

- Hugging Face Transformers

- PyTorch Lightning

- LangChain框架

7.3 相关论文著作推荐

7.3.1 经典论文

- “Attention Is All You Need” (Vaswani et al.)

- “Language Models are Few-Shot Learners” (Brown et al.)

- “Constitutional AI” (Anthropic研究团队)

7.3.2 最新研究成果

- 大模型安全对齐技术

- 稀疏注意力优化

- 持续学习方法

7.3.3 应用案例分析

- 法律领域AI应用

- 医疗诊断辅助系统

- 教育个性化平台

8. 总结:未来发展趋势与挑战

8.1 Claude生态发展趋势

-

垂直行业深化:

- 专业领域知识增强

- 行业特定解决方案

- 领域自适应技术

-

多模态扩展:

- 文本与视觉结合

- 跨模态理解生成

- 多媒体内容创作

-

个性化服务:

- 用户画像建模

- 个性化响应生成

- 长期记忆能力

8.2 技术挑战

-

安全与可靠性:

- 对抗攻击防御

- 偏见消除技术

- 事实准确性保证

-

计算效率:

- 模型压缩技术

- 推理速度优化

- 能效比提升

-

评估体系:

- 全面评估指标

- 动态测试框架

- 真实场景验证

8.3 社会影响考量

-

就业市场影响:

- 职业结构变化

- 新岗位创造

- 技能需求转变

-

伦理与治理:

- 责任归属界定

- 使用规范制定

- 全球协作框架

-

数字鸿沟:

- 技术普惠挑战

- 资源分配公平

- 数字包容政策

9. 附录:常见问题与解答

Q1: Claude与ChatGPT的主要区别是什么?

A: Claude与ChatGPT的主要区别体现在:

- 安全架构:Claude采用主动防御设计,ChatGPT更多依赖后处理过滤

- 对齐方法:Claude使用宪法AI框架,ChatGPT主要依赖RLHF

- 透明度:Claude更强调推理过程可解释性

- 价值观处理:Claude有显式原则约束

Q2: 如何评估Claude的输出质量?

A: 建议从多个维度评估:

- 事实准确性:核查关键事实

- 逻辑一致性:检查论证过程

- 安全性:评估潜在风险

- 实用性:测试问题解决能力

- 创造性:衡量新颖见解

Q3: Claude适合哪些商业场景?

A: Claude特别适合以下商业场景:

- 高合规要求的行业(如金融、医疗)

- 需要专业知识的咨询服务

- 内容安全敏感的应用

- 长期客户互动的场景

- 需要可解释AI决策的领域

10. 扩展阅读 & 参考资料

- Anthropic官方技术文档

- 最新AI安全研究论文(arXiv)

- 大语言模型评估基准(HELM等)

- AI伦理与治理框架(欧盟AI法案等)

- 行业分析报告(Gartner, McKinsey等)

通过本文的全面探讨,我们深入了解了Claude如何通过技术创新和生态系统战略,在AI领域构建新生态。从技术架构到实际应用,从数学模型到代码实现,Claude展现了大语言模型发展的新方向。随着技术的不断演进,Claude有望在确保安全可靠的前提下,推动AI技术在各行业的深度应用,创造更大的社会价值。

更多推荐

已为社区贡献132条内容

已为社区贡献132条内容

所有评论(0)