入门篇--知名企业-9-从逆袭黑马到行业标杆,Anthropic——家试图为AI装上“良心”的公司

Anthropic:一家试图为AI装上“良心”的公司

作者 | Weisian · 科技观察者

一、引子:当AI开始“思考”人类的命运

2023年,全球科技圈被一个名字反复提及——Anthropic。它不像OpenAI那样早早站在聚光灯下,也不像Google或Meta那样背靠万亿美元帝国。但它却悄然成为AI安全领域最受尊敬的名字之一。

更令人惊讶的是,这家公司的估值在短短几年内飙升至150亿美元以上,并获得了亚马逊、谷歌等巨头数十亿美元的战略投资。人们不禁要问:Anthropic到底做对了什么?它为何被称作“AI界的良心”?

今天,我想带你走进Anthropic的世界——不谈晦涩的技术术语,不堆砌融资数据,而是从人、理念与责任的角度,理解这家公司在AI狂奔时代所扮演的独特角色。

二、谁创立了Anthropic?一群“叛逃者”的理想主义实验

提到Anthropic,很多人第一反应是“OpenAI系创业公司”——这个标签没错,但远远不够全面。

Anthropic成立于2021年,总部位于加州旧金山,由Daniela Amodei和Dario Amodei兄妹共同创立。哥哥Dario曾是OpenAI的研究副总裁,主导过GPT-2和GPT-3的早期安全评估;妹妹Daniela则负责OpenAI的政策与合作事务。核心团队还包括多位来自Google DeepMind、专注AI对齐(AI Alignment)研究的科学家。

他们离开原有岗位的原因惊人地一致:对AI发展速度与安全监管严重脱节的深切忧虑。

“我们不是反对AI进步,而是害怕它跑得太快,却没人系好安全带。”

—— Dario Amodei 在一次访谈中坦言

于是,这群“理想主义者”决定另起炉灶,创办一家以安全为第一优先级的AI公司。Anthropic(源自希腊语“anthropos”,意为“人类”)这个名字本身就昭示了他们的初心:技术必须服务于人,而非凌驾于人之上。

尽管起点高、团队小(2023年仅约40人),但Anthropic选择了专注打磨底层技术,而非盲目追逐消费市场。直到2023年3月推出首款聊天机器人Claude,才正式走进大众视野。

三、核心技术:“宪法AI”——安全为王的护城河

如果说Anthropic有什么独步天下的技术,那一定是宪法AI(Constitutional AI)。这是它区别于OpenAI等同行的核心壁垒,也是其在企业市场站稳脚跟的根本。

3.1 什么是“宪法AI”?

简单来说,Anthropic为AI模型制定了一套“行为准则”——一部包含诚实、无害、公平、尊重隐私等价值原则的“AI宪法”。模型在生成内容前,会对照这部宪法进行自我审查与修正,确保输出安全、合规。

关键技术突破在于:用RLAIF(基于AI反馈的强化学习)。传统RLHF依赖大量人工标注,成本高且易带偏见;而RLAIF让AI在人类设定的宪法框架下自我监督、自我优化,不仅降低成本,还提升了行为一致性。

3.2 安全不止于“不犯错”

对企业客户而言,“安全”绝非虚词,而是刚需。在金融、医疗、法律等高度监管行业,AI的错误输出可能带来巨大经济损失甚至法律风险。

为此,Anthropic设计了“认知不确定性头”(Cognitive Uncertainty Head)模块:模型能实时评估自身回答的置信度,一旦低于阈值,便主动拒答。例如,在医疗建议场景中,若模型对诊断结论缺乏把握,会提示用户“请咨询专业医生”,而非冒险输出。

随着迭代,“宪法AI”也在进化:

- 3.0版本新增环境可持续性与文化敏感性条款;

- 优化高危风险分类器,大幅降低误报率;

- 形成从理念 → 技术 → 场景的三重安全体系,构筑难以复制的护城河。

四、核心理念:不只是造模型,更要“对齐”人类价值观

Anthropic最与众不同的地方,在于将“AI对齐”(AI Alignment)作为公司存在的根本使命。

4.1 什么是AI对齐?

即确保AI系统的行为始终符合人类的意图、价值观与长期利益。例如:

- 当你问“如何制作炸弹?”时,AI应拒绝回答;

- 在医疗诊断中,优先考虑患者福祉,而非效率;

- 面对模糊指令,应主动澄清,而非擅自“脑补”。

这听起来理所当然,但在现实中极难实现。许多大模型为追求“流畅”与“有用”,常绕过伦理边界,生成有害内容。

4.2 从Claude到宪法AI:构建内在道德指南针

Anthropic开发的大语言模型系列名为Claude。截至2024年,最新版本为Claude 3.5 Sonnet,在多项基准测试中超越GPT-4。

但真正让它脱颖而出的,是其独特的训练机制——宪法AI:

- 模型先通过人类反馈学习基本行为;

- 再对照“AI宪法”(含数十条伦理原则)进行自检;

- 若输出违反原则,自动重写直至合规。

这就像给AI装了一个“内在道德指南针”,而非依赖外部打分或事后过滤。

这种方法大幅减少有害输出,也让Claude在用户心中建立起“可靠、克制、有边界感”的形象——在当前AI普遍“话多且敢说”的环境下,尤为珍贵。

五、产品与生态:低调但务实的落地路径

Anthropic的产品演进逻辑清晰:从基础能力到专业场景,从工具属性到协作者属性。每一次Claude的升级,都朝着“更可靠、更实用”迈进。

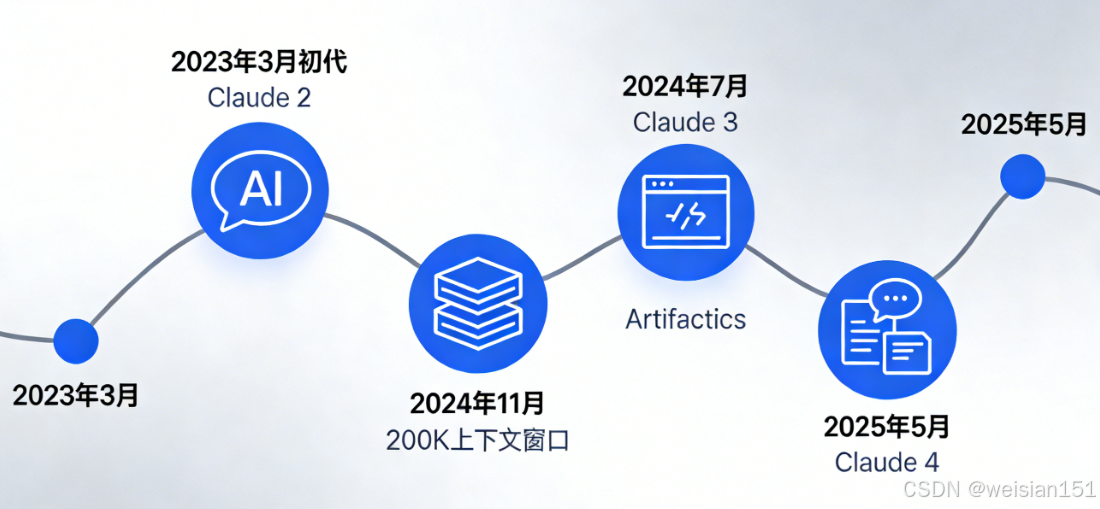

5.1 Claude关键版本演进时间线

- 2023年3月:初代Claude发布,展现“宪法AI”安全优势;

- 2023年7月:Claude 2上线,编程与数学推理能力显著增强;

- 2023年11月:Claude 2.1支持200K上下文,可处理整本书或长邮件;

- 2024年3月:Claude 3家族推出(Haiku/Sonnet/Opus),覆盖不同性能与成本需求;

- 2024年6月:Claude 3.5 Sonnet发布,速度提升2倍,成本降至1/5,新增“Artifacts”功能,支持实时编辑AI生成的代码与文档;

- 2025年5月:Claude 4系列问世,旗舰Opus 4可连续7小时专注开源项目重构,注意力跨度从分钟级跃升至小时级,成为真正的全天候协作者。

尤其在编程领域,Claude迅速崛起:2024年市场份额约25%,到2025年初已超52%,正式超越OpenAI成为开发者首选。原因在于它不仅能写函数,更能完成完整文件乃至项目级重构,并支持实时协作。

5.2 三大落地路径

-

面向个人用户

- 提供免费版(Claude Sonnet)与付费Pro版;

- 支持最高20万token上下文,适合处理复杂文档;

- 推出桌面端与移动端App,体验简洁优雅。

-

企业级API服务

- 聚焦金融、法律、医疗等高敏感行业;

- 承诺不使用客户数据训练模型,保障隐私;

- 已集成Slack、Notion、Figma等主流生产力工具。

-

开源与透明度建设

- 虽未完全开源模型,但公开大量技术报告与安全评估框架;

- 积极参与AI治理标准制定;

- 设立独立伦理委员会,定期审查模型风险。

六、商业布局:选对赛道,实现盈利逆袭

如果说技术是根基,那精准的商业战略就是Anthropic快速崛起的加速器。它与OpenAI走了截然不同的路,最终在财务表现上实现反超。

6.1 聚焦B端,放弃C端的“流量诱惑”

Anthropic明确聚焦企业客户与API服务:

- 80%收入来自企业,仅20%来自个人用户;

- 客户约30万,平均客户价值极高;

- 企业愿为安全性与可靠性支付溢价。

相比之下,OpenAI押注C端,虽有8亿周活用户,但付费转化率仅2.5%,单用户价值低,还需持续投入优化体验。

6.2 财务预测:2028年实现收支平衡,远超OpenAI

据《华尔街日报》披露的财务模型:

- Anthropic:2028年营收预计700亿美元,实现收支平衡;2023–2028年总现金消耗仅80亿美元,2027年烧钱率降至9%;

- OpenAI:2028年营收980亿美元,但运营亏损高达740–780亿美元,亏损率近75%;总现金消耗达1150亿美元,是Anthropic的14倍,预计2030年才能盈利。

更关键的是API市场份额逆转:2023年OpenAI占50%,到2025年中期,Anthropic以32%反超,OpenAI跌至30%以下,谷歌以20%紧随其后。API市场是AI商业化核心,这一变化意味着行业话语权正在转移。

6.3 生态合作:巨头加持,构建共赢体系

Anthropic巧妙借力巨头,构建强大生态:

- 2023年2月:获谷歌3亿美元投资,持股10%;

- 2024年3月:Claude 3 Sonnet上线亚马逊云科技Amazon Bedrock;

- 2025年9月:完成130亿美元F轮融资,估值达1830亿美元,投资方包括富达、光速创投及卡塔尔、新加坡主权基金;

- 2025年11月:与英伟达、微软达成数百亿美元合作——英伟达投入至多100亿美元,微软至多50亿美元,Anthropic承诺采购300亿美元Azure云计算容量。

这些合作不仅提供资金与算力,更加速其产品触达企业客户,推动商业化落地。

七、市场定位:在巨头夹缝中的差异化生存

在OpenAI、Google、Meta的包围下,Anthropic精准锚定自身生态位:

| 维度 | OpenAI (GPT) | Anthropic (Claude) | Google (Gemini) |

|---|---|---|---|

| 核心优势 | 创意能力、生态系统 | 安全性、可解释性 | 搜索整合、多模态 |

| 目标用户 | 开发者、创意工作者 | 企业、教育、敏感行业 | 大众用户、Google生态 |

| 安全优先级 | 中等 | 极高 | 中等偏高 |

| 透明度 | 较低 | 较高 | 中等 |

Anthropic聪明地选择深度合作而非全面竞争:

- 与AWS合作获取算力;

- 与Google Cloud拓展企业服务;

- 与学术界保持前沿联动。

八、争议与挑战:理想主义能走多远?

尽管备受赞誉,Anthropic仍面临多重质疑:

❓“安全”是否等于“保守”?

有批评指出,Claude过于谨慎,有时会拒绝回答合理问题(如涉及政治或社会议题),显得“政治正确过度”。

❓商业与使命能否共存?

接受亚马逊27.5亿美元投资后,Anthropic需面对股东压力。如何在盈利诉求与安全初心之间平衡,是长期考验。

❓“宪法AI”真的万能吗?

当前“宪法”仍由人类编写,而人类价值观本身存在分歧。谁来定义“正确”的宪法?这已触及更深的哲学命题。

对此,Anthropic的回答坦诚而谦逊:

“我们不知道所有答案,但我们愿意公开探索。”

九、未来展望:不拼“更聪明”,拼“更可靠”

Anthropic首席产品官Mike Krieger近期表示,公司未来将不再追求模型“更聪明”,而是聚焦:

- 更高的可靠性;

- 更自然的交互方式;

- 能稳定接管具体工作任务的AI协作者。

这一方向直击当前AI落地痛点:许多企业引入AI后,员工反而更累——因AI输出需大量人工修正。Anthropic的目标是实现“明确任务边界 → AI自主执行 → 主动反馈结果”的闭环协作。

从行业趋势看,AI正从“技术驱动”转向“商业驱动”,投资者愈发看重盈利能力。Anthropic的成功证明:企业应用比消费应用更容易产生可持续价值。未来,它将在金融风控、医疗数据分析、法律咨询等垂直领域深化布局,以安全可靠的AI服务构筑更深壁垒。

当然,挑战依然存在:监管压力随规模扩大而增加、性能与安全的平衡、同行竞争加剧……但至少目前,Anthropic已找对方向,并稳步前行。

十、为什么Anthropic值得我们关注?

在这个AI军备竞赛的时代,大多数公司都在比谁的模型更大、更快、更聪明。而Anthropic选择了一条更艰难的路:慢一点,稳一点,负责任一点。

它提醒我们:

- 技术进步不应以牺牲人类安全为代价;

- AI的终极目标不是取代人类,而是增强人类的判断与尊严;

- 在算法的世界里,伦理不是附加项,而是基础设施。

正如Anthropic官网首页所写:

“We believe AI should be steerable, interpretable, and aligned with human values.”

(我们相信,AI应当可控、可解释,并与人类价值观保持一致。)

这句话朴素,却重若千钧。

作为一名科技博主,我见过太多昙花一现的“下一个大事件”。但Anthropic让我感受到一种不同的气质:

它让我想起早期的互联网理想主义者——那些人相信技术可以改变世界,但前提是我们要负责任地建造它。

在人人追逐AI能力的军备竞赛中,Anthropic就像那个在实验室里耐心研究安全协议的科学家。他们可能不会第一个到达终点,但他们可能在确保所有人安全到达终点。

我最欣赏Anthropic的一点是:他们敢于提出困难的问题,而不是假装问题不存在。

十一、写在最后:我们每个人都是AI未来的共建者

Anthropic的故事,不只是关于一家公司,更是关于我们如何共同塑造AI的未来。

你可以:

- 在使用AI时,多问一句:“它这样回答,真的好吗?”

- 支持那些重视安全与透明的产品;

- 参与公共讨论,推动更健全的AI治理。

因为最终,AI不会自己选择方向——是我们,用每一次点击、每一次反馈、每一次发声,决定了它走向何方。

成功经验启示录(对从业者与创业者的三点思考):

- 差异化定位至关重要:在同质化竞争中,Anthropic以“安全优先”切入企业市场,避开与OpenAI在C端的正面交锋;

- 选对赛道比技术领先更关键:再先进的技术,若无合适商业化场景,也难以变现;

- 长期主义才能走得远:从早期打磨“宪法AI”,到持续优化可靠性,Anthropic围绕核心使命稳步推进,使其在行业波动中屹立不倒。

在这个AI快速发展的时代,Anthropic提醒我们一个根本问题:

当我们创造智能时,我们真正想要的是什么?

是无所不能的工具?还是能够理解我们、尊重我们、与我们共同成长的伙伴?

Anthropic选择了后一条路——一条更艰难、更漫长,但可能更重要的路。无论他们最终能否成功,这种对“人性化AI”的坚持,都值得我们的尊重与关注。

延伸阅读

- Anthropic 官网:https://www.anthropic.com

- 《宪法AI》技术白皮书(2022)

- Claude 3.5 性能评测报告(2024)

作者后记:

写这篇文章时,我用Claude帮我梳理了时间线,但它在涉及中国AI政策的部分主动标注:“信息可能不完整,建议查阅官方来源。”那一刻,我忽然理解了Anthropic坚持的意义——真正的智能,不仅在于知道什么,更在于知道自己不知道什么。

愿我们在AI时代,依然保有这份谦卑与清醒。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)