【大模型与信息抽取】Easy-to-Hard Learning for Information Extraction

本文提出了一种由易到难(E2H)的信息抽取统一学习框架,通过模拟人类学习过程将训练分为简单、困难和主要三个阶段。在简单阶段,模型学习基本技能;困难阶段通过组合样本构建更具挑战性的训练数据;主要阶段进行最终优化。实验在17个数据集上验证了该框架的有效性,在13个数据集上取得最优结果。E2H框架显著提升了NER、RE等任务的性能,特别是在低资源场景下表现突出。该工作为信息抽取任务提供了一种更符合认知规

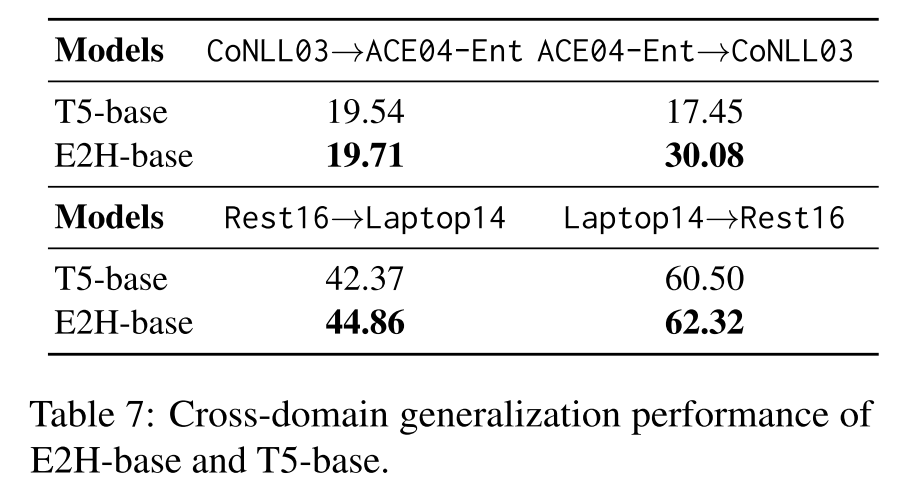

前言:尽管一个模型对各种IE任务进行通用建模已经取得了很大的成功,但他们采用的是一个阶段的学习策略,在给定输入文本的情况下,直接学习以提取目标结构,这与人类学习过程相矛盾。本文提出了一种由易到难的统一学习框架,即简单阶段、困难阶段和主要阶段,通过模仿人类的学习过程来实现。通过将学习过程分解为多个阶段,该框架有利于模型获取通用的IE任务知识,提高模型的泛化能力。在4个IE任务上的大量实验验证了所提框架的有效性。我们在17个数据集中的13个上获得了最新的最先进的结果。代码:Easy-to-Hard Learning for Information Extraction (ACL 2023 Findings) (github.com)

1.主要贡献

- 通过模拟人类学习过程,提出了一个由易到难(E2H)的IE任务统一学习框架;

- 提出了两种新的策略,在不使用任何额外资源的情况下构建了框架中的易阶段和难阶段;

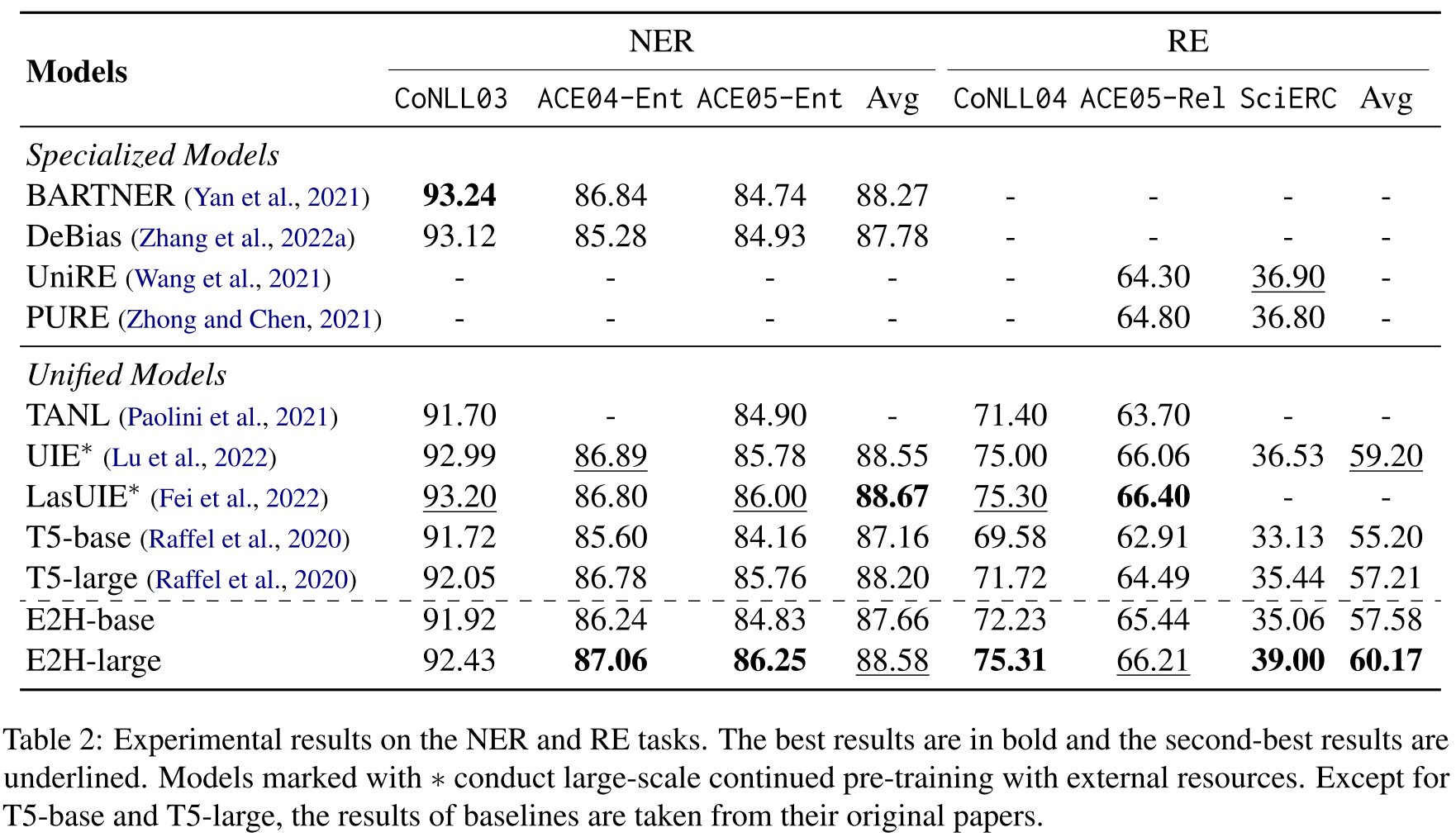

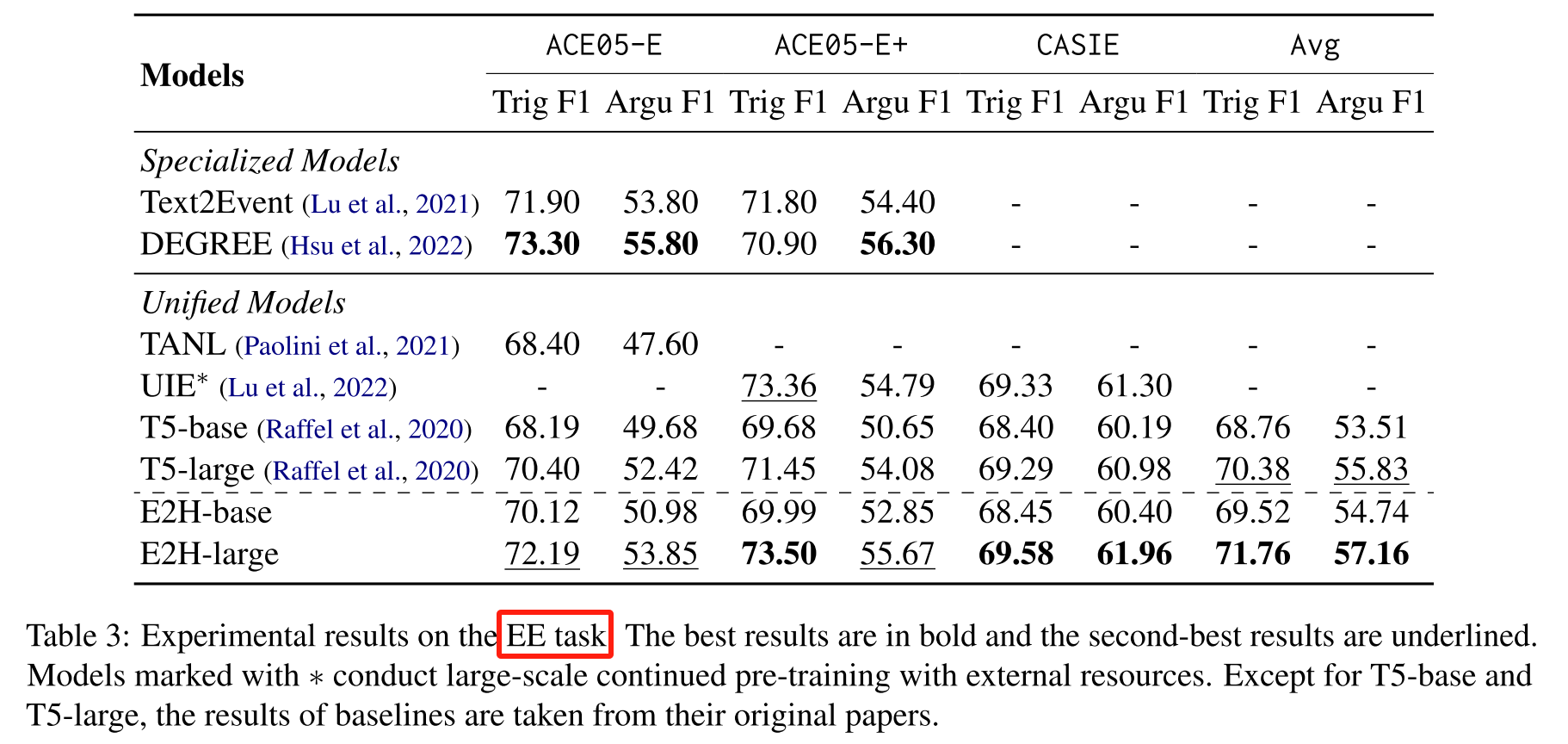

- 在17个数据集上对4个IE任务进行了综合评价,并在13个数据集上取得了最新的评价结果。值得注意的是,我们的E2H方法通过引入两个额外的学习阶段,在NER、RE、EE和ABSA任务上分别平均增加0.38、2.96、1.33和1.39个绝对点,始终优于单阶段学习。

2.方法

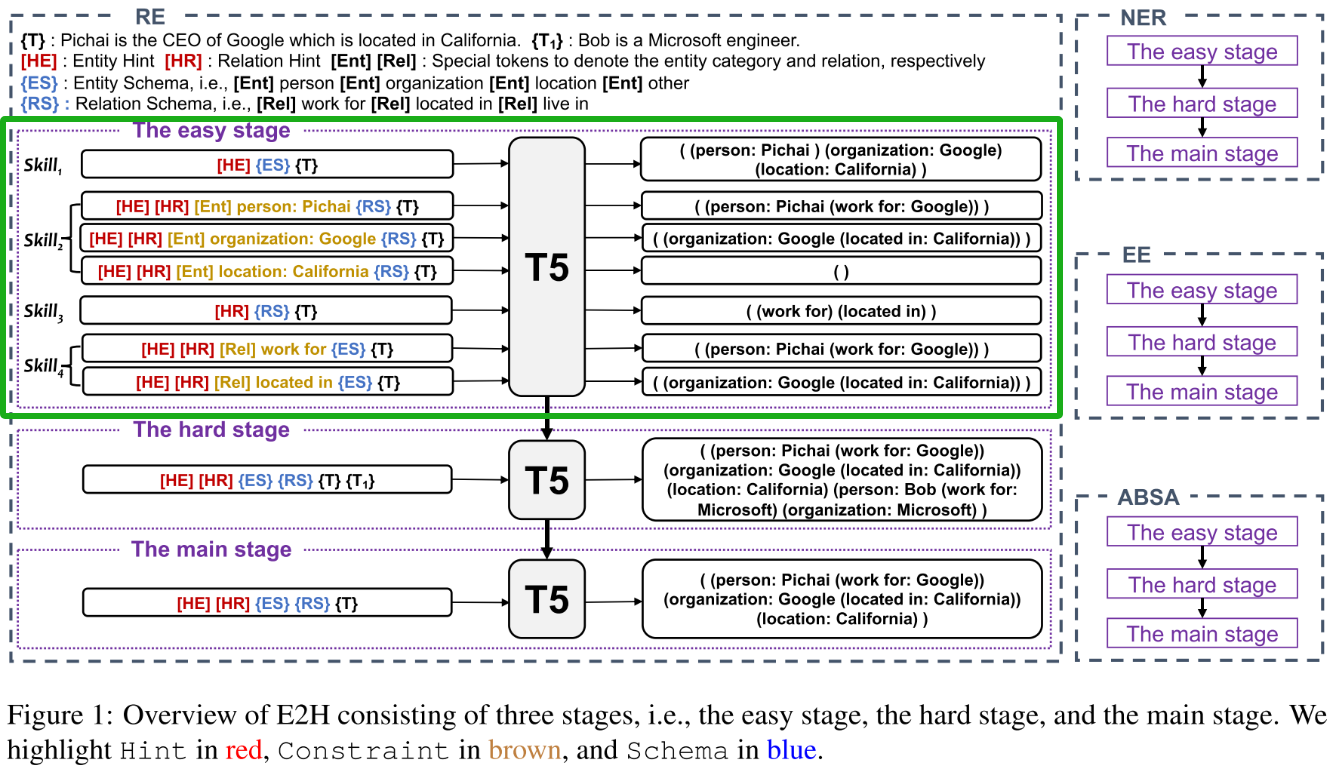

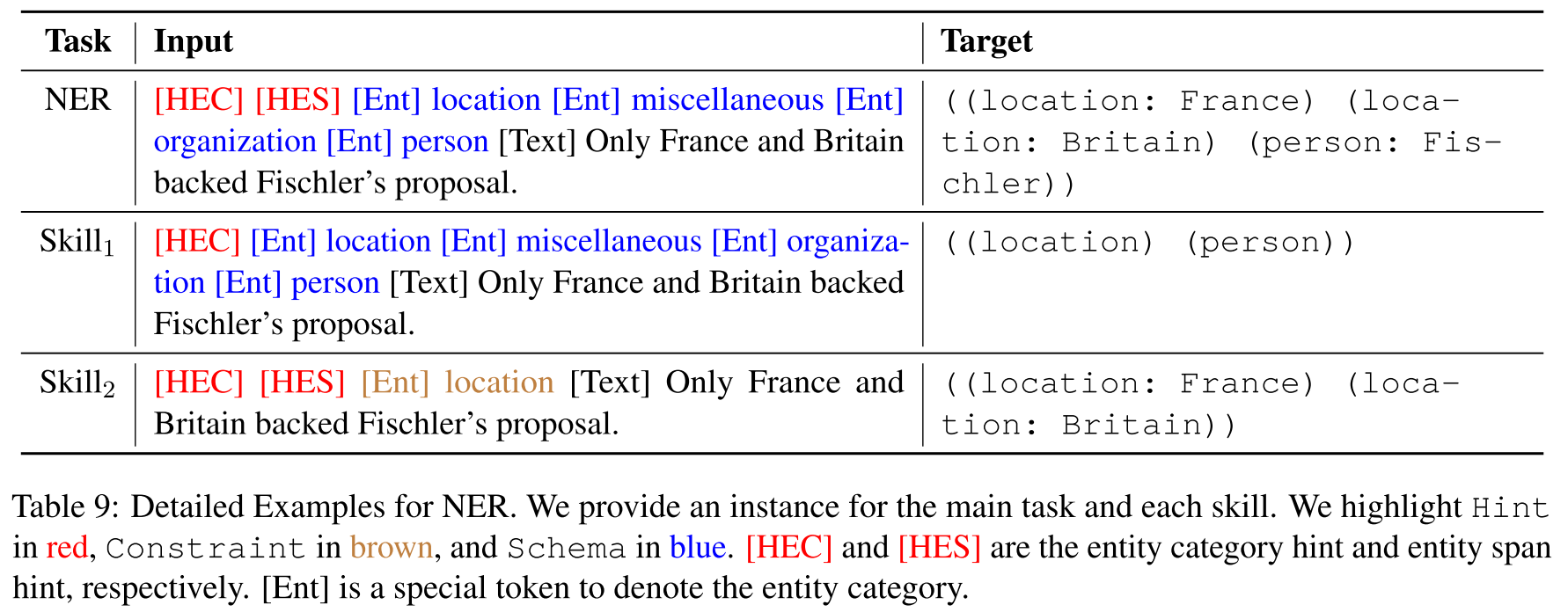

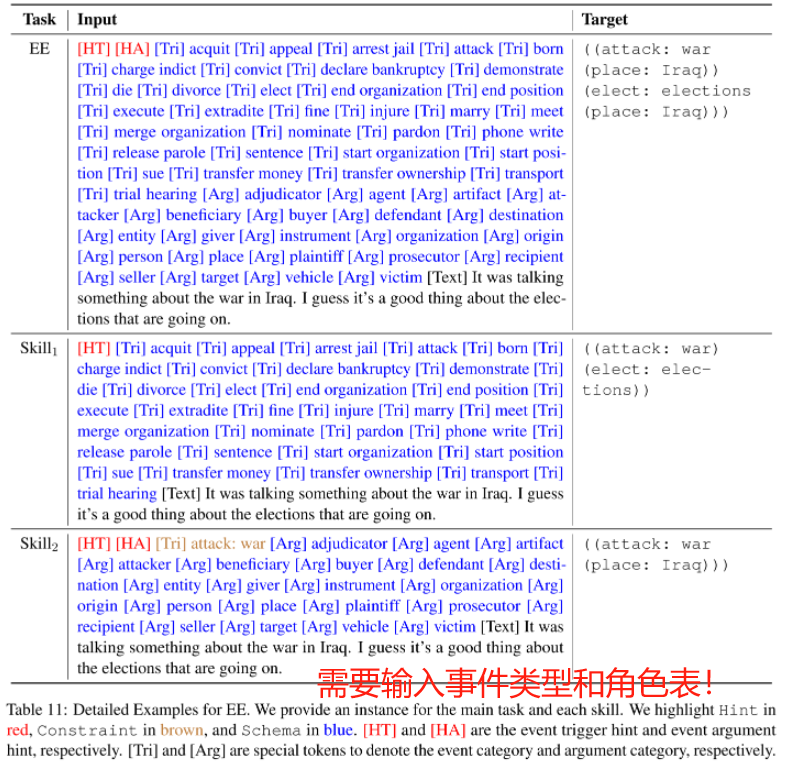

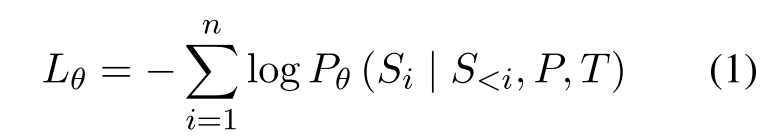

2.1 统一的文本到结构

类似于UIE,文中将NER,RE,EE和ABSA制定为文本到结构生成问题,这使能使用单个模型来处理多个任务。给定文本T及其对应的提示符P,目标是用编码器-解码器模型生成目标IE结构S。在三个学习阶段中,设计了包含三种类型信息的提示词P:Hint, Constraint, and Schema。Hint指导模型应该提取哪些元素,Constraint指示任务的特定约束,Schema提供必要的信息,例如提取的可能关系集。有了这三种类型的信息,提示词能够将不同阶段的学习过程连接起来。以RE任务为例,如下图所示:

- Hint:由实体提示和关系提示中的一个或两个组成。实体提示,由特殊标记[HE]表示,指导模型提取实体,关系提示,由特殊标记[HR]表示,指导模型提取关系。这两个提示的使用引导模型以(头实体、关系、尾实体)三元组的形式提取实体和关系信息。

- Constraint:是一个特定的实体或关系,它将目标结构限制为与该实体或关系相关。

- Schema:包含预定义的实体类别或关系或两者,这取决于需要提取的信息。它为识别文本中的实体和关系提供了必要的信息。

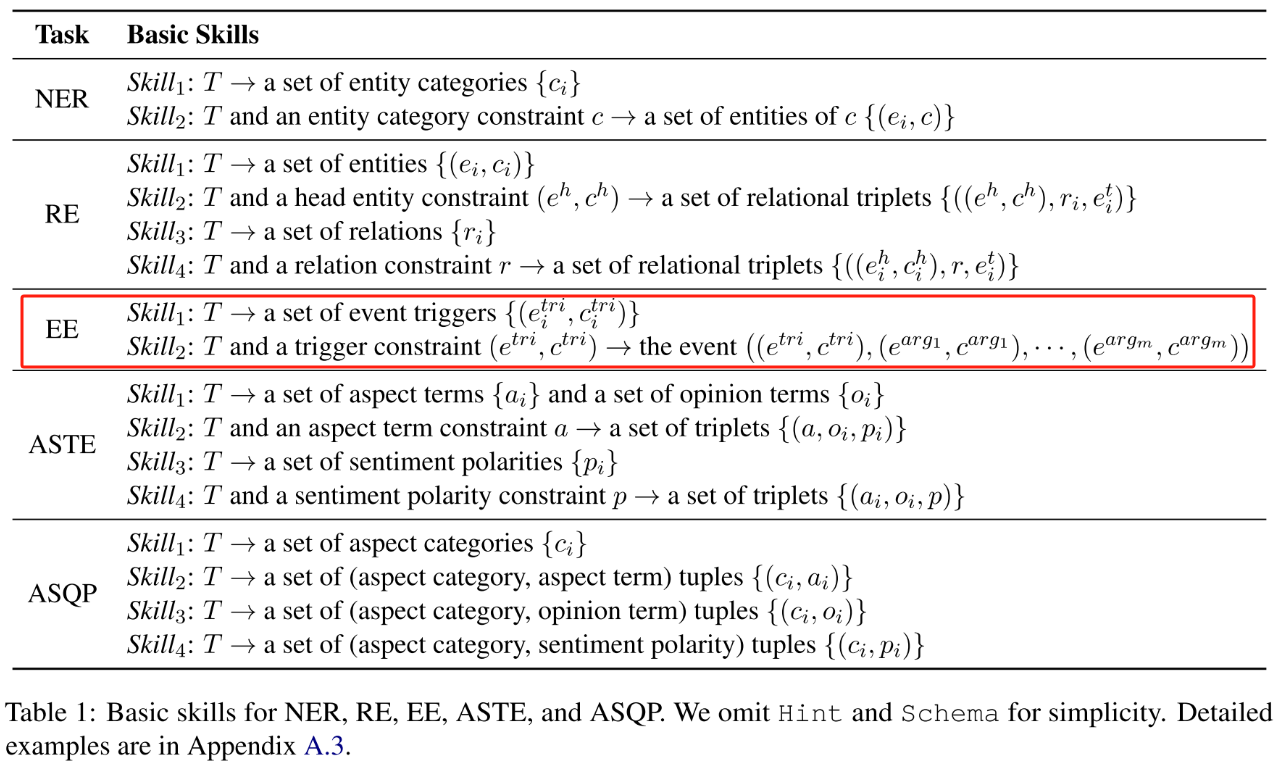

2.2 The Easy Stage

简单阶段的目标是使模型能够学习有助于处理主要任务的基本技能。为了实现这一目标,为每个任务识别几种技能,并根据主任务的数据自动构建训练数据。表1列出了NER、RE、EE、ASTE和ASQP的基本技能。根据每个技能的目标结构,将其设计成主任务的子任务。这些技能更基本,定义更明确。将这些技能结合起来,可以让模型对如何处理主要任务有一个全面的了解。例如,RE任务有四个技能。技能1和技能3帮助模型识别关系三元组的子结构,即,实体和关系,技能2和技能4帮助模型学习这些子结构之间的依赖关系。

2.3 The Hard Stage

困难阶段旨在构建比主任务的原始训练示例更难的训练示例来训练模型。直觉上,如果输入文本包含更多的结构元素和更复杂的上下文,则训练实例更难。为此,我们将原始任务的两个训练实例组合以构建更难的实例。模型必须处理和理解来自两个实例的组合信息,这使得模型正确提取目标结构更具挑战性。原始训练样本总量:N个;假设Hard中每个新训练样本包含原来样本:M个;则Hard-Stage的训练样本总量:M*N个。

2.4 The Main Stage

E2H主干网络:预训练好的T5。训练过程完成,我们使用在主阶段训练的模型为任何给定的提示和文本元组(P, T)生成目标结构S。虽然我们的训练过程有三个阶段,但推理是一个单阶段的过程。

3.实验结果

数据集:17个数据集上对4个IE任务进行了综合评价,并在13个数据集上取得了最新的评价结果。

指标:Micro-F1作为主要的评估指标。对于每个实验结果,报告了三个随机种子的平均性能。

Baselines:专用模型(特定IE任务)和统一模型(通用IE)。

E2H有两种模型大小:E2H-base和E2H-large(预训练的T5-base和T5-large模型初始化)。

[ps] 最大输入长度设置为384,将最大目标长度设置为256。三阶段的epochs设置为[15,30,30]或[25,50,50]。根据模型在开发集上的性能选择参数。所有实验均在NVIDIA Tesla A100上进行。

3.1 主要结果

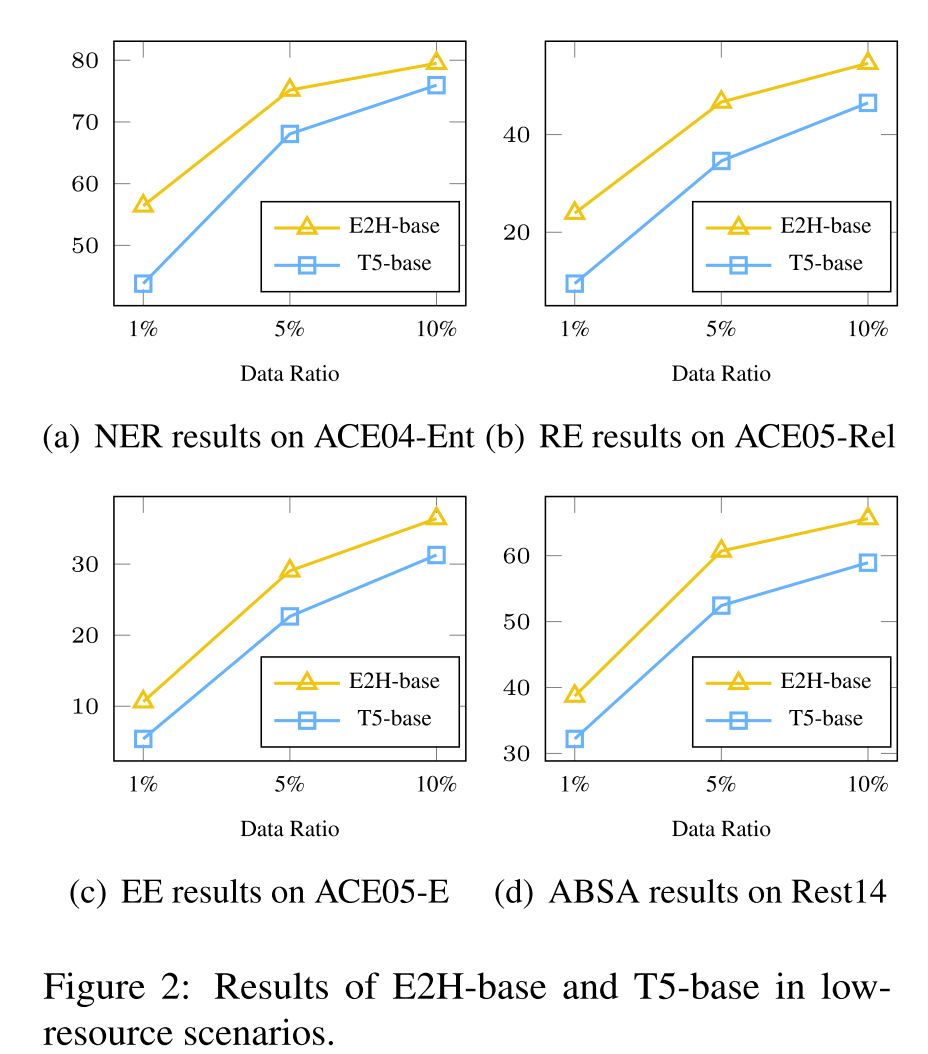

3.2 低资源下的结果

在数据稀缺的情况下,从简单到困难的学习框架的有效性。一方面,简单阶段有助于模型识别目标结构的子结构并捕获它们之间的依赖关系,这在数据有限时是困难的。另一方面,硬阶段提供了多样化和更硬的数据,以帮助模型处理任务的大范围变化,这在低源情景中尤为重要。

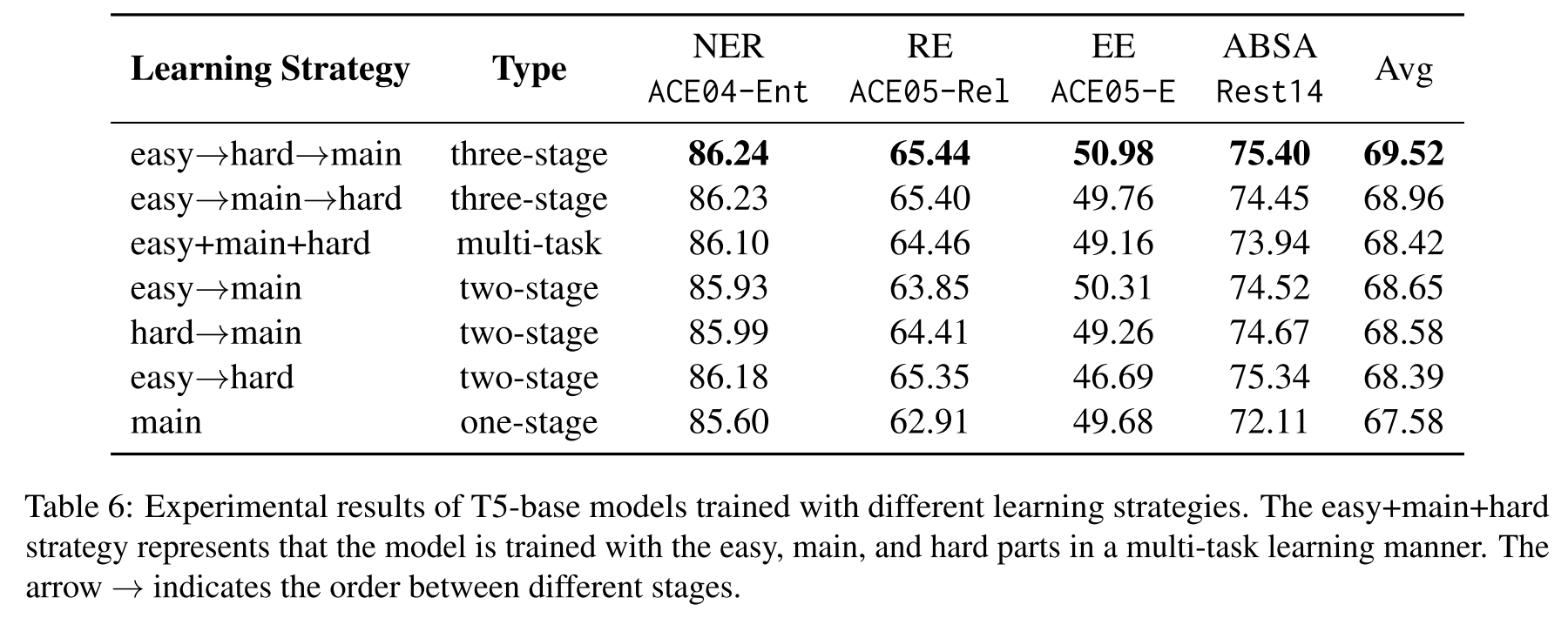

3.3 不同学习策略的分析

- 易→难→主策略是七种策略中效果最好的策略。它在所有数据集上的性能都优于其他策略。

- 从易到难的多阶段学习优于多任务学习(即,简单+主要+困难)。当使用训练数据的简单、主要和困难部分时,在所有数据集上,简单→困难→主要和简单→主要→困难策略均优于简单+主要+困难策略。这表明,从易到难的多阶段学习对模型的性能至关重要。

- 每个阶段都是我们E2H框架的关键,移除任何一级都将降低E2H的性能。

- 三阶段学习优于两阶段学习,三阶段学习优于一阶段学习。

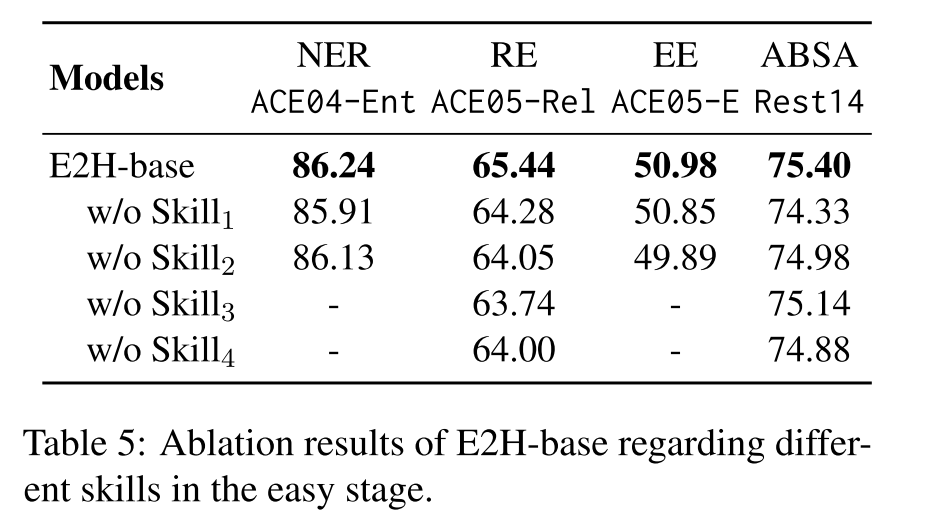

3.4 消融实验

4.总结

本文提出了一个由简单阶段、难阶段和主要阶段组成的工业工程易难学习框架。提出了两种新的策略来构建框架的容易部分和困难部分,以使学习过程能够实现。在满资源和低资源场景下的实验结果证明了该框架的有效性及其相对于一阶段学习方法的优越性。

【参考文献】

Gao, C., Zhang, W., Lam, W., & Bing, L. (2023). Easy-to-hard learning for information extraction. arXiv preprint arXiv:2305.09193.

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)