Android + AI 实战:零基础打造一款“端侧智能识图”App (基于 Google ML Kit)

在学习 Android 开发的过程中,我们往往专注于 UI 布局、Activity 生命周期和数据存储。但随着移动设备性能的飞跃,Android + AI 的技术融合已成为不可忽视的趋势。在Android新技术中,目前端侧大模型(On-device LLM)开始普及,图像识别、文本理解等能力正在全面增强。在Android开发上,我们不能仅仅满足于开发传统的“增删改查”应用。为了探索 Android

前言:移动端开发的“智能化”趋势

在学习 Android 开发的过程中,我们往往专注于 UI 布局、Activity 生命周期和数据存储。但随着移动设备性能的飞跃,Android + AI 的技术融合已成为不可忽视的趋势。在Android新技术中,目前 端侧大模型(On-device LLM) 开始普及,图像识别、文本理解等能力正在全面增强 。

在Android开发上,我们不能仅仅满足于开发传统的“增删改查”应用。为了探索 Android 在 AI 领域的应用,我基于 Google ML Kit 开发了一款“智能识图”Demo。它不需要联网,不依赖后端 API,完全利用手机本地算力即可识别图片内容。

本文将详细记录从环境配置到功能实现的全过程,并对核心代码进行分析。

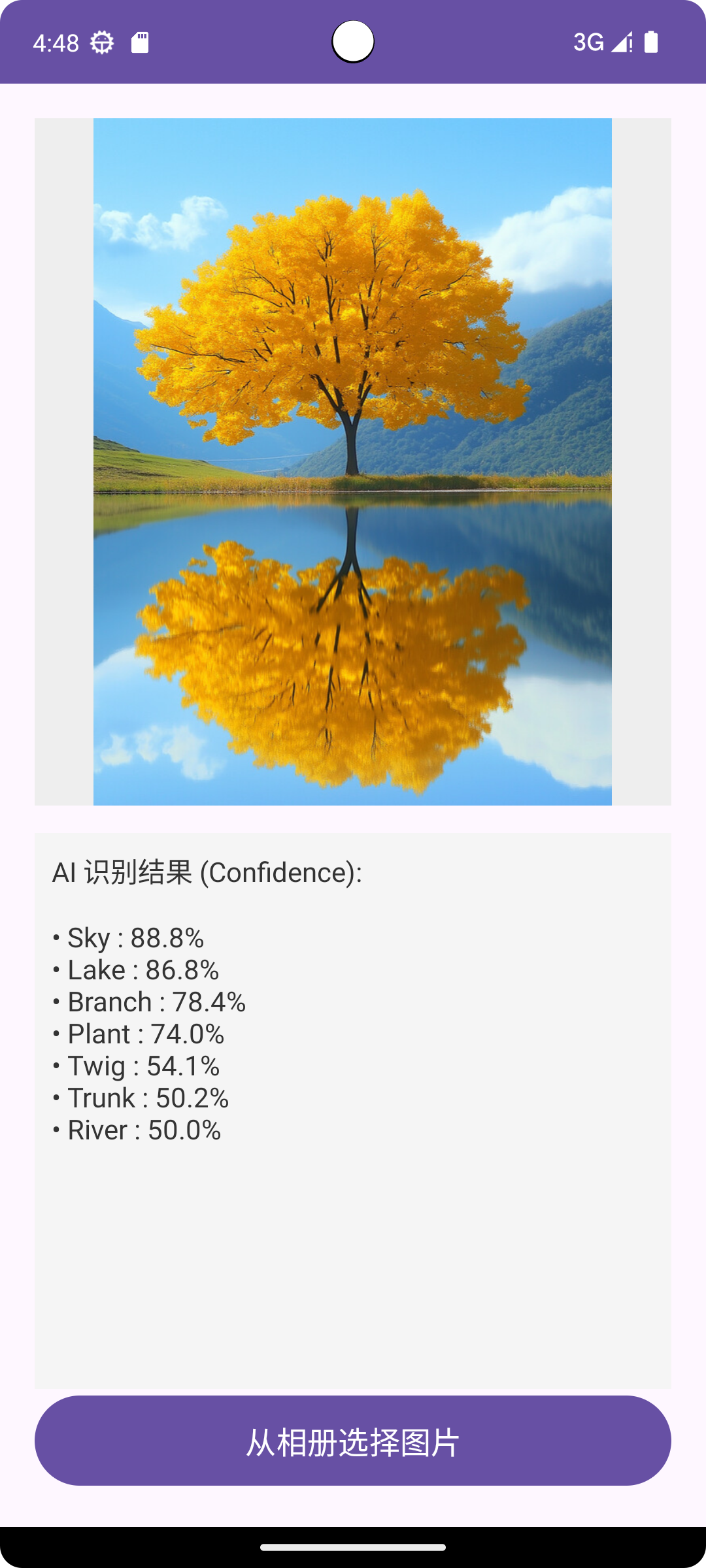

一、 效果展示

话不多说,先看效果。这是一个基于 Java 原生开发的 Android 应用,集成了 Google 的图像标签(Image Labeling)模型。

1. 初始界面与相册选择 界面简洁明了,使用 ConstraintLayout 构建,包含图片预览区和结果分析区。

2. 识别宠物(高置信度) 当我从相册选择一张猫的照片时,App 在毫秒级时间内识别出了 "Cat"、"Pet" 等标签,置信度极高。

3. 识别复杂场景 对于包含多个物体的复杂照片,AI 也能准确分析出主要元素。

二、 技术选型与架构分析

为了达成目标,我没有选择传统的训练模型方式(门槛高、体积大),而是选择了 Google ML Kit。

1.为什么选择 Google ML Kit?

在本项目中,我使用了 Google ML Kit 作为核心 AI 引擎。ML Kit 是 Google 专门为移动端开发者打造的机器学习 SDK,它将 Google 在机器学习领域的深厚积累封装成了易用的 API 。相较于传统的云端 AI API,ML Kit 的 端侧机器学习 (On-device Machine Learning) 具有显著优势,这也符合当前 Android 开发的一大技术趋势 :

-

低延迟 (Low Latency): 所有计算直接在手机 CPU/GPU/NPU 上运行,无需等待网络请求,识别结果毫秒级响应,用户体验极佳。

-

隐私安全 (Privacy First): 图片数据完全在本地处理,无需上传至云端服务器,彻底解决了用户隐私泄露的顾虑。

-

离线可用 (Offline): 即使在无网络环境下(如飞行模式、户外),应用依然能提供完整的智能识图功能。

本项目主要使用了 ML Kit 的 Vision API(视觉能力) 中的图像标签功能,它能够识别超过 400 种常见物体,并给出相应的置信度分析 。

-

核心技术: Google ML Kit (Image Labeling API)

-

开发语言: Java

-

图片加载: Glide 4.x

-

架构优势:

-

端侧运行 (On-device): 所有计算都在本地完成,无需上传图片到服务器,隐私安全性高且无延迟,符合当前 Android 开发对隐私保护的要求。

-

轻量级: 基础模型直接打包在 APK 中,开箱即用。

-

生命周期感知: 结合 Android 最新的

ActivityResultLauncher,抛弃了过时的startActivityForResult。

-

三、 核心代码实现

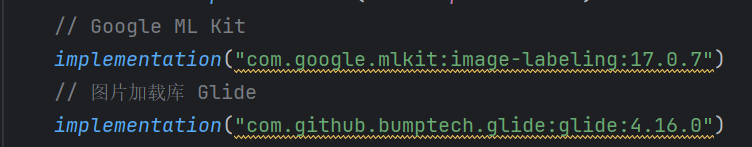

1. Gradle 配置

首先,在 build.gradle 中引入 ML Kit 的图像标签库。为了优化图片显示体验,我还引入了 Glide。

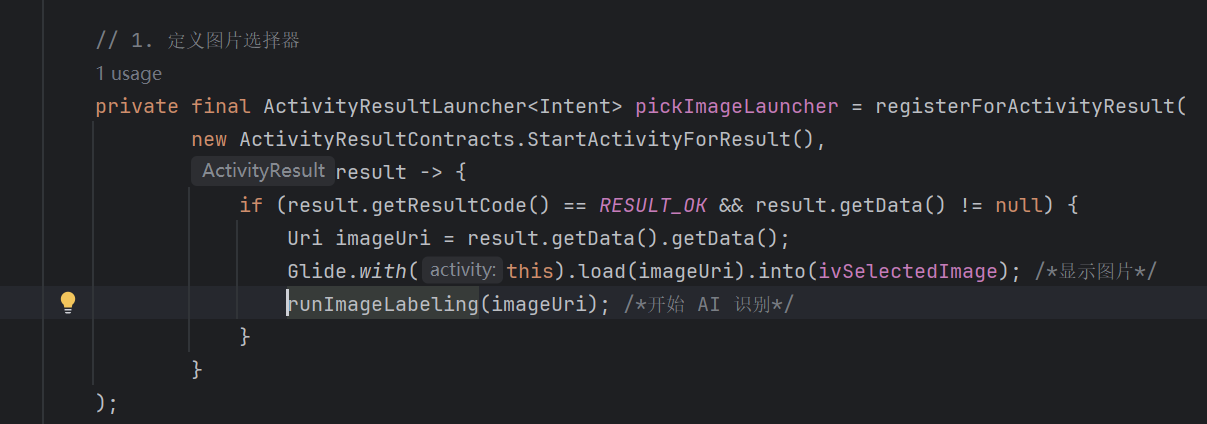

2. ActivityResultLauncher

在获取相册图片时,我注意到 startActivityForResult 已经被标记为过时(Deprecated)。为了紧跟技术潮流,我使用了 Android Jetpack 推荐的 Result API。

分析: 这种写法将回调逻辑与启动逻辑解耦,代码可读性更强,且类型更安全,是现代 Android 开发的标准写法。

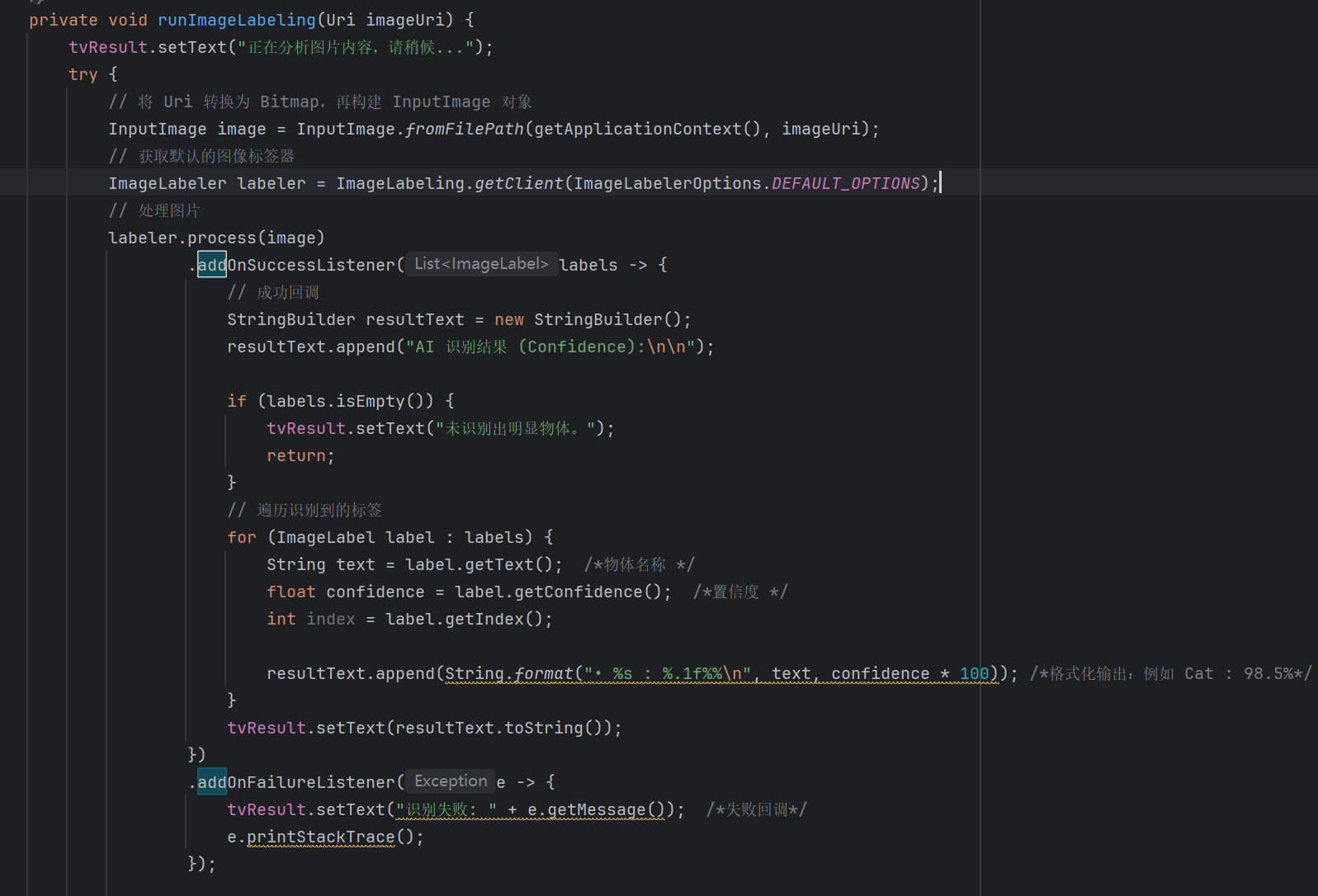

3. AI 识别核心逻辑

这是整个应用最核心的部分。ML Kit 的 process 方法是异步的,不会阻塞主线程(UI 线程)。

四、 遇到的问题与思考

在开发过程中,并非一帆风顺。我遇到了以下问题并进行了深入思考:

1. 图片压缩与性能问题

-

问题: 现在的手机照片动辄 10MB 以上,直接加载进内存容易导致 OOM (内存溢出)。

-

解决: 虽然

InputImage.fromFilePath内部对其进行了处理,但在 UI 显示层,我使用了 Glide。Glide 会自动根据ImageView的大小对 Bitmap 进行下采样(Downsampling),既保证了显示清晰度,又极大地降低了内存占用。

2. 识别结果本地化

-

思考: 目前 ML Kit 的基础模型返回的标签是英文的(如 "Cat", "Table")。

-

改进思路: 如果要投入实际商用,可以在本地维护一个 英文->中文 的映射字典,或者接入轻量级的翻译 API。考虑到这是一个 Demo,保留英文更能体现原始模型的识别能力。

五、 总结

通过本项目,我们成功实现了一个具备“视觉能力”的 Android 应用,这展示了移动开发领域的一个重要转变:从单纯的 UI 交互向智能化体验升级。

随着移动设备算力的不断增强,Android + AI 的深度融合已不再是未来的概念,而是当下的现实 。利用 ML Kit 这样的端侧工具,开发者无需深钻复杂的深度学习算法,就能将图像识别、文本理解等 AI 能力赋予应用 。这种端侧智能 (On-device AI) 模式,不仅降低了开发门槛,更在性能和隐私之间找到了完美的平衡点。作为开发者,掌握如何在 Android 项目中集成这些 AI 组件,将成为提升应用竞争力的关键技能

作者:龙祥

原文链接:Android + AI 实战:零基础打造一款“端侧智能识图”App (基于 Google ML Kit)-CSDN博客

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)