华为CANN算子:AI算力加速核心

华为CANN算子作为AI算力加速的核心技术,通过深度优化实现昇腾芯片的高效计算。文章系统介绍了CANN算子的概念、核心价值(硬件适配性、计算高效性)及技术架构(分层设计、动态编译等),重点分析其性能优化技术(算子融合、内存复用)和典型应用场景(CV/NLP任务)。通过MindSpore框架下的矩阵乘法示例,展示内置算子的使用流程,并说明自定义算子的开发方法。CANN算子既提供开箱即用的高性能内置算

在AI芯片算力竞争日趋激烈的当下,算子作为连接上层AI模型与底层硬件的核心桥梁,其性能直接决定了AI任务的运行效率。华为推出的CANN(Compute Architecture for Neural Networks)异构计算架构,通过对算子的深度优化,实现了AI算力的高效释放。本文将从CANN算子的基本概念出发,剖析其核心价值,结合代码示例、架构表格及功能图示,带大家全面认识CANN算子。

华为CANN算子:AI算力加速核心技术文章大纲

引言

- AI算力加速的背景与重要性

- 华为CANN(Compute Architecture for Neural Networks)的定位与作用

- 算子作为CANN核心组件的关键性

CANN算子的基本概念

- 算子的定义与功能

- 在AI计算图中的角色(如卷积、池化、矩阵运算等)

- 与传统计算库的区别与优势

CANN算子的技术架构

- 分层设计:底层硬件适配层、中间计算优化层、高层接口层

- 与昇腾AI处理器的协同(如达芬奇架构的指令集适配)

- 动态编译与静态编译的结合

性能优化关键技术

- 自动算子融合(减少内存访问开销)

- 内存复用与流水线并行技术

- 针对特定硬件(如NPU)的指令级优化

典型应用场景与案例

- 在CV(计算机视觉)任务中的高效卷积实现

- NLP(自然语言处理)中的矩阵乘优化

- 与主流框架(TensorFlow/PyTorch)的对接实践

开发者工具与生态支持

- AscendCL(CANN对外接口库)的使用示例

- 算子开发工具链(如算子原型定义、TBE算子开发)

- 社区资源与开源支持

未来发展方向

- 面向大模型的稀疏化算子优化

- 跨平台异构计算支持

- 与AI编译器的深度协同(如MindSpore图算融合)

结语

- CANN算子在AI基础设施中的长期价值

- 对开发者与行业的影响展望

一、什么是CANN算子?

CANN算子是基于华为CANN架构开发的、用于完成特定AI计算任务的基本操作单元,例如矩阵乘法、卷积运算、激活函数计算等。这些算子经过华为针对昇腾系列AI芯片的深度优化,能够充分适配硬件的架构特性(如达芬奇架构的计算单元、存储层次等),相比通用算子实现了更高的计算效率和更低的延迟。

从软件栈层级来看,CANN算子处于CANN架构的“算子层”,上承AI框架(如TensorFlow、PyTorch),下接硬件驱动层,承担着将高层模型的抽象计算指令转换为硬件可执行的具体操作的关键作用。

二、CANN算子的核心价值:为何要使用它?

相比传统的通用算子或框架原生算子,CANN算子的核心优势体现在“硬件适配性”和“计算高效性”上,具体可总结为以下三点:

-

极致硬件利用率:针对昇腾芯片的达芬奇架构进行定制化优化,充分调用向量计算单元、标量计算单元等硬件资源,减少计算资源闲置。

-

低延迟高吞吐:通过算子融合、数据预取、内存优化等技术,降低数据在存储层次间的迁移开销,提升任务的吞吐量并减少延迟。

-

完善的生态支持:提供丰富的内置算子库(覆盖计算机视觉、自然语言处理等领域),同时支持自定义算子开发,满足多样化业务需求。

三、CANN算子的分类与架构

3.1 算子分类

根据功能和开发方式,CANN算子主要分为以下两类:

|

分类 |

特点 |

适用场景 |

代表算子 |

|---|---|---|---|

|

内置算子 |

华为官方优化,性能优异,开箱即用 |

常规AI计算任务,无需自定义开发 |

Conv2d(卷积)、MatMul(矩阵乘法)、Relu(激活函数) |

|

自定义算子 |

用户根据业务需求开发,灵活性高 |

特殊计算逻辑、自研算法的实现 |

自定义特征融合算子、专属损失函数算子 |

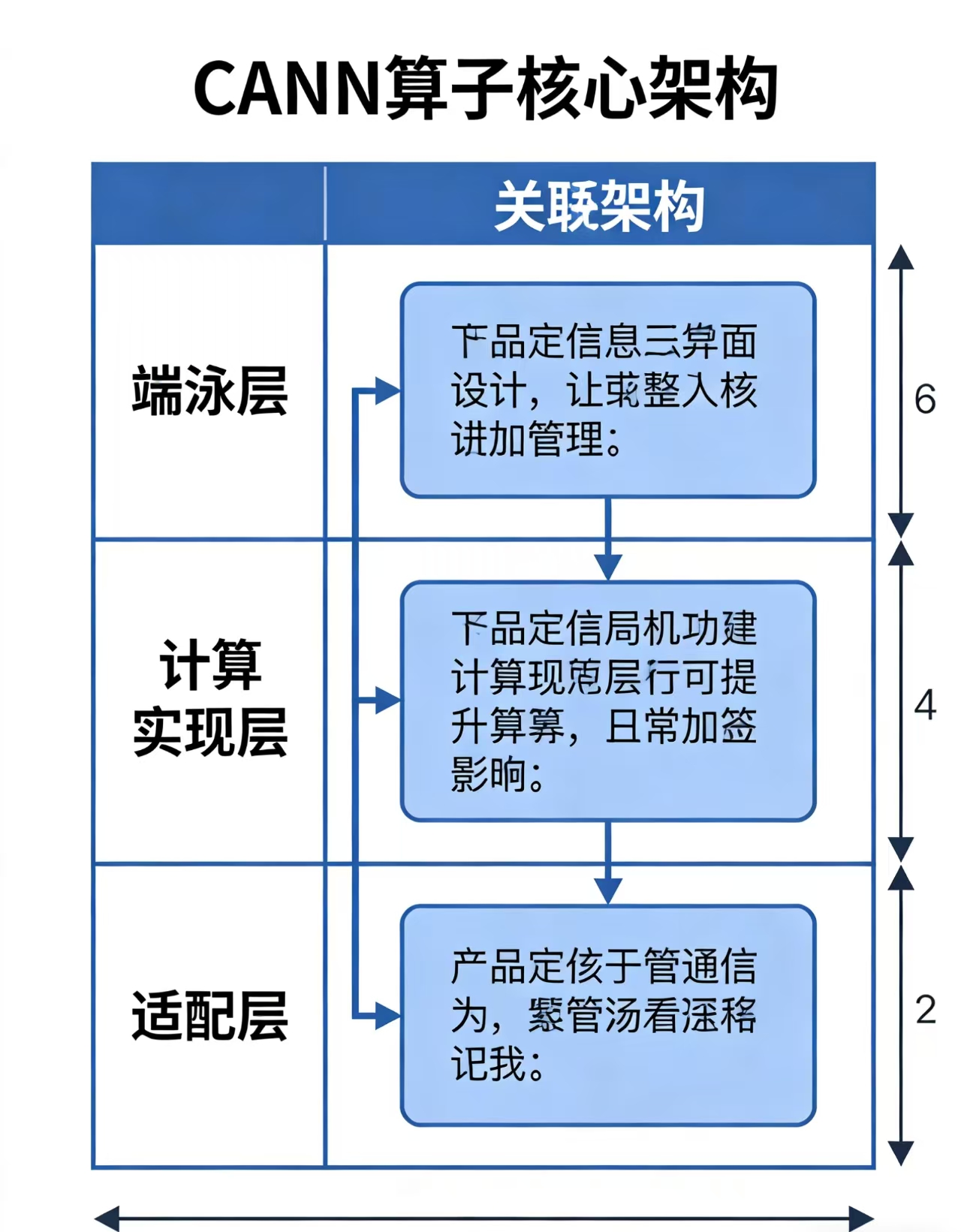

3.2 算子核心架构

一个完整的CANN算子通常包含“描述层”“计算实现层”和“适配层”三个部分,其架构逻辑如下:

-

描述层:定义算子的输入输出数据类型、形状、属性等信息,是算子与上层框架交互的“接口说明”。

-

计算实现层:核心计算逻辑的实现,可通过C、C++、汇编或华为提供的算子开发工具(如TIK)编写,是算子性能的关键。

-

适配层:完成算子与CANN架构的适配,包括内存管理、硬件资源调度等,确保算子能在昇腾芯片上稳定运行。

四、实践:CANN内置算子的使用示例

下面将以昇腾AI处理器为硬件环境,结合MindSpore框架(已适配CANN架构),演示CANN内置算子的使用流程。示例将使用MatMul(矩阵乘法)算子完成简单的矩阵运算。

4.1 环境准备

首先确保环境已满足以下条件:

-

昇腾AI处理器(如Atlas 200I DK A2)

-

CANN Toolkit 7.0及以上版本

-

MindSpore 2.0及以上版本(已关联CANN)

4.2 代码实现

import mindspore as ms

import mindspore.numpy as mnp

# 1. 初始化昇腾设备环境(指定使用昇腾芯片)

ms.set_context(device_target="Ascend")

# 2. 构造输入矩阵(符合CANN算子的数据格式要求)

# 矩阵A:2行3列,数据类型为float32

matrix_a = mnp.array([[1.0, 2.0, 3.0], [4.0, 5.0, 6.0]], dtype=ms.float32)

# 矩阵B:3行2列,数据类型为float32(与A的列数匹配)

matrix_b = mnp.array([[7.0, 8.0], [9.0, 10.0], [11.0, 12.0]], dtype=ms.float32)

# 3. 调用CANN内置MatMul算子进行矩阵乘法

# MindSpore的matmul接口已封装CANN优化后的算子

result = mnp.matmul(matrix_a, matrix_b)

# 4. 输出结果

print("矩阵A:")

print(matrix_a)

print("矩阵B:")

print(matrix_b)

print("矩阵乘法结果:")

print(result)4.3 运行结果与说明

代码运行后将输出以下结果:

关键说明:

1. ms.set_context(device_target="Ascend") 用于指定计算设备为昇腾芯片,此时MindSpore会自动调用CANN算子库,而非CPU或GPU算子。

2. 输入数据的类型和形状需符合CANN算子的要求(如MatMul算子要求输入为二维矩阵,且前一个矩阵的列数等于后一个矩阵的行数),否则会触发类型或形状校验错误。

3. 此处调用的mnp.matmul看似是MindSpore的接口,实则其底层已关联CANN优化后的MatMul算子,无需用户直接操作CANN底层接口,降低了使用门槛。

五、自定义CANN算子:当内置算子不够用时

-

定义算子接口:通过Protobuf文件定义算子的输入输出、属性等信息。

-

编译与部署:通过CANN提供的算子编译工具(如算子编译器)将自定义算子编译为适配昇腾芯片的二进制文件,然后注册到CANN算子库中。

自定义算子的开发需要具备一定的硬件架构知识和编程能力,华为官方提供了《CANN算子开发指南》和大量示例代码,帮助开发者快速上手。

CANN算子作为昇腾AI生态的核心组成部分,通过硬件级的深度优化,为AI任务提供了高效的计算支撑。对于开发者而言,内置算子可满足绝大多数常规需求,开箱即用且性能优异;而自定义算子则为特殊业务场景提供了灵活的扩展能力。

如果大家在CANN算子使用过程中有疑问,欢迎在评论区留言交流!

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。

报名链接:https://www.hiascend.com/developer/activities/cann20252

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)