从零构建大模型智能体:理解 Agent 的本质

引言

从本章开始,我们将踏上 从零实现基于大语言模型的智能体(Agent) 的学习之旅。大模型能力在飞速发展,但真正能驾驭智能体的人依然很少。

市面上的 AI Agent 框架琳琅满目,功能越来越花哨:CoT 推理、ReAct 工具调用、ReWOO 外显规划、Plan & Execute 任务拆解、Reflection 自我修正、RAG 检索增强、MCP 工具协议、A2A 多智能体协作……

每种方法听起来都很强大,但如果你不亲自实现一遍,你永远不会真正理解它们为什么有效,也无法发现潜在缺陷。框架可以替你跑,但框架无法替你理解。而理解,是构建不崩溃、可控、可解释、可扩展智能体系统的唯一途径。

本章目标非常清晰:理解智能体的本质,并明确为什么必须从零实现一套底层逻辑。我们不会直接使用现成框架,而是从最基础的机制拆解,让你掌握 Agent 的核心原理。

Agent 的本质

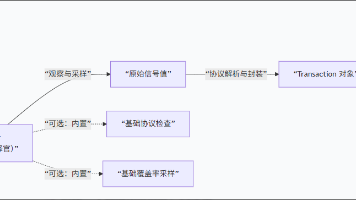

一个现代智能体至少包含四个核心能力:

-

推理链(Reasoning)

- 模型如何从输入信息生成可解释的决策步骤

- CoT、Self-Consistency、Tree-of-Thought 等模式的底层原理

-

工具调用(Tooling)

- Agent 能够与外部系统交互,而不仅仅是生成文本

- ReAct、ReWOO、Plan & Execute 的工具接口设计

-

记忆(Memory)

- 短期上下文管理与长期记忆存储

- RAG 检索增强、MemoryManager 的作用

-

规划(Planning)

- 将复杂任务拆解成子任务并协调执行

- Plan-and-Execute、MCP、多 Agent 协作的核心逻辑

这四者相互作用,共同决定了智能体的能力和稳定性。

现成框架的问题与局限

市面上常用的框架,如 LangChain、AutoGPT,虽然降低了入门门槛,从学习角度涞水,存在几个问题:

- 黑箱设计:推理链和工具调用逻辑被封装,难以理解每一步生成原因

- 可控性低:遇到任务失败或工具调用错误时,缺乏灵活干预手段

- 扩展性受限:框架内置模式固定,难以组合新的推理或工具调用策略

- 调试困难:框架崩溃时,开发者无法快速定位问题

这些问题说明,如果你想真正驾驭智能体,必须掌握底层实现。

为什么必须掌握底层实现

从零实现智能体的价值在于:

- 理解交互逻辑:不同 Agent 模式之间如何组合、互补

- 发现弱点:知道模型可能出错的场景,并设计防护机制

- 自由定制:根据业务需求改写 Agent 架构,而不受框架限制

- 调试能力:能够 debug 智能体,而不仅仅祈祷它别崩

当你亲手实现每一个模式时,会产生一种“黑箱变白箱”的认知体验:你知道每一步为什么生成、如何操作、如何修正。

Prompt 工程 ≠ Agent 工程

很多人认为,只要提示词写得好,就能构建智能体。但实际上:

- Prompt 只解决输入输出的局部逻辑

- Agent 的核心是循环、状态、工具、记忆和规划

- 仅靠 prompt 很难实现多轮推理、动态工具调用或复杂任务拆解

因此,Agent 工程比 Prompt 工程更复杂,但理解它是构建可控智能体的关键。

教程整体目标与最终效果

本教程最终目标:

- 从零实现完整智能体体系:推理、工具、记忆、规划、协作

- 掌握核心 Agent 模式:CoT、ReAct、ReWOO、Plan & Execute、Reflection、RAG、MCP、A2A

- 提升工程能力:可控、高效、可解释、可扩展的智能体系统

- 理论到实践闭环:每章都有可运行示例,让你学完即可动手

做过的人都知道:当你第一次亲手搭出能自主思考、规划、调用工具、总结反馈的 Agent,那种掌控感远超过任何现成框架。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)