通往 AGI 的关键钥匙:深入解析“世界模型” (World Models)

如果说大语言模型是“读万卷书”的才子,那么世界模型就是试图“行万里路”的探险家。在技术层面,世界模型通常包含一个能够预测未来的神经网络。给定当前的状态 (sts_tst) 和一个动作 (ata_tat),它能够预测下一个状态 (st1s_{t+1}st1Pst1∣statPst1∣stat这意味着 AI 不再仅仅是被动地识别图像或生成文本,而是理解了因果关系和物理定律(如重力、碰撞、惯

通往 AGI 的关键钥匙:深入解析“世界模型” (World Models)

在人工智能的浪潮中,我们见证了 ChatGPT 等大语言模型(LLM)展现出的惊人语言能力。然而,图灵奖得主 Yann LeCun 曾多次犀利地指出:“LLM 对物理现实一无所知。”

他所强调的下一代 AI 的核心,正是今天我们要探讨的主角——世界模型(World Models)。

从 OpenAI 的 Sora 横空出世,到自动驾驶的最新进展,“世界模型”这个概念正在从学术界的象牙塔走向 AI 变革的最前沿。它究竟是什么?它的前世今生如何?又为何被视为实现通用人工智能(AGI)的必经之路?

什么是“世界模型”?

如果说大语言模型是“读万卷书”的才子,那么世界模型就是试图“行万里路”的探险家。

1. 核心概念:大脑中的模拟器

通俗地讲,世界模型是 AI 系统对物理世界运作规律的内部映射。

想象一下你在开车。当你转动方向盘时,你不需要真的撞上护栏才知道结果,你的大脑已经在瞬间预演了后果:“如果我向右猛打方向,车会撞墙。”这种在脑海中推演未来、模拟后果的能力,就是人类拥有的“世界模型”。

2. 技术定义

在技术层面,世界模型通常包含一个能够预测未来的神经网络。给定当前的状态 ( s t s_t st) 和一个动作 ( a t a_t at),它能够预测下一个状态 ( s t + 1 s_{t+1} st+1):

P ( s t + 1 ∣ s t , a t ) P(s_{t+1} | s_t, a_t) P(st+1∣st,at)

这意味着 AI 不再仅仅是被动地识别图像或生成文本,而是理解了因果关系和物理定律(如重力、碰撞、惯性)。

历史溯源:从心理学到深度学习

世界模型并非一夜之间诞生的新词,它的演变跨越了半个多世纪。

1. 哲学与心理学的萌芽 (1943)

早在 1943 年,苏格兰心理学家 Kenneth Craik 在其著作《解释的本质》(The Nature of Explanation) 中就提出了这一假说:生物体在头脑中携带了一个“外部现实的小型模型”,利用它来测试各种选择,从而做出更佳的反应。这是世界模型概念的雏形。

2. 控制理论与 MPC

在机器人控制领域,模型预测控制 (Model Predictive Control, MPC) 一直是核心思想。机器人需要通过数学方程(模型)来预测机械臂的运动轨迹,以实现精准抓取。

3. 深度学习时代的里程碑 (2018)

这是世界模型真正进入 AI 核心视野的关键时刻。

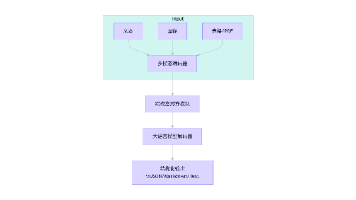

David Ha 和 Jürgen Schmidhuber 发表了名为 《World Models》 的著名论文。他们设计了一个由三个部分组成的架构:

- 视觉模块 (VAE): 把看到的画面压缩成小代码。

- 记忆模块 (RNN): 也就是世界模型本体,预测下一帧画面。

- 控制器 (Controller): 根据预测来做决定。

![**[Image suggestion: David Ha 论文中的 VAE+RNN+Controller 架构图]**](https://i-blog.csdnimg.cn/direct/e754bb0af33748518587218bb7a4d013.png)

这个实验展示了一个惊人的结果:AI 可以在自己的“梦境”(模拟环境)中训练打游戏,然后直接应用到现实中并取得高分。

4. Yann LeCun 的 JEPA 架构

近年来,Meta 首席科学家 Yann LeCun 极力推崇世界模型。他提出了 JEPA (Joint Embedding Predictive Architecture),认为 AI 不应生成每一个像素(像 Sora 那样),而应在抽象特征空间中预测世界的变化。他认为这是机器具备“常识”的前提。

世界模型有什么作用?

为什么我们需要费尽周折去建立一个世界模型,而不是直接通过海量数据训练一个“反应机器”?

1. “做梦”与低成本试错 (Simulation)

在现实世界中训练机器人是昂贵且危险的(例如,不能让自动驾驶汽车通过真的撞人来学习刹车)。

拥有世界模型的 AI 可以像奇异博士在《复仇者联盟》中那样,在几秒钟内于内部模型中推演数百万种可能性(“做梦”),找到最优解后再去执行。这极大地提高了样本效率。

2. 具备推理与规划能力 (Reasoning & Planning)

ChatGPT 本质上是概率性的“文本接龙”,它并不真正理解逻辑。而世界模型允许 AI 进行反事实推理(Counterfactual Reasoning):“如果我不这样做,会发生什么?”这是真正的智能体进行长期规划的基础。

3. 理解物理世界 (Physical Understanding)

OpenAI 的 Sora 之所以被称为“世界模拟器”,是因为它生成的视频不仅仅是像素的堆砌,它“懂”物理。

- 比如:一个人咬了一口饼干,饼干上会留下咬痕(因果性)。

- 比如:摄像机移动,物体被遮挡后重新出现,形状依然保持不变(物体恒常性)。

比较:大语言模型 (LLM) vs. 世界模型

| 特性 | 大语言模型 (LLM) | 世界模型 (World Models) |

|---|---|---|

| 核心任务 | 预测下一个 Token (文字/代码) | 预测下一个 State (世界的状态) |

| 训练数据 | 互联网文本 | 视频、传感器数据、交互记录 |

| 掌握的知识 | 语义、语法、百科知识 | 物理定律、空间几何、因果关系 |

| 弱点 | 容易产生“幻觉”,不懂物理常识 | 构建难度大,计算成本极高 |

| 代表作 | GPT-4, Claude | Sora, Wayve (自动驾驶), JEPA |

结语:通往 AGI 的最后一块拼图

世界模型代表了 AI 从“感性”(识别与生成)向“理性”(理解与规划)的跨越。

目前的生成式视频模型(如 Sora)证明了通过海量视频数据,AI 可以涌现出初步的世界模型能力。但距离完美的物理模拟——比如精准处理液体的流动、复杂的机械交互——还有很长的路要走。

未来,当大语言模型的逻辑能力与世界模型的物理感知能力完美结合时,我们或许就将迎来真正的通用人工智能(AGI)。那是 AI 既能写诗,又能像人类一样在这个复杂的物理世界中自如行走的那一天。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)