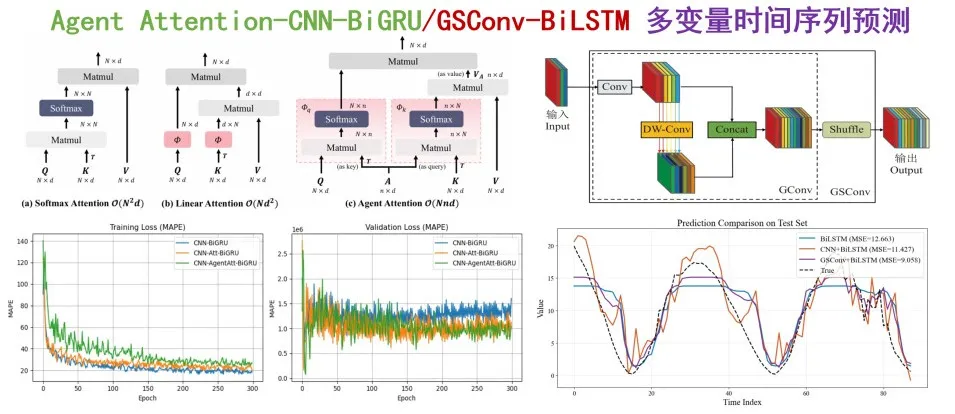

【原创代码分享】Agent Attention-CNN-BiGRU/GSConv-BiLSTM 多变量时间序列预测

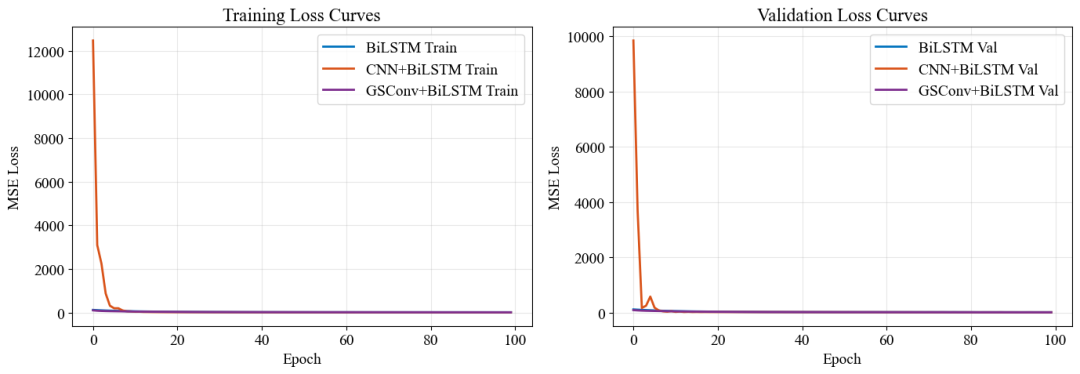

本文提出两种创新的多变量时间序列预测模型:1) CNN-AgentAttention-BiGRU模型,创新性地将机器视觉领域的AgentAttention机制(通过代理令牌降低计算复杂度)与BiGRU结合,实现高效的时间序列预测;2) GSConv-BiLSTM模型,首次将轻量级GSConv模块(融合标准卷积与深度可分离卷积)应用于时序数据特征提取,并与BiLSTM结合。两种模型均具有详细注释的P

程序名称:基于CNN-Agent Attention-BiGRU的多变量时间序列预测

实现平台:python—Jupyter Notebook

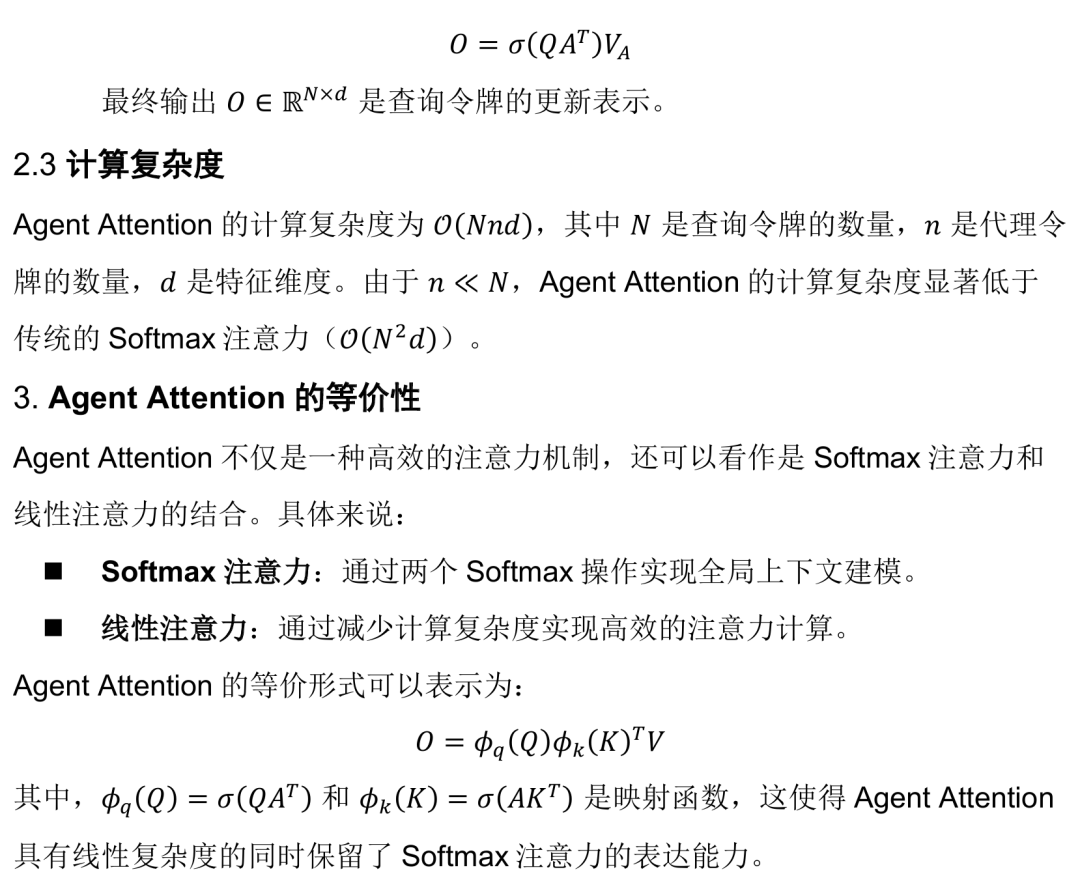

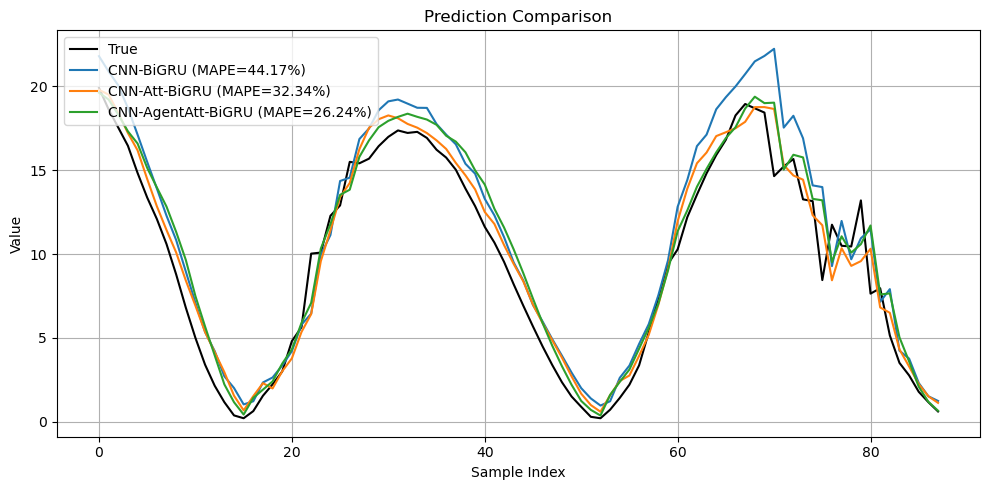

代码简介:构建了基于CNN(卷积神经网络)-Agent Attention(代理注意力机制)-BiGRU(双向门控循环单元)多变量时间序列预测模型。对比了CNN-BiGRU、CNN-Attention-BiGRU、CNN-Agent Attention-BiGRU的预测结果。高创新点,原创未发表,注释超详细,几乎每行一注释。限量。

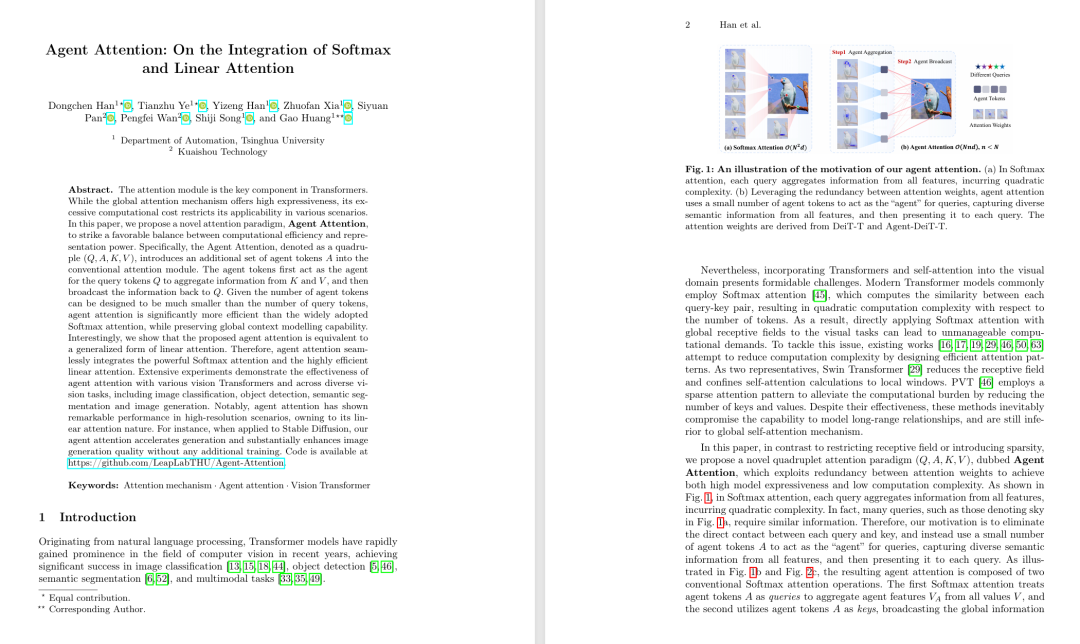

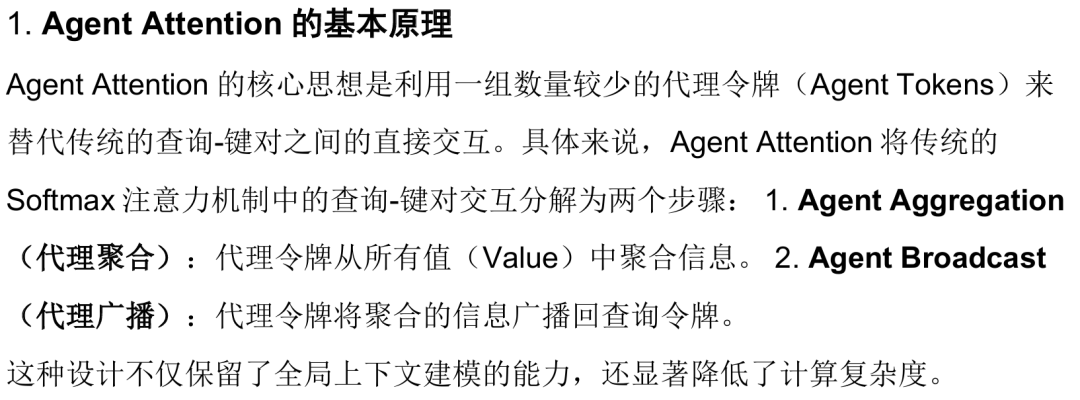

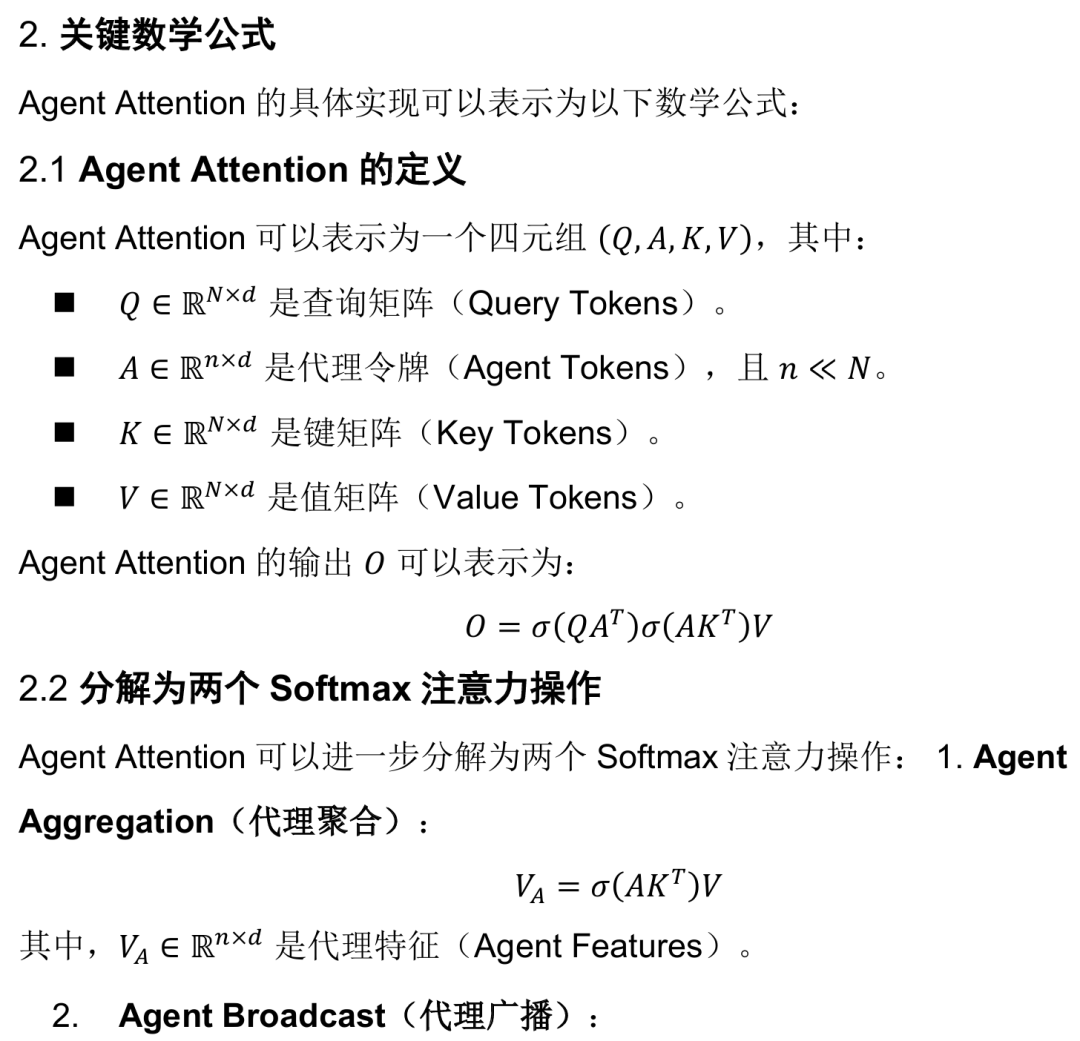

Agent Attention是一种新型的注意力机制,可以平衡计算效率和表示能力。通过引入一组代理令牌(Agent Tokens),将传统的注意力模块扩展为一个四元组(Q,A,K,V),其中A代表代理令牌。这些代理令牌首先作为查询令牌Q的“代理”,从K和V中聚合信息,然后再将这些信息广播回Q。由于代理令牌的数量可以远小于查询令牌的数量,Agent Attention在保持全局上下文建模能力的同时,显著降低了计算复杂度。从理论上讲,Agent Attention将Softmax注意力的二次复杂度降低为线性复杂度,同时通过其设计巧妙地整合了Softmax注意力的高表达能力和线性注意力的高效性。

Agent Attention原理

原文Agent Attention的提出用于机器视觉领域,现有大部分结合该算法的文献也都是应用于图像识别、检测等(如结合YOLO),本代码创新性的将Agent Attention与双向门控循环单元结合,应用于时间序列预测。

BiGRU 是一种循环神经网络(RNN)的变体,结合了双向门控循环单元(GRU)。GRU 是一种轻量级的循环神经网络单元,通过引入更新门和重置门来解决传统 RNN 的梯度消失问题。BiGRU 通过同时处理序列的正向和反向信息,能够更好地捕捉序列中的时间依赖关系。

参考文献:《Agent Attention: On the Integration of Softmax and Linear Attention》《基于双聚合与代理注意力的结肠息肉分割方法研究》

代码获取方式:【原创代码分享】Agent Attention-CNN-BiGRU/GSConv-BiLSTM 多变量时间序列预测

程序名称:基于GSConv-BiLSTM的多变量时间序列预测

实现平台:python—Jupyter Notebook

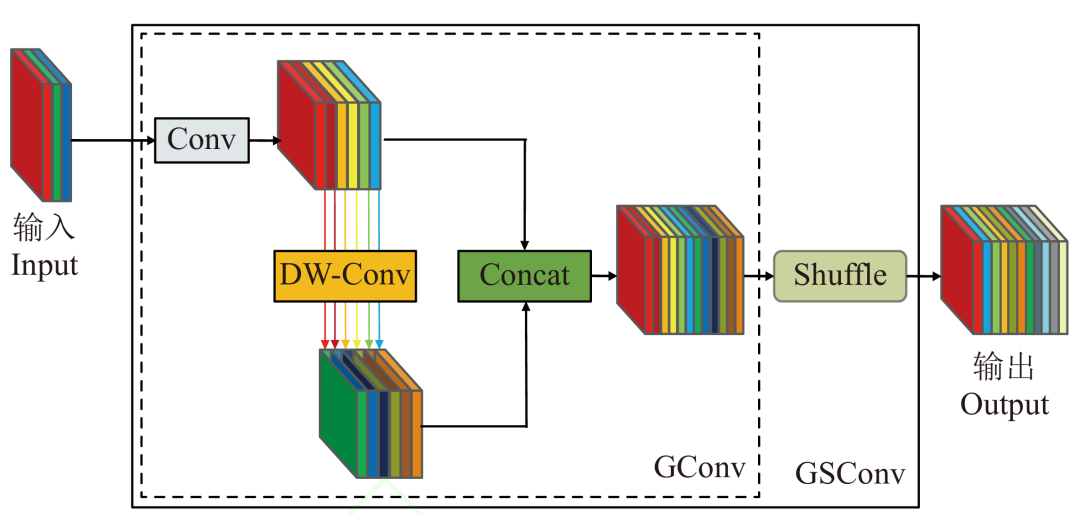

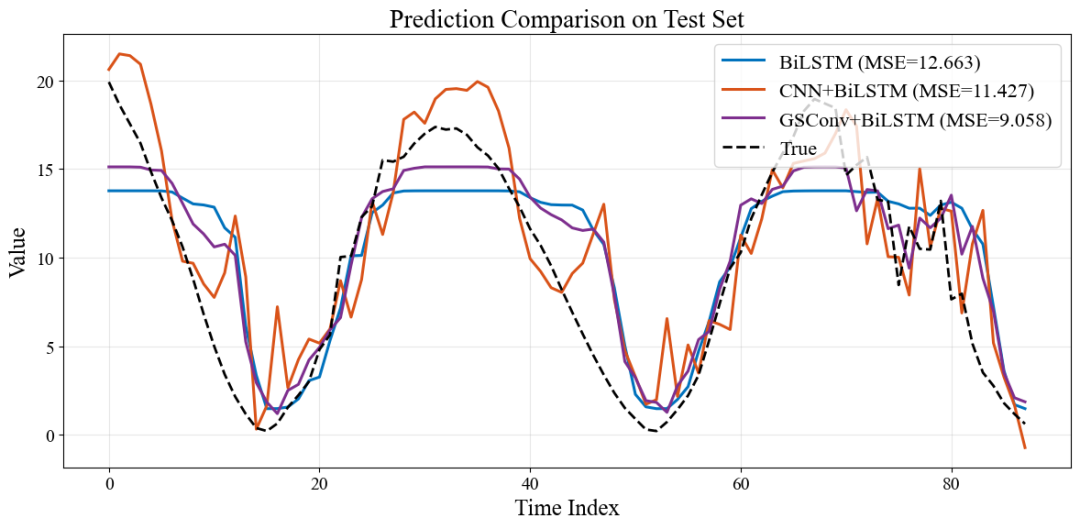

代码简介:构建了基于GSConv(混合标准卷积与深度可分离卷积)-BiLSTM(双向长短期记忆网络)多变量时间序列预测模型。对比了BiLSTM、CNN-BiLSTM、GSConv-BiLSTM的预测结果。高创新点,原创未发表,注释超详细,几乎每行一注释。限量。

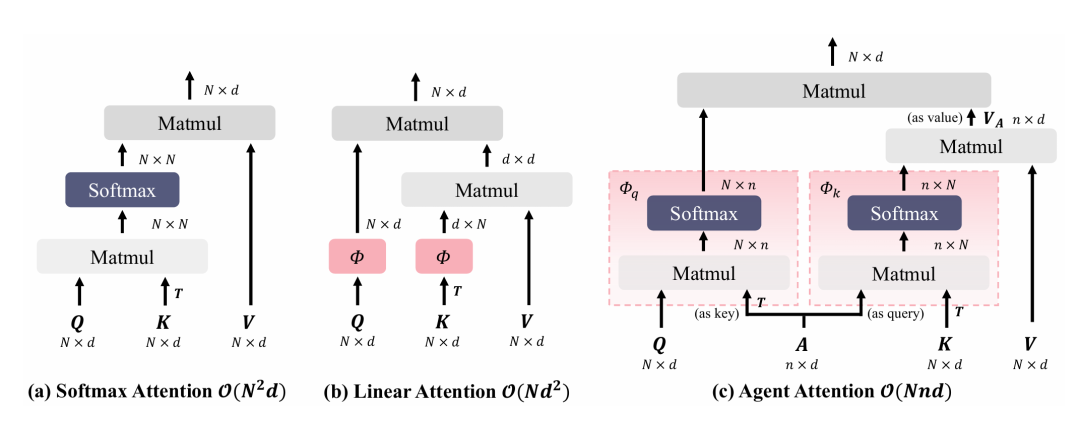

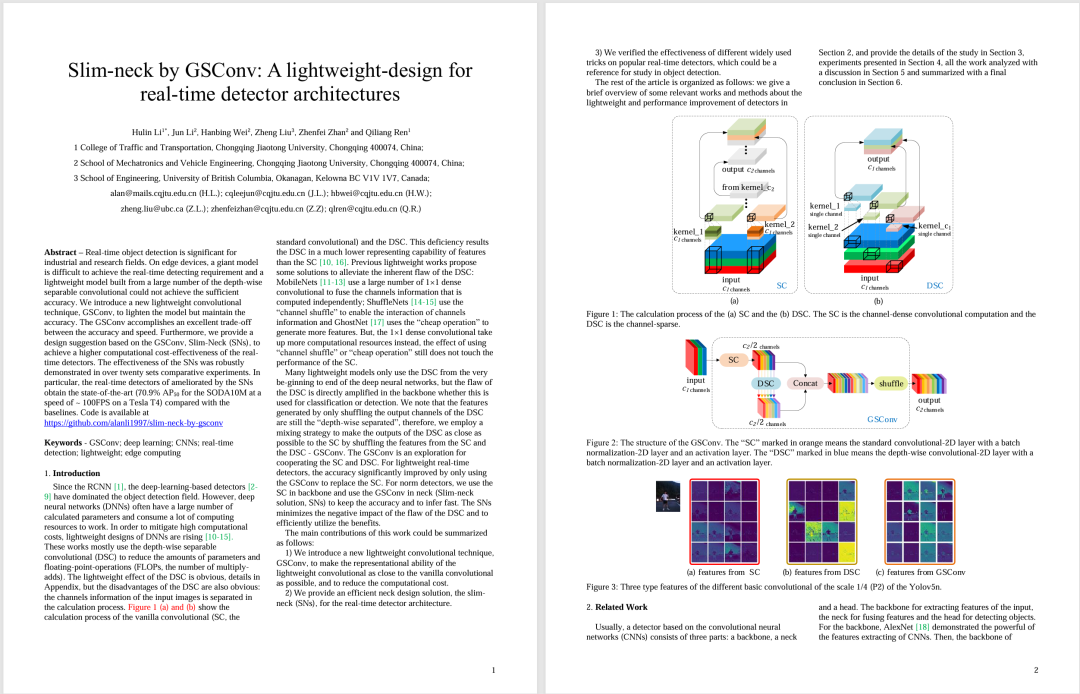

GSConv(Grouped Shuffle Convolution)是一个轻量级卷积模块,可以实现标准卷积(SC)与深度可分离卷积(DSC)的优势互补,用 SC 提取全局通道关系,用 DSC 提取局部空间信息,再通过通道 shuffle 把两部分轻量地融合。

原文GSConv的提出用于机器视觉领域,现有大部分结合该算法的文献也都是应用于图像识别等(如结合YOLO),本代码创新性的将GSConv与双向长短期记忆神经网络结合,应用于时间序列预测。

把时间轴看成“一维空间”,即可得到时间序列版 GSConv:主分支采用 1D-SC(大核)捕获长程依赖,辅助分支采用 1D-DSC(小核)捕获短期波动,二者拼接后 shuffle,实现“既省参数又保表达力”的特征增强。

GSConv卷积原理

将GSConv 与BiLSTM 结合的流程是:先把原始多变量序列输入 GSConv1D 模块,得到兼具局部细节与全局趋势的时序特征;随后把特征送入BiLSTM,由其双向递归结构进一步建模长期前后依赖;最后取 BiLSTM 的末端隐藏状态,经全连接层输出未来时刻的预测值。GSConv 的并行卷积还可减少 BiLSTM 的层数与宽度,从而显著降低整体参数量。

这种组合的优势体现在三方面:1) 计算高效——GSConv 用DSC 减少冗余,卷积可并行,训练比纯 BiLSTM 更快;2) 表达力强——显式分离长短期模式,避免 LSTM 因梯度消失而遗忘长期信息;3) 部署友好——整体模型更小,可在边缘设备上实时运行,同时对噪声和突变更具鲁棒性。

|

模型 |

传统BiLSTM |

GSConv+BiLSTM |

|

特征提取 |

依赖LSTM的递归结构,局部模式需通过大量参数学习 |

显式分离局部(DSC)和全局(SC)特征,效率更高 |

|

参数量 |

LSTM参数量大(尤其是多变量序列) |

GSConv减少冗余参数(DSC的轻量性),整体更轻 |

|

训练速度 |

LSTM串行计算,训练慢 |

GSConv卷积并行化加速,BiLSTM层数可减少 |

|

长短期依赖 |

LSTM可能遗忘长期模式 |

GSConv预提取长期依赖,BiLSTM专注双向整合 |

|

抗噪性 |

对高频噪声敏感 |

DSC分支的局部卷积可平滑高频噪声 |

参考文献:《Slim-neck by GSConv: A lightweight-design for real-time detector architectures》

代码获取方式:【原创代码分享】Agent Attention-CNN-BiGRU/GSConv-BiLSTM 多变量时间序列预测

GSConv+BiLSTM提升效果显著!

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)