大模型萌新不再迷路!超详细开源LLM教程来了

这是一套面向中国开发者、初学者友好、Linux平台优先适配的实用教程体系。它深入浅出地拆解了从环境配置、模型部署,到全参数微调与LoRA调教的完整过程,为大模型技术的大众普及铺设了一条康庄大道。

近年来,随着 ChatGPT 的风靡,大语言模型(LLM)成为人工智能领域的焦点。在海量开源模型涌现的今天,如何快速开始体验、部署、调优这些 LLM,成为众多开发者和研究者的核心问题。而Datawhale倾力打造的《开源大模型食用指南》正是为了解决这一痛点而诞生的宝藏项目。

这是一套面向中国开发者、初学者友好、Linux平台优先适配的实用教程体系。它深入浅出地拆解了从环境配置、模型部署,到全参数微调与LoRA调教的完整过程,为大模型技术的大众普及铺设了一条康庄大道。

为什么我们需要「开源大模型食用指南」?

大语言模型的世界虽然令人向往,但对普通人而言,门槛依旧不低:

- Hugging Face、ModelScope上的模型太多,无从选择;

- 满满英文文档,看得头大;

- 依赖库安装踩坑无数,GPU跑模型经常“炸机”;

- 想调模型?LoRA、QLoRA、全量微调等方案五花八门,该选哪个都不知道;

- 好不容易部署成功,想加个Web界面、接入LangChain又陷入新的迷雾。

基于此,《开源大模型食用指南》的最大价值就在于:

👉 将复杂的大模型食用流程全面本地化、中文化和场景化,从环境搭建、模型解析到部署调优,全过程提供手把手教程,哪怕你是零基础小白,也能跟着一步步实践;

👉 教程基于真实项目经验沉淀而成,覆盖最热门的国内外模型,例如 Qwen3、ChatGLM3、InternLM2、MiniCPM、LLaMA 等,并已实现几十个模型的快速部署和微调方案;

👉 既包括基础部署,也包括微调实战和Langchain场景接入,真正帮助你把模型“用”起来,而不是只停留在“能跑通”;

👉 对硬件要求友好,无需高配集群,一张 RTX 4090 就能做出精彩案例。

教程内容详解:四大模块覆盖完整链路

整个自学指南结构分为四大模块,循序渐进、高效系统。

模块一:环境配置 - 从零运行不再卡顿

Linux环境下部署大模型并非易事,各类依赖包、CUDA版本、Python版本冲突频发。《食用指南》提供了详细的模块级配置教程:

- pip/conda 换源;

- huggingface、modelscope等模型下载镜像设置;

- git-lfs 安装与使用;

- AutoDL/GPU服务器端口开放设置;

- Openxlab 开源平台模型快速拉取教程;

通过这些配置方案,你可以快速构建出适配当前国内大模型生态的本地运行环境。

模块二:模型部署 - 覆盖当前热门LLM与MLLM

教程支持部署接近80+种主流模型,包括纯语言模型(LLM)、多模态模型(MLLM)、代码模型、音频模型、视觉处理模型等。

支持部署的主流模型包括但不限于:

- 中文模型:ChatGLM3、InternLM、MiniCPM、Yi、BaiChuan、GLM-4;

- 国际大咖:LLaMA3、Phi、Gemma、Gemma2、Gemma3、Qwen、OpenELM等;

- 多模态模型:Kimi-VL、Hunyuan3D、Qwen-VL、MiniCPM-o;

- 开源“小钢炮”:Qwen1.5、Phi-3-mini、DeepSeek、TransNormerLLM等;

不仅支持基础的 Transformers 接口部署,还全套支持:

- FastAPI 快速接口化;

- WebDemo 部署,点击即用的网页界面;

- vLLM 轻量推理优化;

- Docker 镜像一键上云;

- LangChain 集成落地应用。

部署完不仅能本地体验,也能快速生成 web 界面互动,大大提高展示及调试效率!

模块三:模型“调教” - 手把手走进 LoRA 与全参微调世界

本项目特别强调模型微调,尤其适配普通GPU的高效微调范式(如LoRA、QLoRA、ptuning等)。

你将学到:

- 如何使用 PEFT 工具进行 LoRA 微调;

- 支持 SwanLab 实验管理平台,实现训练数据可视化;

- 使用 EvalScope 框架评估 LLM 情商、智商能力;

- 微调适应 Chat、医学对话、文档问答、数学推理等特定场景任务;

- 如何在单卡显卡(如 RTX4090)完成调教并复用;

特别值得一提的是,项目中大量微调任务使用国产模型如 Qwen1.5/Qwen3、InternLM2、MiniCPM 等,并提供微调的完整代码与数据配置案例。

模块四:项目实战 - 模拟角色玩法+特色模型应用案例

学会了技术怎么用,还可以进一步实现更有趣的玩法。这套教程推出一批创新项目示例(Example 系列),帮助大家探索 LLM 的边界创造力:

- Chat-甄嬛:基于《甄嬛传》台词微调的大模型,实现角色扮演语言风格模拟,LoRA实战示例;

- Tianji-天机:结合智能体构建、人情世故场景、提示词工程等内容,完成AI社交助理;

- AMChat:Advanced Mathematics Chat,构建能够“解微积分题”的数学专家;

- 数字生命:输入你自己的语料构建个性化“AI分身”,复刻情绪、口吻甚至文字逻辑风格。

每一个都是从环境配置、模型选型,到数据制作、LoRA调教、评估分析的真实流程案例,对标现实中最具想象力的应用创新。

示例库详解:最强开源模型合集

项目附带的模型食用清单也十分丰富且系统,涵盖最当前沿的国产与国际模型生态,支持文生文、图文、多模态、智能体、代码生成等人才培养场景。

以下是部分支持的模型类别及代表:

| 模型类别 | 代表模型 | 支持操作 |

|---|---|---|

| 大语言模型 | ChatGLM3、InternLM3、Qwen3、DeepSeek、Baichuan等 | FastAPI/WebDemo/vLLM/LangChain/LoRA |

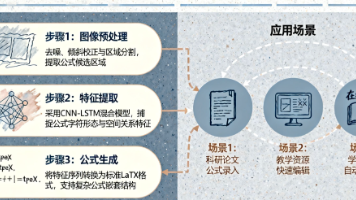

| 多模态模型 | MiniCPM-o、Kimi-VL、Qwen2-VL等 | 图文理解、语音合成、LaTeX截图识别等 |

| 代码模型 | Qwen-Coder、DeepSeek-Coder、Phi-Coder等 | 代码生成、自动debug、部署扩展等 |

| 数学推理模型 | InternLM2-Math、AMChat 等 | 方程求解、导数计算、逻辑证明 |

| 视觉理解模型 | Hunyuan3D-2、SpatialLM | 3D识别、几何分析等 |

每个模型的部署均克服了国内访问慢、依赖不匹配等实际问题,真正做到了“跟着文档走就能跑”的地步!

学习路线建议:新手至高手只需三步!

“大模型太复杂,不知道从哪里学起。”

放心,《食用指南》已经贴心地给出了学习Next Step:

- 入门阶段:

- 环境配置练习:熟悉Linux+CUDA+conda等常见依赖;

- 尝试运行小模型,如 Qwen1.5、MiniCPM、InternLM2;

- 提升阶段:

- 完成 LoRA 微调项目,如“Chat-甄嬛”;

- 尝试 GPTQ 模型部署与内存量化压缩;

- 进阶迁移:

- 尝试 WebDemo 部署,或与 LangChain 构建应用;

- 自定义任务微调,例如医学对话、语义解构等;

- 整合 SwanLab 评估与训练指标可视化,构建调研报告;

延伸阅读:更进一步的学习资源推荐

如果你在跟随《食用指南》掌握了部署与调优技术,想深入了解原理、训练方法、应用开发,推荐进一步参阅以下 Datawhale 项目:

- 🎓 Happy-LLM:从零阅读+实现大语言模型,理解Attention机制

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献430条内容

已为社区贡献430条内容

所有评论(0)