深入理解大模型Attention机制:Q与K为何要分离?数学原理与实例解析(建议收藏)

文章从数学角度和直观例子分析了Attention机制中Q(query)和K(key)的区别与作用。当Q=K时,Weight矩阵变为对称半正定矩阵,降低了模型对非对称场景的处理能力,减弱了模型的表达能力。虽然技术上不一定要区分Q和K,但在self-attention中,Q与K的分离增强了模型的表达能力,使得模型能够更好地捕捉序列中不同位置之间的关系。

在Attention计算中,为什么要分Q(query)、K(Key),能否用同一个数据?Q与K角色能互换吗?本文用数学算式分析和直观举例,来帮助你理解这个问题。

01 Q和K相同的影响

在Attention中:Q和K用于计算相似性(关联性)—权重Weight/Scores。计算式如下:

Weight= Q·KT=XWQ·(XWK)T

其中X是输入值,self-attention中Q、K有相同的X;WQ和WK是可学习的映射权重。

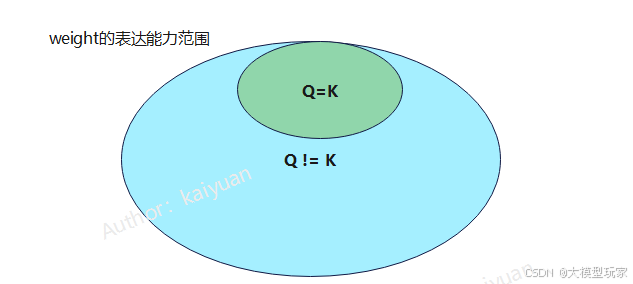

当Q=K时,计算得到的Weight就成为了一个特例,Weight取值范围更小了。

很显然:特例的表达能力肯定弱于Q、K任意的情况。

注意:Q=K只是说表达/理解能力变弱了,并不是不能这么做!

数学角度上:若Q=K,Weight就是对称半正定矩阵。 会降低attention对非对称场景的处理能力!

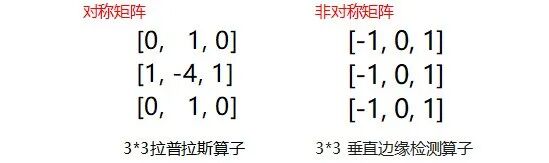

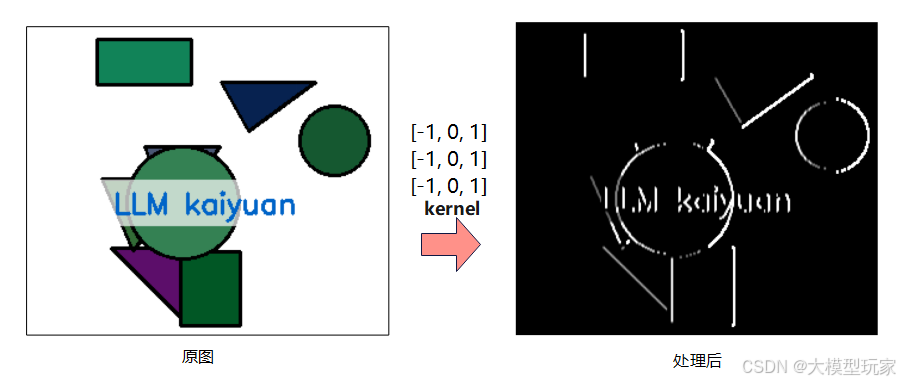

以图像处理做类比,Weight好比卷积计算中的算子(kernel),如果kernel只能是对称矩阵,则不能满足非对称算子的计算场景,比如水平算子和垂直算子。

垂直边缘检测算子能干嘛?举个例子, 如图下所示,它可以把垂直方向边缘提取出来。

对于这种卷积算子,注意力机制能学习出来。比如学会了垂直边缘检测的Attention,更关注垂直方向的边缘数据。但Q=K后,attention的这种能力会严重弱化!

注意是弱化,不是完全没有!因为Weight后面还有个softmax归一化处理,所以与Value相乘的矩阵可以是非对称的!

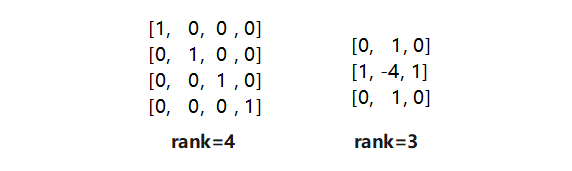

进一步,从矩阵秩的角度来看这个问题。对于矩阵的乘法,秩的变化满足:

Rank(AAT) = Rank(A)

Rank(AB) ≤ min(Rank(A),Rank(B))

根据公式,Q=K计算得到的Weight的秩,一定大于等于Q!=K(不等于)计算得到的Weight的秩!

结合矩阵的秩数越大,表达能力会更强的结论,乍一看,Q!=K算得的Weight的秩数可能会更小,表达能力似乎更差了?

注意这里有个陷阱,是说有可能,而不是一定!大于等于的情况包含了等于。并且秩大,只是说矩阵可表达的空间范围更大,而不是说秩大的矩阵信息就更多!一般讨论时,默认的是Rank(AA) 与Rank(AB)相等。

秩不相等的两个矩阵信息含量对比

Q与K不等的情况下,Q与K本身能携带的信息更多,不考虑求解Weight,仅比较Q和K包含的信息总量,有:

信息量(Q!=K) >= 信息量(Q=K)

02 为什么要分Q和K?必须吗?

首先要明确的是:不一定要区分Q和K!

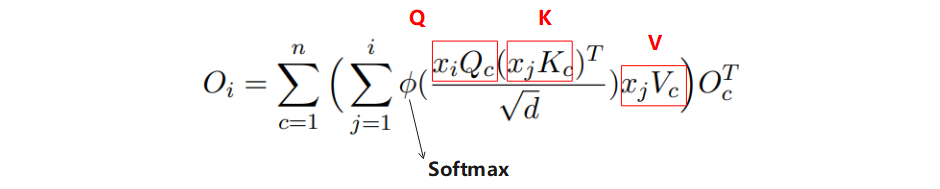

从Attenton的数学公式来讨论。常见的MHA(Multi Head Attenion)的计算公式如下,其中Qc/Kc/Vc表示三个不同映射矩阵,对应了不同的权重,把X与Qc乘积称为Q、X与Kc的乘积称为K,X与Vc乘积称为V。

MHA的attention计算

Attention只有这种表达式吗?答案是:否。

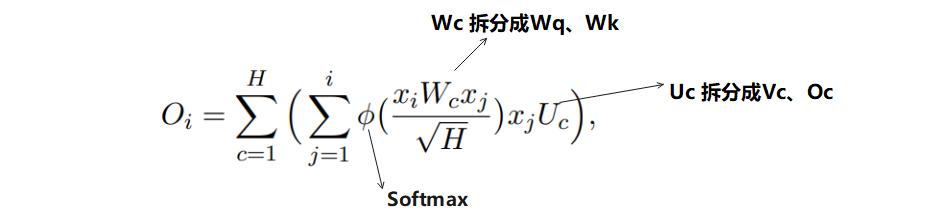

Attention还有表达能力更强的形态!比如秩更高的FPBA(Fully Parameterized Bilinear Attention),它只有两个映射矩阵Wc、Uc。MHA认为是其Wc、Uc拆分后得到的降秩表达。

FPBA的表达式

如果用FPBA,里面的相似性计算变为:XiWcXj。没有Q、K,照样算可以算注意力机制!

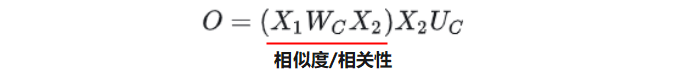

进一步,再去掉公式中的非关键因素:归一化计算softmax、常量值 ,简化attention公式:

,简化attention公式:

括号里面算的是相关性,表示X1与X2相关程度,X1!=X2时是cross-attention,当X1=X2时是self-attention;在self-attention中,仅考虑相似度计算时,Q和K的角色是可以互换,不影响权重计算。

回头看MHA公式,当Q、K的输入X不同时(Xi != Xj),即使Wq等于Wk,得到Q/K也不会相同(特殊值除外)。

Q=XiWQ; K=XjWKQ=XiWQ;K=XjWK

实际上cross-attention中Q不等于K是常态。

03 self-attention中为什么区分Q/K?

前面分析的是一般attention的Q与K值,那在MHA形态下的self-attention(输入都是相同X)中,Q和V为什么要不同?从直观角度来看,因为相似度计算时需要一个查询索引和一个被查询对象。

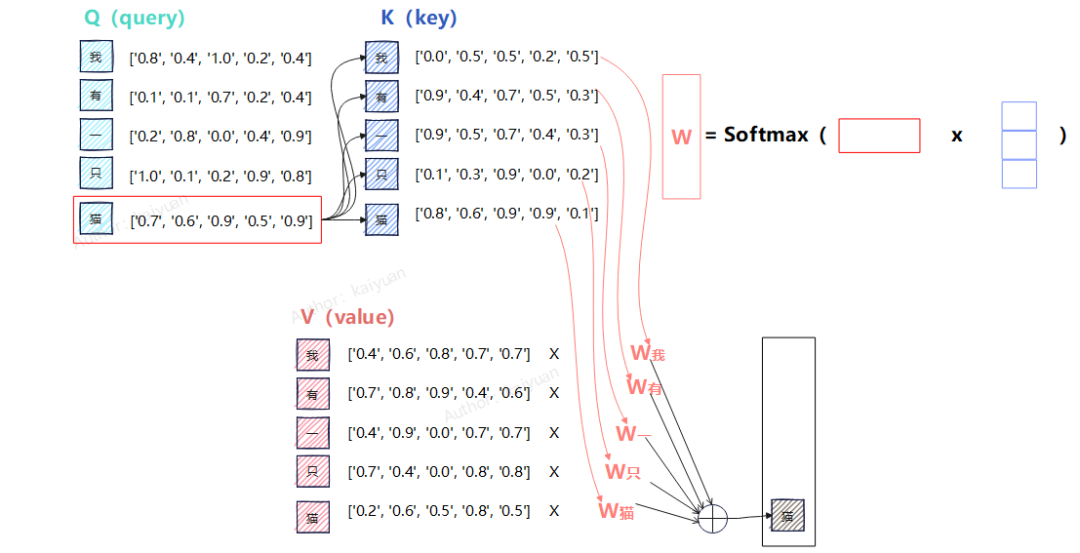

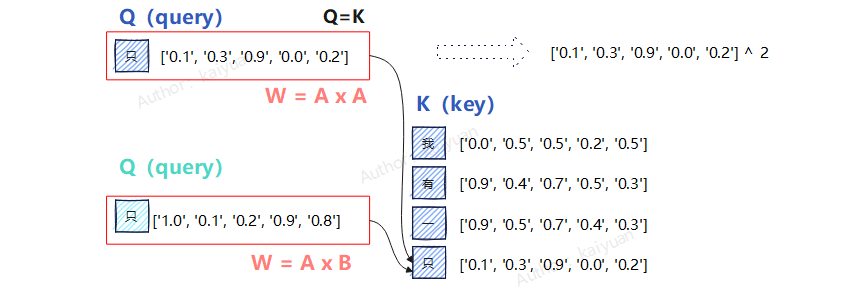

或者说计算时需要有个角色针对当前的数据**提问。**举个例子,当输入序列为“我有一只猫”,经过映射计算后得到了不同的Q/K/V值如下图所示,每个字(token)对应了一个embedding序列:

当需要计算“猫”的注意力输出时,先从Q中找到“猫”的值,然后跟所有K进行相关运算得到不同权重W,最后V与W相乘、再相加后得到“猫”这个token对应的输出值。

从自回归推理的角度来看,假设输入变为“我有一只__“,模型需要推导出下一个字符的场景。仅关注最后一个token的Weight计算(“只”token),它需要与所有token都完成一次运算,当运算到K“只”时,相当于自己在找与自己的关系,如“只”采用相同表达,那么自己查自己的信息就会很少,采用不同表达的Q与K,查询自己会变得更有意义

或者说:Q=K时,结果就是数值取的平方;Q!=K时,结果的取值范围更大,计算下一个token的预测值的范围也更大!

小结:

- 不一定要区分Q和K,只是在我们熟悉的self-attention形态中区分了Q与K。

- 为了便于理解,命名上区分了Q/K,计算上可以互换。求两个不同序列的相关性时Q、K数值基本不同。

- MHA的self-attention计算中,Q、K不相等能增强模型的表达/理解能力!

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

更多推荐

已为社区贡献383条内容

已为社区贡献383条内容

所有评论(0)