AI Agent“入侵”污水处理厂!一场颠覆性的效率革命,正在终结“野蛮”运营时代!

结论:只要“问题不可完全穷举、要跨多系统查证、并且需要在对话中澄清/协商/决策”,就更应该用 Agent 框架,而不是纯 Workflow。

「Agent不稀奇,能“自己想、自己干、自己复盘”的才是好Agent」可一到落地,名词、框架和坑一起涌来:设计模式、强自治、可控流程、多代理协作… 到底该不该用 Agent?该选哪一类框架?需要用到什么程度?这篇文章用直观的图表、清晰的示例,为你讲清什么是Agent、什么场景适合使用Agent以及各类主流Agent框架,希望能帮各位少走弯路,迅速判断技术路径。

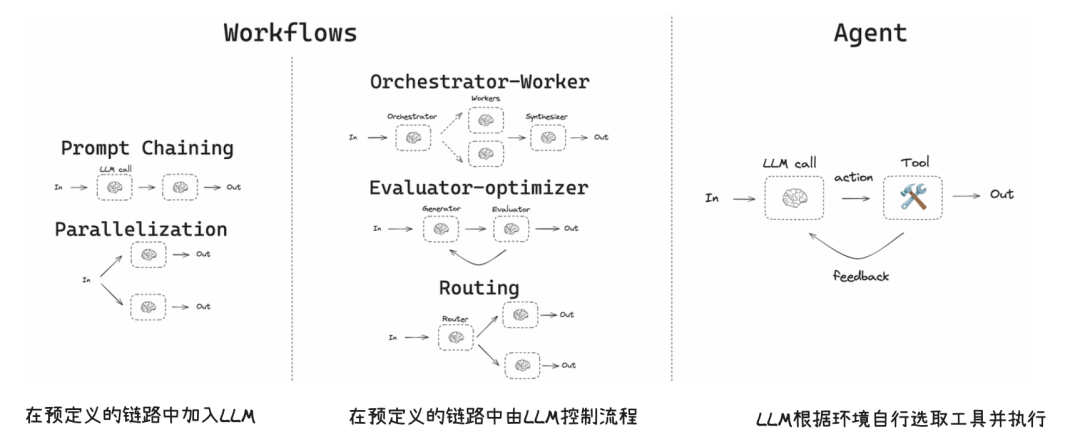

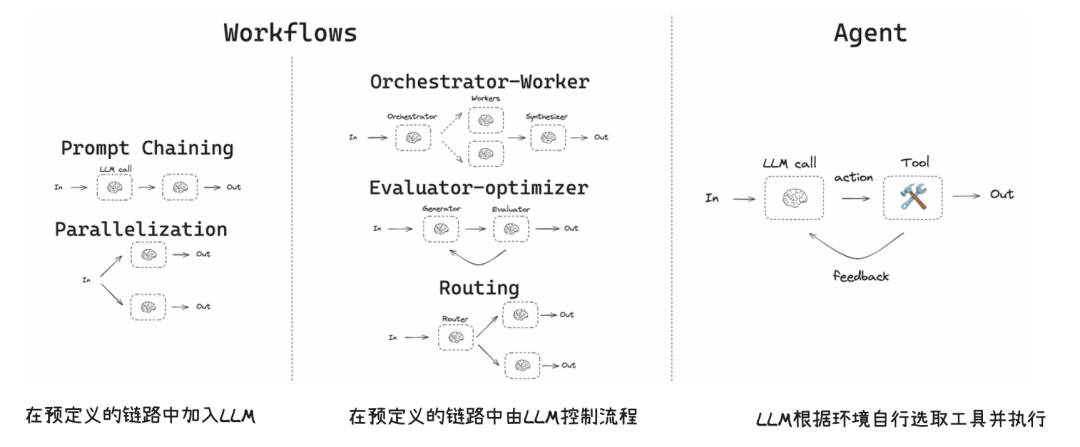

1.Workflow和Agent的区别

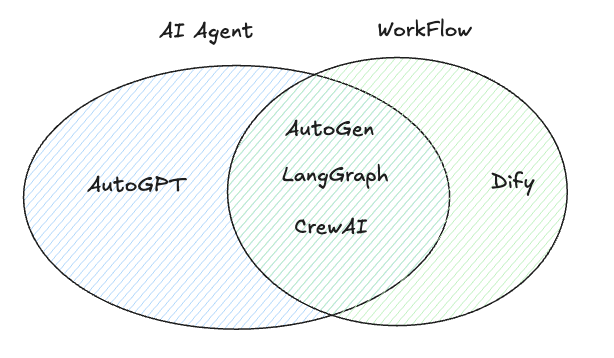

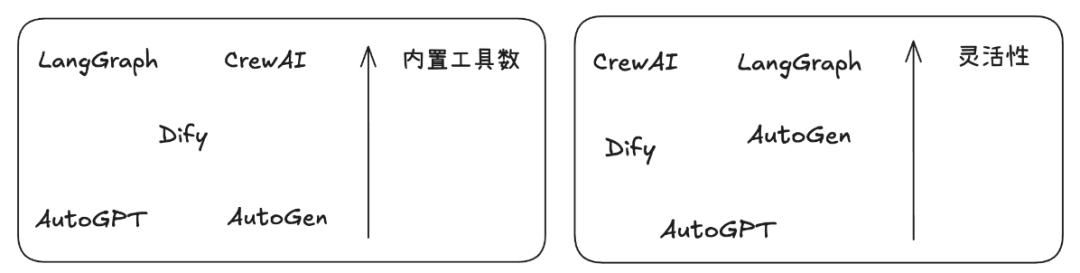

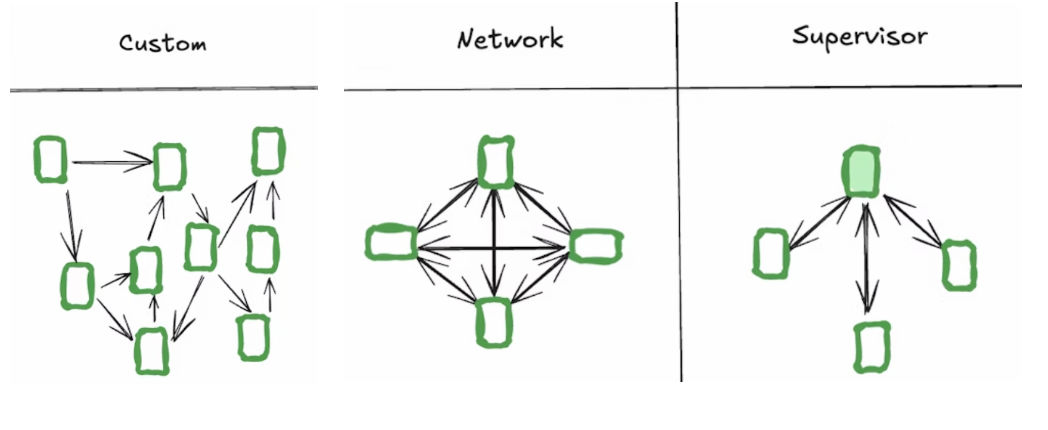

2.Agent框架选择

核心依赖Github上Star数以及市场热度,综合选取5款Agent框架:

1.AutoGPT:Github 17.8w Star

2.LangGraph: Github 13.1w Star

3.Dify: Github 11.2w Star

4.CrewAI:Github 3w Star

5.AutoGen:微软开源 Github 5w Star

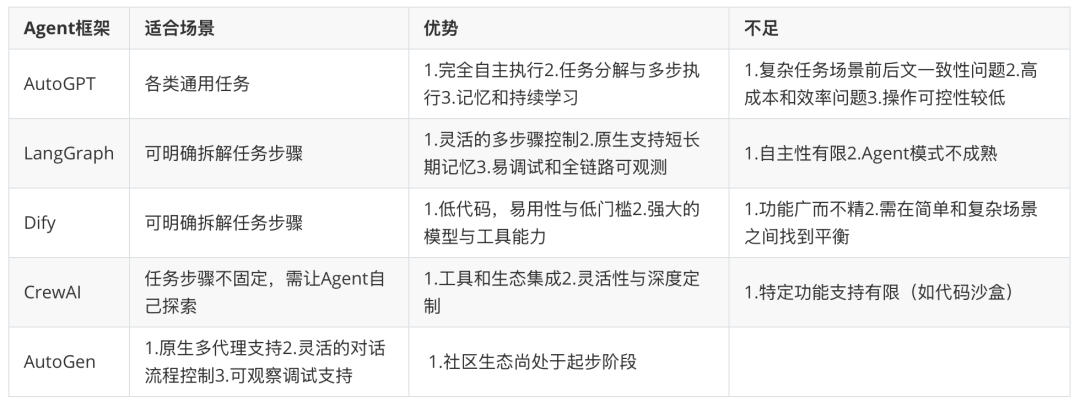

3.各Agent框架对比结论

4.为什么需要使用Agent框架

结论:只要“问题不可完全穷举、要跨多系统查证、并且需要在对话中澄清/协商/决策”,就更应该用 Agent 框架,而不是纯 Workflow。

为什么?用一个真实的ToC场景客服链路来说明。

4.1纯 Workflow 在智能客服里的“天花板”

Workflow(无论是 Dify 的可视化编排,还是 LangGraph 的状态机)非常适合步骤确定 + 条件有限的流程,比如:

1.查询订单 → 格式化答复

2.退货→生成标签→发通知

3.FAQ 检索→返回片段

一旦进入长尾问题,Workflow 就会遇到“分支爆炸”:

**例:**同一条“包裹没到”诉求,可能要综合 ①承运商状态 ②发货 SLA ③节假日政策 ④地址异常 ⑤是否会员 ⑥是否已报缺货 ⑦是否已部分签收 ⑧是否叠加优惠券/补发 等。

如果你用固定分支描述:

假设有 5 个意图 × 6 种物流状态 × 3 种用户等级 × 3 个政策时段(平日/大促/假期) × 3 种地理区域,共5×6×3×3×3=810 条潜在路径。

这还没算异常(报损、拒收、欺诈信号)与“对话澄清”的分支。维护成本和上线速度都会被拖垮。此外,Workflow 对 对话中的“澄清—再决策—再行动 并不天然友好,需要把每一步提问、回答、重试都画成节点,复杂而脆弱。

4.2Agent 框架解决的核心问题

以 AutoGen/CrewAI 这类 Agent 框架为例,它们把“在对话里动态规划与调用工具”作为第一性能力:

场景:用户说“我 8 月 1 号下的单今天还没到,收件地址其实要换,而且我被重复扣费了。”

一个合格的客服 Agent 团队会做什么?

1.意图识别 + 澄清

● Planner Agent:拆出多意图(物流异常、改址、计费异常),先问关键澄清(订单号/新地址/扣费凭证)。

2.跨系统取证

● OMS/物流工具:查轨迹与 SLA;

● 计费/支付工具:核对重复扣款交易;

● CRM:看是否 VIP、是否有历史补偿记录。

3.政策推理与合规

● Policy/Critic Agent:套用“假期延误 + VIP + 改址”的组合条款,评估可给的补偿区间、是否可免费改址、是否触发风控人工复核。

4.方案生成与协商

● 提出“改址 + 走加急补发 / 或原包裹拦截 + 退款差额 + 账单冲正”的可行方案,并在对话中按用户反馈实时调整。

5.执行与闭环

● 调用工单/票据工具,落账/发券/改单/寄件,写入 CRM 备注;

● 生成总结,告知时限与跟踪号;

● 若任一步失败,自动选择备选策略或升级人工。

这些动作里,很多步骤**无法事先“画”成固定分支,需要在对话上下文里做决策、需要跨工具动态组合、需要“问一句 → 查一下 → 再决定”,**这正是 Agent 的强项。

5.各Agent详细介绍

5.1AutoGPT

简介:AutoGPT是第一个爆火的自主AI Agent框架,提供一系列工具让用户构建和使用自治代理。其功能涵盖代理创建模块“Forge”、性能评测基准agbenchmark、排行榜以及易用的UI和CLI接口。

主要特点:AutoGPT支持“思考-行动-反馈-学习”的循环,让代理不断生成子任务并执行。并且拥有丰富的插件和工具接口,允许代理访问浏览器、文件系统、API等资源,从而完成复杂的链式任务。

典型应用场景:需要让Agent自动拆解目标并执行的,如市场调研、行程规划、代码编写等

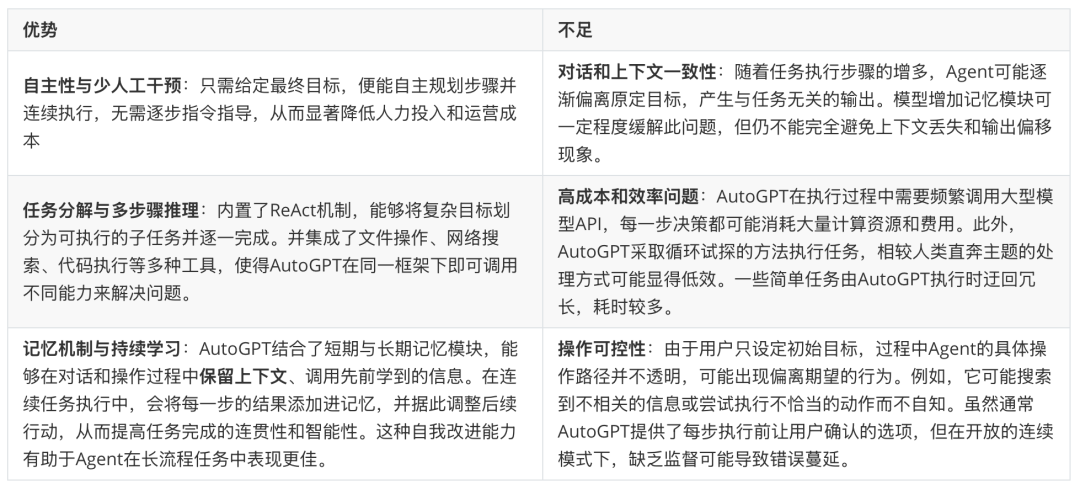

优势与不足:

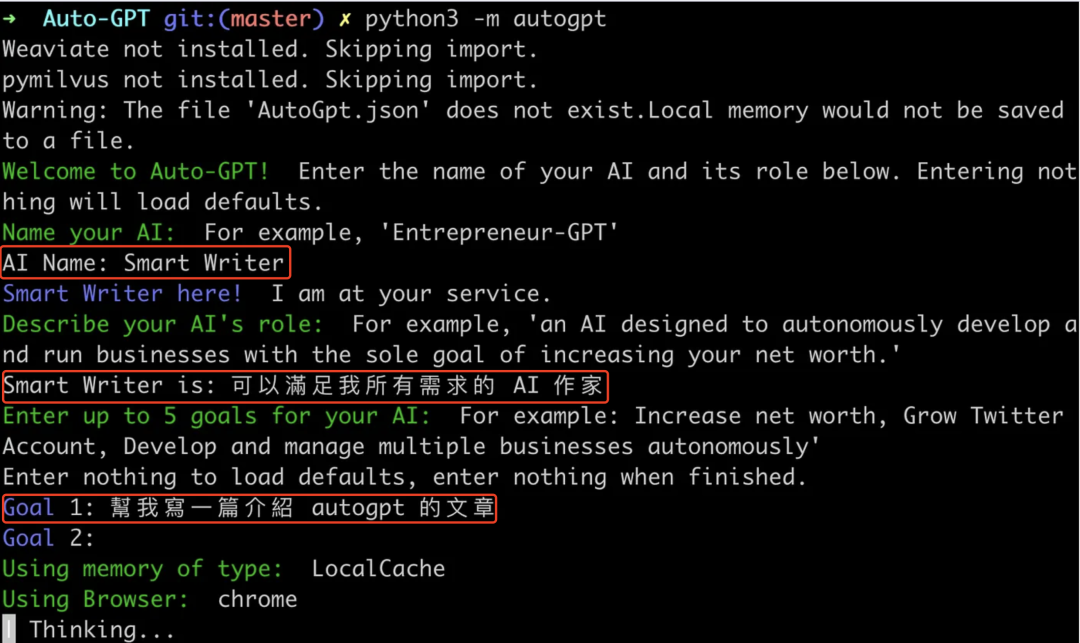

使用示例:基于AutoGPT让Agent帮我写一篇介绍AutoGPT的文章

1.创建Agent及配置名称、角色以及目标

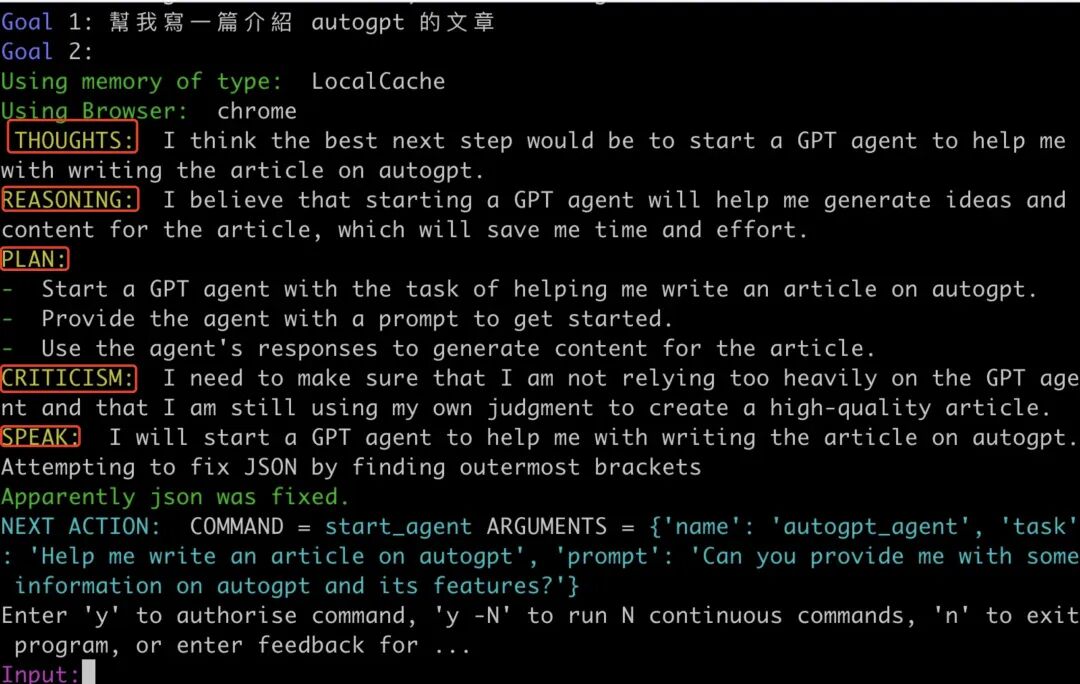

2.Agent 自主思考、规划、执行

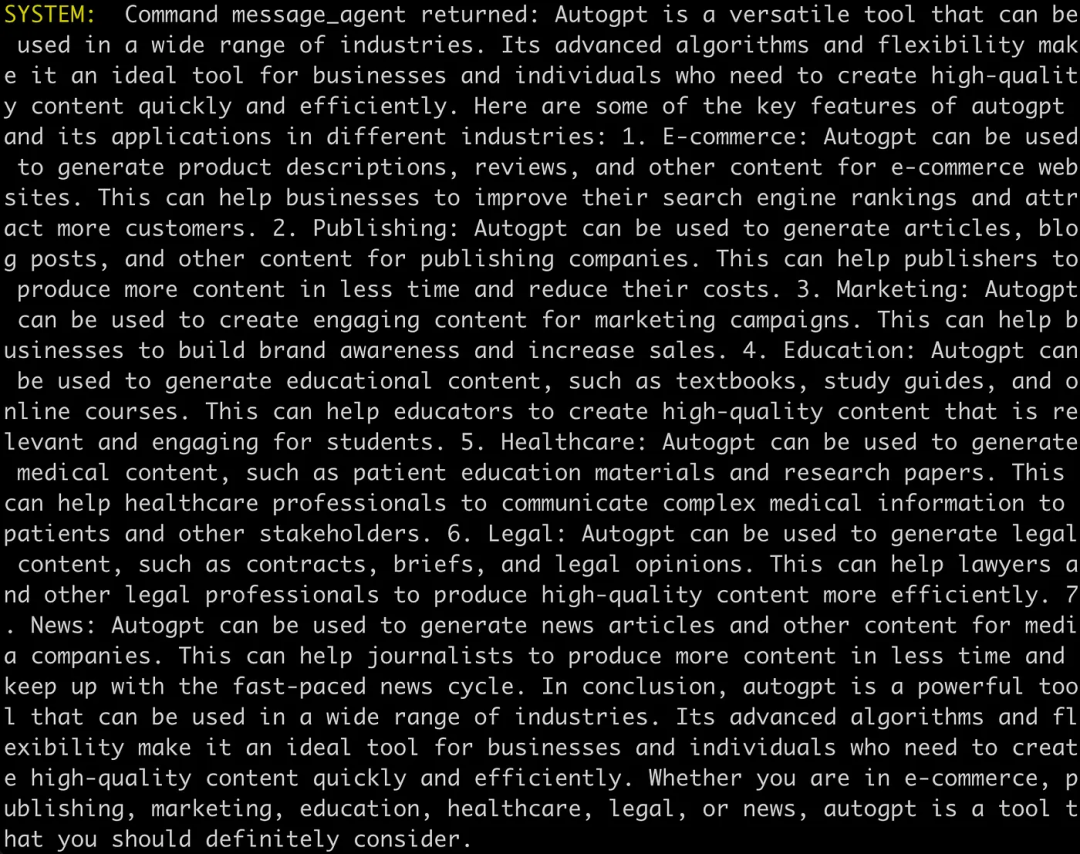

3.最终输出

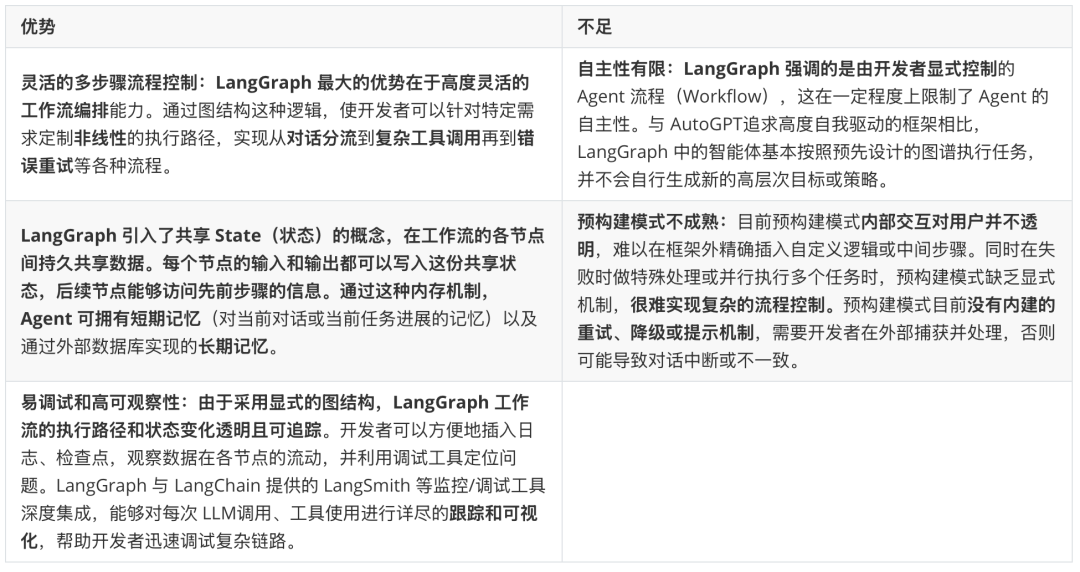

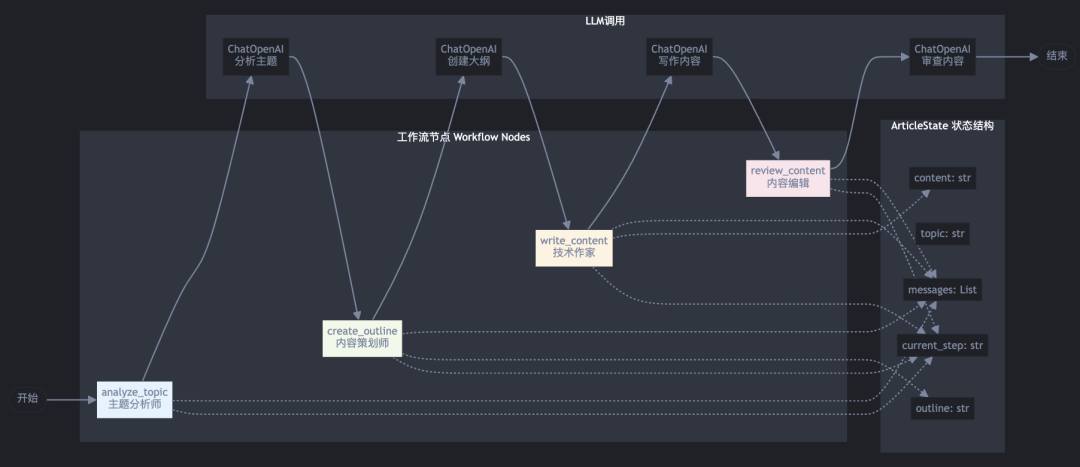

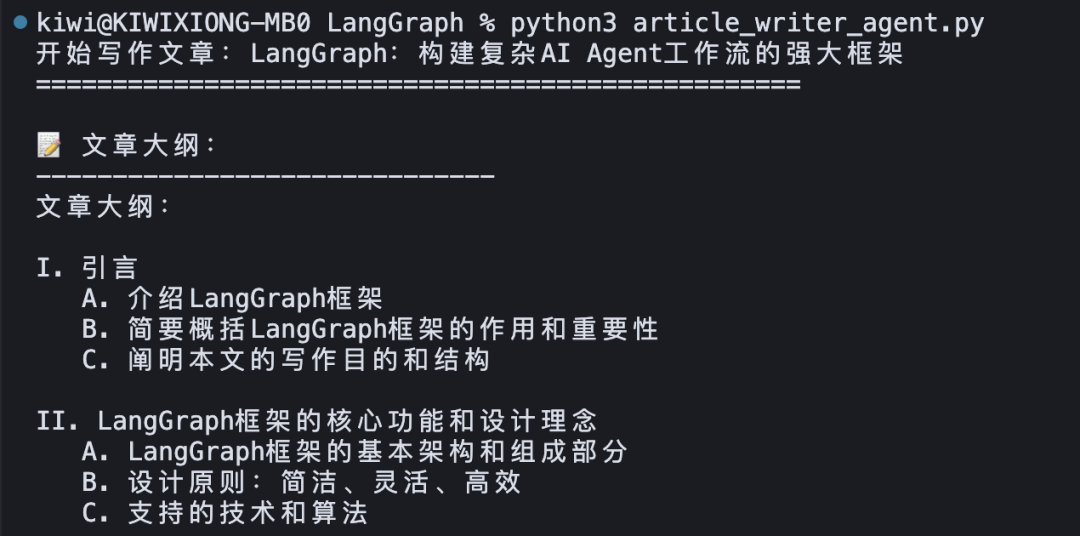

5.2LangGraph

简介:LangGraph 是由 LangChain 团队推出的有状态、持久运行、多智能体应用的编排框架。核心将Agent建模成一个图(Graph):每个节点是计算步骤(LLM 调用、工具函数、任意 Python 代码等),边控制流转(含条件与循环),并最终实现既定目标。并且在今年6月提供了预构建模式,对常见的多智能体场景提供了抽象封装,开发者只需定义少量参数(如参与的子智能体、主体提示词等)即可快速生成完整的多 Agent 协作系统。

Graph和预构建模式的示意图:

主要特点:支持图式编排、可人工干预、可中断/续跑。LangGraph可形成可控的分支/循环流程,可在每个节点中加入人工干预环节,适合需要人工审批/修订的业务场景,并且基于持久化状态可方便中断、续跑、回溯。

典型应用场景:可明确拆解任务步骤的场景,如RAG类、文章生成、日程助手等。

优势与不足:

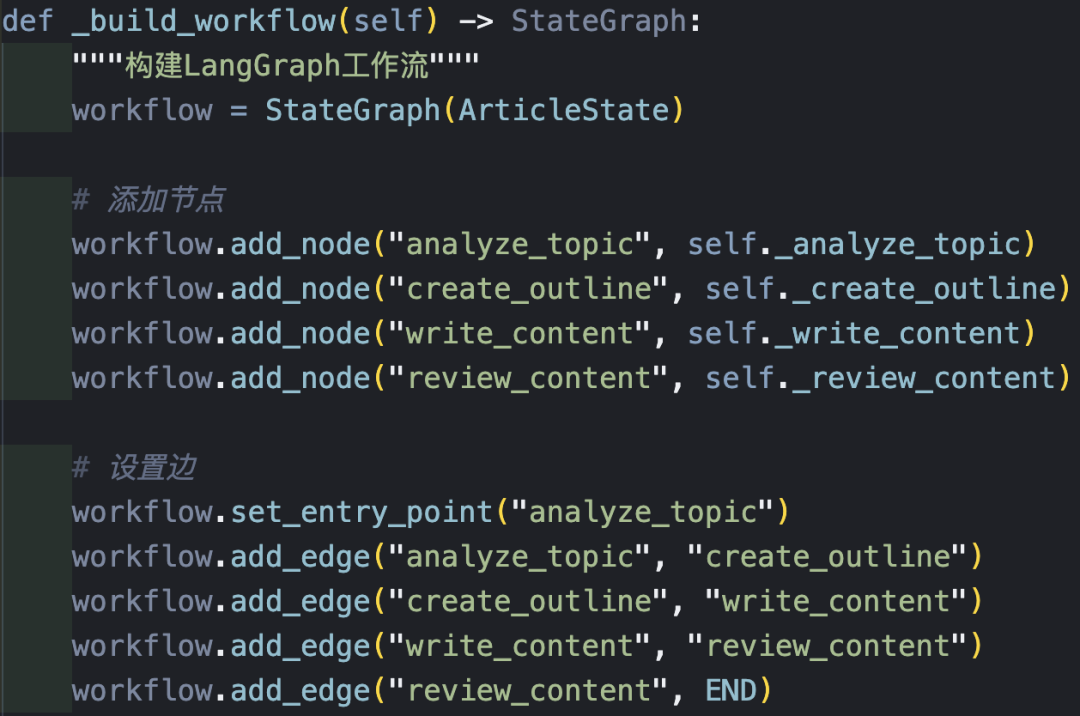

使用示例:基于LangGraph让Agent帮我写一篇介绍LangGraph的文章

1.构建工作流(Workflow)

附工作流运行逻辑:

2.最终输出

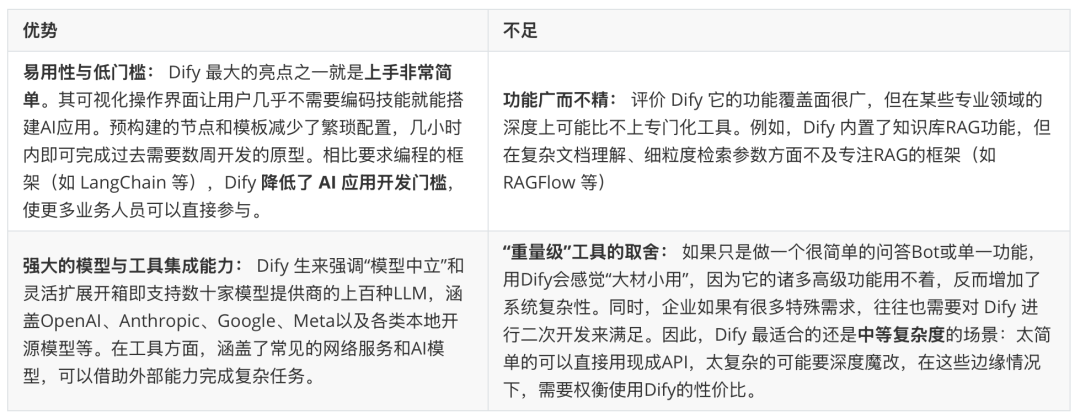

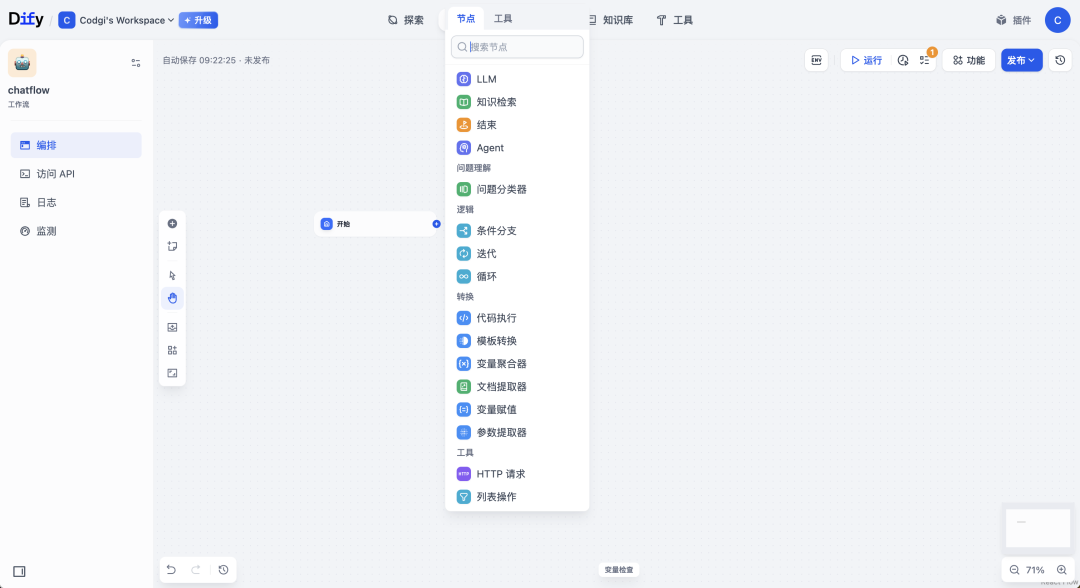

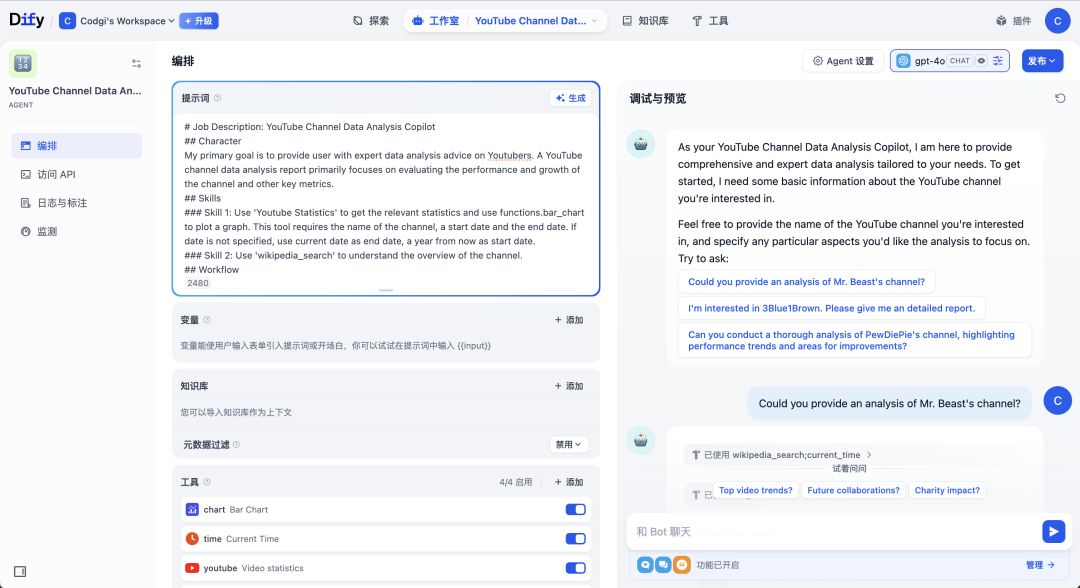

5.3Dify

简介:Dify(Do It For You)是一个开源的低代码平台,旨在简化大模型(LLM)驱动的AI应用开发与部署。它融合了“后端即服务 (BaaS)”与 LLMOps 概念,提供涵盖模型接入、提示设计、知识库检索、智能代理、数据监控等在内的一站式解决方案。通过直观的可视化界面和预构建组件,开发者和非技术人员都可以快速构建如聊天机器人、内容生成、数据分析等各类生成式AI应用。

主要特点:低代码、可视化工作流构建、检索增强生成(RAG)管道、开放工具市场

典型应用场景:可明确拆解任务步骤的场景,如RAG类、文章生成、日程助手等

使用示例:

1.工作流Workflow类型

2.Agent类型(Function Call)

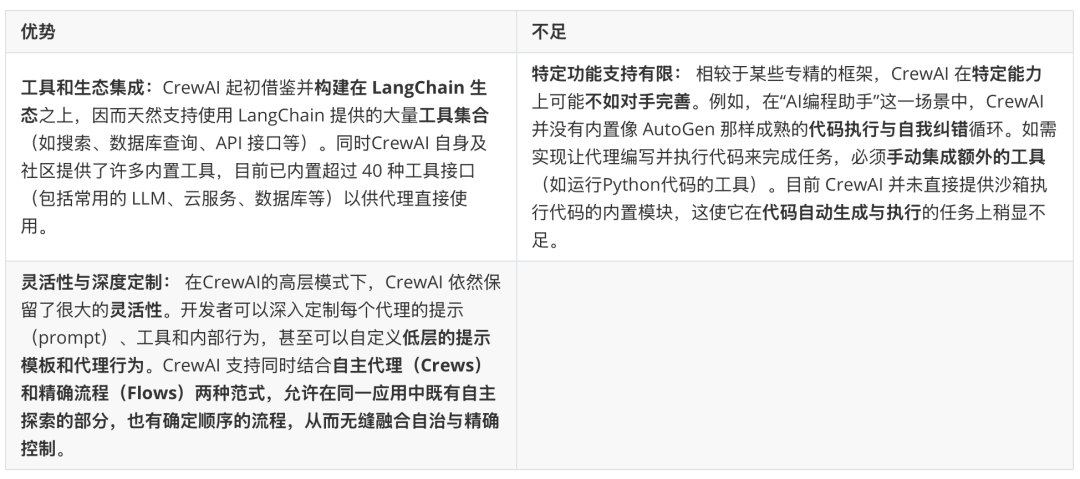

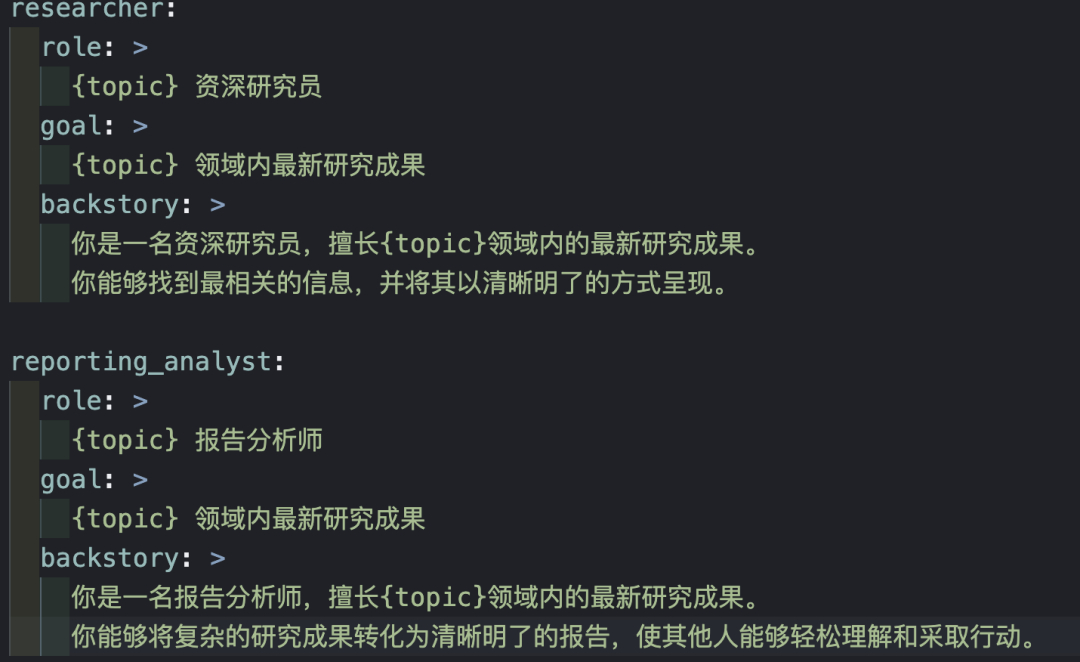

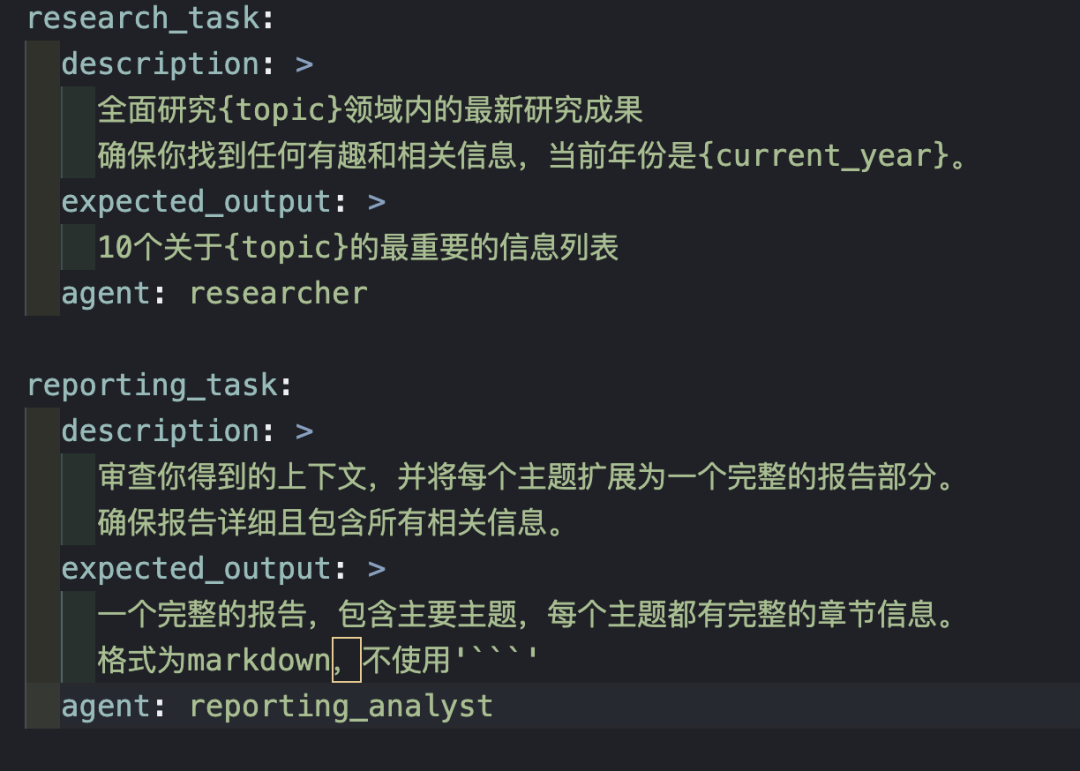

5.4CrewAI

简介:CrewAI 是一个多智能体(multi-agent)编排框架,其核心理念是让多个具备特定角色的 AI 代理协同合作(组成“crew”团队)来完成复杂任务。每个代理被赋予特定的角色、目标和背景知识,通过相互分工与配合,自动地进行任务委派和问询,最终以团队形式完成用户交给的工作。

主要特点:多工具及生态集成、支持Workflow和AI Agent两种模式

优势与不足:

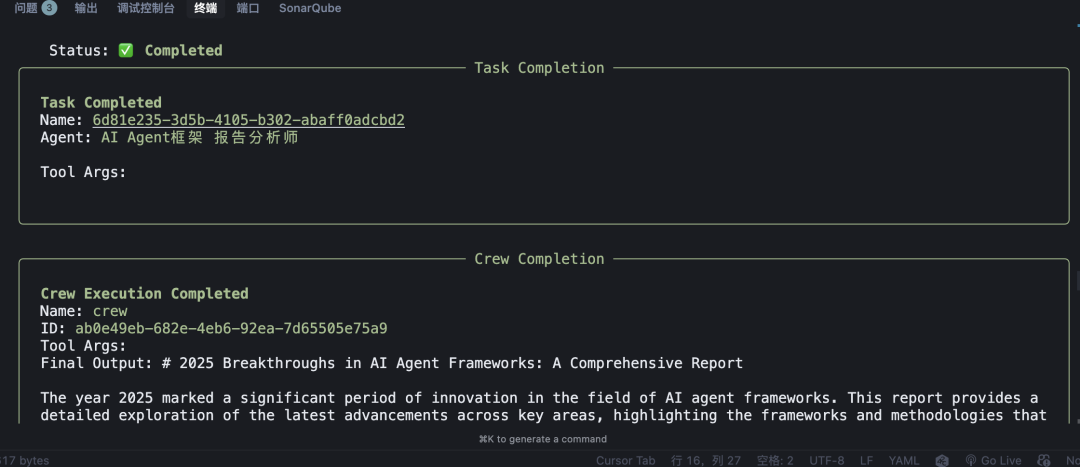

使用示例:研究AIagent领域的最新进展

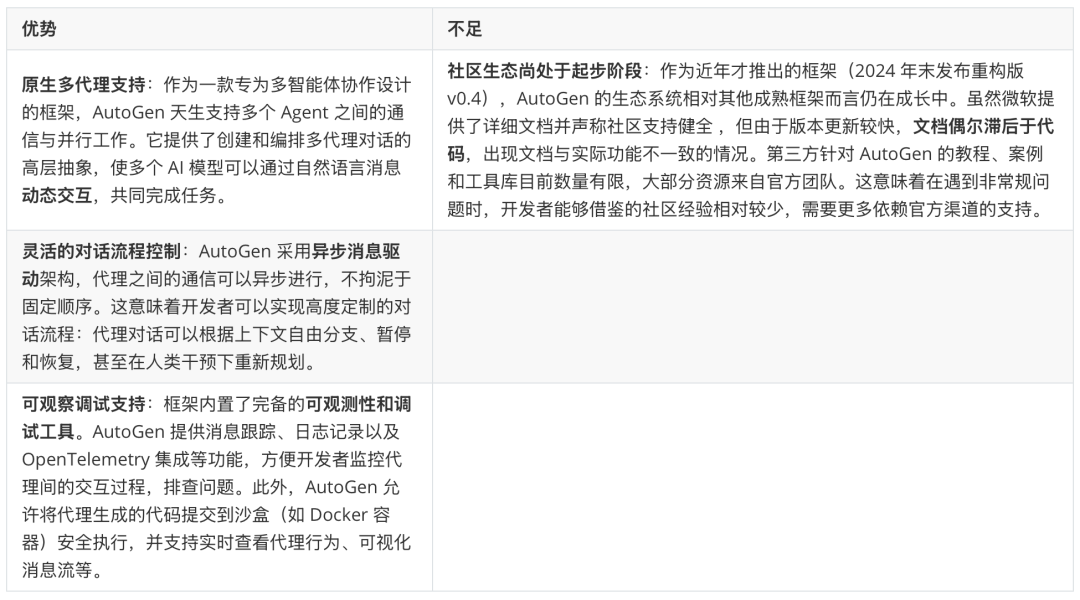

5.5AutoGen

简介:AutoGen 是微软开源的一个面向 Agentic AI(代理式人工智能)的编程框架,用于构建 AI 智能体并促进多个智能体协作完成复杂任务。AutoGen 支持事件驱动的分布式架构,具有良好的可扩展性和弹性,可用于搭建可自主行动或在人类监督下运行的多代理 AI 系统。

主要特点:微软开源、原生多Agent支持、灵活对话控制

优势与不足:

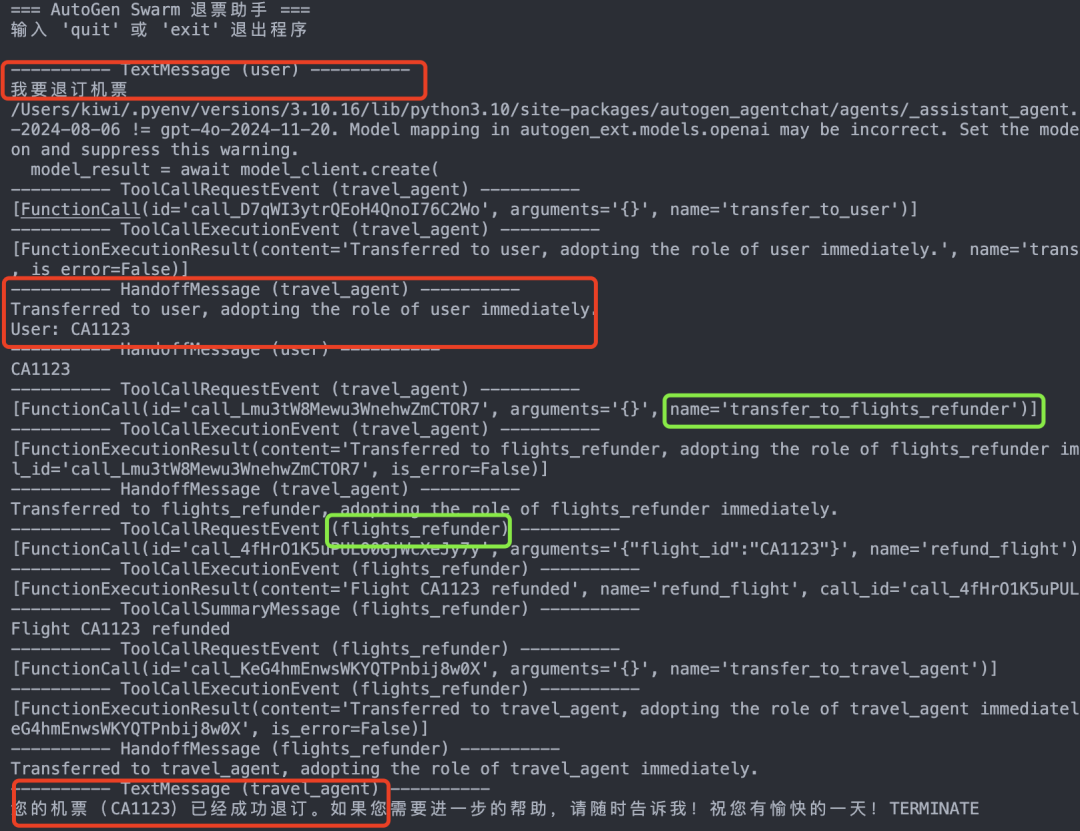

Swarm模式下的机票退订助手示例:

6.总结

本篇文章主要介绍了目前 WorkFlow 和 Agent 的区别,以及什么时候应该采用 Agent 框架:当问题复杂、长尾且多变,Agent 才是主力。同时也简要的介绍了目前几类框架如AutoGPT、LangGraph、Dify、CrewAI、AutoGen,希望能在技术路线的选择与框架选型上帮助到各位读者。

腾讯云TDAI(TencentDB AI Service,简称TDAI)团队也在积极探索数据库与 AI 的结合,并正式推出数据库AI服务,为赋予 Agent 长上下文理解与个性化交互能力,腾讯云在数据库AI服务中推出面向 Agent 记忆场景的产品——Agent Memory,负责存储、检索并管理历史交互信息,让AI能够记住并运用这些信息,从而在持续的互动中表现出更强的连贯性、上下文理解力和个性化服务能力。

可以看到,Agent 不只是新的技术名词,更是一种全新的思维方式——让智能系统从“执行命令”走向“理解目标”。未来,在复杂、多变的业务世界中,腾讯云TDAI团队将持续探索从底层存储、索引到记忆调用的完整链路能力,为客户提供 Agent 的基础组件,奠定AI转型的坚实起点。

如何高效转型Al大模型领域?

作为一名在一线互联网行业奋斗多年的老兵,我深知持续学习和进步的重要性,尤其是在复杂且深入的Al大模型开发领域。为什么精准学习如此关键?

- 系统的技术路线图:帮助你从入门到精通,明确所需掌握的知识点。

- 高效有序的学习路径:避免无效学习,节省时间,提升效率。

- 完整的知识体系:建立系统的知识框架,为职业发展打下坚实基础。

AI大模型从业者的核心竞争力

- 持续学习能力:Al技术日新月异,保持学习是关键。

- 跨领域思维:Al大模型需要结合业务场景,具备跨领域思考能力的从业者更受欢迎。

- 解决问题的能力:AI大模型的应用需要解决实际问题,你的编程经验将大放异彩。

以前总有人问我说:老师能不能帮我预测预测将来的风口在哪里?

现在没什么可说了,一定是Al;我们国家已经提出来:算力即国力!

未来已来,大模型在未来必然走向人类的生活中,无论你是前端,后端还是数据分析,都可以在这个领域上来,我还是那句话,在大语言AI模型时代,只要你有想法,你就有结果!只要你愿意去学习,你就能卷动的过别人!

现在,你需要的只是一份清晰的转型计划和一群志同道合的伙伴。作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

- 硬件选型

- 带你了解全球大模型

- 使用国产大模型服务

- 搭建 OpenAI 代理

- 热身:基于阿里云 PAI 部署 Stable Diffusion

- 在本地计算机运行大模型

- 大模型的私有化部署

- 基于 vLLM 部署大模型

- 案例:如何优雅地在阿里云私有部署开源大模型

- 部署一套开源 LLM 项目

- 内容安全

- 互联网信息服务算法备案

- …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献317条内容

已为社区贡献317条内容

所有评论(0)