RAG系统如何过“合规关”?PII脱敏、本地化部署与审计日志全解析

摘要:在企业部署RAG(检索增强生成)系统时,合规与隐私保护成为关键挑战。本文提出五大核心措施:1)文档摄入和用户查询双阶段PII识别与脱敏;2)全链路本地化部署确保数据不出境;3)完整审计日志记录并脱敏存储;4)禁用境外LLM并实施最小权限控制;5)定期合规演练。通过融合技术先进性与合规性,构建符合GDPR、个保法等要求的RAG系统,为金融、医疗等强监管行业提供安全的AI解决方案。(149字)

在企业大规模落地 RAG(Retrieval-Augmented Generation)系统的过程中,技术先进性已不再是唯一门槛,合规性与隐私保护正成为决定项目能否上线的关键。尤其在金融、医疗、政务等强监管行业,GDPR、个保法、等保2.0 等法规对用户数据的处理提出了严格要求。本文将围绕 敏感信息识别与脱敏、查询过滤策略、本地化部署架构、审计日志留存 以及 数据不出境控制 五大核心维度,详解如何构建一个既智能又合规的 RAG 系统。

一、为什么 RAG 必须重视合规与隐私?

RAG 系统的工作机制决定了其天然会接触两类高敏数据:用户输入的查询(Query) 和 企业内部知识文档(Context)。例如,用户可能在客服系统中输入“我的身份证号是110101199001011234,请问报销流程?”;知识库中也可能包含员工健康记录、客户合同、财务报表等。

若未做脱敏处理,这些数据在 Embedding 编码、向量存储、LLM 推理、日志记录 等环节均可能造成泄露。更严重的是,一旦使用境外 LLM(如 OpenAI、Claude),数据可能被传输至境外服务器,直接违反《数据出境安全评估办法》。

因此,合规不是“可选项”,而是 RAG 系统上线的“准入证”。

二、PII 识别与脱敏:从文档摄入到查询入口的双重防护

1. 文档摄入阶段脱敏

在将知识文档(如 PDF、Word、Confluence 页面)写入向量库前,必须进行 预处理脱敏。推荐使用 Microsoft Presidio 或 spaCy + 自定义规则,识别并替换身份证号、手机号、银行卡号、邮箱等 PII(Personally Identifiable Information)字段。

# 示例:调用 Presidio API 脱敏

from presidio_analyzer import AnalyzerEngine

from presidio_anonymizer import AnonymizerEngine

analyzer = AnalyzerEngine()

anonymizer = AnonymizerEngine()

text = "张三的手机号是13812345678,身份证号110101199001011234"

results = analyzer.analyze(text=text, language='zh')

anonymized = anonymizer.anonymize(text=text, analyzer_results=results)

# 输出:张三的手机号是<PHONE_NUMBER>,身份证号<ID>关键要求:脱敏后需保留语义完整性。例如将“138****5678”替换为“”优于直接删除,避免破坏上下文逻辑。

2. 用户查询阶段过滤

即使文档已脱敏,用户 Query 仍可能携带敏感信息。需在 RAG 服务入口层部署 实时过滤规则:

- 使用正则表达式匹配身份证、手机号、银行卡;

- 对匹配内容进行 **屏蔽(如替换为 ***)或拒绝请求**;

- 结合 Token 中的用户身份,限制高敏查询权限。

注意:脱敏后的 Query 仍需用于 Embedding 生成,确保检索准确性不受影响。

三、全链路本地化部署:数据不出内网的终极保障

为满足金融、医疗等行业“数据不出境”要求,RAG 必须实现 全栈私有化部署,涵盖以下组件:

- Embedding 模型:使用 BGE、text2vec 等开源中文模型,部署于企业 GPU 集群;

- 向量数据库:采用 Milvus、Weaviate 或 Elasticsearch,部署在 Kubernetes 集群中;

- 大语言模型(LLM):选用 Qwen、GLM、Baichuan、Yi 等国产开源模型,通过 vLLM 或 Triton 加速推理;

- 服务网关:通过 Nginx + OAuth2.0 实现权限透传与流量管控。

此类架构完全隔离外部依赖,杜绝数据外泄风险,同时支持等保三级认证所需的“边界防护”与“访问控制”。

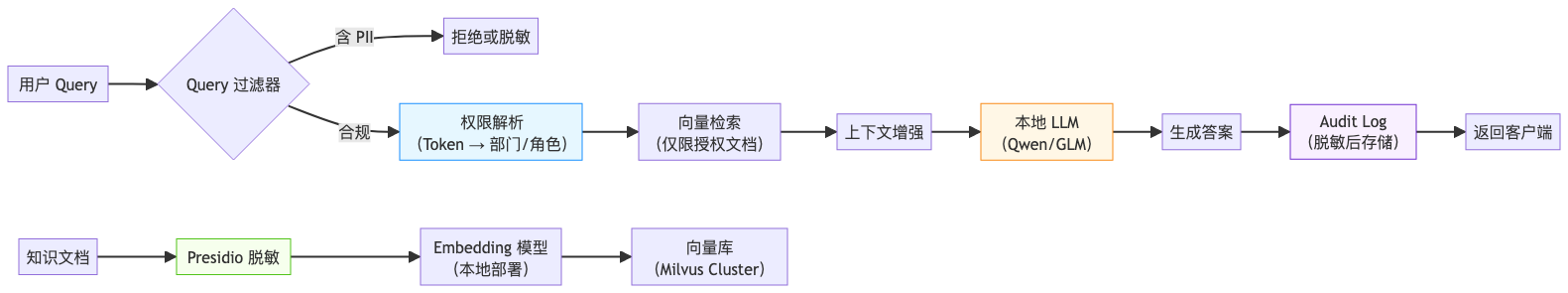

下图展示了合规 RAG 系统的核心数据流:

图中各环节均运行于企业内网,无任何外部 API 调用,满足最高等级数据安全要求。

四、审计日志:可追溯、可回溯、可追责

根据等保 2.0 要求,RAG 系统需 完整记录用户交互行为,并保留至少 180 天。日志应包含:

- 用户标识(脱敏后的 UserID 或 Token Hash)

- 原始 Query(经脱敏处理)

- 检索到的文档 ID 列表

- LLM 生成的最终答案(同样脱敏)

- 请求时间、耗时、状态码

关键点:日志中的 PII 必须二次脱敏,避免审计系统成为新的泄露源。建议使用 字段级加密 或 日志脱敏中间件(如 Fluentd 插件)。

此外,应通过 OpenTelemetry 将日志、指标、追踪统一接入企业 SIEM 平台,支持安全事件联动告警。

五、技术落地建议:从架构到运维的合规闭环

- 禁用境外 LLM:明确禁止调用 OpenAI、Anthropic 等 API,通过服务网格(如 Istio)拦截外联请求;

- 模型与数据同域部署:Embedding 模型、LLM、向量库均部署在同一 VPC,避免跨区域传输;

- 文档摄入幂等+版本快照:确保脱敏逻辑可回滚,支持数据一致性校验;

- 定期合规演练:模拟 PII 泄露场景,验证脱敏与审计机制有效性;

- 权限最小化原则:用户只能检索其所在部门/角色授权的知识子集。

六、结语:合规是 RAG 落地的“护城河”

在 AI 工程化浪潮中,技术能力决定上限,合规能力决定下限。一个忽视隐私保护的 RAG 系统,即便效果再好,也无法通过企业安全审查。通过 PII 识别脱敏、全链路本地化、审计日志闭环 等措施,我们不仅能满足 GDPR、个保法、等保等法规要求,更能赢得客户对 AI 系统的信任。

对于金融、医疗、政务等行业的开发者而言,构建合规 RAG 不仅是技术任务,更是业务刚需。只有将安全与智能深度融合,才能真正让大模型在企业基础设施中“放心跑、安心用”。

更多推荐

已为社区贡献58条内容

已为社区贡献58条内容

所有评论(0)