数据不够怎么办?新加坡国立大学揭秘扩散语言模型的“秘密武器”

新加坡国立大学研究发现,扩散语言模型(DLM)在有限数据下表现卓越,重复训练480次性能仍不饱和,数据潜力超自回归模型3倍,为破解AI“数据饥渴”难题提供新路径。

当大模型陷入“数据饥渴”,我们是否只能无止境地堆砌算力与语料?新加坡国立大学的最新研究给出了否定答案。

本期将深入解读其提出的扩散语言模型(DLM),揭示它如何在有限数据下实现比肩甚至超越自回归模型的性能——这不仅是一场技术路径的革新,更可能是破解当前AI训练数据瓶颈的关键密钥。

01前沿速递:追踪热点 赢在起点

ChatGPT:放大你的无知

LLMs are steroids for your Dunning-Kruger | ByteSauna

作者:gridentio

即使我承认这种幻觉,我也无法抗拒这些模型给我带来的那种美妙的确信感。

作为一名ChatGPT的用户,我常常感觉自己在对话后获得了许多知识,但实际上这些信息往往是不准确甚至错误的。Bertrand Russell曾说,愚蠢的人自信满满,而聪明的人则充满怀疑。ChatGPT让我感到一种虚假的安全感,即使我知道这种感觉是错的,我还是难以抗拒这种确认感。这种技术虽然看似简单,但实际上正在深刻地影响着我们的生活和工作。它让我们在不自觉中放大了自己的无知,而这种效应在长远来看可能会带来不可预知的后果。

Vibe Code的代价:AI辅助编程的反思

GitHub - jackdoe/pico2-swd-riscv

作者:jackdoe

当代码增长到大约四倍,从1000行到4000行时,我的对代码的理解完全消失了,随之而来的是对代码所有权的丧失。每个代码片段都变得毫无意义,阅读起来极其困难,因为每个代码片段都可以是完全无意义的。

这篇文章详细描述了作者使用AI辅助编程的经历。虽然AI大大提高了代码生成的速度,但随之而来的是一系列令人困扰的问题,如代码可读性下降和失去编程的成就感。作者通过自己的实验,揭示了AI编程带来的深层思考:代码的‘味道’和人类编程的直觉在AI辅助下变得模糊不清。

费菲·李:空间智能,开启AI新纪元

https://drfeifei.substack.com/p/from-words-to-worlds-spatial-intelligence

作者:mkirchner

Spatial Intelligence is the scaffolding upon which our cognition is built.

在1950年,当计算机还仅仅局限于自动化算术和简单逻辑时,图灵提出了一个至今仍回响的问题:机器能否思考?这一问题激发了人工智能的研究。作为AI领域的一员,我对图灵的愿景依然充满灵感。然而,我们究竟离这一目标有多近?答案并不简单。如今,大型语言模型已经开始改变我们获取和处理抽象知识的方式,但它们仍然是在黑暗中挥舞着语言的高手,尽管口才了得,却缺乏实践经验。空间智能将彻底改变我们如何创造和互动于现实与虚拟世界,重塑故事讲述、创造力、机器人技术、科学发现等领域。这是AI的下一个前沿。我的研究生涯始终围绕视觉和空间智能展开,这促使我构建了ImageNet,这一大型视觉学习和基准数据集,以及World Labs,旨在实现这一潜力。空间智能在定义我们与物理世界互动方式中扮演着基础角色。无论是停车、接住飞来的钥匙,还是在拥挤的人行道上穿梭,我们都在利用空间智能。它也是我们想象力和创造力的基础。无论是建造沙堡还是玩Minecraft,空间感都是创造体验的关键。而AI目前在理解与赋能人类创作者方面仍有许多不足。空间智能是构建认知的基础,无论是被动观察还是主动创造,它都驱动着我们的推理和规划,甚至在最抽象的话题上也是如此。然而,今天的AI尚未达到这一水平。尽管取得了巨大进展,但AI的空间能力仍远不及人类。空间智能是连接想象、感知和行动的桥梁,是推动人类社会进步的关键。如何构建空间智能的AI?我们如何让AI具备像Eratosthenes那样的视觉推理能力,像工业设计师那样精确地进行工程设计,像讲故事者那样富有创造力,以及像急救人员那样流畅地与环境互动?这需要超越语言的模型——世界模型,一种能够理解和处理复杂虚拟或现实世界的生成模型。

02每周论文:洞察本质 预见未来

深入最新学术研究,甄选具有实用价值或范式突破的顶尖论文。将复杂的学术语言提炼为可操作的洞见,为深度研究提供参考。

利用视频进行思考:视频生成作为一种有前景的多模态推理范式

https://huggingface.co/papers/2511.04570

作者:Jingqi Tong,牟玉蓉,李航城,李明哲,Yongzhuo Yang,张明,Qiguang Chen,Tianyi Liang,Xiaomeng Hu,Yining Zheng,Xinchi Chen,Jun Zhao,Xuanjing Huang,Xipeng Qiu

视频生成模型是潜在的统一跨模态理解和生成模型,将“用视频思考”定位为统一的跨模态推理范式。

“用文本思考”和用“图像思考”范式显著提升了大型语言模型(LLMs)和视觉语言模型(VLMs)的推理能力。然而,这些范式存在固有局限性:(1)图像仅捕捉单一时刻,无法表示动态过程或连续变化;(2)文本和视觉作为独立模态的分离,阻碍了统一的跨模态理解和生成。为克服这些局限性,我们引入“用视频思考”这一新范式,利用视频生成模型(如Sora-2)在统一的时间框架内连接视觉和文本推理。为支持这一探索,我们开发了视频思考基准(VideoThinkBench),包含两大任务类别:(1)以视觉为中心的任务(如Eyeballing Puzzles),(2)以文本为中心的任务(如GSM8K、MMMU的子集)。评估表明,Sora-2是一个强大的推理者。在以视觉为中心的任务中,Sora-2通常与最先进的(SOTA)VLMs相当,甚至在某些任务(如Eyeballing Games)上超越VLMs。在以文本为中心的任务中,Sora-2在MATH上达到92%的准确率,在MMMU上达到75.53%的准确率。此外,我们系统地分析了这些能力来源。我们还发现,自洽性和情境学习可以提高Sora-2的性能。总之,我们的研究证明,视频生成模型是潜在的统一跨模态理解和生成模型,将“用视频思考”定位为统一的跨模态推理范式。

扩散语言模型是超级数据学习器

https://huggingface.co/papers/2511.03276

作者:倪金杰,刘谦,Longxu Dou,杜超,王自力,杭彦,庞天宇,谢启哲

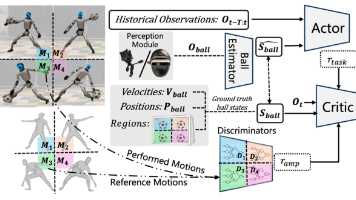

在数据限制下,输入或参数噪声可以提高AR模型的性能,但不能缩小差距。

在严格控制下的预训练设置中,我们观察到一种交叉现象:当独特数据有限时,扩散语言模型(DLMs)在训练更多轮次后始终超越自回归(AR)模型。这种交叉现象随着更多或更高质量的数据而推迟,随着更大模型的规模而提前,并且跨越密集和稀疏架构而持续存在。我们将这些收益归因于三个复合因素:(1)任意顺序建模,(2)来自迭代双向去噪的超密集计算,(3)内置的蒙特卡洛增强;在数据限制下,输入或参数噪声可以提高AR模型的性能,但不能缩小差距。在规模上,一个1.7B的DLM使用~1.5T-token的计算预算在10B个独特的Python token上训练,超越了在严格匹配设置下训练的AR编码器。此外,一个1B参数的DLM使用仅1B token就在HellaSwag上达到>56%的准确率,在MMLU上达到>33%,没有任何特殊技巧,只是通过重复标准的预训练数据。我们还表明,在这种情况下,验证交叉熵的上升并不意味着下游性能的下降。

V-Thinker:以图像进行交互式思考

https://huggingface.co/papers/2511.04460

作者:Runqi Qiao,谭秋娜,Minghan Yang,董官廷,Peiqing Yang,Shiqiang Lang,万恩惠,Xiaowan Wang,徐义达,蓝阳,崇孙,陈莉,张洪刚

V-Thinker通过端到端的强化学习实现交互式、以视觉为中心的思考,包含数据进化飞轮和视觉渐进式训练课程两个关键组件。

赋能大型多模态模型(LMMs)深入整合图像交互与长时程推理能力一直是该领域的长期挑战。近期以视觉为中心的推理进展探索了一种有前景的“以图像进行思考”范式,使LMMs从图像辅助推理转向图像交互式思考。虽然这一里程碑使模型能够关注细粒度图像区域,但进展仍受限于有限的视觉工具空间和特定任务的流程设计。为弥补这一差距,我们提出了V-Thinker,一个通用的多模态推理助手,通过端到端的强化学习实现交互式、以视觉为中心的思考。V-Thinker包含两个关键组件:(1)数据进化飞轮,自动合成、演化和验证交互式推理数据集,涵盖多样性、质量和难度三个维度;(2)视觉渐进式训练课程,首先通过点级监督对感知进行对齐,然后通过两阶段强化学习框架整合交互式推理。此外,我们引入了VTBench,一个专家验证的基准,针对以视觉为中心的交互式推理任务。大量实验表明,V-Thinker在一般和交互式推理场景中始终优于强大的LMM基线,为推进图像交互式推理应用提供了宝贵见解。

通过经验合成扩展智能体学习

https://huggingface.co/papers/2511.03773

作者:Zhaorun Chen,Zhuokai Zhao,张凯,刘波,琪琪,吴一凡,塔伦·卡鲁里,曹莎拉,Yuanhao Xiong,童海波,Huaxiu Yao,李亨多,Jiacheng Zhu,李贤,晨歌,李波,杰森·韦斯顿,Dat Huynh

DreamGym通过推理式经验模型合成多样化的经验,显著提高了RL训练的有效性,并在模拟到真实转移场景中实现了显著的性能提升。

强化学习(RL)可以通过交互使大型语言模型(LLM)智能体实现自我改进,但其实际应用仍然面临挑战,因为昂贵的滚动部署、有限的任务多样性、不可靠的奖励信号和基础设施复杂性都阻碍了可扩展经验数据的收集。为了解决这些挑战,我们引入DreamGym,这是一个统一的框架,旨在合成多样化的、可扩展的经验,以实现自主智能体的有效在线RL训练。DreamGym不是依赖于昂贵的真实环境滚动部署,而是将环境动态蒸馏到一个推理式经验模型中,通过逐步推理推导出一致的状态转换和反馈信号,从而实现可扩展的智能体滚动部署收集用于RL。为了提高转换的稳定性和质量,DreamGym利用一个初始化为离线真实世界数据的经验重放缓冲区,并持续用新的交互来丰富它,以积极支持智能体训练。为了提高知识获取,DreamGym自适应地生成新的任务来挑战当前智能体策略,从而实现更有效的在线课程学习。跨不同环境和智能体主干的实验表明,DreamGym显著提高了RL训练,无论是在完全合成设置还是在模拟到真实转移场景中。在像WebArena这样的非RL就绪任务中,DreamGym比所有基线指标高出30%以上。在RL就绪但昂贵的设置中,它仅使用合成交互就达到了GRPO和PPO的性能。当将纯合成经验训练的策略转移到真实环境RL时,DreamGym在需要远少于真实世界交互的情况下实现了显著的额外性能提升,为通用RL提供了一种可扩展的预热启动策略。

03产品推荐:利器在手 提升效能

发掘能够切实提升开发效率的开源利器与生产力工具。聚焦简化工作流、优化项目部署,将时间投入到更具创造性的环节。

Davia: 代码自动生成文档

GitHub - davialabs/davia: Documentation that writes itself

作者:ruben-davia

Davia能够自动为你的代码库生成交互式内部文档,大大简化了文档维护的工作,提高了开发效率。

Davia是一款开源工具,能够自动为你的代码库生成交互式内部文档。只需指向项目路径,Davia就会生成本地文档文件,并提供交互式可视化编辑功能,可以在Notion风格的平台或本地IDE中编辑。无论是项目维护还是团队协作,Davia都能提供极大的便利,帮助你轻松管理代码文档。

Instagram Story Viewer: 匿名观看神器

Instagram Story Viewer: Watch Stories Anonymously & Free | No Login

作者:deep_signal

通过 Instagram Story Viewer,您可以匿名访问和下载公共 Instagram 内容,无需登录,确保您的研究和分析过程完全保密。

Instagram Story Viewer 是一款完全免费的匿名Instagram故事查看工具,无需登录即可访问和下载公共 Instagram 内容。它提供了高质量的一键下载、多设备支持和严格的隐私保护,帮助营销人员、创意者和研究人员高效地收集和分析内容,而无需泄露身份。

Akamas Insights: AI驱动的Kubernetes优化

Akamas Insights: AI-Driven Kubernetes Optimization

作者:enricobruschini

‘Observability gave teams visibility; Akamas turns that visibility into actions。’——Enrico Bruschini, COO of Akamas

Akamas Insights是Akamas平台的最新模块,利用AI技术自动检测Kubernetes环境中的成本效率和可靠性风险,并提供可立即应用的优化建议。它帮助开发者、SRE和平台工程师实现协作优化,提高性能和降低成本。Akamas Insights通过分析现有的可观测性工具数据,为团队提供清晰的优先级和可衡量的改进,解决传统优化流程中的痛点,使优化过程变得轻松和高效。

从“数据依赖”到“数据效率”,扩散语言模型为我们打开了一扇新的大门。这项研究提醒我们:在追逐更大参数、更多数据的浪潮中,或许还存在更聪明、更可持续的模型演进路径。LLaMA-Factory Online认为,技术的本质并非盲目堆砌,而在于以更集约的方式,释放每一份数据的最大潜能。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)