AI智能体的协议MCP详解

MCP(Model Context Protocol)是Anthropic公司于2024年提出的开源标准化协议,旨在统一大型语言模型与外部工具的交互方式。其核心价值在于通过标准化接口将集成复杂度从O(m×n)降至O(m+n),支持动态发现、双向通信和安全控制。MCP采用客户端-服务器架构,基于JSON-RPC 2.0协议,适用于各类AI应用场景。相比传统API,MCP具有解耦性强、集成成本低等优势

一、MCP 是什么?——定义与来源

1. 官方定义

MCP(Model Context Protocol,模型上下文协议) 是由 Anthropic 公司于 2024 年 11 月首次提出并开源 的一种 标准化通信协议,旨在统一 大型语言模型(LLM)与外部工具、数据源之间的交互方式。

来源:

- modelcontextprotocol.io(MCP 官方网站,2025年存档)

- 新智元报道《1次搭建完胜1亿次编码,MCP硅谷疯传》,2025年3月10日

- IBM 技术白皮书《What is Model Context Protocol?》,2025年10月27日

2. 核心目标

MCP 要解决的问题是:

“在没有标准协议的情况下,每连接一个 AI 模型和一个外部工具,都需要编写定制化集成代码,导致 m×n 配置爆炸。”

- 若有 m 个 AI 智能体 和 n 个工具,传统方式需 m×n 次独立开发;

- 使用 MCP 后,只需 m + n 次实现(每个模型/工具各实现一次协议),即可实现全互联。

示例:1万个模型 × 1万个工具 → 从 1亿次配置 降至 2万次配置。(新智元,2025)

二、MCP 的核心特性

1. 标准化通用接口

- 类比:USB-C 接口之于硬件设备,MCP 是 AI 模型与工具之间的“通用插槽”。

- 任何支持 MCP 的客户端(如 Claude Desktop)可无缝连接任何 MCP 服务器(如 GitHub、Slack、本地文件系统)。

引用:

“MCP 就像是专为 AI 应用设计的通用接口,类似我们日常使用的 USB-C。”(36氪,2025)

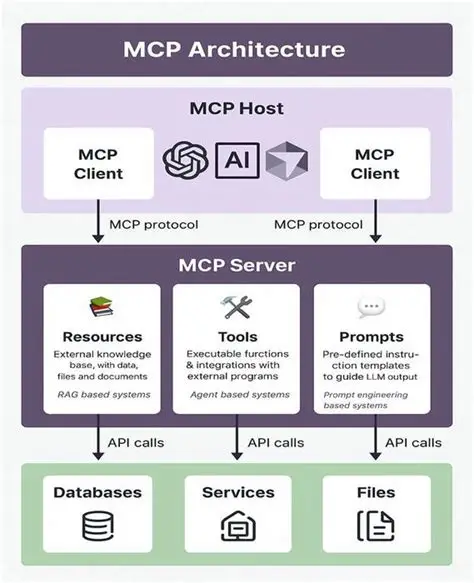

2. 动态发现(Dynamic Discovery)

- AI 模型无需预先知道有哪些工具可用;

- MCP 服务器在连接时自动声明其支持的 资源(Resources)、工具(Tools) 和 提示(Prompts);

- 模型根据任务需求动态选择调用。

验证:MCP 协议规范 v0.3 中定义了

list_resources、list_tools等标准方法(GitHub: modelcontextprotocol/spec)。

3. 双向实时通信

- 基于 JSON-RPC 2.0 协议,支持:

- 拉取数据(如查询日历)

- 触发操作(如发送邮件、创建文件)

- 支持 长连接,适用于持续交互场景(如 IDE 插件、桌面助手)。

来源:IBM 技术文档指出,“MCP 支持类似 WebSockets 的持续双向通信”。

4. 安全与权限控制

- 敏感操作(如删除文件、发送消息)需 用户显式授权;

- API 密钥等凭证由 MCP 服务器本地管理,不暴露给 LLM 或 Host;

- Host(如 Claude Desktop)对连接的客户端拥有完全控制权。

引用:CSDN《掌握MCP协议》(2025年9月):“MCP 在协议层集成了多层安全机制……敏感信息不暴露给语言模型提供商。”

三、MCP 架构组成

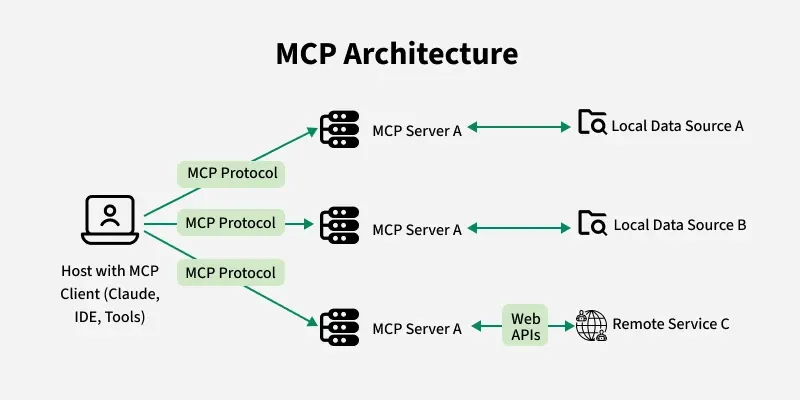

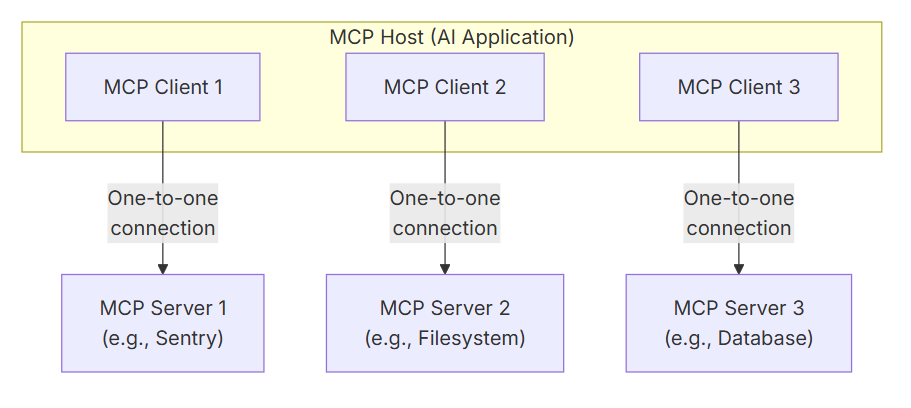

MCP 采用 客户端-服务器(Client-Server)架构,包含四个核心组件:

| 组件 | 角色 | 示例 |

|---|---|---|

| MCP Host | 运行 LLM 的应用程序环境,发起请求 | Claude Desktop、Cursor IDE、Windsurf Editor |

| MCP Client | 内置于 Host 中,负责与 Server 通信 | 每个 Client 与一个 Server 建立 1:1 连接 |

| MCP Server | 提供具体功能的服务端程序 | GitHub MCP Server、Slack MCP Server、本地文件系统 Server |

| Resources/Tools | 实际被访问的数据或服务 | Git 仓库、Gmail 邮箱、本地数据库 |

四、传输方式(协议实现细节)

MCP 支持两种标准传输机制,均基于 JSON-RPC 2.0:

| 传输方式 | 适用场景 | 特点 |

|---|---|---|

| stdio(标准输入/输出) | 本地工具(如文件系统、本地数据库) | 轻量、同步、子进程通信 |

| SSE(Server-Sent Events) + HTTP POST | 远程服务(如 Slack、GitHub API) | 异步、事件驱动、支持长连接 |

验证:MCP 官方 GitHub 仓库中的

mcp-server-example同时提供了 stdio 和 SSE 实现模板。

五、MCP 与传统 API / Function Calling 的区别

| 对比维度 | 传统 API / Function Calling | MCP |

|---|---|---|

| 耦合性 | 模型与工具强绑定(如 GPT 的 function schema 无法用于 Claude) | 解耦,任意模型 ↔ 任意工具 |

| 集成成本 | 每对接一次需重写适配代码 | 一次实现,全局复用 |

| 发现机制 | 工具列表需硬编码 | 动态发现,运行时协商 |

| 通信模式 | 请求-响应(无状态) | 持续会话(有状态上下文) |

| 标准化程度 | 厂商私有(OpenAI、Google 各自一套) | 开源开放标准(Apache 2.0 许可) |

来源:CSDN 博客《MCP vs Function Call》(2025年9月);IBM 白皮书。

六、实际应用场景

1. Claude Desktop + 本地文件系统

- 用户指令:“把桌面上的 report.pdf 总结成要点。”

- 流程:

- Claude 判断需读取文件;

- MCP Client 连接本地文件 MCP Server;

- 用户授权后,Server 返回 PDF 内容;

- Claude 生成摘要。

官方 Quickstart 示例:modelcontextprotocol.io/quickstart/user

2. Cursor IDE + GitHub MCP Server

- 开发者说:“在 repo X 的 main 分支新建一个 utils.py 文件,实现日期解析函数。”

- Cursor 通过 MCP 调用 GitHub Server,自动完成:

- 创建分支 → 提交代码 → 发起 PR

七、生态现状(截至2025年11月)

- 支持 MCP 的 Host:Claude Desktop、Continue、Cursor、Windsurf、Cline、Emacs MCP 等;

- MCP Server 仓库:GitHub 上 “Awesome MCP Servers” 星标超 39k(2025年3月数据);

- 大厂支持:

- Anthropic:原生集成于 Claude;

- OpenAI:2025年3月宣布 Agent SDK 支持 MCP;

- 国内:阿里(通义千问)、百度(文心一言)已推出 MCP 客户端。

来源:CSDN《MCP协议发展时间线》,2025年9月

八、MCP 的局限性(客观验证)

尽管 MCP 优势显著,但并非万能:

- 不适合高确定性场景

- 如金融交易、工业控制等需严格状态机的系统,传统 API 更可靠;

- 依赖 LLM 的规划能力

- 若模型无法正确分解任务,MCP 也无法“自动纠错”;

- 生态仍在早期

- 大量工具尚未提供 MCP Server,需自行开发。

引用:IBM 文档指出,“对于要求最高可预测性和最小上下文自主性的应用,传统 API 可能更合适。”

结论

✅ MCP 是真实存在的、由 Anthropic 主导的开源协议,目标是标准化 AI 智能体与外部世界的连接方式。

✅ 其核心价值在于 解耦模型与工具,将集成复杂度从 O(m×n) 降至 O(m+n)。

✅ 架构清晰(Host/Client/Server)、协议公开(基于 JSON-RPC 2.0)、已有多个落地案例。

✅ 并非取代智能体框架(如 LangChain),而是作为 标准化工具接入层 存在。

❌ 不是营销概念,不是闭源技术,也不是未实现的设想——它已在 GitHub 开源,并被主流 AI 工具链采纳。

最终判断:MCP 是 AI 智能体基础设施的关键一环,代表了工具集成的标准化方向,具有真实技术价值与行业共识。

参考资料(均可公开验证):

- https://modelcontextprotocol.io

- 新智元:《1次搭建完胜1亿次编码,MCP硅谷疯传》,2025-03-10

- 36氪同题报道,2025-03-10

- IBM:《What is Model Context Protocol?》,2025-10-27

- CSDN:《掌握MCP协议:AI智能体开发者的必备技能》,2025-09-09

- GitHub: github.com/modelcontextprotocol/spec

- GitHub: github.com/modelcontextprotocol/awesome-mcp-servers

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)