AI的下半场:智能体(Agent)如何引领应用领域的革命性变革!

AI智能体是能代表用户独立完成任务的高级AI系统,具有LLM驱动决策、工具使用能力和安全边界三大特征。它与传统LLM应用的最大区别在于不仅会"说",更会"做"。构建智能体需要模型、工具和指令三大要素,可选择单智能体或多智能体编排模式。未来每个企业和岗位都将拥有自己的"数字助手",理解智能体原理是进入AI工作流时代的第一步。

过去两年,“AI智能体(AI Agent)”这个词频频出现在各种会议和论文中。有人说它是“下一个操作系统”,有人说它将“重塑所有应用”。但在喧嚣背后,真正懂智能体逻辑的人却不多。

今天这篇文章,我们不讲空洞概念,而是带你从底层原理到落地实践,彻底弄清楚:

- 智能体到底是什么?

- 为什么现在是构建它的最好时机?

- 如何一步步设计、编排和安全运行一个Agent?

- 最后,我们还将用 LangGraph 框架写一个可直接运行的最小智能体示例。

一、什么是智能体(Agent)?

1. 核心定义

智能体(Agent)是一个能够代表用户,以高度独立性完成任务(Workflow) 的系统。它能理解用户目标,自主选择行动路径,并利用外部工具执行任务。

简单来说,它是“能帮你做事的AI”,而不仅仅是“能和你聊天的AI”。

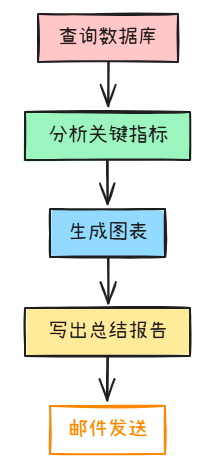

比如你告诉它“帮我分析最新销售数据,并生成周报”,它不会仅仅生成报告模板,而会:

1.查询数据库 → 2. 分析关键指标 → 3. 生成图表 → 4. 写出总结报告 → 5. 邮件发送。

这就是一个完整的 Agent工作流闭环。

2. 与传统LLM应用的区别

很多人把一个能回答问题的聊天机器人当成智能体,这其实是个误区。

智能体与普通LLM应用最大的区别在于:

| 项目 | 普通LLM应用 | 智能体(Agent) |

|---|---|---|

| 核心能力 | 生成文本回答 | 完成任务与执行工作流 |

| 决策方式 | 静态、被动响应 | 动态、主动决策 |

| 工具调用 | 通常无 | 可调用外部API、数据库、系统 |

| 状态管理 | 单轮 | 多轮、自主状态追踪 |

| 错误处理 | 无反馈 | 能主动识别并纠错 |

真正的Agent不仅会“说”,更会“做”。

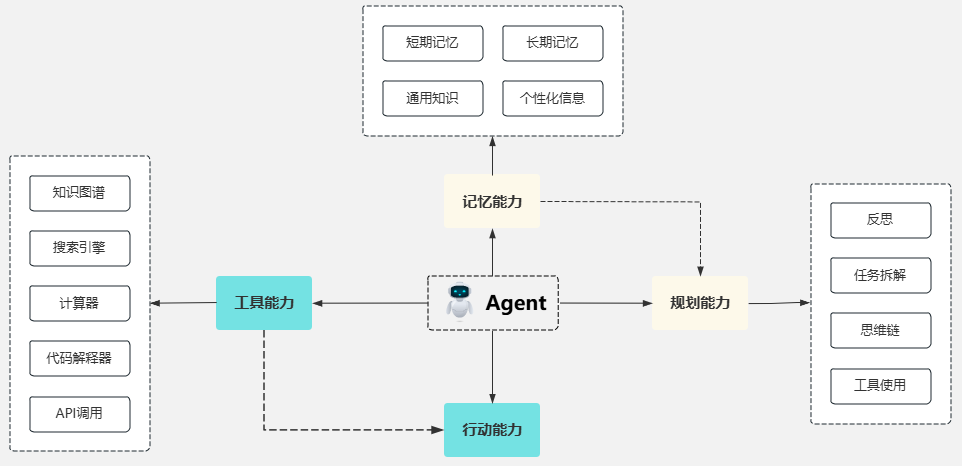

3. 智能体的三大特征

(1)LLM驱动决策

智能体的“大脑”是LLM(如GPT、Claude、DeepSeek等),它会持续判断:

- 当前任务是否完成;

- 哪个工具最合适;

- 结果是否异常;

- 失败时是否应重试或终止。

(2)具备工具使用能力

它能访问数据库、API、文件系统、甚至调用其他Agent。

工具就像智能体的“手脚”,赋予它真正的行动力。

(3)运行在安全护栏之内

智能体在设计上必须有“边界”——确保不会调用危险API、不会泄露隐私数据,也不会乱执行高风险操作。

二、何时应该构建智能体?

一个非常实用的判断标准是:

如果问题可以用规则穷尽描述,就不要用Agent;如果问题充满模糊性和上下文判断,那就该考虑Agent。

典型场景举例:支付欺诈分析

传统规则引擎就像一份“条件清单”:

若金额>10,000 且 IP 异常 → 触发警报。

但智能体像一个经验丰富的调查员,它能结合交易时间、用户历史行为、语言描述等上下文因素做综合判断。即使数据没有明显异常,它也能感知出“可疑”的行为模式。

这种场景下,规则系统会“漏判”,而Agent能“察觉”。

三、智能体设计基础

一个标准的Agent系统由三部分组成:

- 模型(Model):负责理解任务、推理与决策。

- 工具(Tools):让Agent能与外界交互(如数据库、API、文件系统)。

- 指令(Instructions):定义Agent该如何执行工作流。

我们先看一个结构化示例:

# 以LangGraph为例

from langgraph.graph import StateGraph, END

from langchain_community.llms import ChatOpenAI

llm = ChatOpenAI(model="gpt-4o-mini")

# 定义最小状态

class AgentState:

task: str

result: str | None

# 定义执行节点

def do_task(state: AgentState):

response = llm.invoke(f"帮我完成这个任务: {state.task}")

return AgentState(task=state.task, result=response.content)

# 构建智能体图

graph = StateGraph(AgentState)

graph.add_node("executor", do_task)

graph.set_entry_point("executor")

graph.add_edge("executor", END)

app = graph.compile()

# 测试运行

print(app.invoke(AgentState(task="生成一份销售周报")).result)

这就是一个最小可运行的智能体雏形:

你输入一个任务,它会自动调用大模型完成整个流程。

四、核心组件详解

1. 模型选择(Selecting your models)

智能体的核心是LLM,而不是盲目追求“最强模型”。

选择模型的关键在于平衡准确率、速度与成本:

- 原型阶段:先用顶级模型(如GPT-4、Claude 3)打样,验证逻辑;

- 优化阶段:用更小模型(如DeepSeek-R1、Qwen2.5)替代部分流程;

- 生产阶段:按任务类型动态调度不同模型。

实用建议:

- 对每类任务建立性能评估指标;

- 保证关键节点高质量;

- 用小模型优化边缘任务。

2. 定义工具(Defining Tools)

智能体真正的价值来自它能“动手”。

工具可分三类:

| 类型 | 作用 | 示例 |

|---|---|---|

| 数据工具 | 检索信息 | 数据库查询、PDF解析、网页搜索 |

| 行动工具 | 执行操作 | 发送邮件、更新CRM、生成报告 |

| 编排工具 | 控制流程 | 调用其他Agent,协同任务 |

最佳实践:

- 工具必须接口清晰、有文档、有测试;

- 输出格式要标准化;

- 工具可复用、可组合。

例如,我们定义一个工具来查询本地文件内容:

from langchain.tools import tool

@tool

def read_local_file(filename: str):

"""读取指定文件内容"""

with open(filename, 'r', encoding='utf-8') as f:

return f.read()

然后在智能体中调用:

content = read_local_file("sales_data.txt")

llm.invoke(f"请根据以下内容生成分析报告:\n{content}")

3. 配置指令(Configuring Instructions)

Prompt(提示词)是智能体的“行动指南”。

好的指令能让Agent变得“稳、准、懂边界”。

编写技巧:

- 从已有的业务文档或标准流程出发;

- 将复杂任务拆分为明确步骤;

- 明确定义每一步的输出;

- 考虑边缘场景与异常处理。

例如,生成财务报告的指令可以这样写:

instructions = """

你是一个财务分析智能体,目标是基于销售数据生成一份分析报告。

步骤:

1. 读取销售数据。

2. 提取关键指标(销售额、利润、成本)。

3. 识别趋势并分析原因。

4. 输出一份结构化报告(标题、摘要、图表建议、结论)。

"""

五、智能体的编排模式(Orchestration)

编排,就是智能体的“组织架构”。

1. 单智能体系统(Single-agent system)

最基础的形态:一个Agent、多个工具,在循环中执行任务。

优点:

- 简单;

- 易维护;

- 适合小规模自动化。

典型代码:

while not task_done:

next_action = llm.invoke(f"当前任务状态:{state},下一步应该执行什么?")

execute_tool(next_action)

2. 多智能体系统(Multi-agent system)

当任务过于复杂,就需要“团队作战”。

两种模式:

(1)管理者模式(Manager Pattern)

一个中央智能体(Manager)统筹多个子智能体。

比如:翻译Agent、分析Agent、报告Agent。

from langgraph.graph import StateGraph, END

def manager(state):

task_type = llm.invoke(f"请判断任务类型: {state.task}")

if "翻译" in task_type:

return AgentState(task="翻译", result=translator.invoke(state))

elif "分析" in task_type:

return AgentState(task="分析", result=analyzer.invoke(state))

else:

return AgentState(task=state.task, result="任务不匹配")

graph = StateGraph(AgentState)

graph.add_node("manager", manager)

graph.set_entry_point("manager")

graph.add_edge("manager", END)

(2)去中心化模式(Decentralized Pattern)

每个智能体都是独立节点,通过“移交(Handoff)”机制相互协作。

例如客服系统中,分流Agent判断问题类型后,将任务转交给售后或技术支持Agent。

六、护栏体系(Guardrails)

没有护栏的智能体,就像无人驾驶汽车没刹车。

护栏的作用是限制智能体的行为边界,确保安全、合规、稳定。

常见类型:

- 安全分类器:检测越狱、提示注入;

- PII过滤器:防止隐私泄露;

- 工具安全分级:限制高风险操作;

- 输出验证:确保生成内容合法;

- 人工干预触发器:在失败或高风险任务时让人类接管。

在LangGraph中,我们可以这样实现:

def pii_filter(output):

if "身份证" in output or "手机号" in output:

raise ValueError("检测到敏感信息,输出被拦截。")

return output

每次模型输出后执行该函数即可形成安全闭环。

智能体的本质,不是聊天,而是行动。

它能在模糊场景中理解目标、做出判断、执行步骤、纠错反馈,最终帮人类完成工作。

构建智能体的正确路线图是:

- 打好三要素基础(模型、工具、指令);

- 选择适合的编排模式(单体或多体);

- 构建安全护栏;

- 小步迭代、持续验证。

未来每一个企业、每一个岗位,都会有属于自己的“数字助手”。

而理解今天的这些原理,就是你通向“AI工作流时代”的第一步。

七、如何学习AI大模型?

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献530条内容

已为社区贡献530条内容

所有评论(0)