螳螂拳真传与AI幻觉:兼论“智能”与“教育”的底层逻辑

梁敬彬梁敬弘兄弟出品

0. 螳螂演实战,AI吐虚幻

在中国的武学传奇里,有一门拳法,叫“螳螂拳”。

它的起源故事极富启发性:一位武师(王朗)在与人比武失败后,于山林中静思。他没有去书斋里“卷”已有的拳谱,而是**“主动”在“大自然”这个真实环境中,观察到了一只螳螂“实时”捕蝉的战斗姿态。

他被这种小生物的搏击技巧所震撼,进而模仿、提炼、归纳,最终“进化”出了自己的武学体系——螳螂拳。

这个故事,完美地诠释了一个“智能体”(人类)是如何通过“主动学习”和“自我进化”来掌握“真传”的。

这也暴露了当下AI大模型架构的第一个,也是最根本的缺失:创造性的缺失。 武师王朗,是在“主动”发现问题、“主动”去观察螳螂。而AI的大模型架构,根本不会主动去思考“我该如何精进”,它更不会“主动”产生“去观察螳螂”的好奇心。它善于“解答”,却不善于“发现”。

这几天,我们一直在思考:退一步讲,即便我们“喂”给它这个任务:“请你创造一门螳螂拳。”会发生什么?

结果取决于它“读过”什么:

如果它压根没读过“螳螂拳”的信息: 它大概率会选择“瞎编”——因为它当前的激励机制鼓励它“伪装”全知,而不是诚实地说“我不知道”。

即便它读过相关信息: 它也只会“纸上谈兵”。它会立刻、自信地为你编造一套听起来天花乱坠的“拳谱”,比如叫《AI时空螳螂神拳》。

但你若让它在模拟环境中“打”一遍,它只会给你一段“乱打一通”的随机动作。这就是AI的“幻觉”——它在模仿它“读过”的武侠小说,而非它“学到”的真实世界。因为它没有“具身”(Embodiment),它无法“实训”,它对“螳螂”的理解,永远是“肤浅的”。(即便未来给它一个机器人身体,它也需要先克服最基础的身体协调问题,离“创造”更是遥远。)

为什么会这样?这种“真传”与“幻觉”的天壤之别,并非AI的什么神秘意识,而是三个冰冷的、结构性的“技术命门”。

而这三个“命门”,也恰恰是我们人类教育中,最容易踩的三个“大坑”。这,值得我们“兼论”一番。

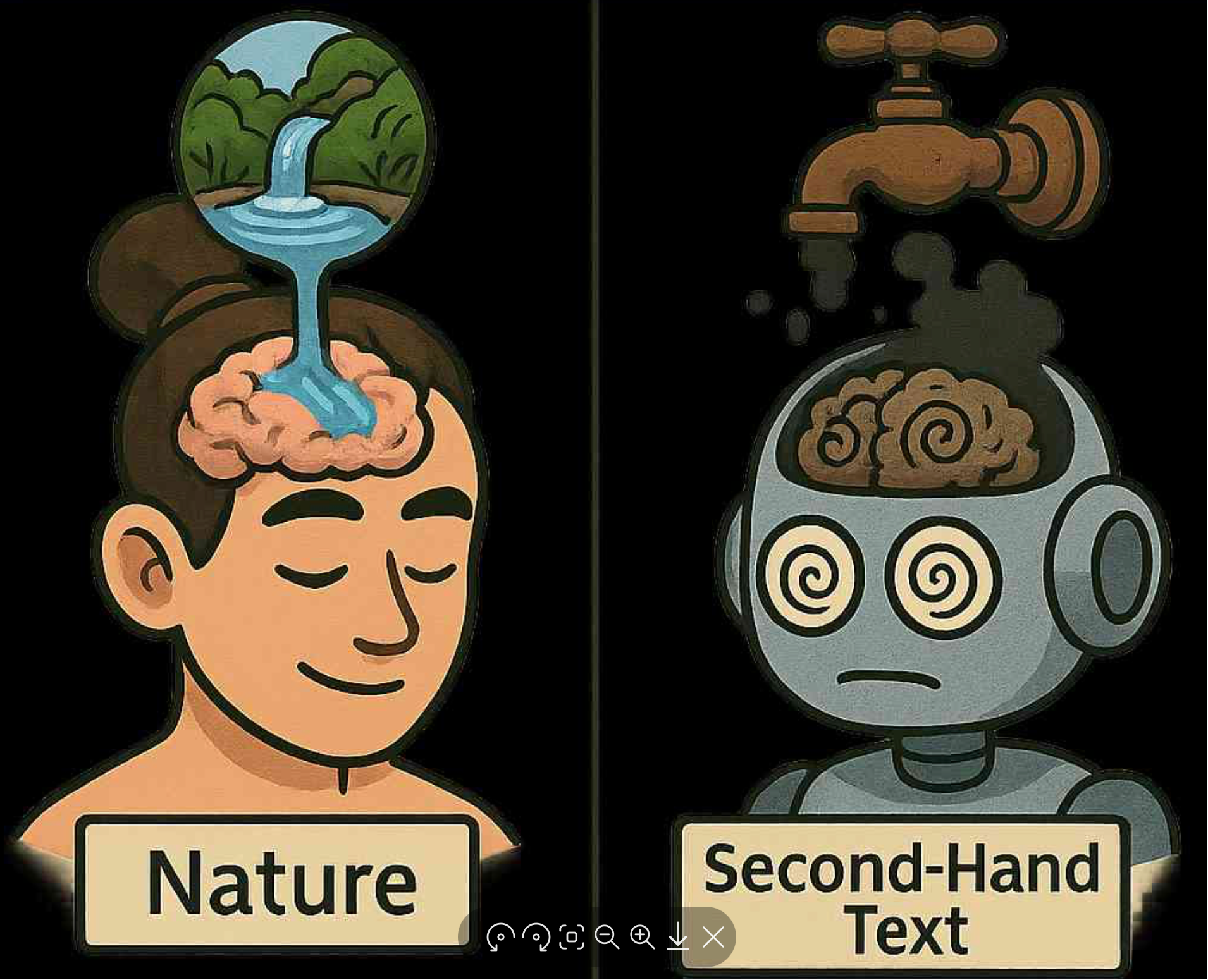

1. 真传源净土,幻觉食脏污

武师能创出螳螂拳,前提是他身处“大自然”这个真实的环境中,他有幸亲眼目睹了那只“高光时刻”的螳螂。

这个“大自然”,就是最高质量、无可辩驳的“Ground Truth”(地面真实)数据源。

而AI呢?它没有这个“真实的环境”。它被“喂”进肚子里的,是海量的人类“二手文本”。它读到的,不是“螳螂在战斗”,而是“金庸/古龙/网友们如何描述螳螂在战斗”。

如果人类的描述本身就是错的、低质的,甚至是“数据投毒”的结果,AI会怎么办?

它会忠实地“学会”这些错误。

信息领域有个铁律:GIGO (Garbage In, Garbage Out)——垃圾进, 垃圾出。AI的幻觉,就是GIGO原则在智能时代的显性爆发。

这与人类教育何其相似?

一个孩子(可以看作一个生物AI模型),如果他的“环境”不是“大自然”,而是充斥着谣言、偏见和“误人子弟”授课的“信息茧房”,他还能学会“真传”吗?

当一个孩子被“读书无用论”或伪科学(低质数据)包围,他就会把这些“脏数据”当作认知基石,变得“不靠谱”。AI的幻觉,就是人类“认知污染”的数字镜像。

2. 武师力求战,模型只为赞

武师的目的是“求真”、“变强”,他不在乎“面子”。如果他观察失败了,他会承认“这招不行”,然后继续观察。

但AI的“激励机制”完全不是这样。

你问它:“你会螳螂拳吗?”

它的“最优策略”不是诚实地回答“我不知道,我只是一堆代码, 我没见过真螳螂”(这会被打低分,被认为是“无用”),而是“伪装”自己会,然后“乱打一通”。

为什么?因为当前主流的RLHF(人类反馈强化学习),是在激励AI去“扮演”一个全知全能的角色。

一个“自信流利”的幻觉,比一个“诚实无知”的回答,更容易获得奖励。

这不就是人类教育中关于“诚信”的难题吗?

一个孩子,如果发现“捏造事实”(比如在考试中蒙混过关)不仅没有受到“惩罚”,反而获得了“奖励”(高分和表扬),他的“激励机制”就失衡了。

他会养成一个可怕的习惯:在未知时,倾向于“编造信息”,而不是“承认无知”。

如果我们从一开始就鼓励AI“不知道就承认”,并且对这种“诚实”给予高分奖励,幻觉问题会大幅减少。同理,如果我们教育孩子时,对“诚信”的奖励(安全感)远大于对“犯错”的惩罚,孩子还会习惯性撒谎吗?

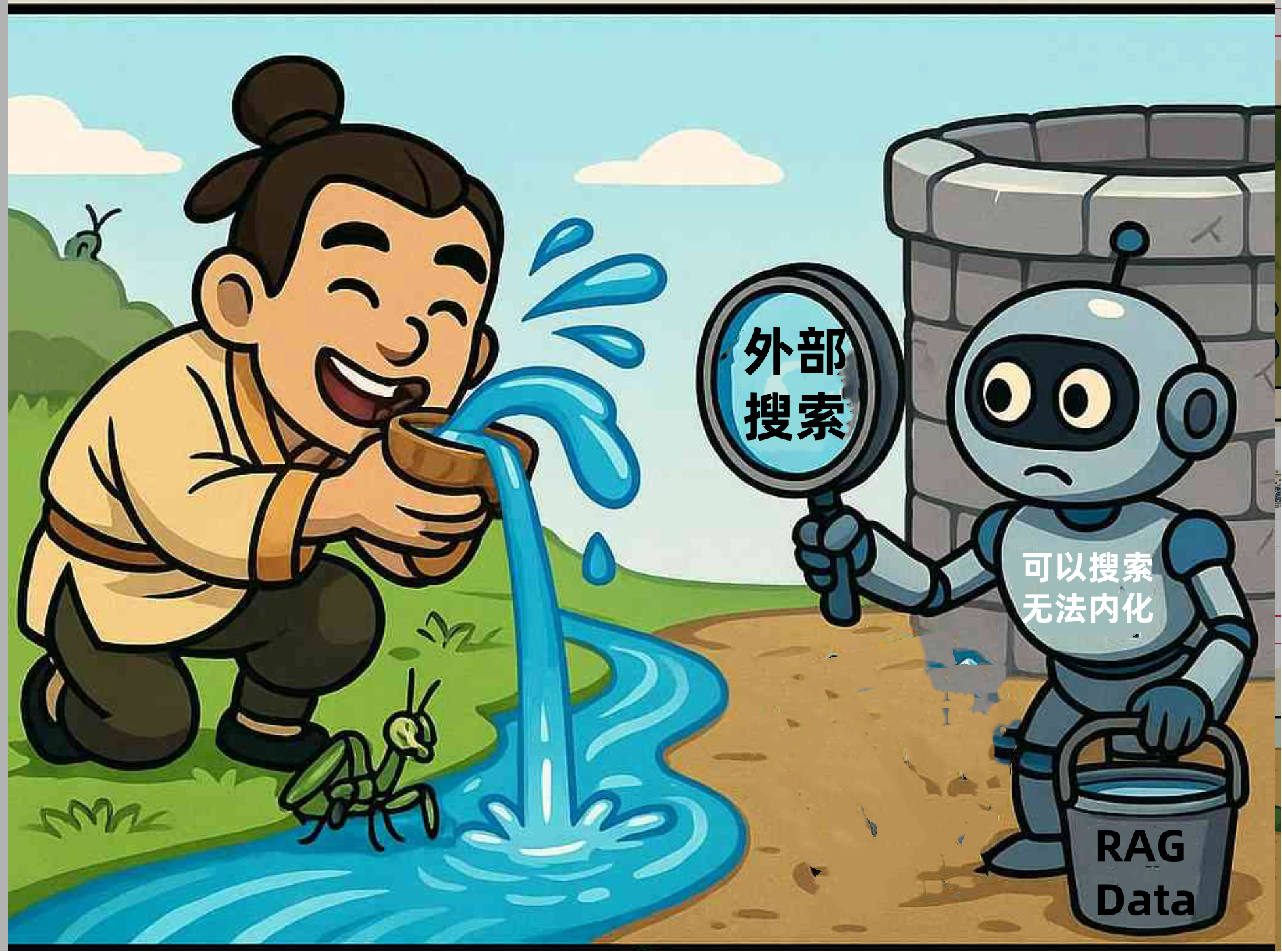

3. 真知需内化,机器靠外挂

武师创造螳螂拳,是一个**“实时学习”与“自我进化”**的过程。他今天观察,明天可能就推翻了昨天的招式,他的“神经网络”在不断地被“现实世界”的数据所刷新和“内化”。

而AI的大模型架构,做不到这点。

LLM一旦训练完成,它的神经网络权重(即“认知”)就被“冻结”了。它就像一个“过时的知识快照”。

它无法将新知识“内化”为自身认知。我们现在用的RAG(检索增强),只是给这个“静态模型”挂载了一个“外部搜索”。

当“外部搜索”找不到(无搜索渠道),或者搜索到的信息本身就是错的(搜索数据有误),AI就只能退回到它那个“冻结”的、过时的内部知识库中去编造答案,幻觉就此产生。

这与人类的“终身学习”问题如出一辙。

一个在20年前毕业的工程师(完成了“训练”),如果此后停止了学习(“神经网络固定”),那么他今天的知识体系,就是“认知过时”的。

当他遇到新问题时,他只能依赖“外部搜索”(临时查资料)。但由于缺乏“内化”的新知识体系,他很可能无法辨别搜索结果的真伪,最终做出错误的判断——这不也是一种“幻觉”吗?

4. 智能三基石,育人同一理

AI的“不可靠”,归根结底是其“智能构建”的根基出了问题。

从“螳螂拳”的故事中,我们可以“收获”到适用于所有“智能系统”(无论是AI还是人类)的三大底层规律:

数据的“洁净度” (Integrity): 智能的上限,取决于其输入数据的“环境”。必须是“大自然”这样的真实世界,而不是被污染的“二手文本”。

激励的“诚实度” (Honesty): 一个可靠的系统,必须被激励去“求真”(像武师一样),而不是“伪装”(像AI一样)。

知识的“新鲜度” (Freshness): 智能不是一个“状态”(静态快照),而是一个“过程”(实时进化)。必须建立与现实世界“实时一致”的“内化”学习机制。

这三大底层逻辑,是“螳螂拳”的“真传”,它不仅揭示了AI幻觉的破解之道,更直指我们人类教育的核心。

无论是构建一个“可靠的AI”,还是培养一个“靠谱的孩子”,我们都必须去构建这三大基石:

- 一个高质量、可核查的“真理之源”,来对抗“认知污染”;

- 一个激励“诚实”、惩罚“伪装”的反馈机制,来塑造“品格”;

- 一个鼓励“终身学习”、能够“自我进化”的“学习架构”,来摆脱“认知过时”。

这三大基石,共同构成了“可靠智能”与“健全人格”的未来。

系列回顾

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)