国内外主流AI大模型MCP协议与调用方法详解

摘要: MCP(Model Context Protocol)是Anthropic提出的开源协议,旨在标准化大语言模型与外部工具的交互,解决接口碎片化问题。其架构包含Host、Client和Server三层,基于JSON-RPC 2.0协议。目前,Claude、GPT-4o、阿里云通义千问和腾讯云混元大模型已支持MCP,而Kimi、DeepSeek等部分支持或未支持。调用方式因平台而异,如Open

1. 什么是MCP?

MCP(Model Context Protocol) 是由 Anthropic 提出的一种开源协议,旨在标准化大语言模型(LLM)与外部工具、数据源和服务之间的交互方式。其核心目标是解决 AI 工具调用中的“接口碎片化”问题——即不同模型使用不同格式调用不同 API,导致开发成本高、扩展性差。

MCP 的设计哲学类似于 USB-C 接口:无论设备品牌或功能如何,只要遵循统一标准,即可即插即用。在 AI 领域,MCP 让 LLM 能通过统一协议访问文件系统、数据库、Web API、向量库等资源。

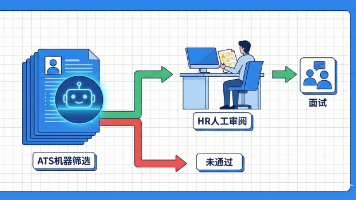

核心架构

- MCP Host:运行环境(如 Claude Desktop、Cursor IDE)

- MCP Client:嵌入在 Host 中的通信组件,负责与 Server 对接

- MCP Server:提供具体功能的服务端(如天气查询、PDF 解析、数据库连接)

MCP 基于 JSON-RPC 2.0 协议,采用请求-响应模式,支持异步调用与流式传输。

2. 国内外主流大模型对 MCP 的支持现状

| 模型/平台 | 所属公司 | MCP 支持状态 | 主要应用场景 |

|---|---|---|---|

| Claude 3.5+ | Anthropic | ✅ 原生支持(Desktop 应用) | 本地文件读取、代码执行、工具集成 |

| GPT-4o / o1 | OpenAI | ✅ ChatGPT 桌面版 + Responses API(2025 Q3起) | Agent 工具调用、企业级自动化 |

| 通义千问 | Qwen-Max 阿里云 | ✅ 百炼平台已接入 MCP | 企业知识库、数据库查询、API 编排 |

| 混元大模型 | HunYuan 腾讯云 | ✅ 腾讯云 MCP 服务上线 | 微信生态集成、内部工具调用 |

| Kimi | 月之暗面 | ⚠️ 实验性支持( | 需通过自定义 MCP Server) |

| DeepSeek-V3 | 深度求索 | ❌ 尚未官方支持 | — |

| GLM-4 | 智谱 AI | ⚠️ 社区驱动 MCP 适配(非官方) | 开发者自行部署 MCP Bridge |

注:截至2025年11月,Anthropic、OpenAI、阿里云、腾讯云已实现较完整的 MCP 生态集成。

3. 各平台 MCP 调用方法详解

3.1. OpenAI(GPT 系列)

API 接口

入口:POST https://api.openai.com/v1/responses

认证:Bearer Token(需开通 MCP 权限)

请求体示例:

{

"model": "gpt-4o",

"messages": [{"role": "user", "content": "帮我查北京明天天气"}],

"tools": [

{

"type": "mcp",

"function": {

"name": "weather_server.get_forecast",

"description": "获取城市未来天气预报"

}

}

],

"tool_choice": "auto"

}

用量与限制

- 免费层:每日 100 次 MCP 调用(仅限 ChatGPT Plus 用户)

- 付费层(API):$0.01 / 次 MCP 调用(独立计费,不计入 token)

- 速率限制:60 RPM(Requests Per Minute)

特点

- ✅ 与 Function Calling 无缝融合

- ✅ 支持流式响应(streaming)

- ❌ 仅限桌面端和 Responses API,网页版暂不支持

3.2. Anthropic(Claude)

调用方式

- 仅限 Claude Desktop 应用

- 用户需手动启动 MCP Server(如 mcp-server-filesystem)

- Claude 自动发现并注册可用工具

示例流程

- 启动本地 MCP Server:

pip install mcp-server-filesystem

mcp-server-filesystem --root-dir ./docs

- 在 Claude Desktop 中输入:“读取 ./docs/README.md”

- Claude 自动调用 MCP Server 获取文件内容

限制

- ❌ 不支持云端调用(无 Web API)

- ❌ 无法通过 API 控制 MCP 工具列表

- ✅ 安全性高(所有数据保留在本地)

3.3. 阿里云百炼(Qwen)

API 接口

Endpoint:https://dashscope.aliyuncs.com/api/v1/mcp/invoke

认证:API Key + RAM 权限控制

调用示例(Python SDK):

from alibabacloud_bailian20240729.client import Client

from alibabacloud_tea_openapi import models as open_api_models

config = open_api_models.Config(access_key_id='YOUR_KEY', access_key_secret='YOUR_SECRET')

client = Client(config)

response = client.invoke_mcp_tool(

model='qwen-max',

tool_name='database_query',

params={'sql': 'SELECT FROM users LIMIT 5'}

)

用量与计费

- 免费额度:每月 500 次 MCP 调用

- 超出部分:¥0.03 / 次

- 并发限制:20 QPS(可申请提升)

特点

- ✅ 深度集成阿里云生态(RDS、OSS、MaxCompute)

- ✅ 支持私有化 MCP Server 部署

- ✅ 提供 MCP Inspector 可视化调试工具

3.4. 腾讯云(HunYuan)

调用方式

- 通过 腾讯云 MCP 控制台注册 Server

- 使用

hunyan-mcp-sdk发起调用

示例(Node.js):

const { HunYuanMCP } = require('@tencentcloud/hunyuan-mcp');

const client = new HunYuanMCP({

secretId: 'YOUR_ID',

secretKey: 'YOUR_KEY',

region: 'ap-beijing'

});

await client.callTool('wechat_message.send', {

toUser: 'user123',

content: '您的订单已发货'

});

限制

- 仅支持腾讯云 VPC 内网调用(保障安全)

- 工具需提前备案审核(防止滥用)

4. MCP 协议的核心优势与局限

✅ 优势

- 标准化:统一工具调用接口,降低集成成本

- 可扩展:开发者可快速发布 MCP Server,形成生态

- 安全性:Host 与 Server 可隔离部署(尤其适合企业)

- 灵活性:支持本地、私有云、公有云多种部署模式

❌ 局限

- 生态割裂:各厂商实现细节不一致(如 OpenAI 与 Anthropic 的工具注册机制不同)

- 学习曲线:需理解 Host/Client/Server 三层架构

- 性能开销:额外的 RPC 层可能引入延迟

- 调试复杂:工具链较长,错误定位困难(需依赖 MCP Inspector 等工具)

5. 开发者建议

- 优先选择本地场景:MCP 最适合桌面端 Agent(如 Cursor、Claude Desktop),在 Web 端仍处早期。

- 善用 SDK:阿里云、腾讯云已提供成熟 SDK,避免手写 JSON-RPC。

- 关注安全边界:MCP Server 应严格限制权限(如文件系统只读、数据库最小权限原则)。

- 不要神话 MCP:它不是万能药,仅解决“工具调用标准化”问题,不替代 Agent 规划或模型推理能力。

6. 结语

MCP 正在成为 AI Agent 时代的“通用插座”。尽管目前仍存在生态碎片化、文档不完善等问题,但随着 OpenAI、阿里、腾讯等巨头的持续投入,其标准化价值将日益凸显。

对于开发者而言,掌握 MCP 不仅是技术趋势,更是构建下一代智能应用的关键能力。

“真正的智能,不在于模型多大,而在于它能否与世界无缝连接。”

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)