Dify:像搭积木一样构建智能应用

Dify是一款开源的AI应用开发框架,旨在简化AI应用的构建过程。它提供可视化工作流编排、RAG引擎和Agent代理等功能,支持用户无需编程即可创建AI助手。Dify支持Docker一键部署,可快速搭建知识库问答、智能客服等应用,并支持本地模型部署确保数据安全。开发者在5分钟内就能构建基于文档的AI问答系统,还能扩展为API或AIAgent。虽然框架本身免费,但使用云端模型需支付API费用。Dif

你是否也曾有过这样的想法?

“ChatGPT的对话能力很棒,但如果能接入我的知识库该多好?”

“Midjourney画图很强,但如果能和我公司的业务流程结合就完美了。”

“我想做一个AI助手,但一想到要串接模型、写提示词、做前后端就头大……”

如果你对以上任何一个场景心有戚戚,那么今天介绍的这款神器——Dify,将为你打开一扇新世界的大门。

Dify 的核心理念是:将复杂的AI技术栈抽象成可视化的构建模块,让开发者甚至是不懂代码的普通用户,都能像搭积木一样,快速、轻松地构建和部署强大的AI应用。

它不是一个简单的“套壳”工具,而是一个完整的、面向生产的AI应用开发框架。

| 核心特征 | 可视化工作流编排、RAG引擎、Agent代理 |

| 官网 | |

| GitHub | |

| 技术栈 |

前后端分离 (React + Python),支持 Docker 部署 |

| 许可证 |

Apache-2.0 (开源且可商用) |

它能解决什么问题?

-

企业内部知识库问答:快速搭建一个理解公司内部文档、规章制度的AI客服。

-

AI智能客服:结合业务数据和工作流,提供7x24小时的专业问答服务。

-

AI内容生成:构建一个能根据特定风格和需求,生成市场文案、新闻稿、社交媒体帖子的内容助手。

-

个人AI学习伙伴:基于你的学习资料,打造一个专属的答疑和总结工具。

本地部署和基本使用

Dify 官方提供了最便捷的 Docker 一键部署方案,对新手极其友好。

-

准备环境:确保你的服务器已安装

Docker和Docker Compose。 -

意见安装并启动:

git clone https://github.com/langgenius/dify cd dify/docker cp .env.example .env docker compose up -d

运行成功后在浏览器上访问 http://localhost/install 进入 Dify 控制台

基本使用:5分钟创建一个知识库助手

-

创建应用:在控制台点击“创建新应用”,选择“文本生成”类型。

-

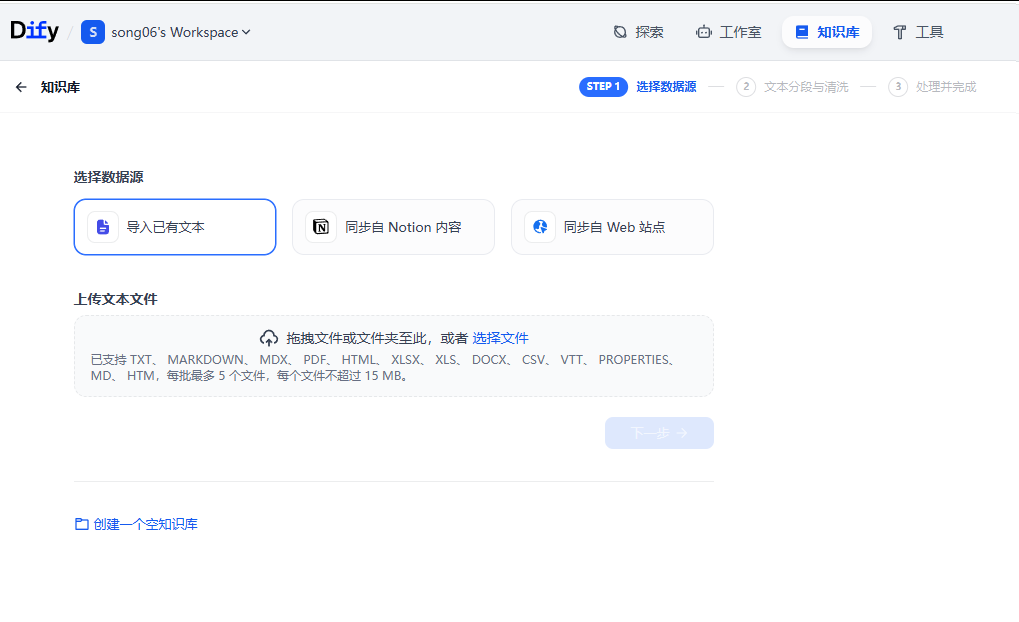

配置知识库:在左侧菜单进入“知识库”,创建一个新的知识库,并上传你的文档(支持TXT、PDF、Word、PPT等)。

-

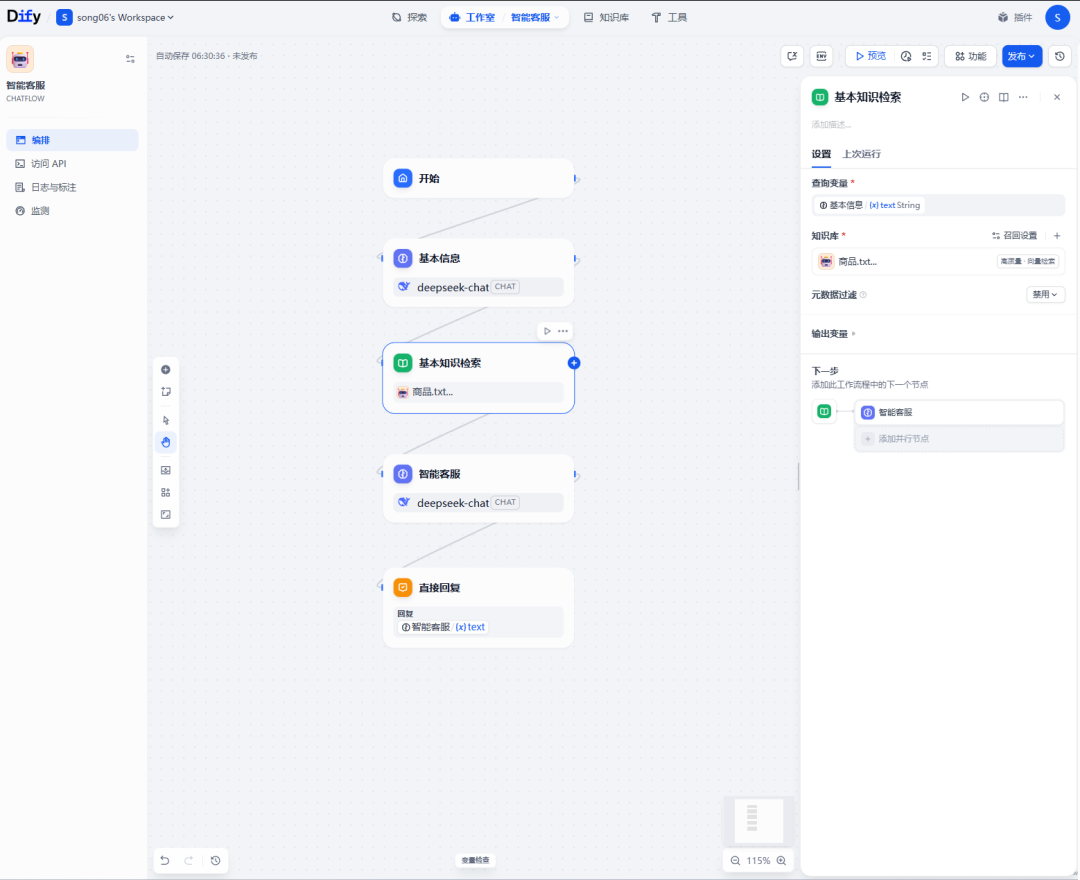

编排工作流:

-

进入应用的工作流编辑界面。

-

从左侧拖入一个 “知识库检索” 节点。

-

再拖入一个 “LLM” 节点。

-

将两个节点连接起来:

Start -> 知识库检索 -> LLM。

-

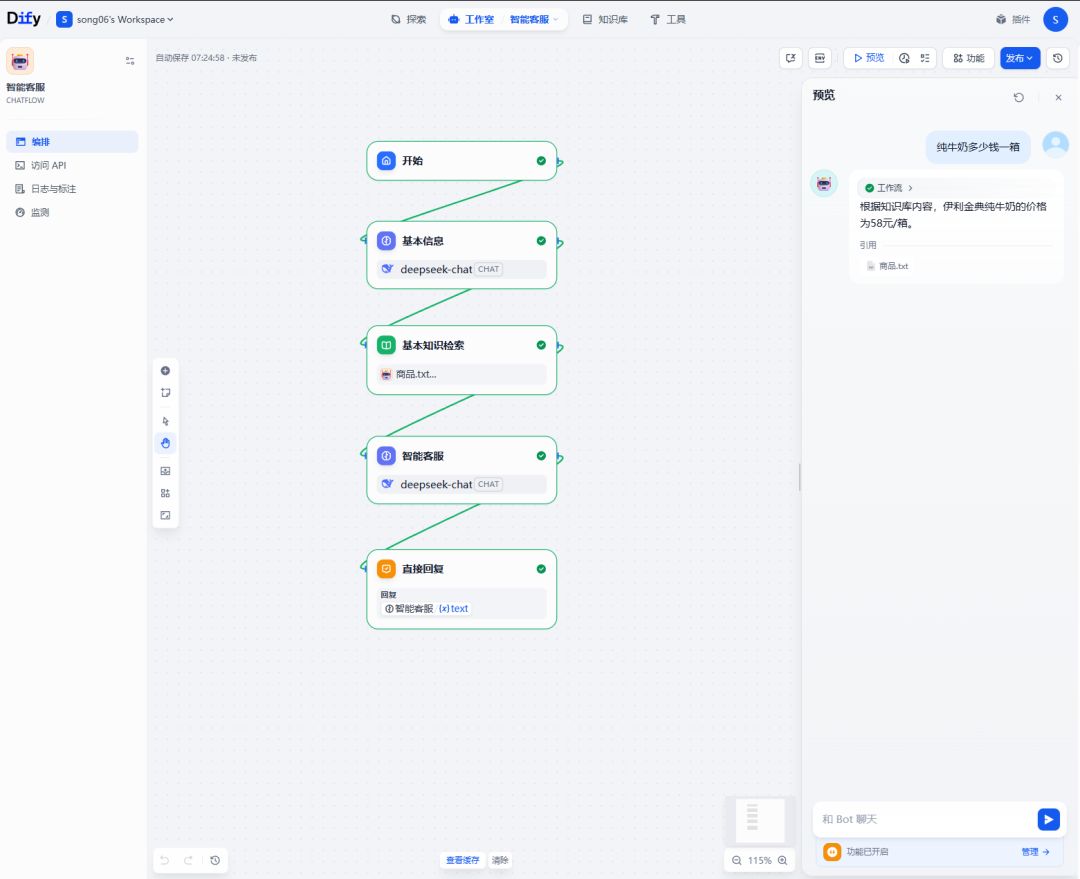

对话测试:在右上角的预览窗格中,输入问题测试一下。你会发现,AI的回答已经基于你上传的文档内容了!

-

整个过程无需编写一行代码,一个专属的、懂你知识的AI助手就诞生了。

多种发布方式可供选择

-

温馨提醒

-

模型费用:Dify本身是免费的,但当你使用OpenAI、Claude等云端模型时,需要支付对应模型的API费用。合理规划使用量。

-

硬件要求:如果使用Ollama部署本地模型,则需要一台性能足够的机器(尤其是GPU),模型越大,要求越高。

-

数据安全:对于敏感数据,建议优先选择本地部署的Dify + 本地模型(如通过Ollama部署)的方案,确保数据不出域。

-

-

扩展探索

当你熟悉了基础操作后,可以尝试Dify更酷的功能:-

构建AI Agent:尝试在工作流中加入“代码执行”或“HTTP请求”节点,让你的AI能执行数学计算或查询实时天气。

-

发布为API:在“发布”页面,你可以将应用封装成API,方便集成到你自己的其他系统中。

-

探索应用市场:Dify官方有应用市场,里面有很多现成的模板,可以一键复用,快速启航。

-

希望这篇介绍能帮助你开启AI应用开发的新旅程!如果你已经用Dify构建了有趣的应用,欢迎在评论区分享你的故事!

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)