《第四届数字信任大会》精彩观点:在十字路口的人工智能:可信任的规模化扩展

《人工智能治理:从挑战到机遇》摘要 人工智能正处于发展的关键阶段,德勤中国合伙人朱灏指出AI的未来取决于能否实现可信的规模化扩展。文章通过分析AI治理的七大维度(隐私保护、解释透明、公平公正等),揭示了亚太地区仅25%企业做好AI治理准备的现状。德勤提出的"端到端智能闭环"理念已在财务审核、合规管理等领域取得显著成效,如某制造企业通过AI实现每年6000小时工时节省。面对全球A

背景

观点内容摘取自《第四届数字信任大会暨ISACA中国2025年度大会》嘉宾的演讲与分享,内容代表了演讲嘉宾的经验分享/意见观点。

详细版本PPT更新在ISACA中国区官网。

🔍 前言

人工智能(AI)正处在“十字路口”。它既是生产力革命的引擎,也潜藏着伦理、风险与合规的挑战。德勤中国合伙人朱灏在“可信人工智能治理系列研讨会”中指出:

“AI的未来不在于技术本身,而在于能否以可信的方式实现规模化扩展。”

本文将从AI治理、行业趋势与实践案例出发,探讨企业如何构建可信任的人工智能体系,实现安全、高效与合规的智能转型。

🧠 一、AI的多行业规模化扩展

德勤在AI应用上提出“端到端智能闭环”理念,覆盖计算机视觉、自然语言处理、生成式AI、机器学习等领域,广泛赋能:

- 客户经营与市场洞察

- 供应链优化与智能生产

- 财务与合规管理自动化

- 风险监控与安全治理

代表性平台:Cortex AI(模型管理)、DelphAI(研发赋能)、Smart RS(智能推荐系统)、Panorama(图分析)、Bot-Alpha(智能对话机器人)

⚙️ 二、AI可信治理的七大维度

| 维度 | 核心要点 |

|---|---|

| 隐私保护 | 尊重合同与监管义务,限定数据用途 |

| 解释透明 | 模型可解释、决策可追踪 |

| 公平公正 | 避免算法偏见与不当歧视 |

| 安全保障 | 预防网络与系统性风险 |

| 健全可靠 | 输出结果一致、可靠 |

| 问责设定 | 明确决策责任与技术边界 |

| 技术负责 | 以社会责任为导向设计AI |

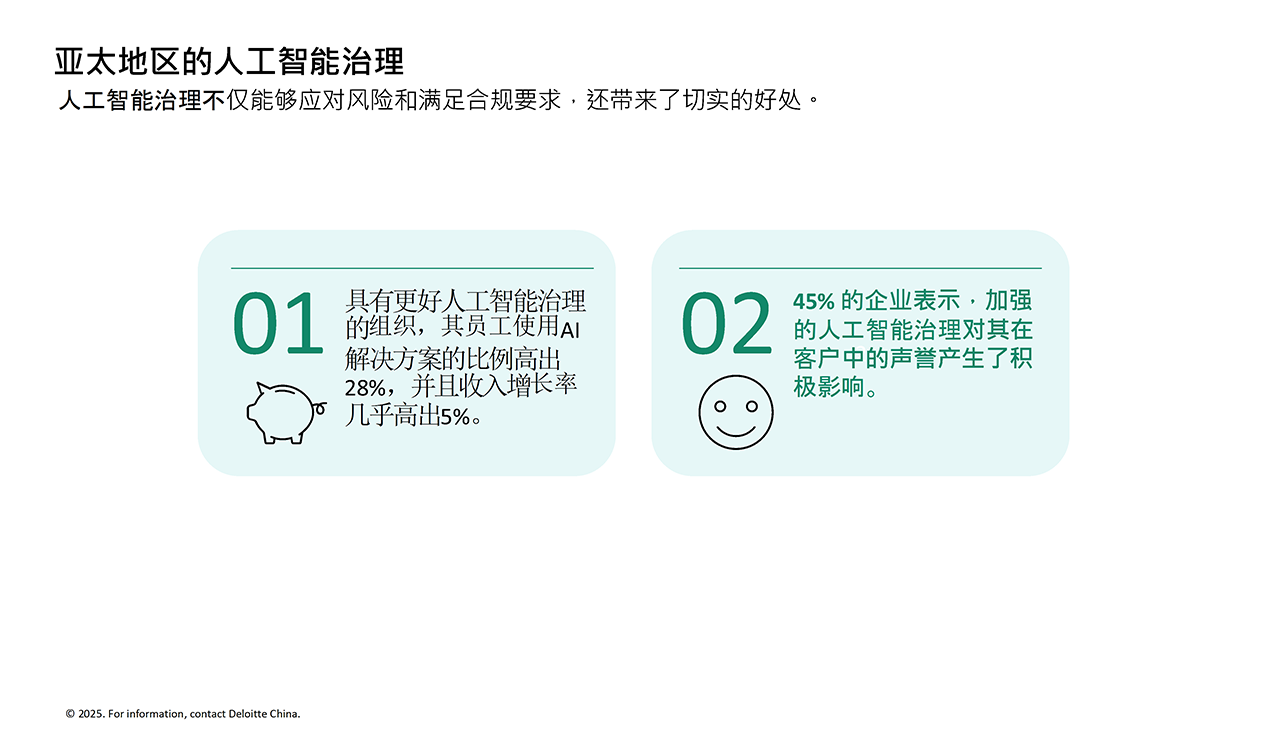

📊 三、亚太地区AI治理现状

德勤与AI研究所联合调研900位亚太高管,结果显示:

- 仅25%的企业认为“已做好生成式AI治理准备”;

- 安全漏洞是企业最担忧的问题;

- 只有56%的员工具备负责任使用AI的能力;

- 加强AI治理可让员工AI使用率提升28%,收入增长近5%。

这反映出:AI治理不仅是防风险,更是增长驱动力。

🧩 四、全球AI监管格局

| 地区 | 核心法规与方向 |

|---|---|

| 中国 | 《生成式人工智能服务管理暂行办法》《人工智能伦理规范》强调可控性与数据主权 |

| 欧盟 | 《人工智能法案》《AI道德准则》倡导公平与透明 |

| 美国 | 《AI权利法案蓝图》《风险管理框架》主张市场创新与分权监管 |

| 日本 | 制造业导向,聚焦老龄化社会应用 |

| 亚太 | 政府主导型治理路径逐渐清晰 |

🏗️ 五、AI治理生命周期与六大抓手

- 评估:识别AI运行环境与潜在风险

- 设计:构建治理框架与政策体系

- 策略:结合企业战略制定合规路线

- 治理:场景化执行与文化建设

- 监督:建立AI事件库与绩效指标

- 优化:跟踪法规变化并持续改进

💼 六、实践案例

✅ 更快:AI加速财务审核

德勤帮助某制造企业构建智能费用审核助手,实现合同与发票的自动比对与合规检测,每年节省6000小时工时。

✅ 更好:合规管理智能体

基于生成式AI知识图谱,构建“中心化合规智库”,让监管要求融入日常业务,提升管理前置性。

✅ 更远:出海企业供应链风险防控

借助AI分析全球公开数据与供应商信息,实现实时风险预警与声誉监控,节省50%以上人工分析时间。

🔭 七、从“治AI”到“AI治”

AI不仅是治理对象,也正成为治理工具。未来的风险管理将从“被动响应”走向“主动预测”,AI将成为企业风险感知与价值创造的核心引擎。

🧾 八、总结

“可信”是AI进入规模化发展的通行证。

企业在AI转型中,应以治理为底座,以责任为核心,通过制度化、透明化和智能化的方式,建立能被信任的AI体系。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)