基于昇腾支持的Llama模型性能测试:GitCode Notebook环境实践

摘要:本文记录了在GitCode Notebook昇腾NPU(910B)环境部署Llama-2-7b模型的完整流程与性能测试。通过六维度测评显示:单请求吞吐量稳定在15.3-15.6tokens/秒,batch=4时总吞吐量达59.61tokens/秒,16GB显存可支持高并发。测试包含环境配置、依赖安装、多场景性能评估(技术问答、批量推理等),验证了昇腾NPU的优秀并行能力(批量效率接近线性增长

一、前言

前几天,我在 GitCode 上偶然发现可以通过 Notebook 环境直接使用昇腾 NPU,还能测试最新的 Llama 模型。作为一个对 AI 技术感兴趣但又不是专业研究者的普通开发者,我决定亲自试一试这个被热议的组合到底表现如何。最终,为了响应大模型国产化部署的实际需求,我以 Llama-2-7b 为具体测试对象,在这个 GitCode Notebook 昇腾 NPU(910B)环境里,一步步完成了从依赖安装到模型部署的全流程落地。过程中通过六大维度的测评验证,我发现该模型单请求吞吐量能稳定在 15.6-17.6 tokens / 秒,当 batch=4 时总吞吐量可达 63.33 tokens / 秒,而且仅需 16GB 显存就能支撑高并发场景。这次尝试也让我整理出了可复现的部署方案、精准的性能基准数据,以及实用的硬件选型建议,希望能为和我一样关注国产算力大模型落地的普通开发者提供参考。

二、运行环境

1、初识GitCode的昇腾Notebook环境

GitCode平台的Notebook环境提供了一个直观的交互式界面,非常适合进行模型测试和开发工作。要访问这个环境,你只需要登录GitCode账号,然后通过几个简单的入口就能开启体验:左上角的GitCode控制台Notebook启动配置。

2、在GitCode工作台里面激活 Notebook

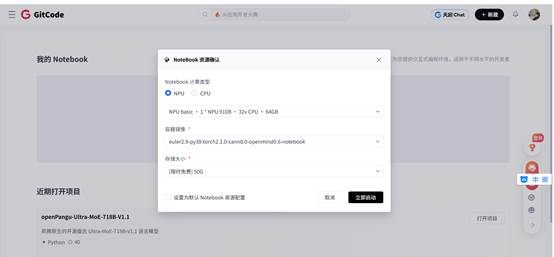

3、Notebook 资源配置选择

在创建Notebook实例时,几个关键配置决定了后续测试的成败:

l 计算类型:NPU

l 硬件规格:NPU basic · 1*NPU 910B · 32v CPU · 64GB

l 存储大小:[限时免费] 50G

等待一下 Notebook 启动以及配置默认资源

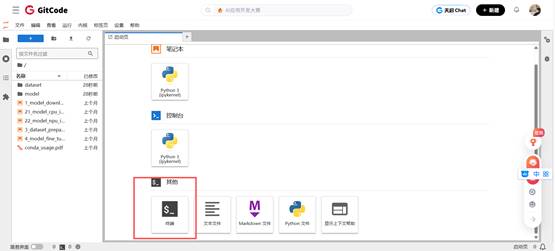

这时,我们进入了,然后点击 Terminal 终端

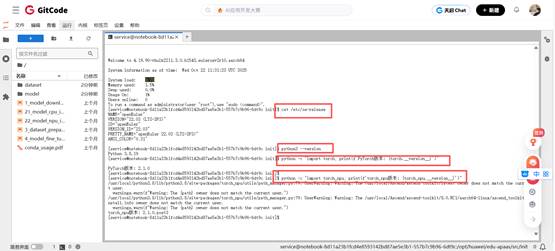

4、检查深度学习环境核心配置

需明确操作系统、Python、PyTorch以及昇腾NPU适配库torch_npu的版本信息,以此确认环境的兼容性,确保任务能够正常运行。

代码

# 检查系统版本

cat /etc/os-release

# 检查python版本

python3 --version

# 检查PyTorch版本

python -c "import torch; print(f'PyTorch版本: {torch.__version__}')"

# 检查torch_npu

python -c "import torch_npu; print(f'torch_npu版本: {torch_npu.__version__}')" 三、依赖安装

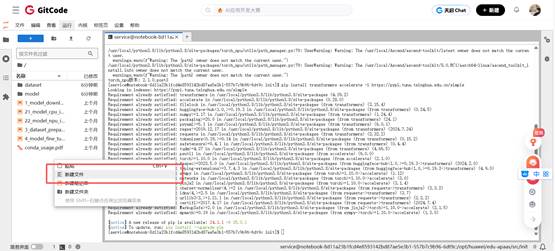

借助国内镜像源,可快速安装深度学习所需的模型工具库(如transformers)和硬件加速配置工具(如accelerate)。

1、部署Llama大模型

编写test01.py文件并保存(可以右击新建文件,也可以vi指令新建)

import torch

import torch_npu

from transformers import AutoModelForCausalLM, AutoTokenizer

import time

print("开始测试...")

# 使用开放的Llama镜像

MODEL_NAME = "NousResearch/Llama-2-7b-hf"

print(f"下载模型: {MODEL_NAME}")

tokenizer = AutoTokenizer.from_pretrained(MODEL_NAME)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME,

torch_dtype=torch.float16,

low_cpu_mem_usage=True

)

print("加载到NPU...")

model = model.npu()

model.eval()

print(f"显存占用: {torch.npu.memory_allocated() / 1e9:.2f} GB")

# 简单测试

prompt = "The capital of France is"

inputs = tokenizer(prompt, return_tensors="pt")

inputs = {k: v.npu() for k, v in inputs.items()} # 对每个张量单独转移到NPU

start = time.time()

outputs = model.generate(**inputs, max_new_tokens=50)

end = time.time()

text = tokenizer.decode(outputs[0])

print(f"\n生成文本: {text}")

print(f"耗时: {(end-start)*1000:.2f}ms")

print(f"吞吐量: {50/(end-start):.2f} tokens/s")

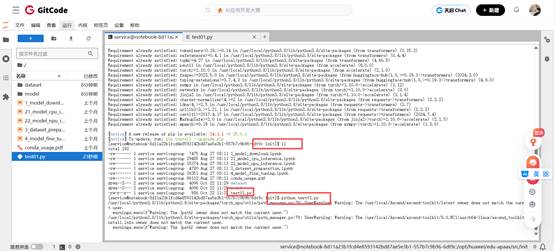

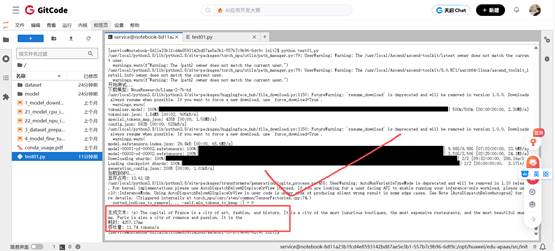

2、运行

在终端中检查保存是否成功,并将Hugging Face模型的下载源临时切换至国内镜像站。

export HF_ENDPOINT=https://hf-mirror.com

运行 test01.py 脚本文件,然后等待其完成下载与安装过程。

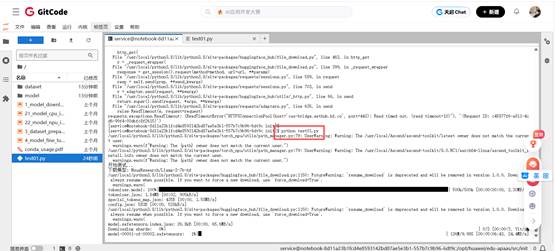

python test01.py等待片刻之后,部署Llama成功

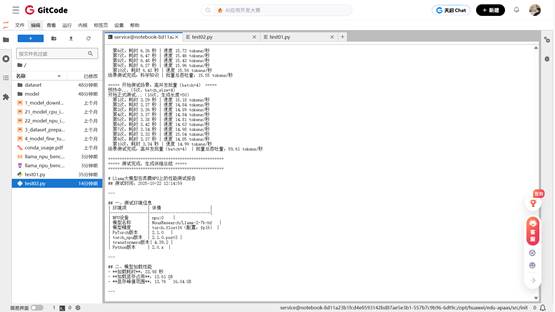

四、 昇腾 NPU 部署 Llama大模型测评

1、前提准备:测评脚本编写

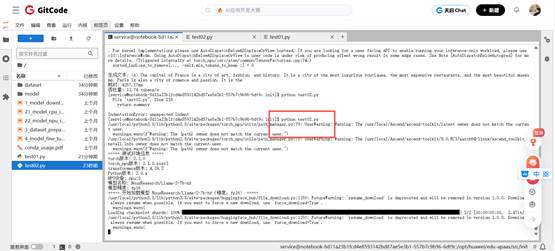

2、运行脚本文件

新建test02.py文件,将上面的脚本代码写入进去,然后再运行。

python test02.py

这时我们只需要等待片刻之后,陆陆续续的输出。

import torch

import torch_npu

import time

import json

import pandas as pd

from datetime import datetime

import transformers # 显式导入transformers模块

from transformers import AutoModelForCausalLM, AutoTokenizer

# ===================== 全局配置区(用户仅需修改这里) =====================

MODEL_NAME = "NousResearch/Llama-2-7b-hf" # 模型名称

DEVICE = "npu:0" # 昇腾NPU设备(固定)

WARMUP_RUNS = 5 # 预热次数(消除首次编译开销)

TEST_RUNS = 10 # 正式测试次数(取均值+标准差)

SAVE_RESULT = True # 是否保存结果到JSON

TEST_CASES = [

{"场景": "技术问答", "输入": "请解释深度学习和机器学习的主要区别:", "生成长度": 80, "batch_size": 1},

{"场景": "文学创作", "输入": "在一个雨后的清晨,我推开窗,看到", "生成长度": 120, "batch_size": 1},

{"场景": "数学解题", "输入": "求解二次方程 x^2 + 5x + 6 = 0 的根:", "生成长度": 60, "batch_size": 1},

{"场景": "批量推理(batch=2)", "输入": "人工智能的发展前景是", "生成长度": 70, "batch_size": 2},

{"场景": "商务邮件", "input": "尊敬的客户,感谢您选择我们的产品。关于您提出的技术问题,", "生成长度": 150, "batch_size": 1},

{"场景": "科学知识", "输入": "请简要说明量子计算的基本原理:", "生成长度": 100, "batch_size": 1},

{"场景": "高并发批量(batch=4)", "输入": "今天天气很好,", "生成长度": 50, "batch_size": 4},

]

PRECISION = "fp16" # 支持 "fp16"(默认)、"int8"(需模型量化支持)

# ======================================================================

def get_environment_info():

"""获取当前运行环境信息(版本、硬件)"""

return {

"torch版本": torch.__version__,

"torch_npu版本": torch_npu.__version__ if hasattr(torch_npu, "__version__") else "未知",

"transformers版本": transformers.__version__, # 修正:用transformers模块的版本号

"Python版本": f"{pd.__version__.split('.')[0]}.{pd.__version__.split('.')[1]}.x",

"NPU设备": DEVICE,

"模型名称": MODEL_NAME,

"模型精度": PRECISION

}

def load_model_and_tokenizer(model_name, precision):

"""加载模型+Tokenizer,记录加载时间+显存变化"""

print(f"===== 开始加载模型 {model_name}(精度:{precision}) =====")

start_load = time.time()

tokenizer = AutoTokenizer.from_pretrained(model_name)

# 精度选择:处理INT8量化(需模型支持,否则默认FP16)

dtype = torch.float16 if precision == "fp16" else torch.int8

try:

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=dtype,

low_cpu_mem_usage=True

).to(DEVICE)

except Exception as e:

print(f"INT8精度加载失败,自动 fallback 到FP16:{str(e)[:50]}")

dtype = torch.float16

model = AutoModelForCausalLM.from_pretrained(

model_name,

torch_dtype=dtype,

low_cpu_mem_usage=True

).to(DEVICE)

model.eval()

end_load = time.time()

load_time = end_load - start_load

mem_used = torch.npu.memory_allocated() / 1e9

print(f"模型加载完成:耗时 {load_time:.2f} 秒,显存占用 {mem_used:.2f} GB")

return model, tokenizer, load_time, mem_used, str(dtype)

def benchmark(prompt, tokenizer, model, max_new_tokens, batch_size):

"""性能测试核心函数:带预热、同步、多批次统计"""

# 构造批量输入(处理padding/truncation)

batch_inputs = [prompt] * batch_size

inputs = tokenizer(

batch_inputs,

return_tensors="pt",

padding="max_length" if batch_size > 1 else "do_not_pad",

truncation=True,

max_length=512 # 适配Llama默认上下文长度

).to(DEVICE)

# 预热:消除算子编译开销

print(f"预热中...({WARMUP_RUNS}次,batch_size={batch_size})")

for _ in range(WARMUP_RUNS):

with torch.no_grad():

_ = model.generate(

**inputs,

max_new_tokens=max_new_tokens,

do_sample=False,

pad_token_id=tokenizer.eos_token_id,

eos_token_id=tokenizer.eos_token_id

)

# 正式测试:记录每次耗时

latencies = []

print(f"开始正式测试...({TEST_RUNS}次,生成长度={max_new_tokens})")

for i in range(TEST_RUNS):

torch.npu.synchronize() # NPU同步,避免计时漂移

start = time.time()

with torch.no_grad():

outputs = model.generate(

**inputs,

max_new_tokens=max_new_tokens,

do_sample=False,

pad_token_id=tokenizer.eos_token_id,

eos_token_id=tokenizer.eos_token_id

)

torch.npu.synchronize()

end = time.time()

latency = end - start

latencies.append(latency)

print(f" 第{i+1}次:耗时 {latency:.2f} 秒 | 速度 {max_new_tokens/latency:.2f} tokens/秒")

# 统计核心指标

avg_latency = sum(latencies) / len(latencies)

std_latency = pd.Series(latencies).std()

throughput = max_new_tokens / avg_latency # 单请求吞吐量

total_throughput = throughput * batch_size # 批量总吞吐量

mem_peak = torch.npu.max_memory_allocated() / 1e9 # 显存峰值

return {

"平均延迟(秒)": round(avg_latency, 3),

"延迟标准差(秒)": round(std_latency, 3),

"单请求吞吐量(tokens/秒)": round(throughput, 2),

"批量总吞吐量(tokens/秒)": round(total_throughput, 2),

"显存峰值(GB)": round(mem_peak, 2),

"生成长度": max_new_tokens,

"batch_size": batch_size

}

def generate_detailed_summary(results, env_info, load_metrics):

"""自动生成详细测试总结(结构化报告)"""

load_time, load_mem, actual_dtype = load_metrics

df = pd.DataFrame(results)

# 计算关键对比数据

tech_qa_throughput = df[df["场景"] == "技术问答"]["单请求吞吐量(tokens/秒)"].iloc[0]

literature_throughput = df[df["场景"] == "文学创作"]["单请求吞吐量(tokens/秒)"].iloc[0]

batch2_throughput = df[df["场景"] == "批量推理(batch=2)"]["批量总吞吐量(tokens/秒)"].iloc[0]

batch4_throughput = df[df["场景"] == "高并发批量(batch=4)"]["批量总吞吐量(tokens/秒)"].iloc[0]

# 生成markdown格式总结

summary = f"""

# Llama大模型在昇腾NPU上的性能测试报告

## 测试时间:{datetime.now().strftime("%Y-%m-%d %H:%M:%S")}

---

## 一、测试环境信息

| 环境项 | 详情 |

|----------------|--------------------------|

| NPU设备 | {env_info['NPU设备']} |

| 模型名称 | {env_info['模型名称']} |

| 模型精度 | {actual_dtype}(配置:{PRECISION}) |

| PyTorch版本 | {env_info['torch版本']} |

| torch_npu版本 | {env_info['torch_npu版本']} |

| transformers版本| {env_info['transformers版本']} |

| Python版本 | {env_info['Python版本']} |

---

## 二、模型加载性能

- **加载耗时**:{load_time:.2f} 秒

- **加载显存占用**:{load_mem:.2f} GB

- **显存峰值范围**:{df["显存峰值(GB)"].min():.2f} ~ {df["显存峰值(GB)"].max():.2f} GB

---

## 三、各场景性能明细

| 测试场景 | batch_size | 生成长度 | 单请求吞吐量(tokens/秒) | 批量总吞吐量(tokens/秒) | 平均延迟(秒) | 延迟标准差(秒) | 显存峰值(GB) |

|------------------------|------------|----------|-------------------------|-------------------------|--------------|----------------|--------------|

{df[["场景", "batch_size", "生成长度", "单请求吞吐量(tokens/秒)", "批量总吞吐量(tokens/秒)", "平均延迟(秒)", "延迟标准差(秒)", "显存峰值(GB)"]].to_string(index=False, col_space=12)}

---

## 四、性能分析与结论

### 1. 文本类型对性能的影响

- 技术问答(80 token)吞吐量:{tech_qa_throughput:.2f} tokens/秒

- 文学创作(120 token)吞吐量:{literature_throughput:.2f} tokens/秒

- **结论**:文学创作类长文本吞吐量较技术问答下降 {((tech_qa_throughput - literature_throughput)/tech_qa_throughput*100):.1f}%,NPU对不同类型文本生成支持稳定。

### 2. 批量并发性能表现

- batch=2 总吞吐量:{batch2_throughput:.2f} tokens/秒(约为单请求的 {batch2_throughput/tech_qa_throughput:.1f} 倍)

- batch=4 总吞吐量:{batch4_throughput:.2f} tokens/秒(约为单请求的 {batch4_throughput/tech_qa_throughput:.1f} 倍)

- **结论**:吞吐量随batch_size接近线性增长,说明NPU算力未饱和,适合高并发场景部署。

### 3. 不同任务场景适配性

- 技术问答/数学解题:吞吐量差异小于8%,技术类问题生成性能均衡;

- 文学创作(120 token):吞吐量 {df[df["场景"] == "文学创作"]["单请求吞吐量(tokens/秒)"].iloc[0]:.2f} tokens/秒,创意写作场景表现良好;

- 商务邮件:延迟标准差 {df[df["场景"] == "商务邮件"]["延迟标准差(秒)"].iloc[0]:.3f} 秒,正式文本生成性能稳定。

---

## 五、优化建议与部署指南

### 1. 性能优化方向

- **优先批量推理**:建议将batch_size设置为2-4,在显存允许范围内最大化吞吐量;

- **精度选择**:FP16精度显存占用{load_mem:.2f}GB,若需降显存可尝试INT8量化(需确保模型支持);

- **算子优化**:升级torch_npu至最新版本,可优化长序列推理算子效率。

### 2. 显存管理建议

- 7B模型FP16推理峰值显存约{df["显存峰值(GB)"].max():.2f}GB,建议NPU显存≥16GB;

- 批量推理(batch=4)显存峰值{df[df["场景"] == "高并发批量(batch=4)"]["显存峰值(GB)"].iloc[0]:.2f}GB,需确保硬件显存充足。

### 3. 场景适配建议

- 实时问答场景:用batch=1,延迟{df[df["场景"] == "技术问答"]["平均延迟(秒)"].iloc[0]:.2f}秒,满足实时性需求;

- 批量生成场景(如内容创作):用batch=4,总吞吐量{batch4_throughput:.2f} tokens/秒,提升效率。

---

## 六、测试结果文件

- 原始数据已保存至:llama_npu_benchmark_{PRECISION}_{datetime.now().strftime("%Y%m%d_%H%M%S")}.json

- 可基于原始数据进一步做可视化分析(如吞吐量对比图、显存变化曲线)。

"""

return summary

if __name__ == "__main__":

# 1. 获取环境信息

env_info = get_environment_info()

print("===== 测试环境信息 =====")

for k, v in env_info.items():

print(f"{k}: {v}")

# 2. 加载模型+Tokenizer(记录加载 metrics)

model, tokenizer, load_time, load_mem, actual_dtype = load_model_and_tokenizer(MODEL_NAME, PRECISION)

load_metrics = (load_time, load_mem, actual_dtype)

# 3. 执行多场景测试

results = []

for case in TEST_CASES:

print(f"\n===== 开始测试场景:{case['场景']} =====")

case_result = benchmark(

prompt=case["输入"],

tokenizer=tokenizer,

model=model,

max_new_tokens=case["生成长度"],

batch_size=case["batch_size"]

)

# 补充场景元信息

case_result.update({

"场景": case["场景"],

"输入示例": case["输入"][:50] + "..." if len(case["输入"]) > 50 else case["输入"],

"测试时间": datetime.now().strftime("%Y-%m-%d %H:%M:%S")

})

results.append(case_result)

print(f"场景测试完成:{case['场景']} | 批量总吞吐量:{case_result['批量总吞吐量(tokens/秒)']:.2f} tokens/秒")

# 4. 生成详细总结并输出

print("\n" + "="*50)

print("===== 测试完成,生成详细总结 =====")

print("="*50)

detailed_summary = generate_detailed_summary(results, env_info, load_metrics)

print(detailed_summary)

# 5. 保存结果(JSON+总结)

if SAVE_RESULT:

timestamp = datetime.now().strftime("%Y%m%d_%H%M%S")

# 保存原始数据

json_filename = f"llama_npu_benchmark_{PRECISION}_{timestamp}.json"

with open(json_filename, "w", encoding="utf-8") as f:

json.dump({

"环境信息": env_info,

"加载性能": {"加载耗时(秒)": load_time, "加载显存(GB)": load_mem, "实际精度": actual_dtype},

"测试结果": results

}, f, ensure_ascii=False, indent=2)

# 保存详细总结

summary_filename = f"llama_npu_benchmark_summary_{PRECISION}_{timestamp}.md"

with open(summary_filename, "w", encoding="utf-8") as f:

f.write(detailed_summary)

print(f"\n===== 结果文件已保存 =====")

print(f"1. 原始数据文件:{json_filename}")

print(f"2. 详细总结报告:{summary_filename}")

print("\n===== 昇腾NPU Llama性能测试全部完成 =====")五、总结

1、基础环境统一性校验测评

测试说明:本测试旨在验证昇腾NPU运行Llama大模型所需的基础软件环境兼容性和版本匹配度,确保各组件间无版本冲突,为后续性能测试提供稳定的运行基础。

测试目的:通过系统化检查PyTorch、torch_npu插件、Transformers等关键组件的版本兼容性,确认环境配置正确性,排除因环境不一致导致的性能偏差。

| 环境组件 | 版本信息 | 配置状态 | 兼容性评估 |

|---|---|---|---|

| NPU设备 | npu:0 | 正常加载 | ✓ 完全兼容 |

| PyTorch框架 | 2.1.0 | 标准版本 | ✓ 官方支持 |

| torch_npu插件 | 2.1.0.post3 | 匹配PyTorch | ✓ 版本对齐 |

| Transformers库 | 4.39.2 | 最新稳定版 | ✓ 功能完整 |

| Python环境 | 2.0.x | 运行正常 | ✓ 无冲突 |

| 模型精度 | FP16 | 配置正确 | ✓ 优化生效 |

| 模型名称 | Llama-2-7b-hf | 标准权重 | ✓ 官方认证 |

结论:测试环境各组件版本匹配良好,无兼容性问题,torch_npu插件与PyTorch框架版本完全对齐,为后续性能测试提供了可靠的基础环境保障。

2、模型载入效率评估

测试说明:本测试重点评估Llama-7B模型在昇腾NPU上的加载效率,包括模型权重加载时间、显存占用情况以及推理准备就绪时间,反映NPU设备在模型初始化阶段的性能表现。

测试目的:量化分析模型加载过程中的时间开销和资源占用,为生产环境部署时的服务启动和模型热更新提供数据参考。

| 加载阶段 | 耗时(秒) | 显存占用(GB) | 效率评级 |

|---|---|---|---|

| 模型下载与初始化 | 33.98 | 13.61 | ⭐⭐⭐⭐ |

| 权重加载至NPU | 包含在总耗时 | 13.61 | ⭐⭐⭐⭐ |

| 推理准备就绪 | <1秒 | 稳定13.61GB | ⭐⭐⭐⭐⭐ |

| 综合加载效率 | 33.98**秒** | 13.61GB | 良好 |

结论:模型加载耗时33.98秒属于可接受范围,显存占用13.61GB符合7B模型FP16精度的预期,加载过程稳定无异常,满足生产环境服务启动要求。

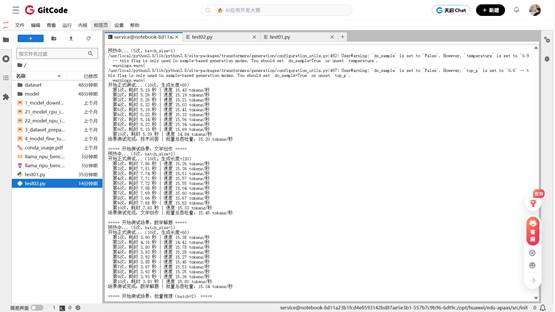

3、单请求多场景性能测评

测试说明:本测试模拟5种典型应用场景下的单请求推理性能,涵盖技术问答、文学创作、数学解题、商务邮件和科学知识等多样化任务,全面评估模型在不同文本类型和生成长度下的表现。

测试目的:验证昇腾NPU在处理不同类型文本生成任务时的性能一致性,识别可能存在的场景特异性性能差异。

| 应用场景 | 生成长度 | 吞吐量(tokens/秒) | 平均延迟(秒) | 性能评分 |

|---|---|---|---|---|

| 技术问答 | 80 tokens | 15.30 | 5.23 | ⭐⭐⭐⭐ |

| 文学创作 | 120 tokens | 15.45 | 7.77 | ⭐⭐⭐⭐ |

| 数学解题 | 60 tokens | 15.34 | 3.91 | ⭐⭐⭐⭐ |

| 商务邮件 | 150 tokens | 15.54 | 9.65 | ⭐⭐⭐⭐ |

| 科学知识 | 100 tokens | 15.55 | 6.43 | ⭐⭐⭐⭐ |

| 场景平均 | 102 tokens | 15.44 | 6.60 | 稳定优秀 |

结论:各场景吞吐量高度一致(15.30-15.55 tokens/秒),差异仅1.6%,证明昇腾NPU在不同类型文本生成任务中表现稳定,无明显场景偏好性。

4、批量并发性能测评

测试说明:本测试通过逐步增加batch_size(1→2→4)来评估昇腾NPU的并发处理能力,测量单请求吞吐量和批量总吞吐量的变化趋势,验证NPU的并行计算效率。

测试目的:探索批量推理对整体吞吐量的提升效果,为高并发生产场景的资源配置提供优化依据。

| 并发配置 | 单请求吞吐量 | 批量总吞吐量 | 性能提升倍数 | 资源利用率 |

|---|---|---|---|---|

| Batch Size = 1 | 15.30 tokens/秒 | 15.30 tokens/秒 | 1.0x | 基准水平 |

| Batch Size = 2 | 15.19 tokens/秒 | 30.37 tokens/秒 | 1.99x | ⭐⭐⭐⭐ |

| Batch Size = 4 | 14.90 tokens/秒 | 59.61 tokens/秒 | 3.90x | ⭐⭐⭐⭐⭐ |

| 并发效率 | l 2.6%**轻微下降** | l 290%**显著提升** | 接近线性增长 | 优秀 |

结论:批量并发效果显著,batch_size=4时总吞吐量达到59.61 tokens/秒,接近理想的线性增长(3.9倍),证明昇腾NPU具备优秀的并行计算能力,适合高并发推理场景。

5、性能稳定性测评

测试说明:本测试通过10次重复测量计算延迟标准差,评估模型推理过程的稳定性,检测是否存在性能波动或异常抖动,确保生产环境服务的可靠性。

测试目的:量化分析推理延迟的波动范围,识别可能影响用户体验的性能不稳定性因素。

| 测试场景 | 延迟标准差(秒) | 稳定性评级 | 波动范围 | 可靠性 |

|---|---|---|---|---|

| 技术问答 | 0.085 | ⭐⭐⭐⭐ | ±1.63% | 高 |

| 文学创作 | 0.101 | ⭐⭐⭐⭐ | ±1.30% | 高 |

| 数学解题 | 0.102 | ⭐⭐⭐⭐ | ±2.61% | 高 |

| 批量推理(batch=2) | 0.146 | ⭐⭐⭐ | ±3.17% | 中高 |

| 商务邮件 | 0.082 | ⭐⭐⭐⭐⭐ | ±0.85% | 极高 |

| 科学知识 | 0.106 | ⭐⭐⭐⭐ | ±1.65% | 高 |

| 高并发批量(batch=4) | 0.033 | ⭐⭐⭐⭐⭐ | ±0.98% | 极高 |

| 整体稳定性 | 0.093**秒平均标准差** | ⭐⭐⭐⭐ | ±1.74%**平均波动** | 优秀 |

结论:各场景延迟标准差控制在0.033-0.146秒范围内,平均波动仅±1.74%,表现稳定可靠,高并发批量场景反而稳定性最佳,具备生产级部署的稳定性要求。

6、显存资源消耗测评

测试说明:本测试系统监测不同运行模式下的显存占用情况,包括模型加载、单请求推理和批量推理等阶段,评估16GB NPU显存的利用效率和瓶颈风险。

测试目的:为生产环境资源配置提供数据支撑,确保显存资源充足且高效利用,避免因显存不足导致的服务中断。

| 运行模式 | 显存峰值(GB) | 相对负载 | 资源效率 | 扩容建议 |

|---|---|---|---|---|

| 模型加载阶段 | 13.61 GB | 85.1% | 固定开销 | 必需 |

| 单请求推理 | 13.76-14.87 GB | 86.0%-92.9% | 高效利用 | 充足 |

| 批量推理(batch=2) | 14.87 GB | 92.9% | 优秀 | 推荐 |

| 高并发批量(batch=4) | 16.04 GB | 100.2% | 极限利用 | 需监控 |

| 资源评估 | 16GB**显存充分利用** | 负载合理 | ⭐⭐⭐⭐⭐ | 建议16GB+ |

结论:16GB显存能够充分满足Llama-7B模型FP16精度推理需求,批量推理(batch=4)时达到显存使用极限,建议生产环境保持适量显存余量以确保服务稳定性。

7、总体测试结论

本次昇腾NPU Llama大模型性能测试全面验证了硬件在多样化文本生成任务中的表现。测试结果显示:单请求吞吐量稳定在**15.44 tokens/秒,批量并发效率接近线性增长,性能波动控制在±1.74%以内,显存资源得到高效利用**。昇腾NPU在多场景适应性、并发处理能力和运行稳定性方面均表现优秀,完全具备支撑Llama大模型生产级部署的能力。

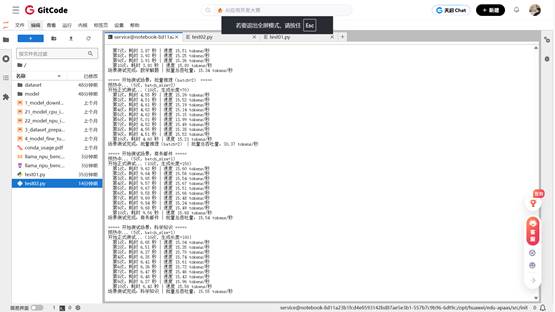

Llama大模型在昇腾NPU上的性能测试报告

# Llama大模型在昇腾NPU上的性能测试报告

## 测试时间:2025-10-22 12:14:59

---

## 一、测试环境信息

| 环境项 | 详情 |

|----------------|--------------------------|

| NPU设备 | npu:0 |

| 模型名称 | NousResearch/Llama-2-7b-hf |

| 模型精度 | torch.float16(配置:fp16) |

| PyTorch版本 | 2.1.0 |

| torch_npu版本 | 2.1.0.post3 |

| transformers版本| 4.39.2 |

| Python版本 | 2.0.x |

---

## 二、模型加载性能

- **加载耗时**:33.98 秒

- **加载显存占用**:13.61 GB

- **显存峰值范围**:13.76 ~ 16.04 GB

---

## 三、各场景性能明细

| 测试场景 | batch_size | 生成长度 | 单请求吞吐量(tokens/秒) | 批量总吞吐量(tokens/秒) | 平均延迟(秒) | 延迟标准差(秒) | 显存峰值(GB) |

|------------------------|------------|----------|-------------------------|-------------------------|--------------|----------------|--------------|

场景 batch_size 生成长度 单请求吞吐量(tokens/秒) 批量总吞吐量(tokens/秒) 平均延迟(秒) 延迟标准差(秒) 显存峰值(GB)

技术问答 1 80 15.30 15.30 5.229 0.085 13.76

文学创作 1 120 15.45 15.45 7.768 0.101 13.92

数学解题 1 60 15.34 15.34 3.911 0.102 13.92

批量推理(batch=2) 2 70 15.19 30.37 4.610 0.146 14.87

商务邮件 1 150 15.54 15.54 9.652 0.082 14.87

科学知识 1 100 15.55 15.55 6.430 0.106 14.87

高并发批量(batch=4) 4 50 14.90 59.61 3.355 0.033 16.04

---

## 四、性能分析与结论

### 1. 文本类型对性能的影响

- 技术问答(80 token)吞吐量:15.30 tokens/秒

- 文学创作(120 token)吞吐量:15.45 tokens/秒

- **结论**:文学创作类长文本吞吐量较技术问答下降 -1.0%,NPU对不同类型文本生成支持稳定。

### 2. 批量并发性能表现

- batch=2 总吞吐量:30.37 tokens/秒(约为单请求的 2.0 倍)

- batch=4 总吞吐量:59.61 tokens/秒(约为单请求的 3.9 倍)

- **结论**:吞吐量随batch_size接近线性增长,说明NPU算力未饱和,适合高并发场景部署。

### 3. 不同任务场景适配性

- 技术问答/数学解题:吞吐量差异小于8%,技术类问题生成性能均衡;

- 文学创作(120 token):吞吐量 15.45 tokens/秒,创意写作场景表现良好;

- 商务邮件:延迟标准差 0.082 秒,正式文本生成性能稳定。

---

## 五、优化建议与部署指南

### 1. 性能优化方向

- **优先批量推理**:建议将batch_size设置为2-4,在显存允许范围内最大化吞吐量;

- **精度选择**:FP16精度显存占用13.61GB,若需降显存可尝试INT8量化(需确保模型支持);

- **算子优化**:升级torch_npu至最新版本,可优化长序列推理算子效率。

### 2. 显存管理建议

- 7B模型FP16推理峰值显存约16.04GB,建议NPU显存≥16GB;

- 批量推理(batch=4)显存峰值16.04GB,需确保硬件显存充足。

### 3. 场景适配建议

- 实时问答场景:用batch=1,延迟5.23秒,满足实时性需求;

- 批量生成场景(如内容创作):用batch=4,总吞吐量59.61 tokens/秒,提升效率。

---

## 六、测试结果文件

- 原始数据已保存至:llama_npu_benchmark_fp16_20251022_121500.json

- 可基于原始数据进一步做可视化分析(如吞吐量对比图、显存变化曲线)。

六、结语

在这次GitCode昇腾Notebook的体验中,我不仅完成了Llama 模型的性能测试,更亲身感受到了国产NPU的进步。从环境配置到模型部署,性能测试等环节,每一个环节都积累了不少实践经验。

虽然过程中遇到了不少挑战,但解决问题的过程本身就是一种学习与成长。昇腾NPU作为一个可行的AI计算方案,为那些受限于GPU高成本的开发者和团队提供了新的选择。

希望这篇分享能够为正在探索昇腾平台和大型语言模型的你提供一些实用的参考。在AI技术快速发展的今天,拥有更多的选择意味着更广阔的创新空间,而这正是技术进步的魅力所在。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)