C2P-CLIP: Injecting Category Common Prompt in CLIP to Enhance Generalization in Deepfake Detection解读

This work focuses on AIGC detection to develop universaldetectors capable of identifying various types of forgery im-ages. Recent studies have found large pre-trained models,such as CLIP, are effectiv

C2P-CLIP: Injecting Category Common Prompt in CLIP to Enhance Generalization in Deepfake Detection

C2P-CLIP:在 CLIP 中注入类别通用提示以提升深度伪造检测的泛化能力

要点总结:

背景和要解决的问题:

现有基于 CLIP 的深度伪造检测方法虽有效,但存在两个关键未解决问题:

- 为何 CLIP 的特征通过线性分类器就能实现泛化性检测?

- 如何进一步挖掘 CLIP 的检测潜力,提升其性能?

关键发现:CLIP 的检测机制

研究者通过特征解码(将 CLIP 检测特征转化为文本) 和词频分析,首次揭示 CLIP 的检测逻辑:CLIP 并非直接识别图像 “真实 / 伪造” 的语义属性,而是通过匹配 “相似概念” 来区分伪造图像(例如,伪造图像的特征解码后会出现特定高频词汇,与真实图像形成差异

提出的方法:C2P-CLIP

基于上述发现,设计 “类别通用提示(Category Common Prompt)” 机制,核心步骤如下:

- caption 生成与增强:用 ClipCap 为图像生成描述文本,再为 “真实图像” 和 “伪造图像” 分别附加固定提示(如真实→“Camera”,伪造→“Deepfake”);

- 概念注入:冻结 CLIP 的文本编码器,仅用 LoRA(低秩适应)微调图像编码器,通过 “对比损失 + 分类损失” 将提示中的类别概念注入图像特征;

- 检测阶段:仅使用微调后的图像编码器和线性分类器,无额外测试参数,保证效率。

摘要:

聚焦生成式人工智能内容(AIGC)检测,旨在开发能够识别各类伪造图像的通用检测器。近期研究发现,CLIP 等大型预训练模型结合线性分类器,在泛化性深度伪造检测中具有良好效果,但仍存在两个关键未解决问题:1)为何 CLIP 特征通过线性分类器能实现有效的深度伪造检测;2)如何进一步挖掘 CLIP 的检测潜力。

在本研究中,我们通过将 CLIP 的检测特征解码为文本并进行词频分析,深入探究了其检测能力的内在机制。研究发现,CLIP 通过识别相似概念实现深度伪造检测(图 1a)。基于这一洞察,我们提出了 “类别通用提示 CLIP”(Category Common Prompt CLIP,简称 C2P-CLIP)—— 该方法将类别通用提示融入文本编码器,向图像编码器注入类别相关概念,从而提升检测性能(图 1b)。

与原始 CLIP 相比,我们的方法在检测准确率上提升了 12.41%,且在测试阶段无需引入额外参数。我们在两个广泛使用的数据集(涵盖 20 种生成模型)上开展了全面实验,验证了所提方法的有效性,其性能达到当前最优水平

引言:

目前的伪造检擦主要聚焦于人脸伪造检测,现有方法取得的紧张难以应对:未见过的深度伪造来源。

-

为何 CLIP 的特征通过线性分类器就能实现泛化性检测?

通过 ClipCap(Mokady、Hertz 与 Bermano,2021)将 CLIP 特征解码为文本,以探究这一问题,具体如图 2 (a)(b) 所示。具体而言,在 UniFd 方法(Ojha 等人,2023)中,研究人员将线性分类器fc应用于 CLIP 提取的图像特征v,以检测伪造图像。受此启发,我们将经线性分类器fc变换后的图像特征v定义为 “检测特征”。为深入理解 CLIP 的检测机制,我们分别将图像特征与检测特征解码为文本

注:

本文的

图像特征:指的是经过clip编码后的图像特征;

检测特征:图像特征再经过unifold线性分类器得到的特征

如图 2 (a) 所示,一张猫的图像经 CLIP 视觉模型处理后提取出图像特征,随后通过 ClipCap 将这些特征解码为文本:“一只猫趴在木桌上”。然而,当我们采用 UniFd 中的线性分类器得到检测特征,并将其解码为文本时,结果却变为:“一张包含多种事物的街道图片”。这一观察表明,图像中 “存在猫” 这类语义信息在检测特征中已不再被捕捉。我们推断,CLIP 本身并不具备 “真实” 与 “伪造” 的固有语义,而是通过识别并匹配相似概念来完成伪造检测

-

如何进一步挖掘 CLIP 的检测潜力,提升其性能?

提出类别通用提示 CLIP(Category Common Prompt CLIP,简称 C2P-CLIP);通过文本编码器向图像编码器注入类别概念,从而增强其区分 “真实” 与 “伪造” 图像的能力。

首先,利用 ClipCap 为训练图像生成文本描述(caption);

随后,为同一类别的图像描述分配统一的类别专属文本提示(即 “类别通用提示”)例如,为所有伪造样本的描述文本附加 “Deepfake”(深度伪造)提示,为所有真实样本的描述文本附加 “Camera”(相机拍摄)提示;

最后,利用这些新构建的图文对重新训练 CLIP,将类别通用概念有效嵌入图像编码器。在此过程中,我们冻结文本编码器的参数,仅采用 LoRA(低秩适应,Hu 等人,2021)对图像编码器进行训练

方法

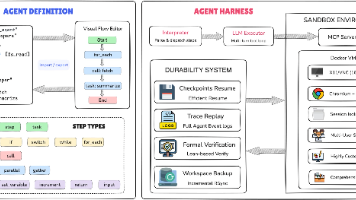

整体架构:

三个部分:文本描述生成与加强:为图像生成文本描述(caption),并通过附加:”类别通用提示“对其增强

概念注入:结合对比损失和分类损失,将增强后的文本描述的分类概念融入图像编码器

检查:将lora参数集成到图像编码器

文本描述生成与增强

设计 “类别通用提示” 以增强图像对应的文本描述,并利用这些增强后的文本描述通过对比学习,将分类概念嵌入图像编码器。具体而言,在训练阶段,我们为所有真实图像的文本描述附加统一提示(如 “Camera” 或 “Biden”),为所有伪造图像的文本描述附加另一组统一提示(如 “Deepfake” 或 “Trump”)。

设训练数据集X包含真实与伪造图像,定义如下:

其中(y=1)表示图像为伪造,(y=0)表示图像为真实。对于训练集中的每幅图像,我们通过 ClipCap 模型生成其对应的文本描述,所有文本描述构成集合C,

我们利用类别通用提示 ( P = { P r e a l , P f a k e } ) (P=\{P_{real}, P_{fake}\}) (P={Preal,Pfake})对文本描述进行增强,得到增强后的文本描述集合 ( C ~ ) (\tilde{C}) (C~):

概念注入(训练阶段)

采用对比学习策略,此阶段图像编码器和文本编码器参数都是冻结的,旨在图像编码器应用lora层。

俩个个关键损失:对比损失和分类损失

计算文本特征 u 和图像特征 v;

计算对比损失:

举例分析:

训练阶段:概念注入过程

生成原始文本描述(caption)

- 真实图像((y=0)):输入一张 “真实相机拍摄的猫趴在木桌上” 的图像,通过 ClipCap 生成原始文本描述(c_j=)“A cat laying on top of a wooden table”;

- 伪造图像((y=1)):输入一张 “ProGAN 生成的猫趴在木桌上” 的伪造图像,ClipCap 生成相似的原始文本描述(c_j=)“A cat laying on top of a wooden table”(因伪造图像视觉上与真实图像高度相似,原始文本描述难以区分)。

文本描述增强(附加类别通用提示)

选取提示对( P r e a l = C a m e r a , P f a k e = D e e p f a k e P_{real=Camera,P_{fake}=Deepfake} Preal=Camera,Pfake=Deepfake)

得到增强文本

- 真实图像增强后文本( c j ~ = \tilde{c_j}= cj~=)“(Camera, A cat laying on top of a wooden table)”;

- 伪造图像增强后文本( c j ~ = \tilde{c_j}= cj~=)“(Deepfake, A cat laying on top of a wooden table)”。

对比学习损失优化

- 文本编码器(冻结)将增强文本 ( c j ~ ) (\tilde{c_j}) (cj~)编码为文本特征 u j u_j uj :真实图像的 u j u_j uj会携带 “Camera + 猫” 的关联信息,伪造图像的(u_j)会携带 “Deepfake + 猫” 的关联信息;

- 图像编码器(带 LoRA 层)将图像编码为图像特征(v_j),对比损失 L contrastive \mathcal{L}_{\text{contrastive}} Lcontrastive会强制 “真实图像特征(v_j)与 Camera 文本特征(u_j)对齐”“伪造图像特征(v_j)与 Deepfake 文本特征(u_j)对齐”;

- 分类损失 L classification \mathcal{L}_{\text{classification}} Lclassification进一步引导线性分类器学习 “Camera 关联的特征 = 0(真实)”“Deepfake 关联的特征 = 1(伪造)” 的决策边界,最终通过加权损失(如(\alpha=8.0))完成图像编码器的 LoRA 微调。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)