【课程笔记·李宏毅教授】斯坦福&Google最新研究的AI村民的虚拟村庄

技术参考:它展示了怎么用ChatGPT控制AI做复杂互动——比如分层规划、Reflect反思,这些技术未来可以用在“AI助手协作”“虚拟世界NPC设计”上;人性模拟:AI村民的“脑补”“人际传播”“剧情发展”,让我们看到AI也能模拟出人类的“烟火气”,虽然不会讲“狗血台词”(比如不会有“小兔崽子快去写作业”这种冲突对话,都是“父慈子孝”的温和互动),但已经很有代入感了。

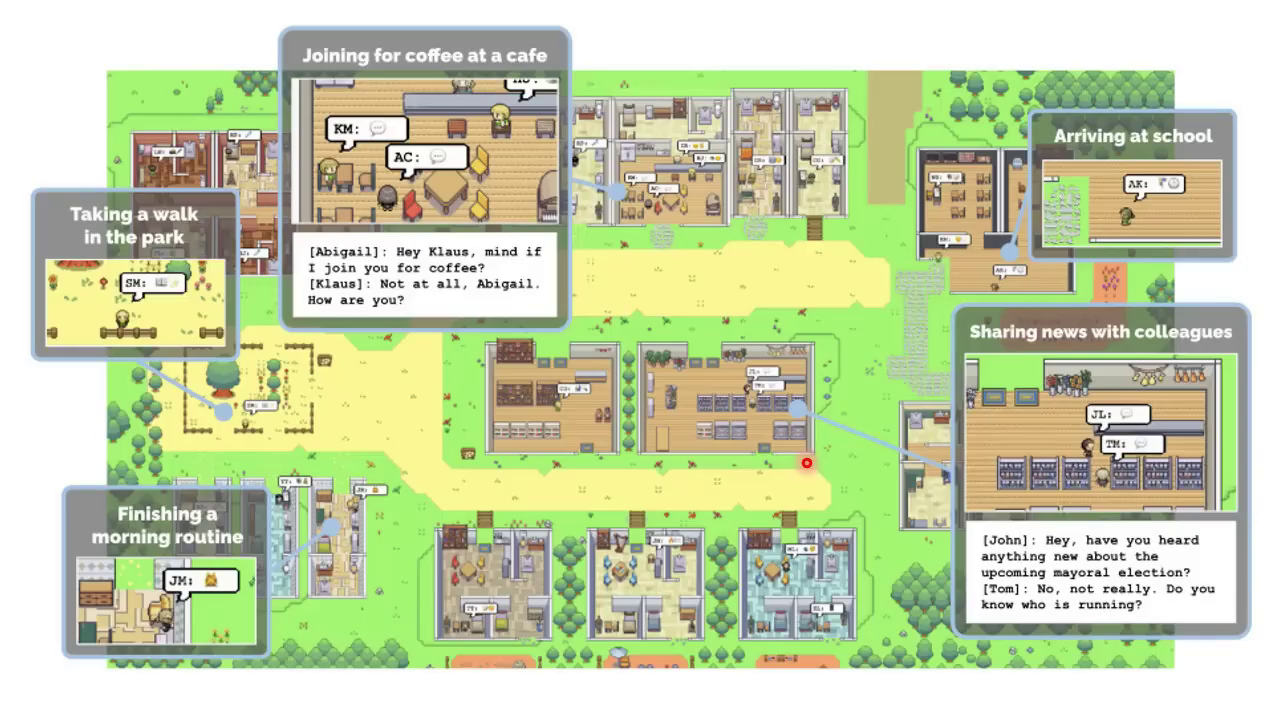

今天要跟大家分享一个极具影响力的研究——来自斯坦福和Google的团队,用AI村民组成了一个虚拟村庄,让他们运作了两天,观察这些“AI村民”的互动与剧情发展。这篇论文(标题《Generative Agents: Interactive Simulacra of Human Behavior》)发布于2023年4月,至今仍是“生成式智能体”领域的经典文献,而且斯坦福HAI实验室官网有配套demo——不过要说明:demo里的村民互动是预录的两天运作结果,没法实时观察,只能看“回放”,但能清晰查看每个村民的记忆、规划和反思。

那这些由ChatGPT操控的AI村民,在虚拟村庄里到底会怎么生活、怎么互动呢?我们一点点来看。

那这些由ChatGPT操控的AI村民,在虚拟村庄里到底会怎么生活、怎么互动呢?我们一点点来看。

一、虚拟村庄的基础设定:25个“有人设”的AI村民

首先,这个虚拟村庄里有25个NPC(非玩家角色),每一个都是由ChatGPT操控的生成式智能体(Generative Agents),不是随便乱逛的“路人甲”——每个村民都有专属人设:包括身份、目标、性格和过往经历。

举个例子:

- 伊莎贝拉(IR):咖啡店老板,目标是“2月14号情人节下午五点,在咖啡店里办一场情人节派对”,性格外向,喜欢主动邀请村民;

- AD:19岁学生,热爱音乐创作,每天固定“上课→写曲子→整理笔记”,性格内向,不擅长主动社交。

这些村民生活在模拟的村庄场景里,要做“正常人的日常”:早上起床刷牙洗脸、上学/开店、跟邻居聊天,甚至会记得“昨天跟谁一起吃了饭”——特别像《失控玩家》里的NPC,只不过背后是ChatGPT在操控,能自主发展出人际关系和剧情。

二、AI村民怎么“行动”?从“行为说明”到“环境指令”

很多人会好奇:这些AI村民是怎么跟环境互动的?比如伊莎贝拉想“去睡觉”,怎么让虚拟环境知道她要做这个动作?

核心流程分两步:

- ChatGPT生成“行为说明”:比如伊莎贝拉的大脑(ChatGPT)会根据当下状况,输出一段文字描述,比如“伊莎贝拉感到困倦,决定回到卧室上床睡觉”;

- 转译器翻译成“环境指令”:这段“行为说明”会被一个转译器处理成虚拟环境能识别的指令(比如“移动角色‘伊莎贝拉’到坐标(X,Y)的卧室,执行‘躺卧’动作”)。

这里要补充一下:目前推测这个转译器是“规则驱动(rule-based)”的——就是提前写好“‘去睡觉’对应哪些环境操作”,不用AI再去学习,毕竟重点是让ChatGPT控制“做什么”,而不是“怎么让环境响应”。

三、关键技术:让AI村民不“傻”的3个核心设计

如果只是让AI按人设随便动,很容易出问题——比如到了12点吃午餐,12点半又吃一次,1点还吃,完全不知道自己吃过了。为了避免这种“憨憨行为”,研究团队用了3个很重要的技术设计,这些技术对未来让AI做复杂任务、跟其他AI互动都很有参考价值。

1. 第一步:AI自己“规划一天”,按表操课不混乱

为什么要让AI规划一天?刚才说了,不规划就会“重复干一件事”。所以研究团队让每个AI每天早上先做“日程规划”,而且是“分层细化”的规划:

- 第一层:粗糙规划(以天为单位):给ChatGPT输入村民的人设、前一天的行为,让它生成当天的大致安排。比如AD的规划是“8点起床→10点上课→下午音乐创作→5点半吃饭→11点半睡觉”;

- 第二层:细化规划(以小时为单位):到了下午1点,再让ChatGPT把“音乐创作”拆成小时级动作,比如“1点 brainstorm 作曲思路→2点写旋律→4点休息吃点心→5点整理创作笔记”;

- 第三层:精准规划(以5分钟为单位):到了4点,再细化“休息吃点心”的细节,比如“4点拿点心→4点05分吃点心→4点10分收拾零食袋→4点15分散步→4点50分打扫工作间”。

这样一来,AI就会按规划过日子——早上起床、刷牙、煮早餐、跟家人聊天、打包书包去上课,跟正常人的节奏差不多,不会再反复吃午餐了。

2. 第二步:加入“外部刺激”,让AI不“一成不变”

但如果AI只会按规划做事,那就太无聊了——每天都穿一样的衣服、做一样的事,跟《失控玩家》里“觉醒前的盖”一样。所以研究团队要给AI“外部刺激”,让它们能根据外界变化调整行为。

那“外部刺激”是什么样的?其实就是AI在村庄里“看到的东西”——每隔一段时间,AI身边的物体(桌子、床、冰箱)、其他村民的状态,都会以文字形式传给它。但问题是:这些信息大多很琐碎,比如“桌子啥事也没发生”“冰箱啥事也没发生”“伊莎贝拉在装饰房间”,多数信息对AI的行为没意义。

这时候就需要一个关键机制——Reflect(反思):对这些琐碎的观察做“摘要”,抽取出真正重要的信息,相当于AI在“整理记忆”,知道哪些事值得记、哪些事会影响自己的计划。

3. 第三步:Reflect(反思)机制:让AI有“想法”,甚至会“妄想”

Reflect是整个研究里最有意思的部分,它让AI不只是“按规则做事”,还能产生自己的“想法”——甚至是像人类一样的“脑补”。具体怎么做?分4步:

(1)第一步:判断“事件重要性”,不记“鸡毛蒜皮”

首先要解决“哪些信息值得反思”:让ChatGPT给每个观察到的事件打分(1-10分),1分是“刷牙、折棉被”这种不重要的事,10分是“分手、被大学录取”这种重要的事。只有累积够多高分事件(比如3个8分以上的事件),AI才会启动反思。

(2)第二步:AI给自己“提问题”,驱动反思

启动反思后,AI会根据这些重要事件,给自己提3个问题——这些问题不是研究人员预设的,是AI自己想的。比如:

- 观察到“克劳斯和玛丽亚经常一起走”,AI可能会问“克劳斯和玛丽亚是不是在交往?”;

- 观察到“伊莎贝拉一直在装饰咖啡店”,AI可能会问“伊莎贝拉是不是在准备什么活动?”。

(3)第三步:检索“相关记忆”,找答案的依据

问题提出来后,AI需要从自己的“记忆库”里找依据——但记忆库全是“桌子没事”“冰箱没事”这种垃圾信息,所以要先“检索”:

- 按3个维度筛选:重要性(高分事件优先)、及时性(最近发生的优先)、关联性(用句子嵌入(sentence embedding)算“问题”和“记忆”的相似度,相似的优先);

- 比如问“克劳斯和玛丽亚是不是在交往”,AI会检索出“昨天看到他们一起买咖啡”“前天看到他们一起散步”这些相关记忆。

(4)第四步:生成“高层洞察”,存入记忆

根据检索到的记忆,AI会生成5个“高层洞察”(high-level insight),还要标注这些洞察来自哪些记忆。比如:

- 基于“一起买咖啡”“一起散步”,AI可能生成“克劳斯和玛丽亚的互动比普通朋友更亲密,推测他们可能互相有好感”;

- 这些洞察会存入记忆,甚至能基于之前的洞察生成新洞察——比如后来观察到“他们一起参加情人节派对”,AI可能会生成“克劳斯和玛丽亚大概率已经在交往了”。

这里要跟大家说个有意思的点:这些洞察不一定是真的,可能是AI的“脑补”——就像人类会“自作多情”一样。比如:

- 观察到“学妹总让自己修电脑”,AI可能会反思“学妹一定喜欢我”;

- 观察到“老板半夜打电话”,AI可能会反思“老板暗恋我”——这就像李雪琴脱口秀里说的“自我攻略”,或者咱们常说的“肥宅妄想”。

(5)反思的结果:AI的“内心想法”

这些反思后的洞察,就是AI的“内心想法”(研究里叫“sort”)。比如在demo里,我们能看到玛丽亚的“内心想法”是“我暗恋克劳斯”,再看克劳斯的“内心想法”——居然也是“我暗恋玛丽亚”!这就很有意思了,典型的“两情相悦但都不告白”的剧情。

不过这里要跟大家“剧透”一下:我怀疑有些“暗恋”的反思不是AI自己生成的,而是研究人员手动加的。为什么?因为正常的反思会标注“依据哪些记忆”,但“暗恋”相关的反思没有标注任何证据——就像突然有个“谜之声”在AI脑子里植入了这个想法。当然,这只是我的猜测,具体还要看后续研究的补充。

四、剧情发展:情人节派对的“传播与结局”

有了人设、规划和反思,AI村民之间就会发展出“剧情”,最完整的就是“伊莎贝拉的情人节派对”。

1. 派对消息的“人际传播”

伊莎贝拉要办情人节派对,她会主动跟路过的村民说“2月14号下午5点,来我咖啡店参加情人节派对”——总共跟9个人说了,然后这9个人又会传给自己的朋友或家人:

- Sam传给老婆Jennifer:“伊莎贝拉邀我们去情人节派对”;

- Elsa传给玛丽亚,但她传错了,说成“伊莎贝拉要办读书会,一起去啊”;

- 克劳斯暗恋玛丽亚,却没传给她,反而传给了Abby(有点“直男操作”了);

- 还有村民会回头跟伊莎贝拉确认:“听说你要办情人节派对?”。

从这个传播过程,我们能清晰看到AI村民的“人际关系网”——谁会跟谁分享消息,谁会传错消息,特别像现实中的人际互动。

2. 情人节派对的“真实结局”

到了2月14号,派对的结果特别“真实”——现实中常说“万人响应,零人到场”,这里虽然没那么惨,但也只来了4个人(本来有5个说要来,1个没来)。不过重点是:

- 玛丽亚来了,克劳斯也来了——他们不是一起的,是“正巧”都来的;

- 玛丽亚主动邀请克劳斯坐在自己对面,克劳斯本来就暗恋她,当然很开心;

- 最后他们在派对上互相告白,在一起了!

不过这里要跟大家说个小遗憾:demo网页加载特别慢,要从2月13号早上6点开始回放,我一直没等到2月14号下午,没亲眼看到他们告白的对话。如果有同学耐心等到了,记得回来跟我update一下细节!

五、总结:这个研究的价值与趣味

今天跟大家分享的这个AI虚拟村庄,不只是“好玩”,还有两个很重要的价值:

- 技术参考:它展示了怎么用ChatGPT控制AI做复杂互动——比如分层规划、Reflect反思,这些技术未来可以用在“AI助手协作”“虚拟世界NPC设计”上;

- 人性模拟:AI村民的“脑补”“人际传播”“剧情发展”,让我们看到AI也能模拟出人类的“烟火气”,虽然不会讲“狗血台词”(比如不会有“小兔崽子快去写作业”这种冲突对话,都是“父慈子孝”的温和互动),但已经很有代入感了。

如果大家对这个研究感兴趣,可以去arXiv找这篇论文(今年四月发布,作者标了Stanford和Google),也可以去玩一下demo——虽然慢,但看着AI村民过日子,还挺有意思的。

以上就是今天要分享的内容,谢谢大家!

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)