个人电脑怎么跑大模型?一文解决技术难题

学会用简单的工具+方法,小白也能3分钟搞定,数据安全、响应快、还省钱,简直不要太香!右键桌面“此电脑”-“属性”-“设备管理器”-“显示适配器”,看显卡型号,上网搜“显卡型号+显存”就能查到。最近DeepSeek模型火出圈了,但不少朋友吐槽:“每次用都得联网,数据隐私没保障”“API调用次数多了,钱包扛不住啊!本地部署后,你问的所有问题、上传的文档,全在电脑里“转圈圈”,连网都不需要,再也不用担心

最近DeepSeek模型火出圈了,但不少朋友吐槽:“每次用都得联网,数据隐私没保障”“API调用次数多了,钱包扛不住啊!”别急,今天咱们就手把手教你如何本地部署DeepSeek模型,让你用最简单的方式,在自己的电脑上搭建一个强大的AI助手!

一、为什么非要本地部署?3个理由告诉你:

1.数据隐私拉满:

本地部署后,你问的所有问题、上传的文档,全在电脑里“转圈圈”,连网都不需要,再也不用担心隐私泄露。

2.响应快到飞起:

没有网络延迟,DeepSeek的回答像闪电一样“嗖”地蹦出来,比在线版快3倍不止!

3.成本直接归零:

一次性搞定硬件(比如买块显卡),之后想怎么用就怎么用,再也不用为API调用次数掏钱。

二、本地部署DeepSeek模型,选对工具是关键!

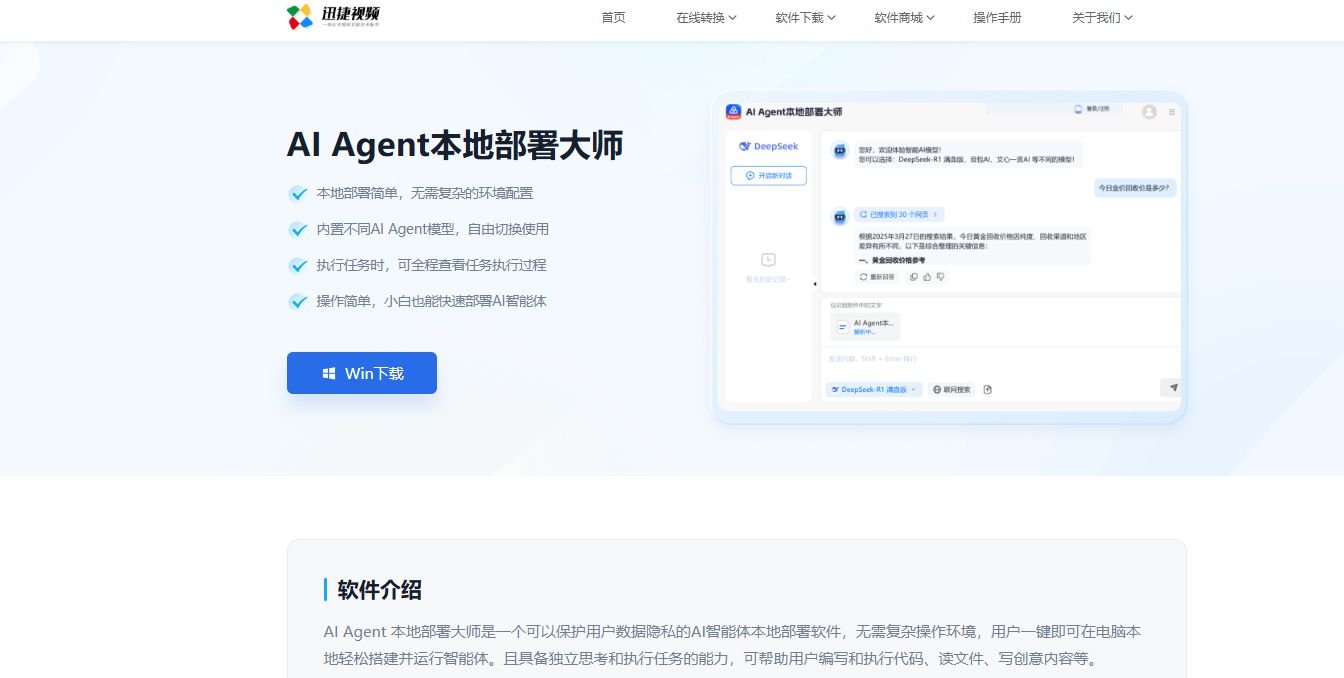

说到部署,很多人第一反应是:“要装Python吗?要敲命令行吗?我这种电脑小白能行吗?”别慌!“AI Agent本地部署大师”来帮忙,专为小白设计,一键安装,3分钟搞定!

工具亮点:

·傻瓜式操作:不用装Python、CUDA,不用敲代码,像装微信一样简单。

·模型全覆盖:DeepSeek-R1、豆包、文心一言……想用哪个点哪个。

·硬件自适应:自动检测你的电脑配置,推荐最适合的模型版本(比如1.5B、7B、32B)。

·离线也能用:断网?高铁?飞机?DeepSeek照样陪你唠嗑。

三、手把手教程:用AI Agent本地部署大师装DeepSeek

第一步:下载安装(1分钟)

1.打开浏览器,搜索“AI Agent本地部署大师”,进入官网下载Windows版安装包。

2.双击安装包,一路点“下一步”,建议装到D盘(别占C盘空间)。

3.安装完成,桌面出现一个萌萌的AI图标,点开它!

第二步:选模型(30秒)

1.主界面点“下载模型”,你会看到一堆DeepSeek版本:

·1.5B:2G显存就能跑,低配电脑首选。

·7B:8G显存,性能更强,适合写代码、做文案。

·32B:32G显存,土豪专属,回答更“聪明”。

2.根据你的显卡选版本(比如我的笔记本是GTX 1660,选7B刚好),点“立即部署”。

第三步:启动模型(20秒)

1.下载完,模型会出现在“本地模型”列表里。

2.选中它,点“启动”,软件会偷偷加载模型到内存/显存。

3.几秒钟后,弹出聊天窗口,输入“你好”,它会实时秒回哦~

四、避坑指南:这3个坑千万别踩!

坑1:硬件不达标,强行装大模型

·症状:点启动后,电脑卡成PPT,甚至蓝屏。

·解法:1.5B模型需要至少2G显存,7B需要8G,32B需要32G。不确定显存?右键桌面“此电脑”-“属性”-“设备管理器”-“显示适配器”,看显卡型号,上网搜“显卡型号+显存”就能查到。

坑2:模型下载慢,等得想砸电脑

·症状:下载进度条像蜗牛爬,1%...2%...3%...

·解法:

①白天用网高峰期?试试凌晨下载。

②关闭所有占带宽的软件(比如视频、下载工具)。

③用手机热点(部分运营商对家庭宽带限速,手机4G/5G反而更快)。

坑3:启动后没反应,聊天窗口空白

·症状:点启动后,软件卡住,聊天窗口一片白。

·解法:

①重启软件(任务管理器结束进程,再重新打开)。

②换个模型版本(比如从7B换到1.5B)。

③检查显卡驱动是否最新(右键桌面-“NVIDIA控制面板”-“帮助”-“系统信息”,看驱动版本)。

现在你们知道如何本地部署DeepSeek模型了吧?其实就是“选对工具+避开硬件坑+耐心等下载”三步走。学会用简单的工具+方法,小白也能3分钟搞定,数据安全、响应快、还省钱,简直不要太香!

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)