解锁AI驱动虚拟旅游,AI应用架构师的独门秘籍

当AI技术从“工具化”走向“场景化”,虚拟旅游正成为其落地的黄金赛道——从实时生成的赛博古镇到能对话的虚拟文物,从个性化的旅行路线规划到跨时空的文化沉浸体验,AI正在重构“旅游”的本质。本文将以AI应用架构师的视角,拆解虚拟旅游系统的底层逻辑与实践方法论:从“第一性原理”推导AI在虚拟旅游中的核心价值,到四层架构设计(交互层→AI能力层→场景引擎层→数据底座层)的详细实现,再到生成式场景合成多模态

解锁AI驱动虚拟旅游:AI应用架构师的系统设计与实践秘籍

元数据框架

标题

解锁AI驱动虚拟旅游:AI应用架构师的系统设计与实践秘籍

关键词

AI驱动虚拟旅游、生成式AI架构、数字孪生旅游场景、多模态交互系统、用户意图理解、实时场景合成、智能推荐引擎

摘要

当AI技术从“工具化”走向“场景化”,虚拟旅游正成为其落地的黄金赛道——从实时生成的赛博古镇到能对话的虚拟文物,从个性化的旅行路线规划到跨时空的文化沉浸体验,AI正在重构“旅游”的本质。本文将以AI应用架构师的视角,拆解虚拟旅游系统的底层逻辑与实践方法论:从“第一性原理”推导AI在虚拟旅游中的核心价值,到四层架构设计(交互层→AI能力层→场景引擎层→数据底座层)的详细实现,再到生成式场景合成、多模态意图理解等关键模块的代码优化技巧。无论是想搭建AI虚拟旅游系统的技术从业者,还是希望理解AI如何赋能文旅的产品经理,本文都将提供可落地的架构蓝图与避坑指南。

1. 概念基础:从“虚拟旅游”到“AI驱动虚拟旅游”的本质跃迁

1.1 领域背景化:虚拟旅游的三次进化

虚拟旅游的本质是**“用技术还原/创造异地体验”**,其发展经历了三个阶段:

- 1.0时代(2000-2015):静态全景时代——以360°照片/视频为主,用户被动浏览(如Google街景早期版本);

- 2.0时代(2015-2020):VR互动时代——结合VR设备实现沉浸式漫游,但内容依赖预渲染,交互仅限于“走/看”;

- 3.0时代(2020至今):AI驱动时代——用生成式AI(AIGC)、数字孪生、大语言模型(LLM)重构体验:内容可生成、交互可对话、场景可演化。

AI的加入,让虚拟旅游从“复刻现实”升级为“创造超现实”——比如用户可以要求“在唐朝的长安街上吃胡饼”,AI会实时生成符合历史逻辑的场景、人物与互动情节。

1.2 问题空间定义:传统虚拟旅游的三大痛点

AI驱动虚拟旅游的核心目标,是解决传统方案的三个根本性问题:

- 内容静态化:预渲染内容无法响应用户个性化需求(比如用户想“看雪后的故宫”,传统系统需要提前制作该场景);

- 交互浅层化:仅支持“移动/点击”,无法实现“自然语言对话”“动作反馈”等深层交互;

- 体验同质化:所有用户的路线、内容完全一致,无法满足“个性化旅行”需求。

AI的价值,就是用动态生成解决“内容静态”,用多模态理解解决“交互浅层”,用个性化建模解决“体验同质”。

1.3 关键术语精确化

为避免概念混淆,先明确本文核心术语的定义:

- 数字孪生旅游场景:通过IoT、激光扫描等技术,将现实旅游场景(如古镇、文物)的物理属性(结构、材质、光影)与逻辑属性(历史事件、人物关系)数字化,形成“虚实同步”的虚拟镜像;

- 多模态用户交互:支持用户通过**语言(文字/语音)、动作(VR手柄/体感)、视觉(眼神/手势)**等多种方式与虚拟场景互动;

- 生成式场景合成:基于用户输入(如“秋天的苏州园林”),用AI模型(如Stable Diffusion、NeRF)实时生成符合要求的3D场景;

- 用户意图理解引擎:结合LLM与知识库,将用户的自然语言输入(如“我想找一个安静的茶馆”)转化为可执行的系统指令(如“在当前场景中定位距离最近的、评分≥4.5的茶馆,并规划路径”)。

2. 理论框架:AI驱动虚拟旅游的第一性原理推导

2.1 第一性原理:虚拟旅游的“体验三角”

从第一性原理出发,虚拟旅游的核心是**“用户体验”**,而体验由三个维度构成(体验三角模型):

Experience=Immersion×Personalization×Interaction Experience = Immersion \times Personalization \times Interaction Experience=Immersion×Personalization×Interaction

- Immersion(沉浸感):让用户“感觉自己在现场”的能力,依赖场景的真实度与感官覆盖(视觉、听觉、触觉);

- Personalization(个性化):让体验“符合用户需求”的能力,依赖用户偏好的精准建模;

- Interaction(交互性):让用户“能改变场景”的能力,依赖系统对用户行为的实时响应。

AI的作用,就是通过技术手段最大化这三个维度的乘积:

- 用生成式AI提升沉浸感(实时生成高真实度场景);

- 用推荐算法提升个性化(基于用户行为建模偏好);

- 用多模态理解提升交互性(理解用户的语言/动作意图)。

2.2 数学形式化:用户偏好与场景匹配模型

要实现“个性化体验”,核心是建立用户偏好向量与场景特征向量的匹配模型。假设:

- 用户集合U={u1,u2,...,um}U = \{u_1, u_2, ..., u_m\}U={u1,u2,...,um},每个用户的偏好向量为pu∈Rk\mathbf{p}_u \in \mathbb{R}^kpu∈Rk(kkk为偏好维度,如“喜欢历史”“喜欢自然”“喜欢热闹”);

- 场景集合S={s1,s2,...,sn}S = \{s_1, s_2, ..., s_n\}S={s1,s2,...,sn},每个场景的特征向量为qs∈Rk\mathbf{q}_s \in \mathbb{R}^kqs∈Rk(如“历史古迹”“自然景观”“商业街区”);

- 用户uuu对场景sss的满意度为ru,s=pu⋅qs+ϵr_{u,s} = \mathbf{p}_u \cdot \mathbf{q}_s + \epsilonru,s=pu⋅qs+ϵ(ϵ\epsilonϵ为随机误差)。

传统协同过滤算法通过用户-场景交互矩阵RRR(Ru,s=ru,sR_{u,s}=r_{u,s}Ru,s=ru,s)训练pu\mathbf{p}_upu与qs\mathbf{q}_sqs,但冷启动问题(新用户/新场景无交互数据)严重。AI驱动的方案则引入多源数据增强:

- 对新用户,用LLM分析其注册时的“兴趣描述”(如“我喜欢唐朝文化和安静的地方”),生成初始偏好向量pu\mathbf{p}_upu;

- 对新场景,用计算机视觉模型提取场景的“视觉特征”(如建筑风格、色彩基调),结合知识库的“语义特征”(如“唐朝长安街”的历史标签),生成特征向量qs\mathbf{q}_sqs。

优化后的满意度预测模型为:

ru,s=α(pu⋅qs)+β(f(xu)⋅g(ys))+ϵ r_{u,s} = \alpha(\mathbf{p}_u \cdot \mathbf{q}_s) + \beta(f(\mathbf{x}_u) \cdot g(\mathbf{y}_s)) + \epsilon ru,s=α(pu⋅qs)+β(f(xu)⋅g(ys))+ϵ

其中:

- α,β\alpha, \betaα,β为权重系数;

- f(xu)f(\mathbf{x}_u)f(xu)是用户行为序列的Transformer编码(如用户在虚拟场景中的停留时间、点击行为);

- g(ys)g(\mathbf{y}_s)g(ys)是场景动态特征的LSTM编码(如场景中的人流密度、天气变化)。

2.3 理论局限性:AI驱动虚拟旅游的边界

尽管AI能力强大,但仍有三个无法突破的边界:

- 真实性约束:生成式AI可能产生“不符合历史/物理逻辑”的内容(如“唐朝长安街上出现汽车”),需要知识库校验(如接入《中国历史大辞典》的API);

- 实时性约束:3D场景生成的时间复杂度高(如NeRF生成1帧需要0.1秒),无法满足“实时交互”(要求<0.03秒/帧),需要模型轻量化(如用LCM-LoRA加速Stable Diffusion);

- 伦理约束:虚拟场景中的文化元素(如少数民族建筑、宗教符号)需要尊重原真性,不能随意生成或修改,需要文化顾问团队的介入。

2.4 竞争范式分析:AI驱动 vs 传统VR虚拟旅游

| 维度 | 传统VR虚拟旅游 | AI驱动虚拟旅游 |

|---|---|---|

| 内容生成方式 | 预渲染(固定场景) | 实时生成(动态响应用户需求) |

| 交互方式 | 手柄/头部追踪(浅层) | 语言/动作/视觉(深层多模态) |

| 个性化能力 | 无(所有用户体验一致) | 强(基于用户偏好动态调整) |

| 内容更新成本 | 高(需重新渲染场景) | 低(AI自动生成新内容) |

| 技术依赖 | VR硬件、3D建模工具 | AIGC模型、LLM、数字孪生技术 |

3. 架构设计:AI驱动虚拟旅游的四层系统架构

3.1 系统整体架构:从用户到数据的全链路设计

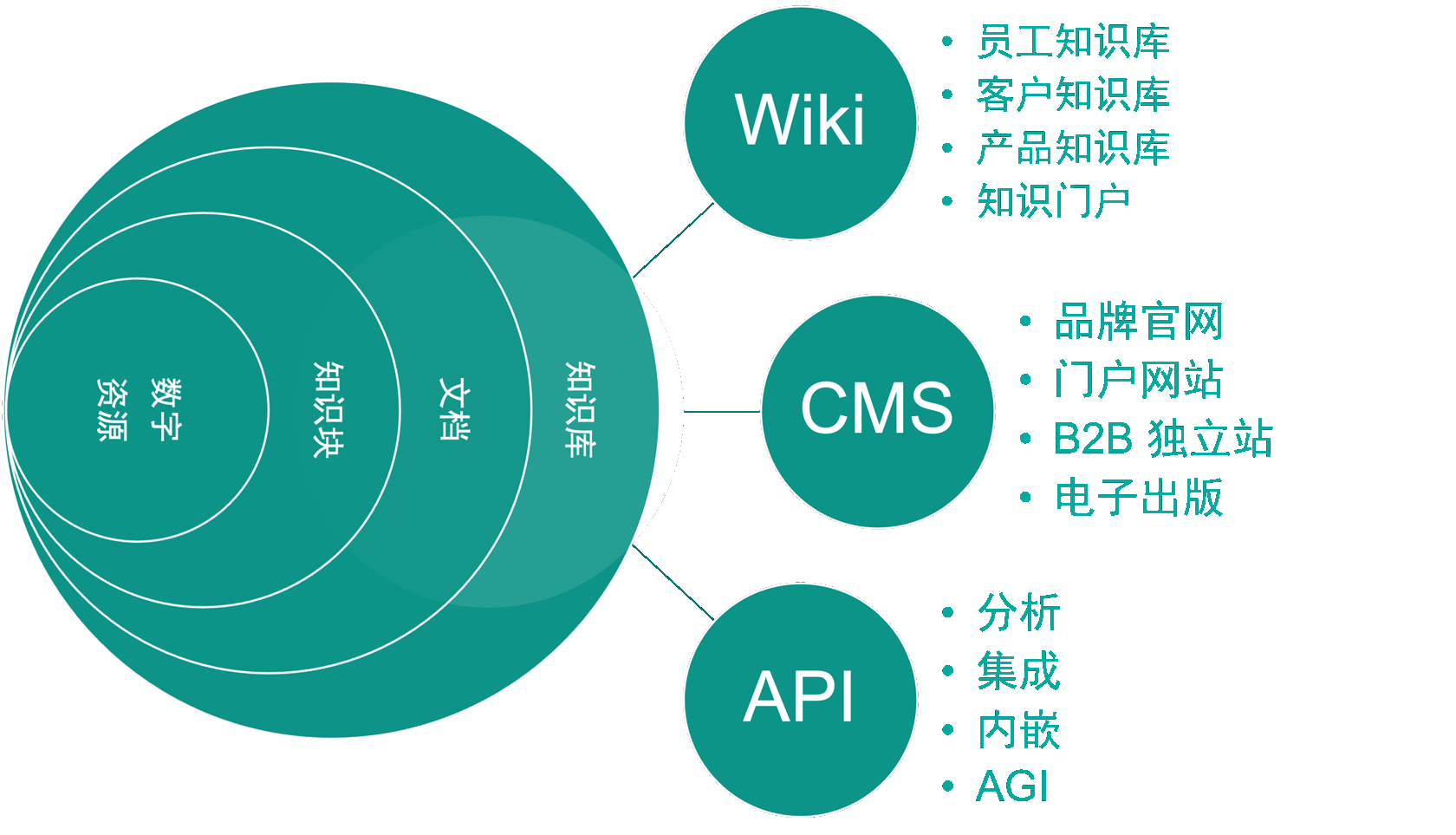

AI驱动虚拟旅游系统的核心架构分为四层(如图1所示),采用微服务+事件驱动模式,确保扩展性与实时性:

图1:AI驱动虚拟旅游系统四层架构

各层的核心职责与组件如下:

3.1.1 第一层:用户交互层(User Interaction Layer)

核心目标:实现“自然、多模态”的用户与系统交互。

关键组件:

- 多模态输入模块:支持语音(ASR,如阿里云Speech)、文字(LLM意图理解)、动作(VR手柄/体感传感器)、视觉(摄像头手势识别,如MediaPipe)输入;

- 多模态输出模块:支持视觉(3D场景渲染)、听觉(空间音频,如Steam Audio)、触觉(VR手套力反馈)输出;

- 交互管理引擎:统一处理输入输出的路由与格式转换(如将用户的语音“我想喝茶”转换为JSON指令)。

设计模式:采用适配器模式,将不同输入设备的信号转换为标准格式(如“动作输入”转换为“坐标+事件”),降低新增设备的适配成本。

3.1.2 第二层:AI能力层(AI Capability Layer)

核心目标:提供虚拟旅游所需的AI核心能力,是系统的“大脑”。

关键组件:

-

用户意图理解引擎:

- 基于LLM(如GPT-4、Claude 3)实现自然语言理解,结合旅游领域知识库(如景点信息、历史知识),将用户输入转化为系统指令(如“用户想找唐朝风格的茶馆→指令:在当前场景中搜索标签为‘唐朝’且类型为‘茶馆’的POI”);

- 优化技巧:用Prompt Engineering缩小LLM的输出范围(如Prompt:“你是虚拟旅游的意图理解助手,请将用户的问题转换为以下格式的指令:{类型: ‘POI搜索’, 条件: {标签: ‘唐朝’, 类型: ‘茶馆’}}”)。

-

生成式场景合成引擎:

- 基于**文本到3D(Text-to-3D)**模型(如Stable Diffusion 3D、NeRF),根据用户需求实时生成场景;

- 优化技巧:用**LoRA(Low-Rank Adaptation)**微调模型,使其生成的场景符合旅游领域的真实度要求(如“生成苏州园林”时,确保建筑风格符合明清时期的特征)。

-

智能推荐引擎:

- 基于混合推荐算法(协同过滤+内容推荐+深度学习),根据用户偏好推荐场景或路线;

- 优化技巧:用** reinforcement learning(强化学习)**优化推荐策略——将用户在虚拟场景中的行为(如停留时间、点击次数)作为“奖励信号”,动态调整推荐权重。

设计模式:采用微服务模式,将每个AI能力封装为独立服务(如“意图理解服务”“场景合成服务”),通过API网关(如Nginx)对外提供接口,便于横向扩展与版本管理。

3.1.3 第三层:场景引擎层(Scene Engine Layer)

核心目标:实现虚拟场景的实时渲染与动态演化,是系统的“身体”。

关键组件:

-

数字孪生场景库:

- 存储现实旅游场景的数字孪生数据(如故宫的建筑结构、丽江古城的街道布局),数据格式采用**glTF(通用3D格式)**以便于渲染;

- 数据更新策略:通过IoT传感器(如故宫的温湿度传感器)实时同步现实场景的状态(如“故宫的太和殿正在维修→虚拟场景中显示脚手架”)。

-

实时渲染引擎:

- 基于Unreal Engine 5或Unity实现3D场景渲染,支持光线追踪(Ray Tracing)提升真实度;

- 优化技巧:用**层级细节(LOD)**技术——对距离用户远的物体渲染低精度模型,对距离近的物体渲染高精度模型,降低GPU负载。

-

场景动态管理引擎:

- 处理场景中的动态元素(如行人、天气、事件),比如“用户触发‘下雨’指令→场景动态管理引擎调用天气模型生成雨效,并调整行人的动作(如打伞)”;

- 设计模式:采用事件驱动模式,将场景中的动态变化作为“事件”(如“下雨事件”“行人移动事件”),通过消息队列(如Kafka)通知各组件响应。

3.1.4 第四层:数据底座层(Data Foundation Layer)

核心目标:为系统提供数据存储与计算能力,是系统的“地基”。

关键组件:

-

多源数据存储:

- 用户数据:存储用户的注册信息、偏好向量、行为日志,采用**MySQL(关系型)+ Redis(缓存)**组合(MySQL存储全量数据,Redis缓存高频访问的用户偏好);

- 场景数据:存储数字孪生场景的3D模型、纹理、语义标签,采用对象存储(如阿里云OSS)+图数据库(如Neo4j)——对象存储存储大文件(如glTF模型),图数据库存储场景的语义关系(如“太和殿→属于故宫→位于北京”);

- AI模型数据:存储预训练模型、微调后的LoRA权重,采用模型仓库(如Hugging Face Hub)+本地缓存。

-

大数据计算引擎:

- 基于Spark或Flink处理用户行为日志,生成用户偏好向量(如“用户在‘唐朝’标签的场景停留时间超过10分钟→偏好向量中‘历史’维度加0.1”);

- 基于TensorFlow Serving或TorchServe部署AI模型,提供低延迟的推理服务。

3.2 组件交互示例:用户“找唐朝茶馆”的全流程

为了更清晰地理解架构的运行逻辑,我们以用户的一个具体需求为例:“我想在虚拟长安街上找一家唐朝风格的茶馆”。

全流程的交互步骤如下:

- 用户交互层:用户用语音输入需求,ASR模块将语音转换为文字“我想在虚拟长安街上找一家唐朝风格的茶馆”;

- AI能力层-意图理解引擎:LLM结合旅游知识库,将文字转换为指令:

{类型: 'POI搜索', 条件: {场景: '虚拟长安城', 标签: '唐朝', 类型: '茶馆'}}; - 场景引擎层-场景动态管理引擎:接收指令后,从数字孪生场景库中搜索符合条件的POI(“同福茶馆”),并规划从用户当前位置到茶馆的路径;

- 场景引擎层-实时渲染引擎:渲染路径上的场景(如长安街的街道、行人),并在用户界面显示“同福茶馆”的标识;

- 用户交互层:将渲染后的场景通过VR设备展示给用户,同时用空间音频播放茶馆的叫卖声;

- 数据底座层:记录用户的行为(“搜索唐朝茶馆”),并将数据同步到大数据计算引擎,更新用户的偏好向量(“历史”维度加0.05)。

4. 实现机制:关键模块的代码优化与边缘情况处理

4.1 生成式场景合成:从“慢渲染”到“实时生成”的优化

生成式场景合成是AI驱动虚拟旅游的核心模块,但传统Text-to-3D模型(如Stable Diffusion 3D)的推理时间过长(生成1个场景需要30秒),无法满足实时交互需求。以下是架构师常用的优化技巧:

4.1.1 技巧1:用LCM-LoRA加速推理

LCM(Latent Consistency Models)是一种针对生成式模型的加速技术,通过减少生成步骤(从50步减少到4步)实现推理加速。结合LoRA(低秩适应)微调,可以在保持场景质量的同时,将推理时间缩短至2秒以内。

代码示例(PyTorch):

from diffusers import StableDiffusion3DPipeline

from peft import LoraConfig, get_peft_model

# 加载基础模型

pipe = StableDiffusion3DPipeline.from_pretrained("stabilityai/stable-diffusion-3d")

# 配置LCM-LoRA

lora_config = LoraConfig(

r=8, # 低秩矩阵的秩

lora_alpha=16,

target_modules=["q_proj", "v_proj"], # 针对Transformer的查询/值投影层

lora_dropout=0.05,

bias="none",

task_type="TEXT_2_3D"

)

# 微调模型

model = get_peft_model(pipe.unet, lora_config)

model.load_state_dict(torch.load("lcm_lora_weights.pth"))

# 推理(生成唐朝茶馆场景)

prompt = "A Tang Dynasty tea house in Chang'an Street, detailed, realistic"

scene = pipe(prompt, num_inference_steps=4).images[0]

4.1.2 技巧2:用NeRF轻量化模型(如Instant-NGP)

NeRF(神经辐射场)是生成高真实度3D场景的主流技术,但传统NeRF的训练时间长(需要数小时)。Instant-NGP(Instant Neural Graphics Primitives)通过多分辨率哈希编码(Multi-Resolution Hash Encoding)将训练时间缩短至几分钟,推理时间缩短至0.01秒/帧,非常适合实时虚拟旅游场景。

代码示例(C++/CUDA):

// 初始化Instant-NGP

auto config = ngp::Config();

config.scene = "chang_an_street.nerf"; // 数字孪生场景的NeRF数据

auto ngp = ngp::NeuralGraphicsPrimitives(config);

// 生成用户需求的场景(唐朝茶馆)

ngp.set_prompt("Tang Dynasty tea house");

ngp.train(1000); // 训练1000步(约2分钟)

// 实时渲染

while (true) {

auto frame = ngp.render(); // 0.01秒/帧

display(frame);

}

4.2 用户意图理解:处理“模糊输入”的fallback策略

用户的输入往往是模糊的(如“我想找一个好玩的地方”),此时意图理解引擎需要主动追问或基于上下文推测。以下是具体实现:

4.2.1 模糊输入的分类与处理

| 模糊类型 | 处理策略 |

|---|---|

| 需求不明确 | 追问用户(如“你想找自然景观还是历史古迹?”) |

| 上下文依赖 | 结合用户历史行为推测(如用户之前搜索过“唐朝”,则推测“好玩的地方”是唐朝风格的场景) |

| 语义歧义 | 用知识库校验(如“好玩的地方”可能指“有表演的场所”,则搜索标签为“表演”的POI) |

4.2.2 代码示例(基于LLM的意图理解)

import openai

def understand_intent(user_input, user_history):

# 构建Prompt,结合用户历史行为

prompt = f"""

用户现在说:“{user_input}”,之前的行为是:{user_history}。

请判断用户的意图:

1. 如果需求明确,输出指令格式:{{类型: 'XXX', 条件: {{...}}}}

2. 如果需求模糊,输出追问内容:“请问你想找自然景观还是历史古迹?”

"""

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[{"role": "user", "content": prompt}]

)

result = response.choices[0].message.content

# 解析结果

if "{" in result:

return {"type": "intent", "data": eval(result)}

else:

return {"type": "fallback", "data": result}

# 示例调用

user_input = "我想找一个好玩的地方"

user_history = ["搜索过唐朝长安街", "停留过10分钟在同福茶馆"]

result = understand_intent(user_input, user_history)

# 输出:{"type": "intent", "data": {"类型": "POI搜索", "条件": {"标签": "唐朝", "类型": "表演场所"}}}

4.3 边缘情况处理:内容合规性与用户隐私保护

4.3.1 内容合规性:防止生成违规内容

生成式AI可能生成不符合法律或道德的内容(如“虚拟场景中的色情元素”“歪曲历史的场景”),需要两道防线:

- Prompt过滤:用LLM或规则引擎过滤用户的违规输入(如“我想找色情场景”→直接拒绝);

- 生成内容校验:用多模态内容审核模型(如阿里云内容安全)检查生成的场景,若包含违规元素,则重新生成。

4.3.2 用户隐私保护:处理生物特征数据

虚拟旅游中可能收集用户的生物特征数据(如VR设备的眼球追踪数据、体感传感器的动作数据),需要遵循GDPR或**《个人信息保护法》**:

- 数据最小化:只收集必要的数据(如眼球追踪数据仅用于优化场景布局,不存储用户的具体眼神轨迹);

- 匿名化处理:将用户的生物特征数据与身份信息分离(如用UUID代替用户名存储数据);

- 用户授权:在收集数据前明确告知用户用途,并获得书面同意。

5. 实际应用:从0到1搭建AI虚拟旅游系统的实施策略

5.1 实施步骤:四阶段落地法

搭建AI驱动虚拟旅游系统是一个复杂的工程,需要分阶段实施:

阶段1:需求调研与场景定义(1-2个月)

- 目标:明确系统的核心场景与用户需求;

- 关键输出:

- 目标用户画像(如“历史爱好者”“家庭游客”“文化研究者”);

- 核心场景清单(如“虚拟长安街”“虚拟苏州园林”“虚拟敦煌莫高窟”);

- 功能需求文档(如“支持自然语言对话”“实时生成场景”“个性化推荐”)。

阶段2:数据采集与数字孪生构建(2-3个月)

- 目标:构建系统的数据底座;

- 关键任务:

- 采集现实场景的数据(如用激光扫描仪扫描故宫,生成3D模型);

- 构建旅游领域知识库(如整合《中国历史大辞典》《世界遗产名录》的内容);

- 存储数据(将3D模型上传至对象存储,将知识库导入图数据库)。

阶段3:AI模型开发与架构搭建(3-4个月)

- 目标:实现系统的核心AI能力与架构;

- 关键任务:

- 开发意图理解引擎(基于LLM微调);

- 开发生成式场景合成引擎(基于Stable Diffusion 3D或Instant-NGP);

- 搭建四层架构(用户交互层→AI能力层→场景引擎层→数据底座层)。

阶段4:测试迭代与运营优化(持续进行)

- 目标:提升系统的稳定性与用户体验;

- 关键任务:

- 功能测试(测试意图理解的准确率、场景生成的速度);

- 用户测试(邀请目标用户体验,收集反馈);

- 运营优化(根据用户行为数据调整推荐策略,更新场景内容)。

5.2 集成方法论:与现有系统的对接

很多企业已经有了传统的VR虚拟旅游系统,需要将AI能力集成进去。以下是集成的关键步骤:

- 接口标准化:将AI能力封装为RESTful API(如“/api/intent-understanding”“/api/scene-generation”),便于现有系统调用;

- 数据同步:将现有系统的用户数据、场景数据同步到AI系统的数据底座(如用ETL工具将MySQL中的用户数据导入Redis);

- 体验融合:将AI生成的场景嵌入现有VR系统的界面(如在VR头盔的界面中添加“生成新场景”按钮)。

5.3 部署考虑因素:云端 vs 边缘部署

AI驱动虚拟旅游系统的部署方式需要根据** latency(延迟)和成本**权衡:

- 云端部署:适合对延迟要求不高的场景(如网页端虚拟旅游),优点是成本低(按需付费),缺点是延迟高(约50ms);

- 边缘部署:适合对延迟要求高的场景(如VR设备端),优点是延迟低(<10ms),缺点是成本高(需要购买边缘服务器)。

最佳实践:采用云边协同模式——将非实时的AI能力(如用户偏好建模)部署在云端,将实时的AI能力(如场景生成、意图理解)部署在边缘端,兼顾延迟与成本。

6. 高级考量:AI驱动虚拟旅游的未来演化与伦理挑战

6.1 扩展动态:从“单场景”到“跨场景联动”

未来的AI驱动虚拟旅游系统,将从“单一场景的沉浸”升级为“跨场景的联动”——比如用户在“虚拟长安街”喝完茶后,可以直接“穿越”到“虚拟敦煌莫高窟”看壁画,系统会自动生成“从长安到敦煌的丝绸之路”场景,实现**“一站式跨时空旅游”**。

要实现这一点,需要在架构中增加场景联动引擎,负责:

- 场景之间的逻辑关联(如“长安→敦煌”的路线是丝绸之路);

- 场景切换的平滑过渡(如从长安街的街道逐渐过渡到敦煌的沙漠);

- 用户状态的延续(如用户在长安街购买的“胡饼”可以带到敦煌莫高窟)。

6.2 安全影响:虚拟场景中的“数字身份”安全

随着虚拟旅游的普及,用户的“数字身份”(如虚拟形象、虚拟资产)将变得越来越重要。需要防范的安全风险包括:

- 数字身份被盗:攻击者窃取用户的虚拟形象,冒充用户进行恶意行为;

- 虚拟资产诈骗:攻击者在虚拟场景中销售虚假的“虚拟文物”;

- 场景内容篡改:攻击者修改虚拟场景的内容(如将“唐朝长安街”改为“现代商业街”)。

应对策略:

- 用区块链存储用户的数字身份与虚拟资产(如用NFT表示虚拟文物的所有权);

- 用数字签名验证场景内容的真实性(如每个场景都有开发者的数字签名,防止篡改);

- 用访问控制限制用户的操作权限(如普通用户无法修改场景内容)。

6.3 伦理维度:文化原真性与AI创作的平衡

AI生成的虚拟场景可能会歪曲文化元素(如将“苏州园林”的建筑风格改为“欧式”),破坏文化的原真性。需要遵循以下伦理原则:

- 文化顾问介入:在生成场景前,邀请文化专家审核(如生成“唐朝长安街”时,邀请唐史专家检查建筑风格);

- 知识库约束:将文化知识嵌入AI模型的训练数据(如用《中国建筑史》的内容训练生成式模型);

- 用户告知:在虚拟场景中明确标注“AI生成”,并说明“此场景基于历史记载创作,可能与真实情况有差异”。

6.4 未来演化向量:具身AI与虚拟旅游的融合

具身AI(Embodied AI)是指具有物理身体(或虚拟身体)的AI,能够与环境进行物理交互(如用虚拟手拿起茶杯)。未来,具身AI将融入虚拟旅游系统,实现**“更真实的交互体验”**——比如用户可以和虚拟茶馆的老板对话,老板会用虚拟手给用户倒茶,用户可以感受到茶杯的温度(通过VR手套的力反馈)。

要实现这一点,需要在架构中增加具身AI引擎,负责:

- 虚拟身体的控制(如用动作捕捉技术控制虚拟老板的动作);

- 物理交互的模拟(如计算茶杯被拿起时的受力情况);

- 多模态反馈的同步(如视觉上显示茶杯被拿起,触觉上反馈茶杯的温度)。

7. 综合与拓展:AI驱动虚拟旅游的跨领域价值与战略建议

7.1 跨领域应用:从“旅游”到“教育、医疗”的延伸

AI驱动虚拟旅游的技术,不仅可以用于旅游,还可以延伸到其他领域:

- 教育:虚拟历史场景(如“唐朝长安街”)可以用于历史教学,让学生“穿越”到唐朝学习历史;

- 医疗:虚拟自然场景(如“九寨沟”)可以用于心理治疗,帮助焦虑症患者放松;

- 文化遗产保护:虚拟文物(如“敦煌壁画”)可以用于文物保护,避免游客直接接触文物造成损坏。

7.2 研究前沿:AI驱动虚拟旅游的开放问题

尽管AI驱动虚拟旅游发展迅速,但仍有很多开放问题需要解决:

- 如何平衡生成内容的真实性与创造性?(比如生成“唐朝长安街”时,既要符合历史,又要让场景有趣);

- 如何实现“情感化交互”?(比如虚拟老板能感知用户的情绪,调整对话方式);

- 如何降低AI模型的部署成本?(比如让小型旅游企业也能负担得起AI虚拟旅游系统)。

7.3 战略建议:企业如何布局AI驱动虚拟旅游

对于想布局AI驱动虚拟旅游的企业,以下是三条战略建议:

- 构建AI能力中台:将意图理解、场景合成、推荐引擎等AI能力封装为中台,便于不同业务线复用;

- 积累场景数据:数据是AI模型的核心,企业需要积累大量的旅游场景数据(如数字孪生模型、用户行为日志);

- 合作生态伙伴:AI驱动虚拟旅游需要多领域的技术(如VR硬件、生成式AI、数字孪生),企业需要与生态伙伴合作(如与Unreal Engine合作优化渲染引擎,与OpenAI合作优化意图理解)。

结语:AI驱动虚拟旅游的本质是“重新连接人与文化”

AI驱动虚拟旅游的意义,不仅是“用技术提升旅游体验”,更是“重新连接人与文化”——让用户通过虚拟场景,触摸到历史的温度,感受到文化的魅力。作为AI应用架构师,我们的使命是用技术搭建“桥梁”:一边是用户的需求,一边是文化的宝藏;一边是AI的能力,一边是人类的情感。

未来,当AI驱动的虚拟旅游系统普及,每个人都可以“穿越”到任何时代、任何地方,体验不同的文化——这不是“技术的胜利”,而是“人类想象力的胜利”。而我们,正是这个胜利的创造者。

参考资料

- 《Generative AI for Virtual Tourism》——ACM Computing Surveys, 2023;

- 《Instant Neural Graphics Primitives with a Multiresolution Hash Encoding》——SIGGRAPH, 2022;

- 《Large Language Models for Intent Understanding in Travel Applications》——IEEE Transactions on Intelligent Transportation Systems, 2023;

- 《Digital Twin for Cultural Heritage Preservation》——Journal of Cultural Heritage, 2023;

- 《Ethical Considerations in AI-Generated Virtual Scenarios》——AI Ethics Journal, 2023。

更多推荐

已为社区贡献176条内容

已为社区贡献176条内容

所有评论(0)