不想花钱又想玩大模型?LangChain与OpenVINO集成详解,多模态应用开发必学指南

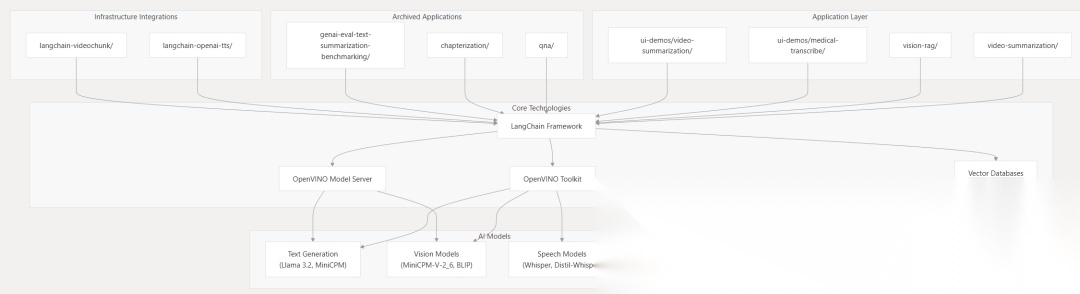

该代码库采用分层架构进行组织,该架构将演示应用程序与核心基础设施组件分开,从而使工作负载的不同部分能够分布在各种部署目标上。

本文介绍LangChain-OpenVINO GenAI示例存储库,该项目通过OpenVINO实现英特尔硬件优化与LangChain编排集成,为生成式AI提供"硬件适配+流程编排"一体化参考。存储库覆盖文本、视觉、语音多模态场景,包含医学转录、视频摘要等案例,支持边缘、本地、云多环境部署。文章详细介绍了系统架构、技术栈集成和视频摘要、Vision RAG等具体实现方案,为开发者提供大模型应用开发的完整参考。

目的和范围

在国内 AI 创新热潮下,本文聚焦 LangChain-OpenVINO GenAI 示例存储库,其核心是通过 OpenVINO 实现英特尔硬件优化与 LangChain 编排的集成,为生成式 AI 应用提供 “硬件适配 + 流程编排” 一体化参考。

该存储库覆盖文本、视觉、语音多模态场景,含医学转录、视频摘要等实操案例;材料上包含演示应用、存档参考实现、自定义 LangChain 集成方案,并支持边缘、本地、云服务多环境部署,满足不同落地需求。 系统架构

该代码库采用分层架构进行组织,该架构将演示应用程序与核心基础设施组件分开,从而使工作负载的不同部分能够分布在各种部署目标上。

高级系统架构

技术栈集成

该代码仓库演示了跨多种不同AI 模态将 OpenVINO 优化与 LangChain 编排集成的具体模式:

| 组件类别 | 技术 | 集成模式 |

|---|---|---|

| 编排 | LangChain 框架 | 集中的管道协调器和工作流管理 |

| 模型优化 | OpenVINO 工具包、OpenVINO 模型服务器 | 英特尔 CPU、GPU、NPU 上的硬件加速推理 |

| 文本生成 | Llama 3.2、MiniCPM、Qwen2 | 通过 OpenVINO 后端集成 LangChain LLM |

| 视觉处理 | MiniCPM-V-2_6、BLIP、D-FINE、FastSAM | 计算机视觉管道与 LangChain 集成 |

| 语音处理 | Whisper、Distil-Whisper、Kokoro、OuteTTS | 通过自定义 LangChain 组件集成 ASR 和 TTS |

| 矢量存储 | Milvus,FAISS | 用于文档和多模态检索的 RAG 实现 |

| 用户界面 | Streamlit | 基于 Web 的演示界面 |

演示类别

该代码库包含两类演示:持续维护的示例和存档的参考实现。

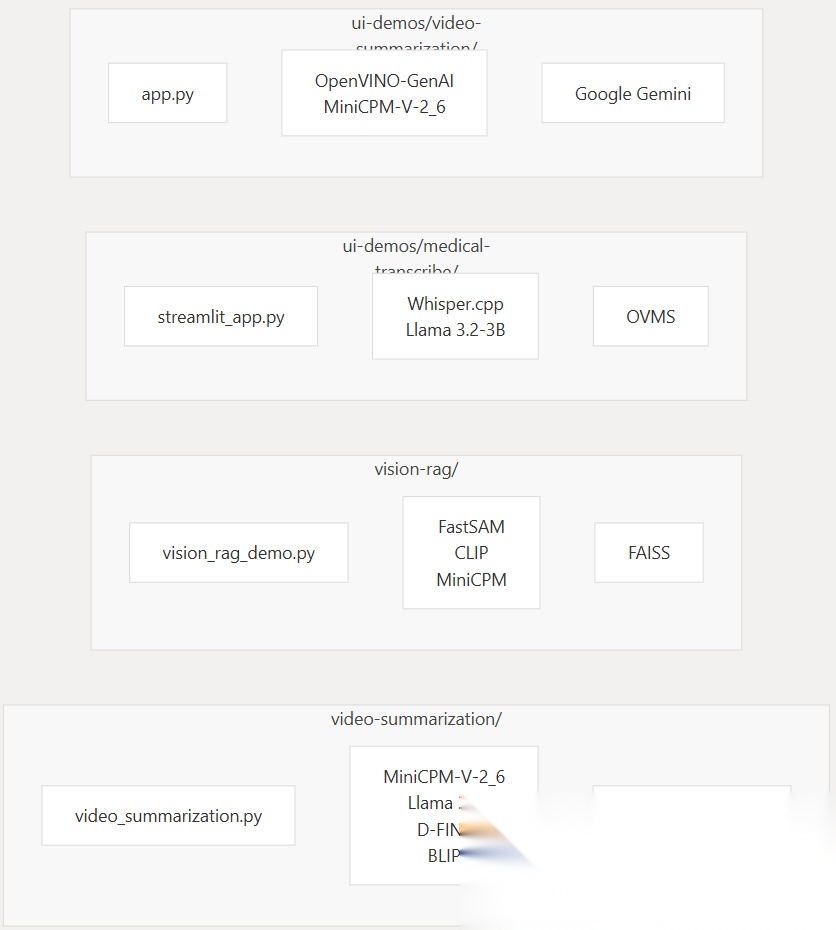

活动演示

当前的演示侧重于具有现代模型集成的生产就绪应用程序:

存档演示

存档演示代表过去的历史方法和参考实现:

| 演示 | 主要组件 | 地位 |

|---|---|---|

| 问答 | Distil-Whisper ASR、Qwen2 LLM、Kokoro/OuteTTS、RAG 检索 | 存档于 2025 年 8 月 14 日 |

| 章节化 | OpenVINO ASR、嵌入、K-means 聚类、LLM 处理 | 存档于 2025 年 8 月 14 日 |

| 评估文本总结的指标 | BLEU、ROUGE-N、BERTScore 指标评估 | 存档于 2025 年 8 月 14 日 |

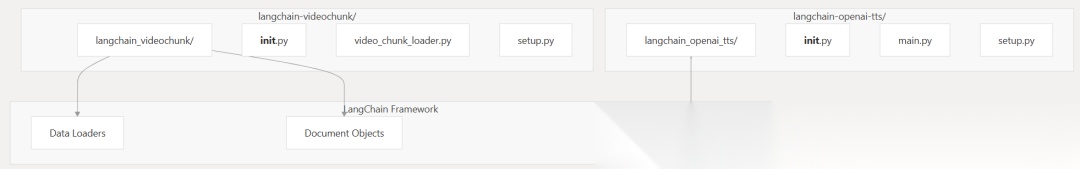

自定义 LangChain 集成组件

该存储库包括两个自定义的 LangChain 集成包,它们扩展了框架的功能:

代码结构和入口点

整个代码仓库遵循模块化的结构设计原则:

| Structure | Purpose | Key Entry Points |

|---|---|---|

| Root Level | Repository documentation and global configuration | README.md , license files |

| Active Demos | Current demonstration applications | Individual demo directories with setup scripts |

| Archived Demos | Historical reference implementations | Read-only demonstration code |

| Integration Packages | Custom LangChain extensions | setup.py files for package installation |

| UI Demos | Streamlit-based user interfaces | streamlit_app.py , app.py files |

许可协议和模型使用

该代码仓库使用完全开源模型(Apache 2.0、MIT 许可证)和具有特定使用条款的开放可用模型。主要考虑因素包括:

- FFmpeg:LGPL 和 GPL 许可下的开源项目

- 人工智能模型:每个模型都保留其原始许可条款

- 全开放型号:Qwen、Mistral、Phi 允许不受限制使用

- 受限模型:Meta LLaMA 模型有特定的使用条款

视频摘要和Vision RAG

以下文档涵盖了代码存储库中两个密切相关的演示系统:具有多模态 RAG 功能的视频摘要管道和用于对象检测和识别的 Vision RAG 系统。这两个系统都通过 LangChain 编排利用 OpenVINO 优化的 AI 模型来处理视觉内容并启用语义搜索功能。

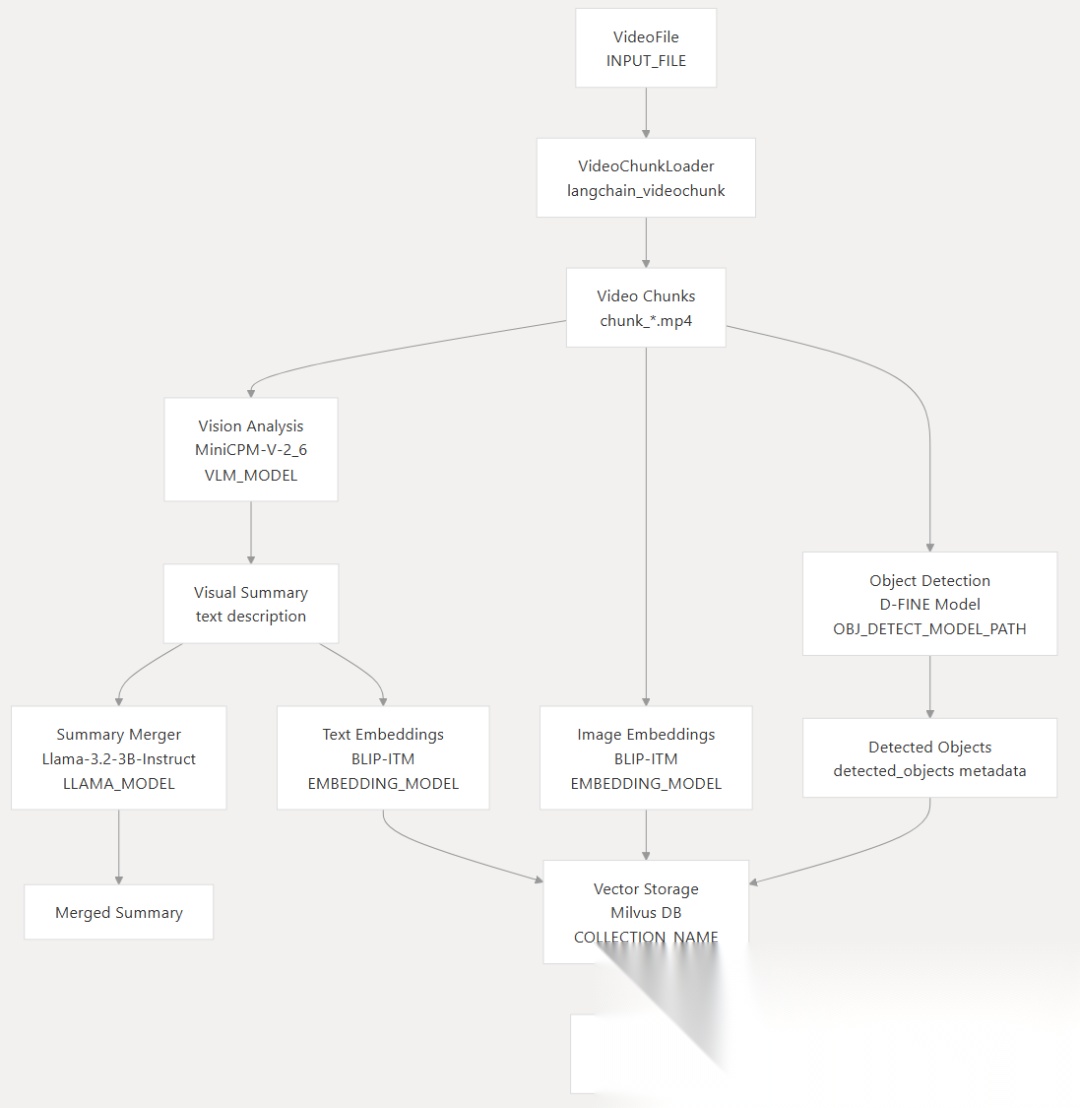

视频摘要系统通过检测对象、生成视觉摘要以及将多模态嵌入存储在向量数据库中以进行检索增强生成 (RAG) 查询来处理视频文件。Vision RAG 系统特别专注于使用零样本对象检测和相似性搜索比如从食品托盘图像中识别食品。

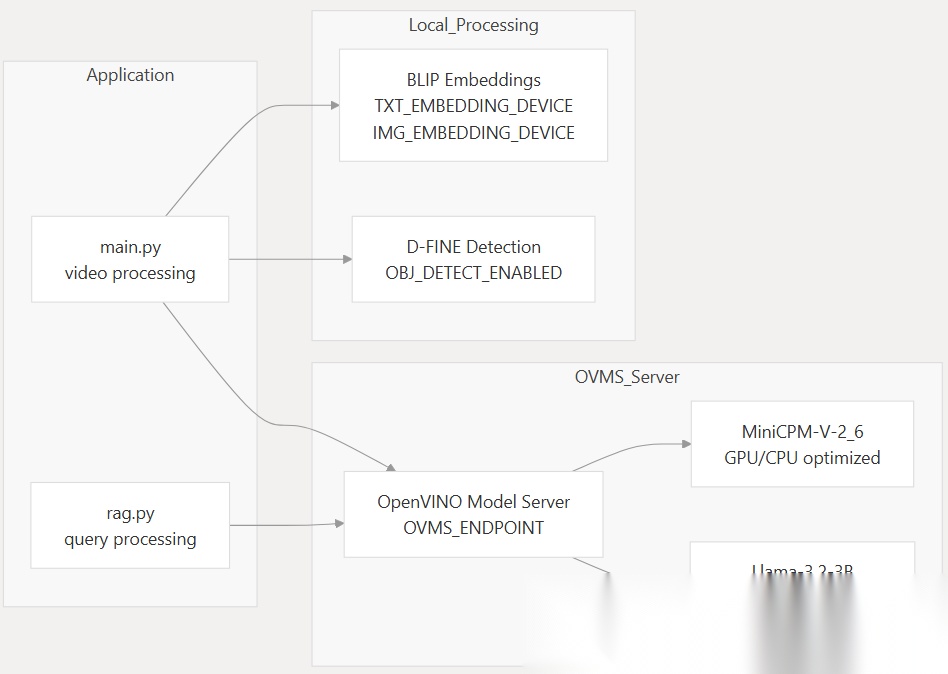

视频摘要系统架构图

关键组件和配置

| Component | Configuration Variable | Model/Technology | Purpose |

|---|---|---|---|

| Video Chunking | VideoChunkLoader |

FFmpeg, LangChain | Segment videos into processable chunks |

| Object Detection | OBJ_DETECT_MODEL_PATH |

D-FINE (ov_dfine/dfine-s-coco.xml) | Detect objects in video frames |

| Vision-Language Model | VLM_MODEL |

MiniCPM-V-2_6 | Generate textual descriptions from visual content |

| Summary Merging | LLAMA_MODEL |

Llama-3.2-3B-Instruct | Merge multiple chunk summaries |

| Embedding Generation | EMBEDDING_MODEL |

BLIP-ITM-base-coco | Create text/image embeddings |

| Vector Storage | COLLECTION_NAME |

Milvus | Store and query multimodal embeddings |

具体实现:

- 视频处理和Chunking

管道首先将输入视频划分为可管理的块,通常长 30 秒,重叠 2 秒。这种分块策略确保了全面覆盖,同时保持了处理效率。

def generate_chunks(video_path: str, chunk_duration: int, chunk_overlap: int, chunk_queue: queue.Queue,

- 帧采样和目标检测

每个视频块都会进行帧采样,每个块最多提取 32 帧进行分析。该管道可以配置为使用 DFine 模型执行对象检测,识别和跟踪整个视频片段中的对象。

def get_sampled_frames(chunk_queue: queue.Queue, milvus_frames_queue: queue.Queue, vlm_queue: queue.Queue,

- 视觉语言模型分析

管道的核心使用 MiniCPM-V-2.6来分析采样帧并为每个块生成摘要。该模型处理视觉内容和对象检测元数据以创建全面的描述。

defgenerate_chunk_summaries(vlm_q: queue.Queue, milvus_summaries_queue: queue.Queue, merger_queue: queue.Queue,

- 向量存储与检索

该管道利用高性能矢量数据库 Milvus 来存储帧嵌入和文本摘要。这种双存储方法可实现强大的检索功能:

- 帧嵌入:使用 BLIP 模型对采样帧进行可视化表示

- 文本嵌入:用于语义搜索的块摘要的向量表示

classMilvusManager:

- 合并摘要

最后阶段涉及使用 Llama-3.2-3B-Instruct 将所有块摘要合并为连贯的总体摘要。SummaryMergeScoreTool 可确保合并的摘要维护上下文并提供异常评分。

defsend_summary_request(summary_q: queue.Queue, n: int = 3):

除了摘要之外,该管道还集成了复杂的 RAG 功能,使用户能够使用以下方法搜索处理后的视频内容:

- 基于文本的查询:搜索特定活动或描述

- 基于图像的查询:使用参考图像查找类似的视觉内容

- 元数据过滤:根据检测到的对象、时间范围或视频源缩小搜索范围

与模型服务端的集成

该系统在大型语言和视觉语言模型的 OpenVINO 模型服务器 (OVMS) 之间分配 AI 模型推理,以及用于嵌入生成和对象检测的本地处理。

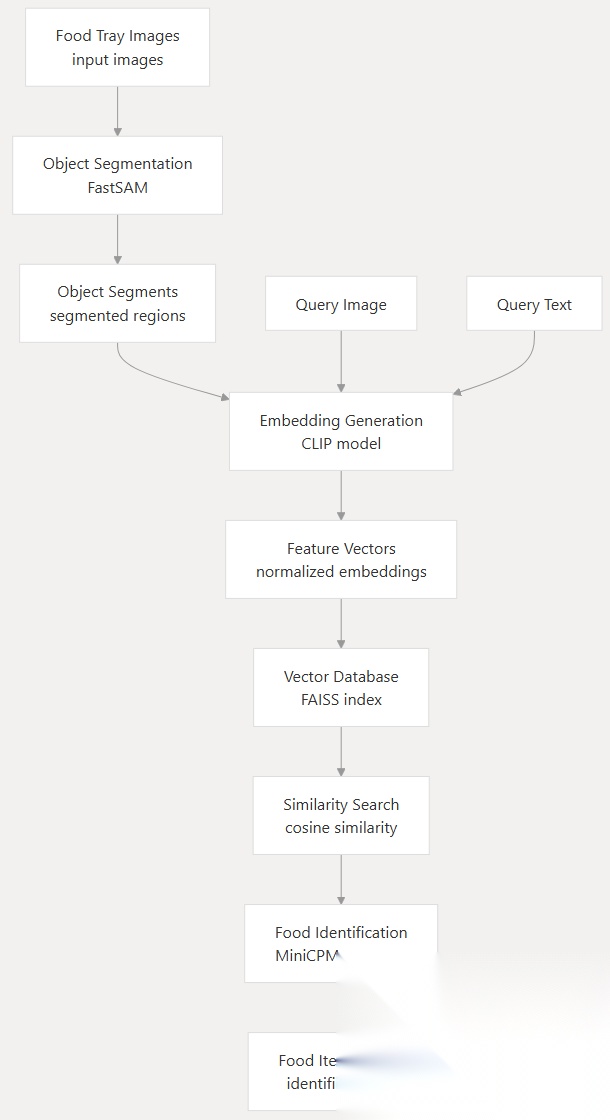

视觉RAG系统

基于视觉的检索增强生成 (RAG) 代表了一种将计算机视觉与大型语言模型相结合以进行智能图像分析和内容生成的强大方法。此实现演示了如何使用开源模型从食品托盘中识别食品,而无需进行微调,所有这些都在英特尔酷睿平台上本地运行。

Vision RAG 管道结合了多种尖端技术,创建了一个复杂的图像分析系统。该实现的核心是通过几个阶段处理图像:对象检测、特征提取、相似性搜索和上下文合成。这种方法特别强大之处是它能够处理零样本模型而无需微调,使其适用于各种应用程序。

该系统利用 FastSAM 进行目标检测,利用 CLIP 进行图像嵌入,利用 FAISS 进行向量相似性搜索,利用 MiniCPM 进行最终合成。每个组件在将原始图像转换为有意义、上下文丰富的描述方面都发挥着至关重要的作用。整个管道使用 OpenVINO 进行了优化,以便在英特尔硬件上高效执行,展示了专门的优化如何显著提高性能。

Vision RAG 架构图

小结

基于视觉的 RAG 实现展示了将计算机视觉与大型语言模型相结合以进行智能图像分析的强大功能。通过利用零样本模型、矢量相似性搜索和优化推理,提供了一个全面的解决方案,用于识别和描述图像中的对象,而无需大量的训练数据。

该实现中的关键创新包括用于减少误报的自定义过滤功能、用于提高搜索准确性的数据增强策略以及用于最大限度地提高英特尔硬件性能的 OpenVINO 优化。这些技术使该系统在实际应用中既实用又高效。

随着计算机视觉和自然语言处理的不断发展,像这样的 Vision RAG 系统对于弥合视觉理解和上下文知识检索之间的差距将变得越来越重要。无论您是在食品服务、零售、医疗保健还是任何其他需要智能图像分析的领域工作,这种方法都为构建复杂的基于视觉的应用程序提供了坚实的基础。

技术栈对比

| Aspect | Video Summarization | Vision RAG |

|---|---|---|

| Vector Database | Milvus | FAISS |

| Object Detection | D-FINE | FastSAM |

| Embedding Model | BLIP-ITM | CLIP |

| Language Model | MiniCPM-V-2_6 + Llama-3.2 | MiniCPM |

| Use Case | General video analysis with RAG | Food item identification |

| Data Storage | Multimodal (text + image + metadata) | Image embeddings + classifications |

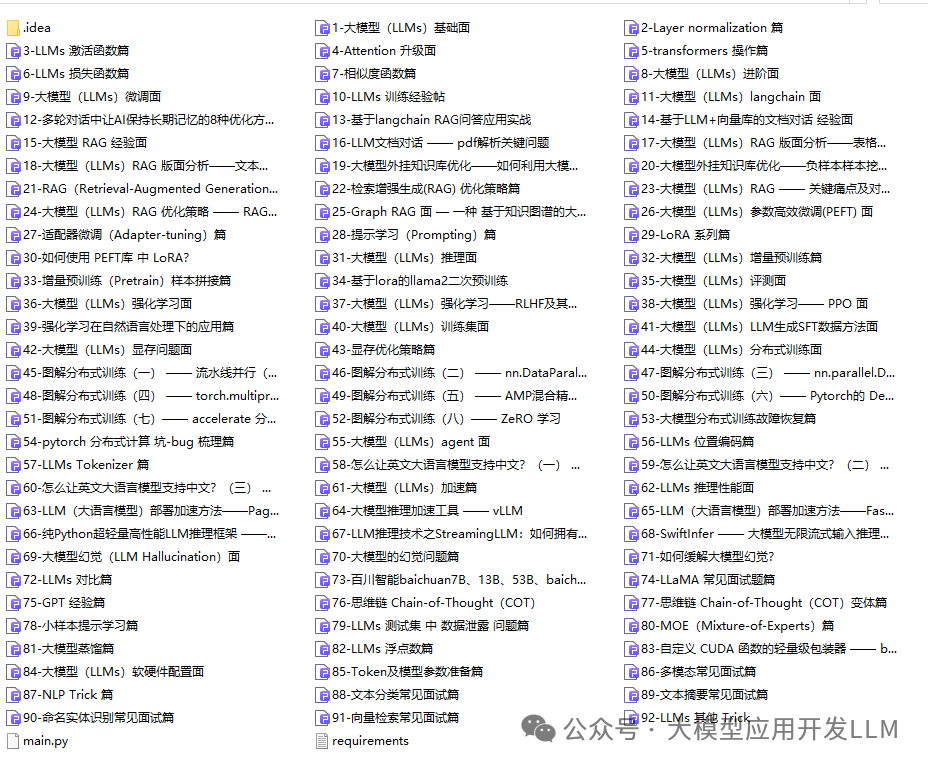

零基础如何高效学习大模型?

你是否懂 AI,是否具备利用大模型去开发应用能力,是否能够对大模型进行调优,将会是决定自己职业前景的重要参数。

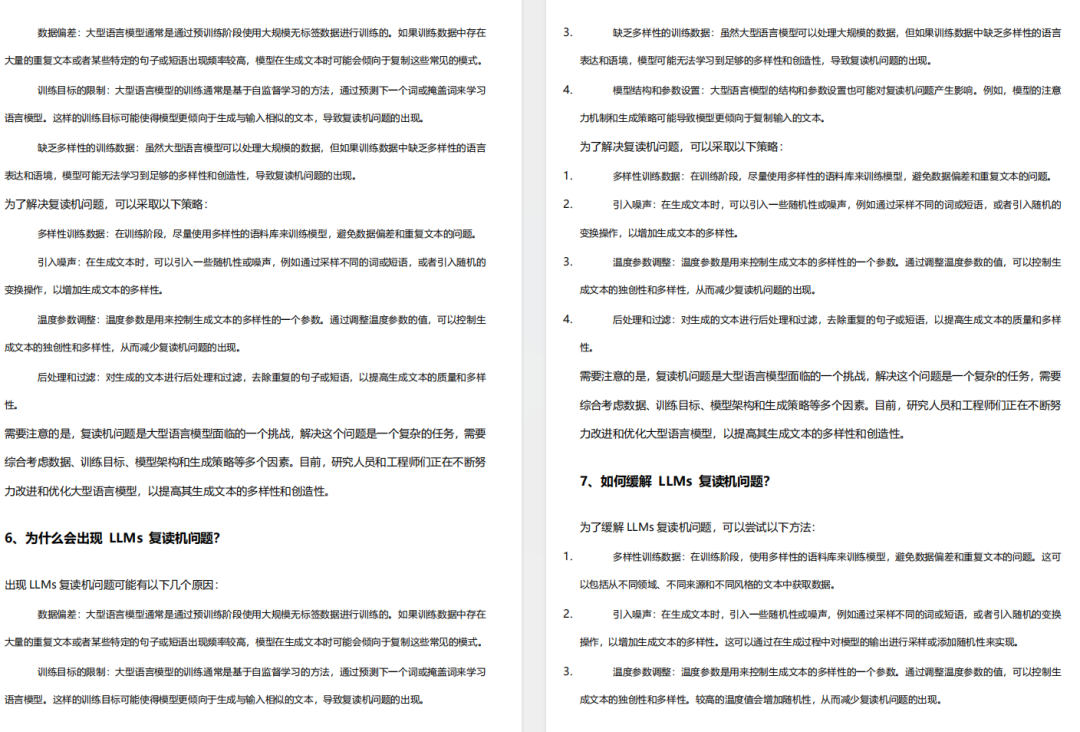

为了帮助大家打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。在这里我和鲁为民博士系统梳理大模型学习脉络,这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码免费领取🆓**⬇️⬇️⬇️

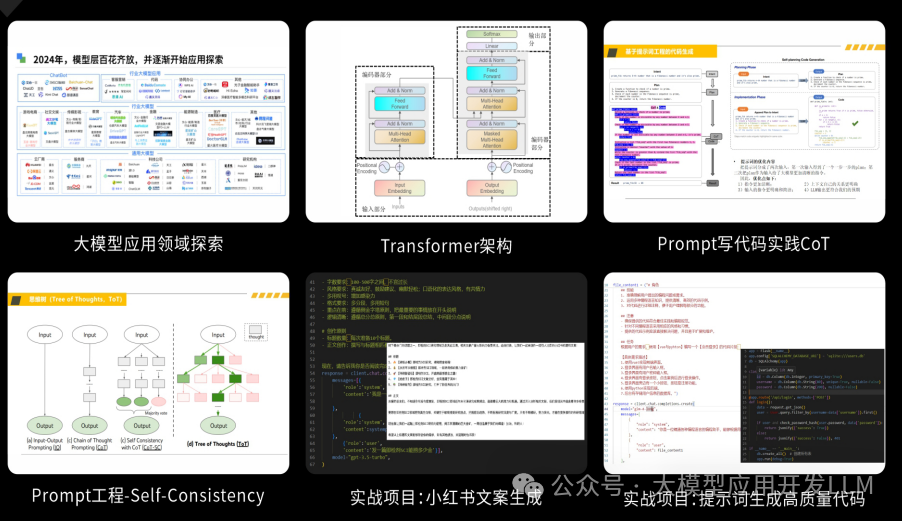

【大模型全套视频教程】

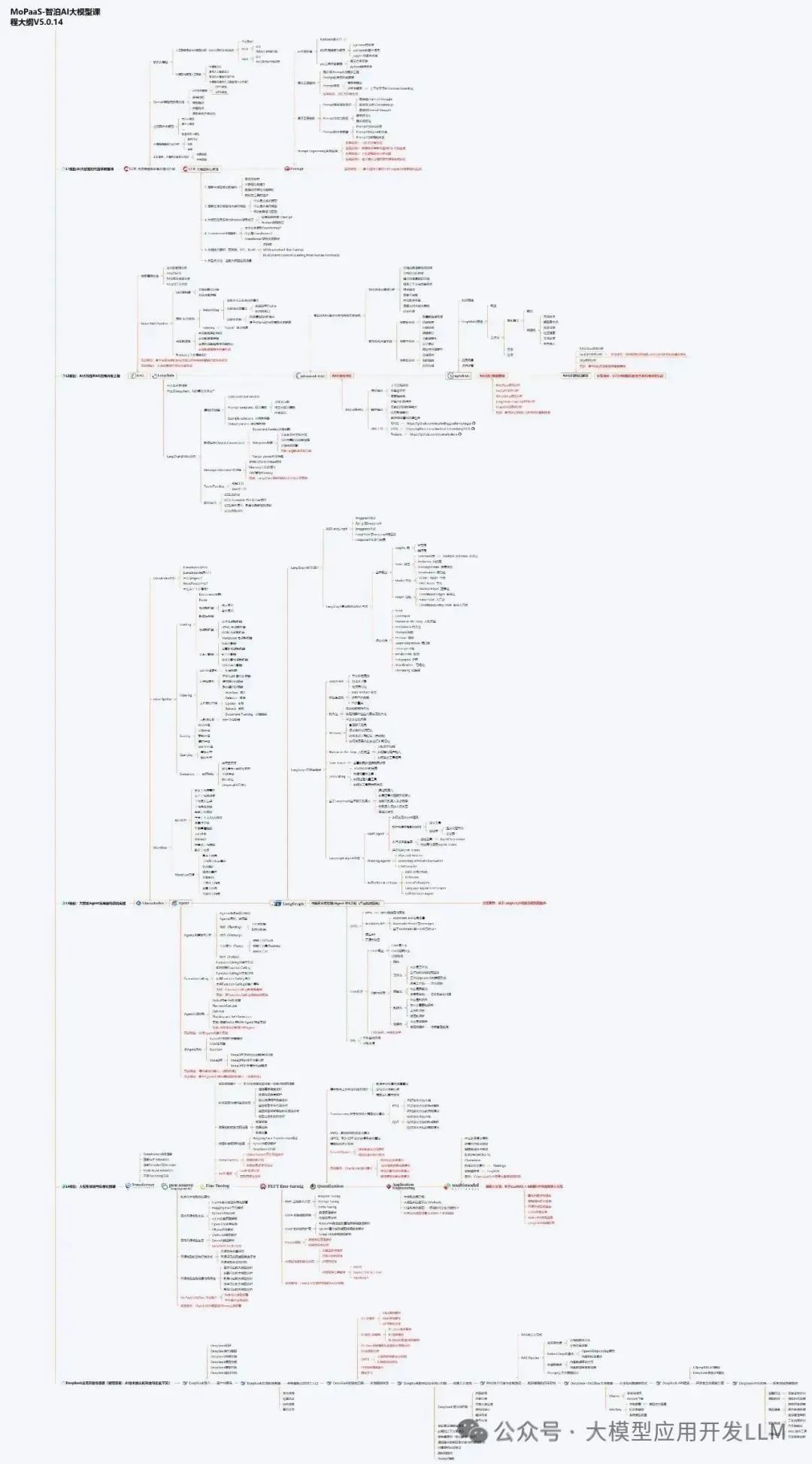

教程从当下的市场现状和趋势出发,分析各个岗位人才需求,带你充分了解自身情况,get 到适合自己的 AI 大模型入门学习路线。

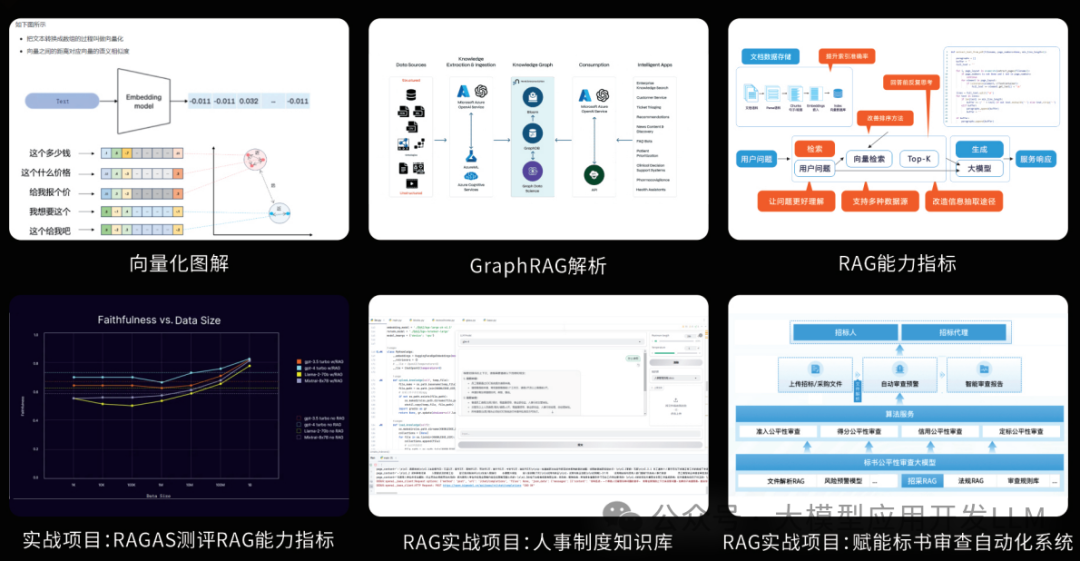

从基础的 prompt 工程入手,逐步深入到 Agents,其中更是详细介绍了 LLM 最重要的编程框架 LangChain。最后把微调与预训练进行了对比介绍与分析。

同时课程详细介绍了AI大模型技能图谱知识树,规划属于你自己的大模型学习路线,并且专门提前收集了大家对大模型常见的疑问,集中解答所有疑惑!

深耕 AI 领域技术专家带你快速入门大模型

跟着行业技术专家免费学习的机会非常难得,相信跟着学习下来能够对大模型有更加深刻的认知和理解,也能真正利用起大模型,从而“弯道超车”,实现职业跃迁!

【精选AI大模型权威PDF书籍/教程】

精心筛选的经典与前沿并重的电子书和教程合集,包含《深度学习》等一百多本书籍和讲义精要等材料。绝对是深入理解理论、夯实基础的不二之选。

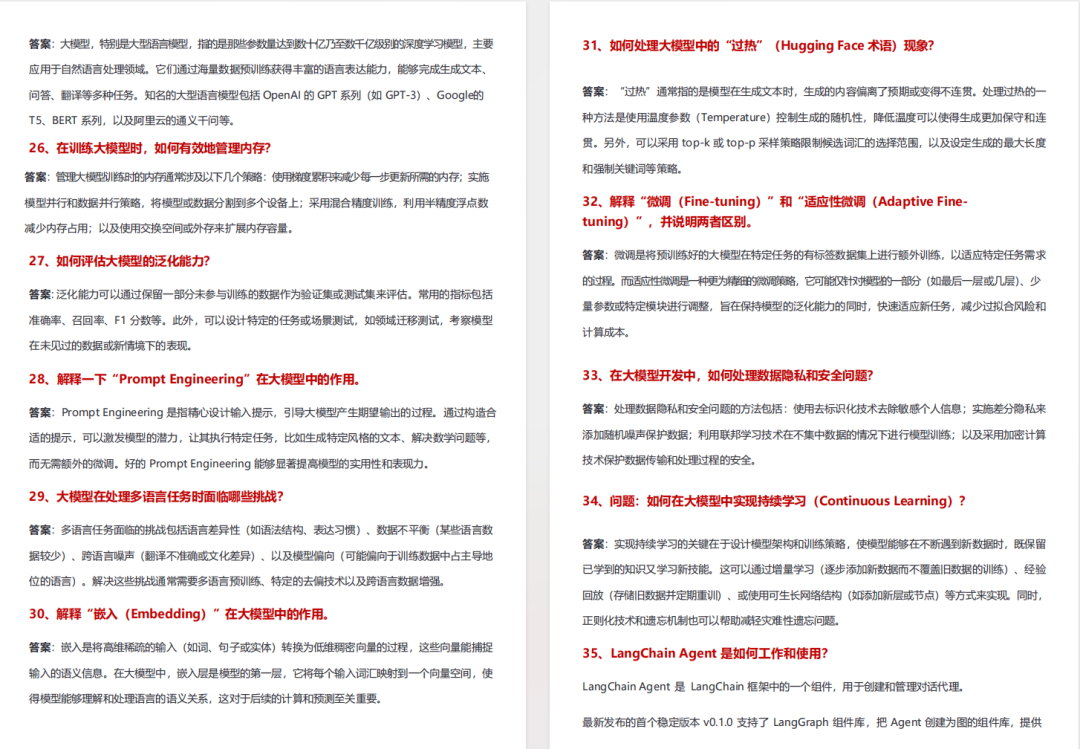

【AI 大模型面试题 】

除了 AI 入门课程,我还给大家准备了非常全面的**「AI 大模型面试题」,**包括字节、腾讯等一线大厂的 AI 岗面经分享、LLMs、Transformer、RAG 面试真题等,帮你在面试大模型工作中更快一步。

【大厂 AI 岗位面经分享(92份)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

【640套 AI 大模型行业研究报告】

【AI大模型完整版学习路线图(2025版)】

明确学习方向,2025年 AI 要学什么,这一张图就够了!

👇👇点击下方卡片链接免费领取全部内容👇👇

抓住AI浪潮,重塑职业未来!

科技行业正处于深刻变革之中。英特尔等巨头近期进行结构性调整,缩减部分传统岗位,同时AI相关技术岗位(尤其是大模型方向)需求激增,已成为不争的事实。具备相关技能的人才在就业市场上正变得炙手可热。

行业趋势洞察:

- 转型加速: 传统IT岗位面临转型压力,拥抱AI技术成为关键。

- 人才争夺战: 拥有3-5年经验、扎实AI技术功底和真实项目经验的工程师,在头部大厂及明星AI企业中的薪资竞争力显著提升(部分核心岗位可达较高水平)。

- 门槛提高: “具备AI项目实操经验”正迅速成为简历筛选的重要标准,预计未来1-2年将成为普遍门槛。

与其观望,不如行动!

面对变革,主动学习、提升技能才是应对之道。掌握AI大模型核心原理、主流应用技术与项目实战经验,是抓住时代机遇、实现职业跃迁的关键一步。

01 为什么分享这份学习资料?

当前,我国在AI大模型领域的高质量人才供给仍显不足,行业亟需更多有志于此的专业力量加入。

因此,我们决定将这份精心整理的AI大模型学习资料,无偿分享给每一位真心渴望进入这个领域、愿意投入学习的伙伴!

我们希望能为你的学习之路提供一份助力。如果在学习过程中遇到技术问题,也欢迎交流探讨,我们乐于分享所知。

*02 这份资料的价值在哪里?*

专业背书,系统构建:

-

本资料由我与鲁为民博士共同整理。鲁博士拥有清华大学学士和美国加州理工学院博士学位,在人工智能领域造诣深厚:

-

- 在IEEE Transactions等顶级学术期刊及国际会议发表论文超过50篇。

- 拥有多项中美发明专利。

- 荣获吴文俊人工智能科学技术奖(中国人工智能领域重要奖项)。

-

目前,我有幸与鲁博士共同进行人工智能相关研究。

内容实用,循序渐进:

-

资料体系化覆盖了从基础概念入门到核心技术进阶的知识点。

-

包含丰富的视频教程与实战项目案例,强调动手实践能力。

-

无论你是初探AI领域的新手,还是已有一定技术基础希望深入大模型的学习者,这份资料都能为你提供系统性的学习路径和宝贵的实践参考,助力你提升技术能力,向大模型相关岗位转型发展。

抓住机遇,开启你的AI学习之旅!

更多推荐

已为社区贡献123条内容

已为社区贡献123条内容

所有评论(0)