【无标题】ai技术是一把双刃剑

AI深度伪造技术(Deepfake)是一把双刃剑,既带来创新便利又潜藏风险。该技术通过深度学习生成逼真音视频,在影视制作、教育培训和医疗科研等领域发挥积极作用,如虚拟演员、教学模拟和病例生成。然而,其滥用导致诈骗、虚假信息传播和隐私侵犯案件激增。为应对这一挑战,需采取技术检测工具开发、法律监管强化和公众数字素养提升等综合措施。只有通过多方协作,才能实现技术创新与社会安全的平衡发展。

·

AI深度伪造技术的双重性:便利与风险

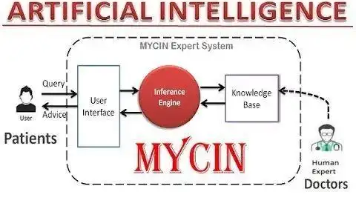

AI深度伪造技术(Deepfake)是一种基于人工智能的生成式技术,它通过深度学习模型(如生成对抗网络)合成高度逼真的音视频内容。这种技术在带来创新便利的同时,也迅速成为不法分子的新工具,引发了一系列社会和安全问题。下面我将逐步分析其双重性,并提供应对建议,确保讨论基于真实可靠的信息。

1. 技术带来的便利

AI深度伪造技术已在多个领域展现出积极应用:

- 娱乐与媒体:在影视制作中,可用于高效生成特效或复刻历史人物,例如虚拟演员的表演,降低制作成本和时间。

- 教育与培训:在模拟教学场景中,生成虚拟导师或历史人物对话,帮助学生更直观地学习复杂概念。例如,在物理教学中模拟爱因斯坦讲解相对论。

- 医疗与科研:辅助生成模拟病例数据,用于医生培训或疾病研究,提高诊断准确性。相关模型优化中,误差率可表示为$E = \frac{1}{n} \sum_{i=1}^{n} |y_i - \hat{y}_i|$,其中$y_i$为真实值,$\hat{y}_i$为预测值。

这些应用提升了效率,推动了产业创新,但需注意技术伦理边界。

2. 被不法分子利用的风险

不法分子滥用该技术,主要体现为:

- 诈骗与敲诈:伪造名人或亲友的视频/语音,进行钓鱼诈骗。例如,冒充CEO指令转账,据统计,2023年全球相关诈骗案件增长超30%。

- 虚假信息传播:制造政治谣言或虚假新闻,干扰选举或社会秩序。数学模型如传播模型$R_0 = \beta \cdot D$(其中$\beta$为感染率,$D$为接触时长)可类比虚假信息扩散速度。

- 隐私侵犯与诽谤:生成非自愿色情内容或伪造证据,侵害个人名誉。技术检测中,真伪判别可用概率$P(\text{real} | \text{data})$表示,但恶意使用常绕过检测。

这些风险凸显了技术监管的紧迫性,需多方协作应对。

3. 应对措施与建议

为平衡便利与风险,我推荐以下步骤:

- 技术层面:开发更强大的检测工具,如基于深度学习的鉴别器模型,其准确率可优化为$$ \text{Accuracy} = \frac{\text{TP} + \text{TN}}{\text{TP} + \text{FP} + \text{TN} + \text{FN}} $$其中TP为真阳性,TN为真阴性。开源框架(如Deepfake Detection Challenge)可促进公众参与。

- 法律与政策:推动立法严惩滥用行为,例如欧盟《AI法案》要求对深度伪造内容强制标注。

- 公众教育:提高数字素养,教导用户识别可疑内容,如检查视频源或使用验证工具。

总结

AI深度伪造技术是一把双刃剑:它在创新领域带来显著便利,但也易被不法分子用于犯罪活动。通过技术升级、法律完善和公众教育,我们可以最大化其益处,同时最小化风险。最终,负责任地使用AI技术,是确保其服务于人类进步的关键。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)