Spring AI与RAG技术实战:构建企业级智能文档问答系统

Spring AI是Spring生态系统中的AI集成框架,提供了统一的API来访问各种AI模型和服务。它简化了AI功能的集成过程,支持OpenAI、Azure OpenAI、Amazon Bedrock等多种后端服务。Spring AI与RAG技术的结合为企业构建智能文档问答系统提供了强大的技术基础。通过合理的架构设计、性能优化和错误处理,可以构建出稳定、高效的智能问答系统。随着AI技术的不断发展

Spring AI与RAG技术实战:构建企业级智能文档问答系统

引言

随着人工智能技术的快速发展,企业对于智能化文档处理的需求日益增长。传统的文档管理系统往往只能提供简单的关键词搜索,无法理解用户的自然语言查询意图。Spring AI结合RAG(检索增强生成)技术,为企业构建智能文档问答系统提供了全新的解决方案。

技术栈概述

Spring AI框架

Spring AI是Spring生态系统中的AI集成框架,提供了统一的API来访问各种AI模型和服务。它简化了AI功能的集成过程,支持OpenAI、Azure OpenAI、Amazon Bedrock等多种后端服务。

RAG技术原理

RAG(Retrieval-Augmented Generation)是一种结合信息检索和文本生成的技术。它首先从知识库中检索相关信息,然后将检索到的内容作为上下文提供给生成模型,从而产生更准确、更有依据的回答。

向量数据库

向量数据库是RAG架构中的核心组件,用于存储和检索文档的向量表示。常用的向量数据库包括:

- Milvus:开源的向量数据库,支持高性能相似性搜索

- Chroma:轻量级向量数据库,易于集成

- Redis:通过RedisSearch模块支持向量搜索

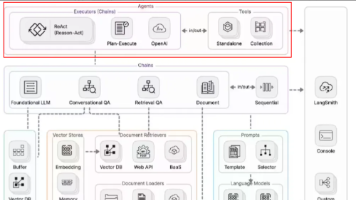

系统架构设计

整体架构

用户界面 → API网关 → Spring Boot应用 → RAG服务 → 向量数据库

↓

AI模型服务

核心组件

- 文档处理模块:负责文档的解析、分块和向量化

- 向量存储模块:使用向量数据库存储文档嵌入

- 检索模块:实现语义搜索和相似性匹配

- 生成模块:调用AI模型生成回答

- 缓存层:使用Redis缓存频繁查询的结果

实现步骤

1. 环境准备

首先添加Spring AI依赖:

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-openai-spring-boot-starter</artifactId>

<version>0.8.1</version>

</dependency>

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-transformers-spring-boot-starter</artifactId>

<version>0.8.1</version>

</dependency>

2. 文档处理与向量化

@Service

public class DocumentProcessor {

@Autowired

private EmbeddingClient embeddingClient;

public List<DocumentChunk> processDocument(String content) {

// 文档分块

List<String> chunks = splitDocument(content);

// 生成向量嵌入

List<Embedding> embeddings = embeddingClient.embed(chunks);

return createDocumentChunks(chunks, embeddings);

}

private List<String> splitDocument(String content) {

// 实现文档分块逻辑

return TextSplitter.splitByTokenCount(content, 512);

}

}

3. 向量存储实现

@Repository

public class VectorStoreService {

@Autowired

private RedisConnectionFactory connectionFactory;

public void storeVectors(List<DocumentChunk> chunks) {

try (RedisConnection connection = connectionFactory.getConnection()) {

for (DocumentChunk chunk : chunks) {

String key = "doc:" + chunk.getId();

byte[] vectorBytes = convertToBytes(chunk.getEmbedding());

connection.hSet(key.getBytes(), "vector".getBytes(), vectorBytes);

connection.hSet(key.getBytes(), "content".getBytes(), chunk.getContent().getBytes());

}

}

}

public List<DocumentChunk> searchSimilarVectors(float[] queryVector, int topK) {

// 实现向量相似性搜索

return performVectorSearch(queryVector, topK);

}

}

4. RAG服务实现

@Service

public class RagService {

@Autowired

private ChatClient chatClient;

@Autowired

private VectorStoreService vectorStore;

@Autowired

private EmbeddingClient embeddingClient;

public String answerQuestion(String question) {

// 生成问题向量

Embedding questionEmbedding = embeddingClient.embed(question);

// 检索相关文档

List<DocumentChunk> relevantChunks = vectorStore.searchSimilarVectors(

questionEmbedding.getEmbedding(), 5

);

// 构建提示词

String context = buildContext(relevantChunks);

String prompt = buildPrompt(question, context);

// 生成回答

return chatClient.generate(prompt);

}

private String buildContext(List<DocumentChunk> chunks) {

return chunks.stream()

.map(DocumentChunk::getContent)

.collect(Collectors.joining("\n\n"));

}

private String buildPrompt(String question, String context) {

return String.format("""

基于以下上下文信息,请回答用户的问题。

如果上下文信息不足以回答问题,请如实告知。

上下文:

%s

问题:%s

回答:

""", context, question);

}

}

5. REST API接口

@RestController

@RequestMapping("/api/rag")

public class RagController {

@Autowired

private RagService ragService;

@PostMapping("/ask")

public ResponseEntity<ApiResponse> askQuestion(@RequestBody QuestionRequest request) {

try {

String answer = ragService.answerQuestion(request.getQuestion());

return ResponseEntity.ok(ApiResponse.success(answer));

} catch (Exception e) {

return ResponseEntity.status(HttpStatus.INTERNAL_SERVER_ERROR)

.body(ApiResponse.error("处理问题时发生错误"));

}

}

@PostMapping("/documents")

public ResponseEntity<ApiResponse> processDocument(@RequestBody DocumentRequest request) {

// 文档处理逻辑

return ResponseEntity.ok(ApiResponse.success("文档处理成功"));

}

}

性能优化策略

1. 缓存优化

@Configuration

@EnableCaching

public class CacheConfig {

@Bean

public CacheManager cacheManager(RedisConnectionFactory connectionFactory) {

RedisCacheConfiguration config = RedisCacheConfiguration.defaultCacheConfig()

.entryTtl(Duration.ofHours(1))

.disableCachingNullValues();

return RedisCacheManager.builder(connectionFactory)

.cacheDefaults(config)

.build();

}

}

@Service

public class RagService {

@Cacheable(value = "answers", key = "#question")

public String answerQuestion(String question) {

// 原有的回答逻辑

}

}

2. 异步处理

@Async

public CompletableFuture<String> processDocumentAsync(String content) {

return CompletableFuture.supplyAsync(() -> {

// 文档处理逻辑

return "处理完成";

});

}

3. 批量操作优化

public void batchStoreVectors(List<DocumentChunk> chunks) {

// 使用管道批量操作

try (RedisConnection connection = connectionFactory.getConnection()) {

connection.openPipeline();

for (DocumentChunk chunk : chunks) {

// 批量设置操作

}

connection.closePipeline();

}

}

错误处理与监控

1. 全局异常处理

@ControllerAdvice

public class GlobalExceptionHandler {

@ExceptionHandler(AIException.class)

public ResponseEntity<ApiResponse> handleAIException(AIException ex) {

return ResponseEntity.status(HttpStatus.SERVICE_UNAVAILABLE)

.body(ApiResponse.error("AI服务暂时不可用"));

}

@ExceptionHandler(Exception.class)

public ResponseEntity<ApiResponse> handleGeneralException(Exception ex) {

log.error("系统错误", ex);

return ResponseEntity.status(HttpStatus.INTERNAL_SERVER_ERROR)

.body(ApiResponse.error("系统内部错误"));

}

}

2. 监控指标

@Component

public class RagMetrics {

private final MeterRegistry meterRegistry;

public RagMetrics(MeterRegistry meterRegistry) {

this.meterRegistry = meterRegistry;

}

public void recordQueryTime(long milliseconds) {

meterRegistry.timer("rag.query.time").record(milliseconds, TimeUnit.MILLISECONDS);

}

public void incrementQueryCount() {

meterRegistry.counter("rag.query.count").increment();

}

}

部署与运维

Docker容器化

FROM openjdk:17-jdk-slim

WORKDIR /app

COPY target/rag-system.jar app.jar

EXPOSE 8080

ENTRYPOINT ["java", "-jar", "app.jar"]

Kubernetes部署

apiVersion: apps/v1

kind: Deployment

metadata:

name: rag-system

spec:

replicas: 3

selector:

matchLabels:

app: rag-system

template:

metadata:

labels:

app: rag-system

spec:

containers:

- name: rag-app

image: rag-system:latest

ports:

- containerPort: 8080

resources:

requests:

memory: "1Gi"

cpu: "500m"

limits:

memory: "2Gi"

cpu: "1000m"

实际应用场景

1. 企业知识库问答

为企业内部文档、规章制度、操作手册等提供智能问答服务,提高员工工作效率。

2. 客户服务系统

集成到客服系统中,为客户提供基于产品文档的准确回答,减少人工客服压力。

3. 教育培训平台

为在线教育平台提供课程内容问答功能,增强学习体验。

4. 技术支持文档

为技术产品提供智能文档支持,用户可以通过自然语言查询技术问题。

挑战与解决方案

1. AI幻觉问题

问题:AI模型可能生成看似合理但实际错误的信息。 解决方案:

- 设置置信度阈值

- 提供原文引用

- 实现事实核查机制

2. 性能瓶颈

问题:向量搜索和AI生成可能成为性能瓶颈。 解决方案:

- 使用高效的向量索引

- 实现结果缓存

- 采用异步处理

3. 数据安全

问题:企业文档可能包含敏感信息。 解决方案:

- 实现数据加密

- 设置访问权限控制

- 进行安全审计

未来发展方向

- 多模态支持:支持图片、表格等非文本内容的处理

- 实时学习:系统能够从用户反馈中持续学习改进

- 个性化推荐:根据用户历史和行为提供个性化回答

- 多语言支持:扩展支持更多语言的文档处理

- 边缘计算:在边缘设备上部署轻量级模型

总结

Spring AI与RAG技术的结合为企业构建智能文档问答系统提供了强大的技术基础。通过合理的架构设计、性能优化和错误处理,可以构建出稳定、高效的智能问答系统。随着AI技术的不断发展,这类系统将在企业数字化转型中发挥越来越重要的作用。

在实际实施过程中,需要根据具体业务需求进行定制化开发,同时注重系统的可扩展性、安全性和用户体验。通过持续优化和改进,智能文档问答系统将成为企业知识管理的重要工具。

更多推荐

已为社区贡献87条内容

已为社区贡献87条内容

所有评论(0)