【大模型】谷歌最新推出的开源工具LangExtract——基于LLM的信息提取,LangExtract使用教程!

精准提取目标结构化信息;将提取结果与原始文本关联,确保可追溯;支持批量处理大量文档;生成可视化界面,方便审查核对;可在你选择的任意模型上运行;通过几个示例就能学习你的提取模式;无需从零开始搭建完整的信息提取管道。

在无结构文本里进行信息挖掘,过程往往令人头疼。无论是想从满是医学专业术语的 PDF 里提取药物名称,还是要给一份 10 页的法律文件做总结 —— 而且文件中同一条款还用被动语态重复表述了五次 —— 只要有过这类经历的人,都能明白这种困扰。

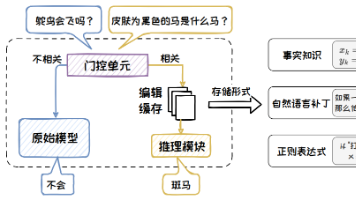

过去这些年,应对这类问题的办法要么是编写复杂难维护的正则表达式(堪称 “正则恐怖秀”),要么是依赖复杂的大语言模型(LLM)提示词,可后者还常常会编造不实信息。不过现在,情况有了转机:谷歌最新推出的开源工具LangExtract,或许能让开发人员和数据团队彻底摆脱这种困境,重新找回高效工作的状态。

这款工具不只是简单的 “用 AI 提取信息”,它会把每一条提取出的内容都与原始文本关联起来。这意味着它能精准显示信息的来源,甚至精确到字符偏移量的位置。比如你想知道 “罗密欧再次对朱丽叶着迷” 这句话在《罗密欧与朱丽叶》第二幕的具体位置,LangExtract 就能以可视化、可交互的方式告诉你答案。

1、LangExtract 的特别之处

从本质上来说,LangExtract 是一个 Python 库,由 Gemini(你也可以根据偏好选择其他 LLM)提供技术支持,核心功能是从文本中提取结构化信息。无论是临床病历、法律文书、财务报告,还是 Reddit 上用户的抱怨内容,只要是篇幅较长、格式混乱且由人类撰写的文本,它都能处理。

但 LangExtract 绝非普通的 “LLM 包装器”,它有着扎实的核心功能。以下这些特点,让它在同类工具中脱颖而出:

- 可追溯性:每一个提取出的实体,都会直接与原始文档绑定,并且附带字符偏移量信息。不存在模糊的转述情况,如果它提取出 “朱丽叶是太阳” 这句话,就会明确展示出这句话在原始文本中的具体位置。这一功能对于验证提取结果、调试边缘案例非常实用,从根本上避免了 “盲目信任提取结果” 的问题。

- 输出不偏离预设规则:你只需定义好提取模式,并提供几个示例,LangExtract 就不会像普通 LLM 提示词那样,在提取过程中 “自由发挥”、偏离方向。它会严格遵循你设定的模式,始终保持输出的一致性。这背后依靠的是 “受控生成” 技术 —— 一种能让 LLM 输出始终符合预设规则的技术。虽然 Gemini 模型在这一技术的适配性上表现出色,但 LangExtract 也支持与其他后端模型配合使用。

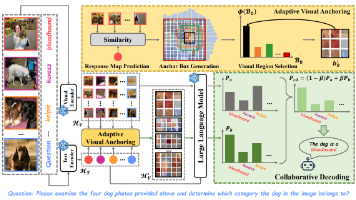

- 擅长处理长文档:面对篇幅庞大的医疗报告或像莎士比亚戏剧这样的长文本,大多数 LLM 要么直接崩溃,要么提取到中途就 “忘记” 了目标。而 LangExtract 采用了 “文档分块 - 并行处理 - 多轮拼接” 的策略来应对:先将长文档拆分成多个小块,对这些小块进行并行提取处理,之后再通过多轮优化,将所有提取结果整合拼接。这种方式虽非完美,但专为处理大量数据设计,而非仅用于制作花哨的博客演示案例。

- 提取过程可视化、可交互:LangExtract 会生成一个完全可交互的 HTML 文件,文件中会清晰展示所有提取出的实体及其上下文信息。这意味着你无需费力查看复杂的 JSON 数据,只需打开浏览器,就能直观看到提取了哪些信息、这些信息来自哪里。无论是给老板做快速演示,还是自己测试边缘案例,这个功能都能派上大用场。

- 灵活性极高:LangExtract 的灵活性远超预期,适用场景十分广泛:提取医疗信息、生成财务摘要、梳理法律条款…… 只要你提供几个清晰的示例,它就能快速学习并适配对应的提取模式,无需进行模型微调。这让它成为了一种 “特殊但高效” 的工具,尤其适合那些 “结构重要但文本写作风格差异大” 的领域。

谷歌团队甚至为放射学报告专门搭建了演示案例:输入一份格式混乱的自由文本放射报告,LangExtract 能将其转化为结构化的检查发现。这绝非 “玩具级” 工具,而是能为严肃工作流程提供支持的生产级框架(尽管为规避法律风险,官方附带了免责声明)。

-

知边界、不越界

:LangExtract 既能提取 “显式信息”(直接来自文本的信息),也能提取 “推断信息”(基于模型世界知识推导的信息)。不过需要注意的是,推断信息的准确性完全依赖于所使用的模型以及你提供的提示示例 —— 这也是该功能需要谨慎使用的地方。

2、LangExtract 的使用案例总结

当你面对 1000 份格式混乱的文档,需要从中提取药物名称、关键检查结果、故事角色等结构化信息时,LangExtract 能实现以下功能:

- 精准提取目标结构化信息;

- 将提取结果与原始文本关联,确保可追溯;

- 支持批量处理大量文档;

- 生成可视化界面,方便审查核对;

- 可在你选择的任意模型上运行;

- 通过几个示例就能学习你的提取模式;

- 无需从零开始搭建完整的信息提取管道。

为什么 LangExtract 如此重要?

在众多 LLM 工具中,LangExtract 属于少数真正理解 “无结构文本提取痛点” 的工具。目前大多数 AI 包装器工具,要么过于追求 “智能化”,最终输出大量无用信息;要么把复杂的问题抛给用户,只给出 “只需微调模型” 这样的模糊建议。

而 LangExtract 恰好处于两者之间:既有足够的智能来解决实际问题,又有扎实的功能来保证结果可靠。它不追求成为 “无所不知的神奇系统”,而是专注于以 “务实、可靠” 的方式完成信息提取任务。

3、Python 代码

import textwrap

import langextract as lx

# 1. 定义简洁的提取提示词

prompt = textwrap.dedent("""\

提取按出现顺序排列的角色、情感和关系。

使用原文进行提取。不要转述或重叠实体。

为每个实体提供有意义的属性以增加上下文。""")

# 2. 提供高质量示例以引导模型

examples = [

lx.data.ExampleData(

text=(

"ROMEO. But soft! What light through yonder window breaks? It is"

" the east, and Juliet is the sun."

),

extractions=[

lx.data.Extraction(

extraction_class="character",

extraction_text="ROMEO",

attributes={"emotional_state": "wonder"},

),

lx.data.Extraction(

extraction_class="emotion",

extraction_text="But soft!",

attributes={"feeling": "gentle awe"},

),

lx.data.Extraction(

extraction_class="relationship",

extraction_text="Juliet is the sun",

attributes={"type": "metaphor"},

),

],

)

]

# 3. 在输入文本上执行提取操作

input_text = (

"Lady Juliet gazed longingly at the stars, her heart aching for Romeo"

)

result = lx.extract(

text_or_documents=input_text,

prompt_description=prompt,

examples=examples,

model_id="gemini-2.5-pro",

)

可使用以下代码片段将提取结果保存为 HTML 文件,实现可视化查看:

# 将结果保存为JSONL文件

lx.io.save_annotated_documents([result], output_name="extraction_results.jsonl")

# 从JSONL文件生成交互式可视化HTML内容

html_content = lx.visualize("extraction_results.jsonl")

with open("visualization.html", "w") as f:

f.write(html_content)

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

2025最新版CSDN大礼包:《AGI大模型学习资源包》免费分享**

一、2025最新大模型学习路线

一个明确的学习路线可以帮助新人了解从哪里开始,按照什么顺序学习,以及需要掌握哪些知识点。大模型领域涉及的知识点非常广泛,没有明确的学习路线可能会导致新人感到迷茫,不知道应该专注于哪些内容。

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1级别:AI大模型时代的华丽登场

L1阶段:我们会去了解大模型的基础知识,以及大模型在各个行业的应用和分析;学习理解大模型的核心原理,关键技术,以及大模型应用场景;通过理论原理结合多个项目实战,从提示工程基础到提示工程进阶,掌握Prompt提示工程。

L2级别:AI大模型RAG应用开发工程

L2阶段是我们的AI大模型RAG应用开发工程,我们会去学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

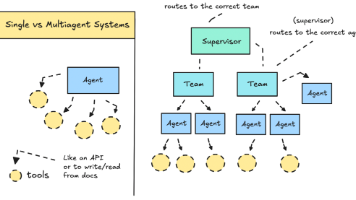

L3级别:大模型Agent应用架构进阶实践

L3阶段:大模型Agent应用架构进阶实现,我们会去学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造我们自己的Agent智能体;同时还可以学习到包括Coze、Dify在内的可视化工具的使用。

L4级别:大模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,我们会更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调;并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

整个大模型学习路线L1主要是对大模型的理论基础、生态以及提示词他的一个学习掌握;而L3 L4更多的是通过项目实战来掌握大模型的应用开发,针对以上大模型的学习路线我们也整理了对应的学习视频教程,和配套的学习资料。

二、大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

三、大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

四、大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

五、大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

更多推荐

已为社区贡献170条内容

已为社区贡献170条内容

所有评论(0)