WebGPU在前端实时AI图像生成中的性能优化与实现策略

通过WebGPU的硬件级并行计算能力和优化策略,开发者可以在前端实现高效、稳定的实时AI图像生成。结合显存池化、计算着色器加速和动态LOD切换等技术,能够显著提升用户体验。未来,随着WebGPU标准的成熟和硬件适配的完善,前端AI图像生成将迈向更广阔的场景。参考文献。

💓 博客主页:瑕疵的CSDN主页

📝 Gitee主页:瑕疵的gitee主页

⏩ 文章专栏:《热点资讯》

目录

随着AI技术的快速发展,实时图像生成(如风格迁移、超分辨率等)在前端场景中的需求日益增长。WebGPU作为新一代图形与计算API,通过硬件级并行计算能力,为前端AI图像生成提供了高性能解决方案。本文将深入探讨如何利用WebGPU优化实时AI图像生成的性能,并结合代码示例与技术细节展开分析。

WebGPU基于Vulkan/DirectX 12/Metal底层API,支持GPU的千级核心并行处理能力。相比传统WebGL,其性能提升显著:

- 计算着色器(Compute Shader):可直接在GPU上执行AI模型的推理任务,减少CPU-GPU数据传输开销。

- 低延迟渲染:通过命令缓冲区(Command Buffer)和异步任务队列机制,将操作延迟降低至10ms以内。

- 显存池化:预分配显存池,减少运行时内存分配开销。

- 绑定组(Bind Group):高效管理显存绑定,避免频繁的内存碎片化问题。

根据画面复杂度动态调整渲染精度,降低显存占用与计算负载。

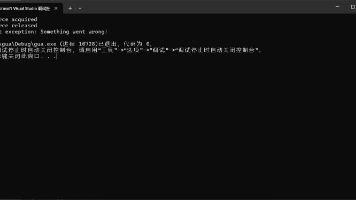

通过显存池化减少内存分配开销,以下是实现示例:

const bufferPool = {

buffers: [],

allocate(size, usage) {

let buffer = this.buffers.find(b => b.size >= size && !b.inUse);

if (!buffer) {

buffer = device.createBuffer({

size,

usage,

mappedAtCreation: true

});

this.buffers.push(buffer);

}

buffer.inUse = true;

return buffer;

},

release(buffer) {

buffer.inUse = false;

}

};

使用WebGPU的计算着色器(WGSL语言)实现AI模型的并行处理。以下示例展示风格迁移的简化实现:

struct Input {

inputTexture: texture_2d<f32>,

styleKernel: texture_2d<f32>

};

@group(0) @binding(0) var<uniform> params: Input;

@group(0) @binding(1) var outputTex: texture_storage_2d<rgba8unorm, write>;

@compute @workgroup_size(16, 16)

fn main(@builtin(global_invocation_id) id: vec3<u32>) {

let uv = vec2<f32>(id.x, id.y);

let inputColor = textureLoad(params.inputTexture, uv, 0);

let kernelColor = textureLoad(params.styleKernel, uv, 0);

// 简化版风格迁移逻辑

let outputColor = inputColor * kernelColor;

textureStore(outputTex, uv, outputColor);

}

根据模型复杂度动态调整渲染精度,以下是实现示例:

function calculateLOD(frameData) {

const complexity = calculateSceneComplexity(frameData);

if (complexity < 0.3) {

return 'low'; // 使用256x256分辨率

} else if (complexity < 0.7) {

return 'medium'; // 使用512x512分辨率

} else {

return 'high'; // 原始分辨率

}

}

const lodConfig = {

low: { width: 256, height: 256 },

medium: { width: 512, height: 512 },

high: { width: 1920, height: 1080 }

};

WebGPU的资源同步屏障设计直接影响性能。通过以下技巧优化同步效率:

- 精准匹配屏障类型:针对纹理或缓冲区的不同操作场景选择最匹配的屏障类型。

- 合并相邻屏障:减少冗余的同步操作。

- 延迟屏障触发:允许无依赖任务并行执行。

- 输入预处理:将图像数据上传到GPU显存。

- 计算着色器处理:在GPU上执行AI模型推理(如风格迁移、超分辨率)。

- 输出渲染:将结果渲染到Canvas或视频流中。

通过Web组件封装AI图像生成逻辑,实现与前端UI的无缝集成。以下是Web组件示例:

<webgpu-ai-renderer src="input.jpg" model="style-transfer"></webgpu-ai-renderer>

class WebGPUAIComponent extends HTMLElement {

constructor() {

super();

this.canvas = document.createElement('canvas');

this.appendChild(this.canvas);

}

connectedCallback() {

this.initWebGPU();

this.startRendering();

}

initWebGPU() {

// 初始化WebGPU设备与管线

}

startRendering() {

// 启动渲染循环

}

}

customElements.define('webgpu-ai-renderer', WebGPUAIComponent);

WebGPU在不同硬件上的性能表现差异较大。建议采用以下策略:

- 移动端优化:通过动态任务优先级调度减少帧率波动(如三星Galaxy S23 Ultra的优化案例)。

- 低端设备适配:采用三级LOD切换策略(Level 0: 2万面片,Level 1: 50万面片,Level 2: 200万面片)。

通过监控工具(如Chrome Performance面板)定位性能瓶颈,并根据用户反馈调整优化策略。

- WebGPU的Vulkan兼容层:计划在2024年实现,进一步降低跨平台开发成本。

- 多线程渲染支持:WebGL 3.2即将推出的多线程渲染支持,可提升复杂场景效率。

- 硬件适配挑战:需针对不同GPU架构(如NVIDIA 32的倍数线程组大小,AMD 64的倍数)优化线程分配策略。

- AI模型轻量化:结合WebAssembly实现复杂特效的补充,降低GPU负载。

通过WebGPU的硬件级并行计算能力和优化策略,开发者可以在前端实现高效、稳定的实时AI图像生成。结合显存池化、计算着色器加速和动态LOD切换等技术,能够显著提升用户体验。未来,随着WebGPU标准的成熟和硬件适配的完善,前端AI图像生成将迈向更广阔的场景。

参考文献:

更多推荐

已为社区贡献49条内容

已为社区贡献49条内容

所有评论(0)