一文看懂log函数在大模型中的作用

Log函数(对数函数)是数学中的逆运算工具,能将指数问题转化为简单运算。核心特性包括:将乘法变加法、压缩数值范围、解决指数方程。在大模型训练中,Log函数通过交叉熵损失函数和Softmax激活函数优化计算,避免数值下溢,提升训练稳定性。总结来说,Log函数是处理复杂运算的"数学转换器",让大数计算和模型训练更高效可控。

通俗解释:Log 函数是什么?它在数学和大模型训练中的作用

一、Log 函数是什么?

Log 函数(对数函数)是数学中的“逆运算工具”,专门解决“指数问题”。

-

通俗理解:如果问“2的几次方等于8?”,答案是3,写成数学表达式就是:

log2(8)=3

这里的“2”是底数,“8”是真数,“3”是对数结果,表示“以2为底,8的对数是3”。

-

核心特性:

-

逆运算:Log 是幂运算的逆运算(例如,23=8→ log2(8)=3)。

-

简化复杂计算:将乘法转化为加法,将幂运算转化为乘法(例如,log(ab)=loga+logb)。

-

压缩数值范围:对大数或小数取对数后,数值范围会缩小(例如,1到1000的对数值是0到3)。

-

二、Log 函数在数学中的作用

-

简化复杂运算

-

乘法变加法:计算 1000×100时,取对数后只需计算 3+2=5,再取指数得到结果 105=100000。

-

解决指数方程:例如,求解 3x=27,直接取对数得 x=log3(27)=3。

-

-

处理大范围数据

-

科学测量:地震震级(里氏震级)、声音强度(分贝)等均用对数尺度,便于描述跨越多个数量级的变化。

-

-

信息论与熵

-

信息量计算:信息量的公式为 I=−log(p),其中 p是事件发生的概率。概率越小(如罕见事件),信息量越大。

-

三、Log 函数在大模型训练中的作用

在大模型(如神经网络)中,Log 函数主要用于优化计算和稳定训练,具体体现在以下场景:

-

交叉熵损失函数(Cross-Entropy Loss)

-

作用:衡量模型预测概率与真实标签的差距。

-

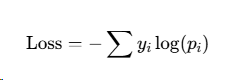

公式:

其中 yi是真实标签(0或1),pi是模型预测的概率。

-

为什么用 Log?

-

梯度友好:Log 的导数简单(dxdlog(x)=1/x),便于反向传播时计算梯度。

-

避免数值下溢:直接相乘概率(如 p1×p2×...)会导致数值趋近于0,取对数后转化为求和,更稳定。

-

-

-

Softmax 激活函数

-

作用:将模型输出的“原始分数”(Logits)转换为概率分布。

-

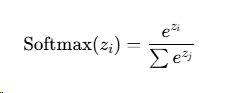

公式:

-

Log 的配合:

-

训练时直接使用 Log-Softmax(对 Softmax 结果取对数),避免数值计算中的指数爆炸问题。

-

例如,计算交叉熵损失时,PyTorch 会直接调用

torch.nn.functional.log_softmax提升效率。

-

-

-

优化算法中的对数变换

-

学习率调整:某些优化器(如 Adam)会用对数尺度调整学习率,避免早期训练震荡。

-

正则化:对权重参数取对数,约束其范围(如防止权重过大)。

-

四、Log 函数的直观类比

-

音乐中的音高:音高与频率的关系是对数关系。频率翻倍(如从 440Hz 到 880Hz),音高只升高一个八度。

-

地图比例尺:对数尺度地图能同时显示从城市到国家的范围,避免小比例尺细节丢失。

五、总结

-

数学中:Log 是“逆向放大器”,简化乘除为加减,压缩数据范围。

-

大模型中:Log 是“稳定器”和“加速器”,让损失计算更平滑,训练更高效。

-

核心价值:通过数学变换,解决指数级问题,让复杂计算变得可控。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)