通过提示词工程提升大模型在HLE上的表现的初步研究

本文探讨了提示工程对大语言模型(LLM)在Humanity's Last Exam(HLE)基准测试中表现的影响。通过设计包含角色设定、场景模拟和多步骤推理的提示模板,研究者测试了DeepSeek V3.1模型在物理和CS/AI领域的表现。结果显示,采用结构化提示后正确率从基线0/37提升至7/37(18.92%)和17/66(25.76%)。研究还发现问题的表述方式显著影响模型表现,并验证了&q

总结

考虑到 https://hf-mirror.com/deepseek-ai/DeepSeek-V3.1-Base DeepSeek V3.1-Thinking 的得分为15.9或R1为17.7,而无思考模型的DeepSeek V3.1在零样本情况下得分为7/37(18.92% +/- 12.62%)或17/66(25.76% ± 10.55%),我认为这是一个初步结果,表明提示工程可以帮助LLM回答更多问题。

考虑到 https://lastexam.ai/ 在8月30日的数据

- Grok 4 准确率为25.4

- GPT-5 准确率为25.3

- Gemini 2.5 Pro 准确率为21.6

而无思考模型的DeepSeek V3.1在零样本情况下得分为7/37(18.92% +/- 12.62%)或17/66(25.76% ± 10.55%),我认为这显示了广阔的前景,值得进一步研究。

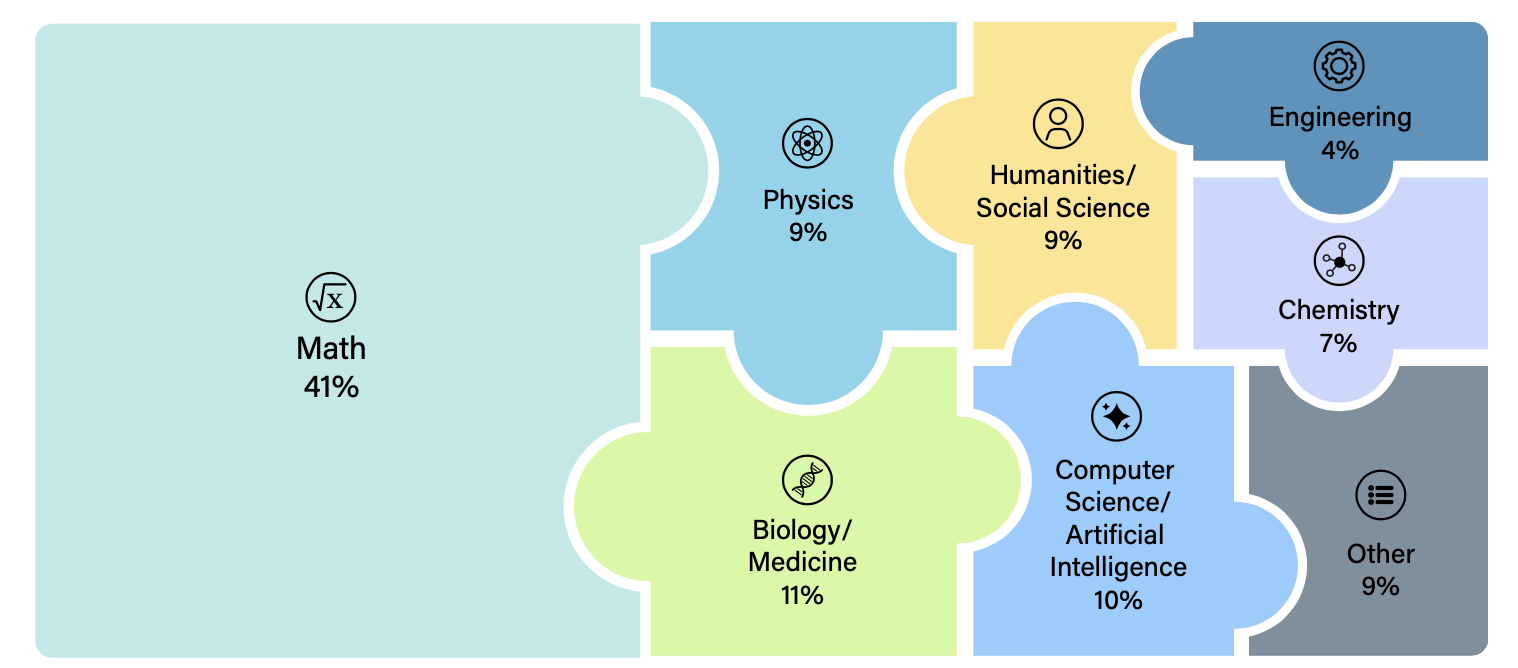

HLE(Humanity’s Last Exam)

Humanity’s Last Exam (HLE) 是一个为评估最前沿大语言模型(LLM)能力而设计的多模态基准测试。它旨在解决当前主流基准(如MMLU)因模型性能已超过90%而逐渐失效的问题。

HLE定位为“人类知识的最后考试”,其核心特点包括:

- 极高难度:包含2,500道极具挑战性的题目,覆盖超一百个学科,均处于人类知识的前沿。

- 多模态:不仅包含文本,还融合了图像等其他模态的信息。

- 防过拟合:采用公开题库与私有测试集结合的方式(公开2,500题,另持有一个未公开的测试集),以更真实、有效地评估模型的泛化能力,防止其通过记忆答案获得高分。

简言之,HLE旨在成为衡量顶尖AI模型真正理解与推理能力的终极学术基准。

提示工程非常重要

参考:

https://www.bilibili.com/video/BV1j4h3zpEPa

https://docs.anthropic.com/en/resources/overview

https://github.com/StamKavid/claude-code-prompting-101

我查看了我们目前的提示。

https://github.com/centerforaisafety/hle/blob/67b325111a0c3678eeb563eb30f98344f06846ad/hle_eval/run_model_predictions.py#L11

我们目前的提示对于每个样本,仅仅具有结构化的输出。

我在本地使用DeepSeek v3.1 API(针对无图像选择题)进行了一个关于角色、场景和任务步骤的实验。

假设是:提示工程可以帮助LLM回答更多问题

我应该从哪里获取角色、场景和信息…?

当我们向LLM“提问”时,或者在智能体开发中,我们假设“对话”发生在某个“场景”中,人物/智能体在其中扮演“角色”。相反,如果我们有问题、答案和理由,我们可以要求LLM推断角色和场景。

以下是用于推断的提示。

注意:这是一个提示模板,其中msg对应问题,answer对应答案,cause对应理由(rationale)

"""issue\n""" + msg + """

\nanswer\n

"""+answer+"""

cause\n""" + cause + """

——————

以上是一些零散的信息

基于这些信息,您认为回答这个问题的最佳人选是什么?

在什么场景下可能会被问到这个问题?

回答者的思考过程是怎样的?并总结思考过程中出现的知识点。

请以json格式输出

thinking_process: str

role: str

scene: str

knowledge: list[str]

任务特定性

为了验证假设,是时候从hle中选择数据集了。

由于我已经在使用DeepSeek v3.1,因此图像不在考虑范围内。

由于我没有判断的知识,并且我不希望LLM自我判断,所以选择选择题。

从物理开始,我对物理很有自信……即使我的软件职业生涯已经超过10年。(您可以在CNCF、Hyperledger、Apache等中找到我在GitHub上的贡献)

众所周知,我们可以采用通用步骤来处理选项选择。

- 步骤1:简单理解选项之间的差异

- 步骤2:回顾相关的物理原理和知识,例如knowledge_1, knowledge_2 …knowledge_n

- 步骤3:通过将相关物理原理和知识与选项之间的差异联系起来,确定研究要点

- 步骤4:请注意,问题本身的描述可能包含错误或细节问题,因此请基于事实回答。

- 步骤5:分析本体的研究要点并假设一个答案。

- 步骤6:基于假设的选项,比较和分析选项之间的差异。

将其转化为提示,我们得到以下提示模板:

注意:msg是要回答的问题,internal_data["role"]和internal_data["scene"]来自上一步,formatted_string.strip()是来自上一步的知识

"""You are """ + internal_data["role"] + """\n

You are in """ + internal_data["scene"] + """\n

You need to answer following question

Please follow the steps below to provide a brief answer

Step 1: Simply understand the difference between options

Step 2: Review relevant physics principles and knowledge, such as:\n

""" +

formatted_string.strip()

+ """\n

Step 3: Identify the points of study by connecting relevant physics principles and knowledge to the difference between options

Step 4: Please note that the descriptions in the question itself may contain mistakes or nits, so please answer based on the facts.

Step 5: Analyze the ontology's points of investigation and assume an answer.

Step 6: Compare and analyze the differences between the options based on the assumed options.

Your answer should in json structure as

Thinking_process: {your thinking process, to show your followed steps to answer the question}

Explanation: {your reason}

Answer: string, just from given options

Confidence: {your confidence score between 0% and 100% for your answer}

Here is the question:

"""

+ msg

动态知识

物理下有多个类别。光学、天文学、电磁学……每个问题都需要回忆特定的知识点来回答。

- 原因:旨在特定知识点的帮助,模拟内容工程,例如从电子书中读取的函数调用,或开卷考试。

- 无连续对话:在代码实现中,我们应在对话A中获取这些知识点,并将其传递到对话B中。以避免LLM从上下文中学习或使用答案。

待办:我们需要知道哪些知识点有效……但定性测量和定量测量是不同的主题。

请注意,问题本身的描述可能包含错误或细节问题,因此请基于事实回答

我认为在交给LLM的任务和现实生活中的任务之间还有改进的空间。

问题_id:66f2dee46721a56e35d20300

使用位于附近太阳轨道上的强大望远镜创建了一张水星的图像。使用了以486nm为中心的1nm宽带通滤波器。描述水星钠尾在远日点与近日点的外观差异及其颜色....

我手动测试了这个问题,由于我没有天文学学位……所以我转向了一个类比,来解释为什么DeepSeek失败。

测量食用盐(NaCl)的pH值。

我们知道这很容易测试,因为我们将一些盐放入水中并使用pH试纸……

LLM可能会说,哦,pH试纸仅用于“水溶液”(我的意思是液体),而不用于食用盐。

使用deepseek的测试结果表明,deepseek关注于“水星的钠尾”并假设其被过滤掉。如果我们将“水星的钠尾”改为“水星的尾巴”,效果会更好,有时可以工作。

问题_id:66f28cc8b866ea3f1f4e95f5

问:我有一个连接到矢量网络分析仪的磁环天线。如果我将其靠近MRI的接收线圈,我将在线圈的工作频率处看到共振。但是,有些线圈我看不到共振。但它们完全正常。这是怎么可能的?

答:这些是高阻抗线圈。

这是一个简答题,问题是问“如何”,而答案似乎是“什么”。将How it's possible?改为What kind of coils are they?效果更好。

在答案之前将Thinking_process作为结构化输出

您可以看到提示模板是“ReAct”风格。

- 步骤5:分析本体的研究要点并假设一个答案。

- 步骤6:基于假设的选项,比较和分析选项之间的差异。

是的,从Thinking_process中可以观察到“Aha”时刻。因此,Thinking_process在Answer之前。

如果Answer字段在前,即使有“Aha”时刻,Answer字段也不会被更正。(我在与LLM对话时禁用了流式传输方式)

结果

| 名称 | 正确数 | 使用的token数 | 评论 |

|---|---|---|---|

| 基线 | 0/37 | 21371 | 系统提示 |

| 第一轮 | 7/37(18.92% +/- 12.62%) | 71177 | 本issue中的方法 |

| 第二轮 | 7/37(18.92% +/- 12.62%) | 我在晚上11点进行这一轮时丢失了token使用记录,我从记录json中恢复了数据。 | |

| 使用CS/AI测试 | 17/66(25.76% ± 10.55%) | 215064 | 早上醒来后,我注意到我忘记将提示从物理改为CS/AI……但它仍然得到了17/66 |

注意1:有些问题在第一轮正确,在第二轮错误。也许应该测试为Pass@1?或者如果我们说Pass@5,可能会更正确?

注意2:有些格式错误被计为错误,即使答案是正确的。例如:B(bob),但我们想要B

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)