程序员必看:大模型Agent开发前必须思考的两个维度 - 本质与复杂度【珍藏指南】

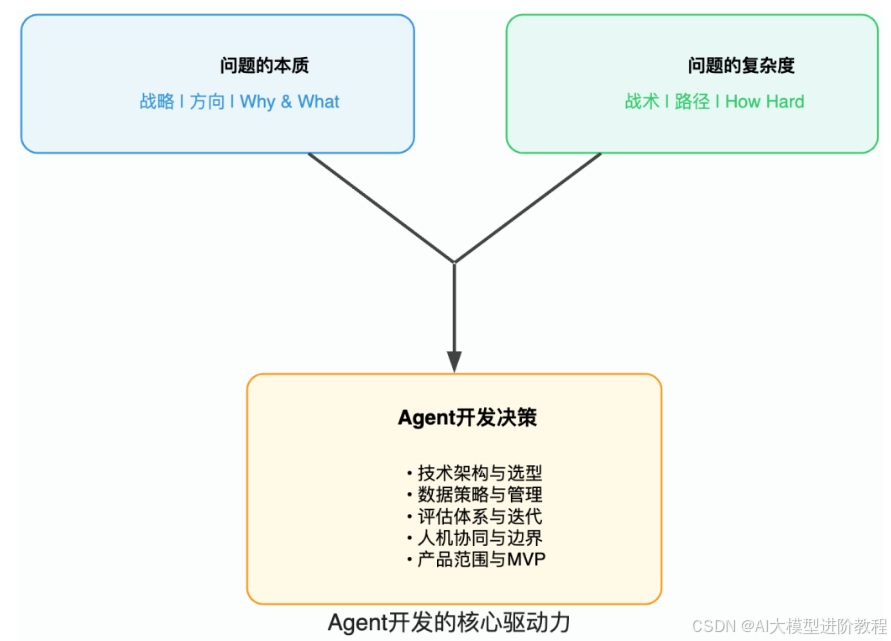

文章阐述了开发大模型Agent前必须从两个维度进行分析:问题本质(战略层面,关注核心目标、输入输出、约束规则和环境状态)和问题复杂度(战术层面,关注状态空间、动态性、规划深度等)。这两个维度分别指导"做正确的事"和"正确地做事",影响技术选型、数据策略、评估指标、人机协同设计和范围定义等开发决策,确保资源高效利用,交付有价值的产品。

1. 问题的本质 (The Nature of the Problem)

问题的本质,是指剥离掉所有表面细节和实现方式后,问题最核心的目标、输入、输出和约束。它回答的是“我们到底要解决什么(What)”以及“为什么(Why)”要解决它。

理解问题本质包含以下几个关键层面:

·核心目标 (Core Objective): 最终要达成的状态或价值是什么?这不应该是“做一个聊天机器人”,而应该是“将用户平均问题解决时间从15分钟缩短到2分钟”或“提升用户对产品功能的自主探索率30%”。目标必须是可衡量的、有价值的。

·输入与输出 (Inputs & Outputs): Agent接收什么信息,并需要产生什么行动或结果?

o输入: 是结构化数据(如API返回的JSON),还是非结构化文本(用户提问)?是单一来源,还是多模态(文本+图片)?

o输出: 是生成一段文本,调用一个API,执行一系列动作(如在软件中点击按钮),还是改变物理世界(如控制机器人手臂)?

·约束与规则 (Constraints & Rules): 在解决问题的过程中,必须遵守哪些限制?

o业务约束: 预算、时间、合规性(如GDPR)、品牌声誉等。

o技术约束: 延迟不能超过500ms、必须在特定硬件上运行、API调用有频率限制等。

o物理/环境规则: 如果是自动驾驶,必须遵守交通规则;如果是游戏AI,必须遵守游戏机制。

·环境状态 (Environment State): Agent所处的环境是怎样的?

o静态 vs. 动态: 环境是否在Agent决策时发生变化?(例如,下棋是回合制静态的,而自动驾驶是高度动态的)。

o可观测性: Agent能否获取环境的全部信息?(例如,棋类是完全可观测的,而扑克牌或股市预测是部分可观测的)。

为什么理解本质很重要?

如果对问题本质的定义错了,那么即使你开发出一个技术上再完美的Agent,它也无法创造真正的价值。这就像造了一艘非常坚固的船,但目的地本身就是错的。

2. 问题的复杂度 (Complexity of the Problem)

问题的复杂度,是衡量找到一个“足够好”的解决方案需要多少资源的度量。它回答的是“解决这个问题有多难(How Hard)”。这里的“资源”可以是计算时间、内存、数据量,甚至是人的认知负荷。

复杂度可以从以下几个维度来分析:

·状态空间大小 (State Space Size): 问题有多少种可能的情况?

o低复杂度: 井字棋的状态空间很小,可以暴力穷举。

o高复杂度: 围棋的状态空间比宇宙中的原子总数还多,无法穷举。

·动态性与不确定性 (Dynamism & Uncertainty):

o确定性 (Deterministic): 每个动作的结果都是唯一且可预测的(如移动棋子)。

o随机性 (Stochastic): 动作的结果带有随机成分(如游戏中的掷骰子,或机器人手臂操作时可能出现的轻微打滑)。

o动态性: 环境会独立于Agent的动作而变化(如股市、实时交通)。

·规划深度与广度 (Planning Depth & Breadth):

o深度: 需要“看”多少步未来才能做出好决策?(例如,国际象棋需要深远规划)。

o广度: 在每一步有多少种选择?(例如,围棋的广度远大于象棋)。

·目标的模糊性 (Goal Ambiguity): 目标是否清晰、单一?

o清晰目标: “赢得这盘棋”、“将文件从A移动到B”。

o模糊/多目标: “写一首优美的诗”、“设计一个既美观又实用的用户界面”、“在保证安全的同时尽快到达目的地”。这类问题通常没有唯一的“最优解”。

·数据需求与质量 (Data Requirement & Quality):

o低数据需求: 基于规则的系统可能不需要太多数据。

o高数据需求: 需要从海量数据中学习复杂模式的问题(如自然语言理解、图像识别)。

3. 如何引导Agent开发决策

问题的本质和复杂度,是指导Agent开发全流程的“北极星”和“地形图”。它们在战略和战术层面提供决策依据。

| 决策领域 | 问题本质 (战略 What & Why) | 问题复杂度 (战术 How) |

| 1. 技术选型与架构设计 | 决定了Agent的核心能力 - 本质是信息检索与整合 -> 优先考虑RAG(检索增强生成)架构。 - 本质是执行多步任务 -> 优先考虑ReAct、Plan-and-Execute等思维链框架。 - 本质是创意生成 -> 需要强大的生成模型(LLM)作为核心。 | 决定了实现该能力的具体方法 - 状态空间巨大、动态 -> 深度强化学习(Deep RL)、蒙特卡洛树搜索(MCTS)。 - 规划深度要求高 -> 需要CoT (Chain-of-Thought) 或 ToT (Tree-of-Thoughts) 来增强推理。 - 环境部分可观测 -> 需要记忆模块(Memory)和状态估计模型(如卡尔曼滤波)。 |

| 2. 数据策略 | 决定了需要什么样的数据 - 本质是医疗诊断辅助 -> 核心是高质量、经过标注的医疗影像和病历数据,而不是通用网络文本。 - 本质是模仿特定专家行为 -> 需要收集该专家的操作日志、决策记录作为高质量的示范数据(Demonstrations)。 | 决定了需要多少数据和如何处理数据 - 目标模糊、主观性强 -> 需要大量多样化的数据来学习隐式模式,并且可能需要人类反馈数据(RLHF)。 - 确定性、规则清晰 -> 可能只需要少量数据,甚至可以通过合成数据(Synthetic Data)来解决。 |

| 3. 评估指标与迭代方向 | 定义了“成功” - 本质是提升用户满意度 -> 评估指标就不能只有“任务成功率”,还必须包括用户满意度评分(CSAT)、用户留存率等。 - 本质是降低成本 -> 评估指标就是“自动化处理率”、“平均处理成本”等。 | 定义了“改进”的难度和方向 - 问题复杂、多目标 -> 评估本身就很困难,可能需要建立多维度评估框架,并引入人类评估者进行主观打分。 - 迭代方向 -> 如果复杂度在于规划深度,就优化推理逻辑;如果在于环境动态性,就提升Agent的反应速度和适应性。 |

| 4. 人机协同设计 | 决定了Agent的角色是“替代”还是“增强” - 本质是处理高风险、需负责任的任务(如法律、金融) -> Agent应该设计成一个强大的“副驾驶”(Copilot),最终决策由人做出。 - 本质是处理重复性、低风险的任务 -> Agent可以被设计为完全自动化的执行者。 | 决定了人和机器的交接点 - 问题在某些场景下复杂度激增 -> Agent应被设计成能够识别自己的“知识边界”,在遇到高复杂度或低置信度的场景时,主动将控制权交给人类。 - 例如: 一个客服Agent可以自动处理80%的常规问题,但遇到高复杂度或高情绪化的用户时,立即转接人工坐席。 |

| 5. 范围定义与MVP | 帮助我们聚焦核心价值,定义MVP - 一个“万能”的个人助理Agent,其本质可能非常宽泛。为了落地,我们首先要找到一个核心场景,比如“高效的会议纪要整理与任务分配”,以此作为MVP的本质。 | 帮助我们管理风险,设定合理预期 - 如果一个问题的复杂度极高(如通用人工智能),那么MVP的目标就不可能是“完全解决”,而可能是“在某个高度受限的子领域内,表现超越现有方案”。 - 承认复杂度,可以避免好高骛远,从而制定出切实可行的开发路线图。 |

总结

·问题的本质是战略层面的思考,它决定了你的方向。如果方向错了,跑得再快也没有用。它确保你正在“做正确的事”(Building the right thing)。

·问题的复杂度是战术层面的分析,它决定了你的路径和工具。它评估了到达目的地需要翻越多少高山、渡过多少河流。它确保你“正确地做事”(Building the thing right)。

g)。

·问题的复杂度是战术层面的分析,它决定了你的路径和工具。它评估了到达目的地需要翻越多少高山、渡过多少河流。它确保你“正确地做事”(Building the thing right)。

在开发任何Agent之前,花充足的时间进行这两个维度的分析,可以让整个开发过程事半功倍,避免资源浪费,并最终交付一个真正有价值的产品。

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!

你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

更多推荐

已为社区贡献22条内容

已为社区贡献22条内容

所有评论(0)