控制LLM生成--SGCD

本文提出草图引导约束解码(SGCD)方法,用于解决黑盒大模型生成结构化内容时的格式约束问题。该方法采用两阶段处理:首先由黑盒大模型生成初步草图,再由本地辅助模型进行约束细化。实验表明,SGCD在信息提取和句法分析任务中显著提升性能(精确度最高提升32.1%)。虽然该方法存在额外开销、依赖模型指令跟随能力等局限,但为不修改模型参数实现约束生成提供了新思路,尤其适用于需要严格格式保证的应用场景。

参考论文:https://arxiv.org/pdf/2401.09967

一、整体介绍

在我们运用大模型进行生成任务时,由于个性化输出需求,我们需要输出内容按照我们需要的内容格式进行生成,eg: json、SQL等,但是我们又不想从头开始微调大模型,而能直接采用一些方法引导模型按照我们需要生成(虽然直接在Prompt中进行生成内容格式约束,但是效果不太稳定),SGCD技术就是用来解决这个问题。传统的受限解码,是一种在语言模型输出上强制约束的方式进行实现的,然而,这种技术的应用通常受限于能够访问模型的softmax logits(下一个token分布)的模型,这在黑盒大型语言模型(LLMs)中并不可行。

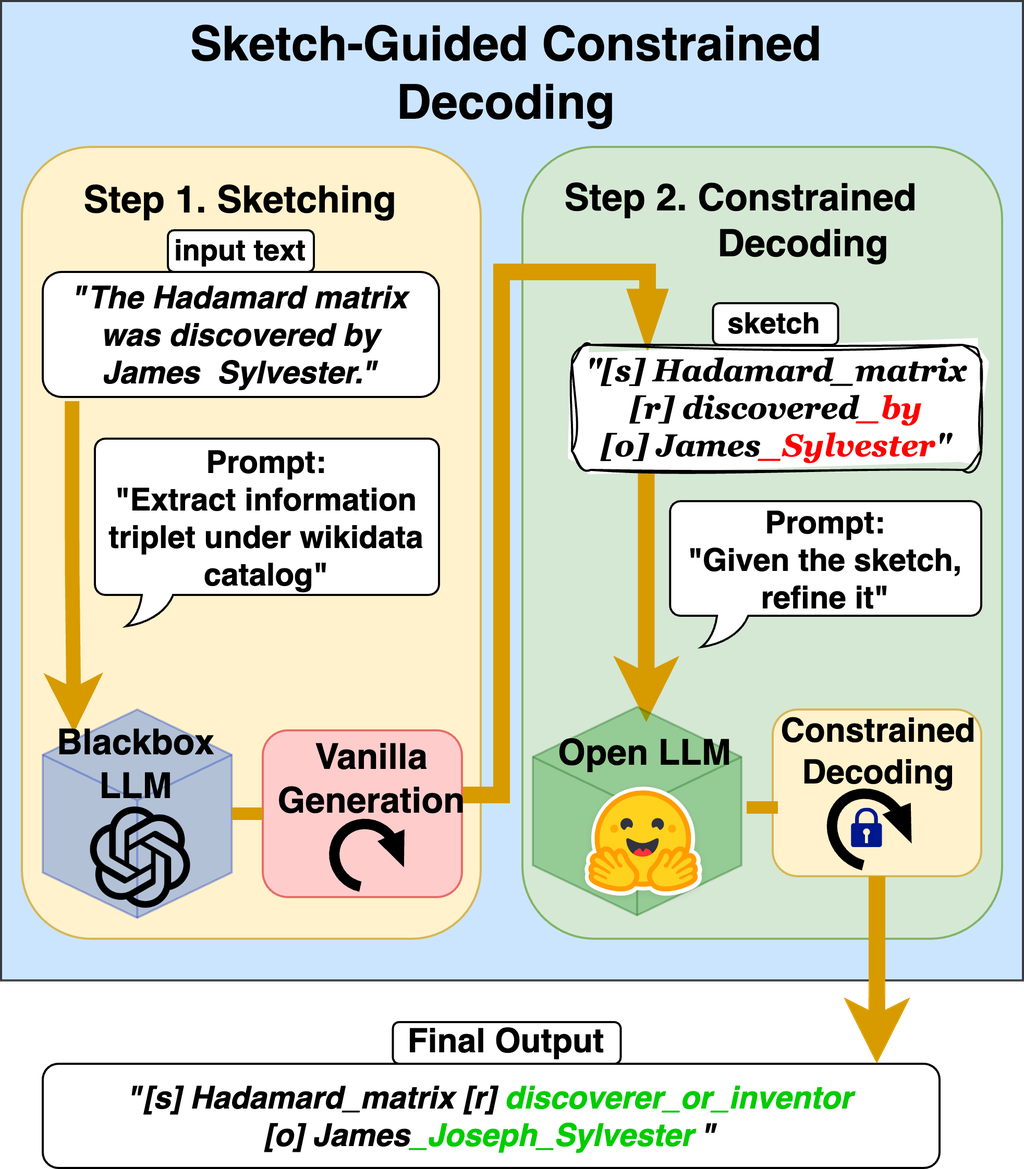

为了解决这个问题,论文提出了一种名为草图引导约束解码(Sketch-Guided Constrained Decoding, SGCD)的新方法。SGCD不依赖于黑盒LLM的logits,而是利用一个本地托管的辅助模型来细化黑盒LLM的输出。这个初始输出被视为进一步细化的“草图”。SGCD将约束解码任务分为两个阶段:草图阶段和约束生成阶段。在草图阶段,一个强大的黑盒LLM生成一个初步的草案。在约束生成阶段,一个较小规模的本地LLM对草案进行细化,以满足指定的约束。

图1:概述草图引导的约束解码(SketchGCD)。 在初始素描阶段中,BlackBox LLM在不应用任何约束的情况下生成了初步的“草图”答案。 然后,在约束解码阶段,一个辅助模型,即约束解码器,对草图进行细化。 经过细化的最终输出通过构造满足指定的约束。

二、方法介绍

SketchGCD 将约束解码任务分为两个不同的阶段:草图绘制和约束解码。

2.1草图绘制

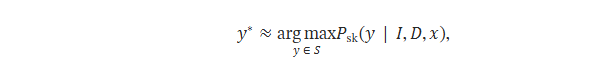

在草图绘制期间,一个草图绘制器——一个强大的黑盒 LLM,记为Psk—采用。它解释一条指令I以及一组示例对 ,生成一个预备草稿y∗通过无约束解码:

其中S是所有可能序列的集合。

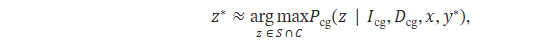

2.2 约束解码

约束解码由约束解码器完成,这是一个较小规模的、本地托管的大语言模型(LLM)Pcg.给定一条指令Icg,一组输入-草图-输出演示 ,原始输入x,和草图y∗,它细化y∗为

服从约束条件 C. (可选地, x 和 xi 可以省略,但会损失信息。)

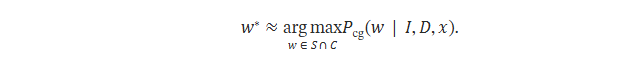

相反,使用约束解码的经典直接少样本提示通常需要一个更大的约束生成器Pcg在本地运行,以便找到

另一个基本的替代方法, 无约束少样本提示(Brown et al., 2020),产生 y∗ 作为最终输出结果。

SketchGCD基于这样的预期:约束细化后的输出z∗应该至少与两者一样好y∗(因为z∗符合约束条件)和w∗(作为Psk是一个比Pcg).

三、实验介绍

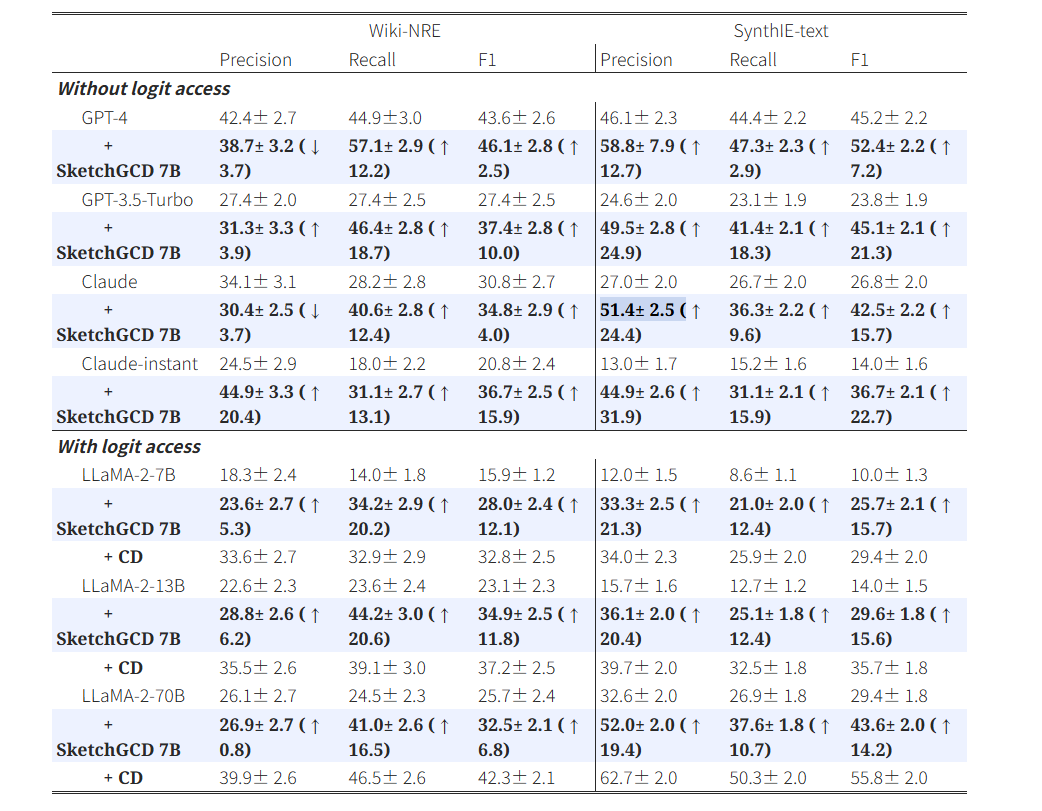

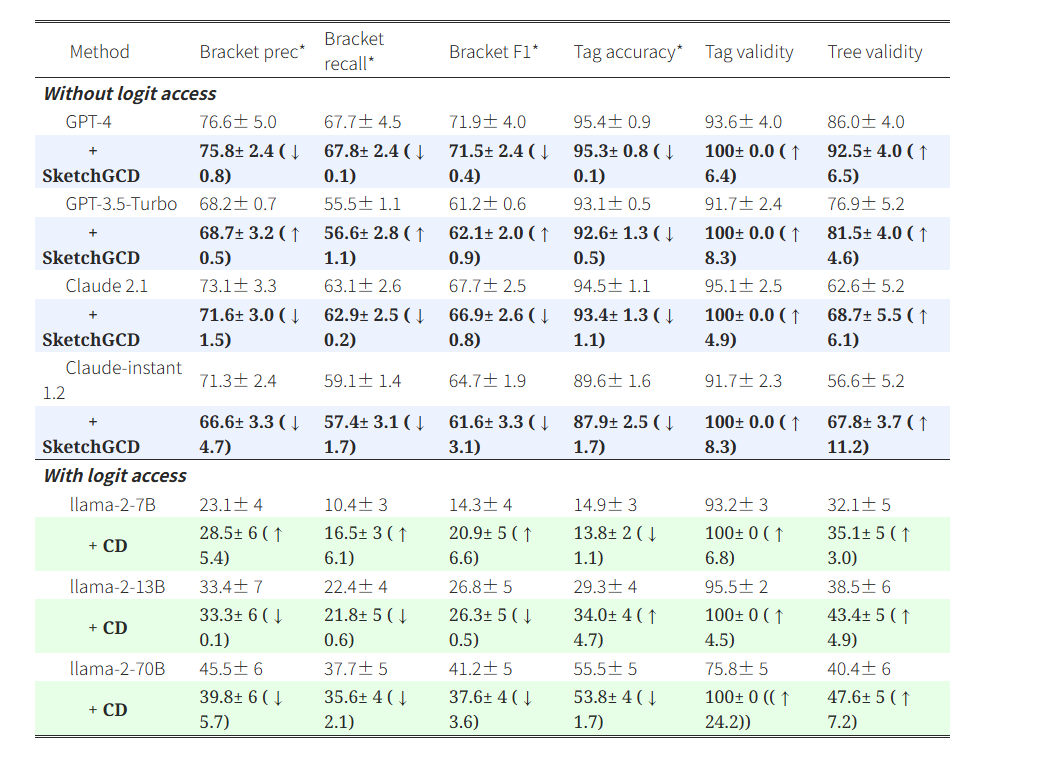

通过在封闭信息提取和依存句法分析任务上的实验,论文展示了SGCD的有效性。SGCD显著提高了LLMs的性能,并在多个模型上超越了先前的方法。

- 在封闭信息提取任务中,SGCD平均提高了16.4%的精确度和7.9%的召回率。

- 在依存句法分析任务中,SGCD提高了32.1%的精确度和27.4%的召回率

四、总结

受限解码 (SketchGCD)通过使用单独的草图绘制和细化阶段,来实现对生成结果的强制约束,取得了不错的效果。但是该种方法存在一定的局限性:

(1)SketchGCD 会增加额外的开销,因为它需要一个受约束的解码器在草图绘制阶段之后来细化草图;

(2)随着大语言模型 (LLM) 不断改进,指令跟随能力得到提升,通过prompt约束可以较好解决一些限制性生成;

(3)与经典的受约束解码一样,SketchGCD 只能在结构级别或句法级别强制约束,而不能在语义级别强制约束。模型仍然可能生成语义上不正确的输出。

--------------------------------------------------------------------------------------------------------------------------

YUTransformer是谁?

个人介绍:技术博客名为YUTransformer,8年AI老兵,从事NLP、大语言模型、多模态大模型等相关算法的研发和落地,拥有丰富的算法经验,先后在百度、平安、小鹏汽车从事算法落地的工作,借助平台将个人的一些算法研究和经验分享出来,一起推动技术的进步!加我vx(yx116169)入vlm/vla大模型群和llm群

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)