大模型学习

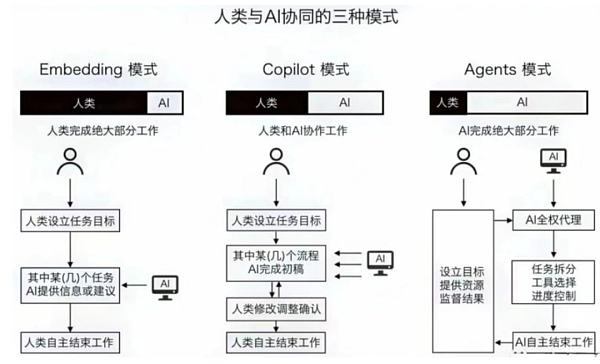

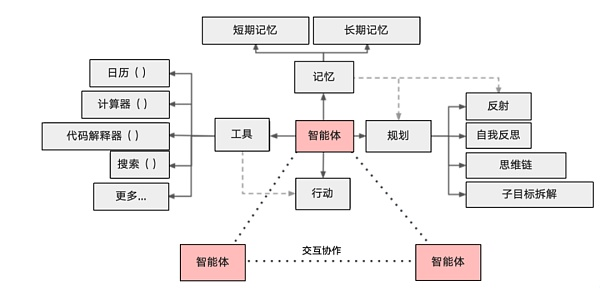

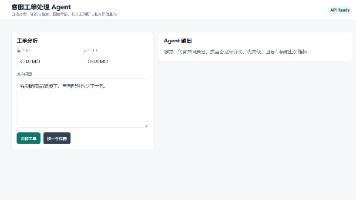

而 LangChain 则是提供一种通用的框架通过大语言模型的指令来轻松地实现这些工具的调用。我们都知道在执行一个复杂的任务时,我们需要考虑多方面的影响因素,将复杂任务拆分为细小的子任务去执行。AI Agent 的诞生就是为了处理各种复杂任务的,就复杂任务的处理流程而言 AI Agent 主要分为两大类:行动类、规划执行类。总而言之,AI Agent 就是结合大模型能去自动思考、规划、效验和执行的

ML system 入坑指南 | 摸黑干活 (fazzie-key.cool)

AI Agent(人工智能代理)是一种能够感知环境、进行决策和执行动作的智能实体

为什么需要 AI Agent

LLM 的一些缺点:

- 会产生幻觉

- 结果并不总是真实的

- 对时事的了解有限或一无所知

- 很难应对复杂的计算

- 没有行动能力

- 没有长期记忆能力

比如让 ChatGPT 买一杯咖啡,ChatGPT 给出的反馈一般类似 “无法购买咖啡,它只是一个文字 AI 助手” 之类的回答。但你要告知基于 ChatGPT 的 AI Agent 工具让它买一杯咖啡,它会首先拆解如何才能为你购买一杯咖啡并拟定代用某 APP 下单以及支付等若干步骤,然后按照这些步骤调用 APP 选择外卖,再调用支付程序下单支付,过程无需人类去指定每一步操作。这就是 AI Agent 的用武之地,它可以利用外部工具来克服这些限制。这里的工具是什么呢?工具就是代理用它来完成特定任务的一个插件、一个集成 API、一个代码库等等,例如:

- Google 搜索:获取最新信息

- Python REPL:执行代码

- Wolfram:进行复杂的计算

- 外部 API:获取特定信息

而 LangChain 则是提供一种通用的框架通过大语言模型的指令来轻松地实现这些工具的调用。我们都知道在执行一个复杂的任务时,我们需要考虑多方面的影响因素,将复杂任务拆分为细小的子任务去执行。AI Agent 的诞生就是为了处理各种复杂任务的,就复杂任务的处理流程而言 AI Agent 主要分为两大类:行动类、规划执行类。总而言之,AI Agent 就是结合大模型能去自动思考、规划、效验和执行的一个计算体,以完成特定的任务目标,如果把大模型比作大脑,那 AI Agent 可以理解为小脑 + 手脚。

为了解决有限记忆时间的限制,通常会用到外部存储器。常见的做法是将信息的嵌入表示保存到可支持快速的最大内积搜索(MIPS)的向量存储数据库中。向量数据库通过将数据转化为向量存储,解决大模型海量知识的存储、检索、匹配问题。向量是 AI 理解世界的通用数据形式,大模型需要大量的数据进行训练,以获取丰富的语义和上下文信息,导致了数据量的指数级增长。向量数据库利用人工智能中的 Embedding 方法,将图像、音视频等非结构化数据抽象、转换为多维向量,由此可以结构化地在向量数据库中进行管理,从而实现快速、高效的数据存储和检索过程,赋予了 Agent“长期记忆”。同时,将高维空间中的多模态数据映射到低维空间的向量,也能大幅降低存储和计算的成本,向量数据库的存储成本比存到神经网络的成本要低 2 到 4 个数量级。

Embedding 技术和向量相似度计算是向量数据库的核心。Embedding 技术是一种将图像、音视频等非结构化数据转化为计算机能够识别的语言的方法,例如常见的地图就是对于现实地理的 Embedding,现实的地理地形的信息其实远远超过三维,但是地图通过颜色和等高线等来最大化表现现实的地理信息。在通过 Embedding 技术将非结构化数据例如文本数据转化为向量后,就可以通过数学方法来计算两个向量之间的相似度,即可实现对文本的比较。向量数据库强大的检索功能就是基于向量相似度计算而达成的,通过相似性检索特性,针对相似的问题找出近似匹配的结果,是一种模糊匹配的检索,没有标准的准确答案,进而更高效地支撑更广泛的应用场景。

大模型学习路径:

https://github.com/ninehills/blog/issues/97

prompt设计的基础原则

1、明确性与结构化:明确的指令应当包含任务定义、角色设定和格式规范三个核心要素,避免产生歧义。

2、上下文管理:通过“参考上文”、“继续上文”这种提示,保持上下文的连贯性。

3、约束与容错:通过显式约束减少模型输出发散是Prompt设计的关键环节。这包括输出长度限制(如“不超过200字”、“分3点回答”)、否定指令(明确排除不需要的内容)以及异常处理机制(要求模型在无法完成任务时返回特定标识如“NEED_MORE_INFO”)。同时,Prompt设计应聚焦于指导模型应该做什么,而非仅仅强调不应做什么,这有助于模型更具体地理解任务要求

4、少样本提示:提供3-5个高质量样本,覆盖典型边界情况,使模型通过示例学习任务模式。更高效的做法是采用对比学习,同时展示正确与错误示例,使模型更清晰把握标准。也就是说先给它一个sample,辅助他回答问题,有点像思维链这个东西

5、思维链:可以要求模型输出思考方式,对于逻辑推理类复杂任务,思维链技术通过引导模型显式展示推理过程大幅提升准确性。

【教程地址】:https://github.com/datawhalechina/base-nlp

【镜像】:https://bgithub.xyz/datawhalechina/base-nlp

【组队表格】

https://ccnsqtff33uv.feishu.cn/base/MU3bbtNu9aqzrys5BBYcpv8NnVc?from=from_copylink

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)