还能这么发?零样本学习+CLIP,涨点起飞!

近期零样本连续增量学习(CILP)领域取得重要进展,ZSCILP等创新模型通过记忆增强机制和知识蒸馏技术,有效解决了知识遗忘与任务适应难题。同时,GenCLIP框架创新性地融合多层视觉提示与双分支推理,显著提升零样本异常检测性能;COOkeD则采用异构集成策略,在OOD检测中实现闭集分类器与CLIP模型优势互补。这些突破为AI领域提供了更高效的零样本解决方案,相关论文与代码资源已开放共享。

零样本连续增量学习作为人工智能领域中极具潜力的研究方向,近期迎来了诸多突破性进展,热度也在不断攀升!

像一些顶尖科研团队,已经接连在国际顶级会议上发表多篇重磅论文。其中,最新提出的零样本CILP模型ZSCILP,更是巧妙地解决了传统方法中知识遗忘与新任务适应之间的矛盾,被顶级会议CVPR收录!其核心在于,该模型通过创新性的记忆增强机制,让模型在面对新任务时能够精准地提取旧任务的关键特征,同时避免遗忘旧知识。而传统零样本学习方法往往受限于样本缺失导致的知识迁移不足,但ZSCILP通过引入知识蒸馏和关联挖掘技术,突破了这一瓶颈。

想在这一领域发论文的伙伴,可以从知识迁移优化、记忆机制创新以及多任务适应性提升等方面入手。

为方便大家研究,我特意整理了10篇零样本CILP的相关论文,都是顶会顶刊成果,部分论文附上了代码便于大家复现,全部论文PDF版+开源代码,工种号 沃的顶会 扫码回复 “零样本CILP” 领取。

GenCLIP:Generalizing CLIP Prompts for Zero-shot Anomaly Detection

文章解析

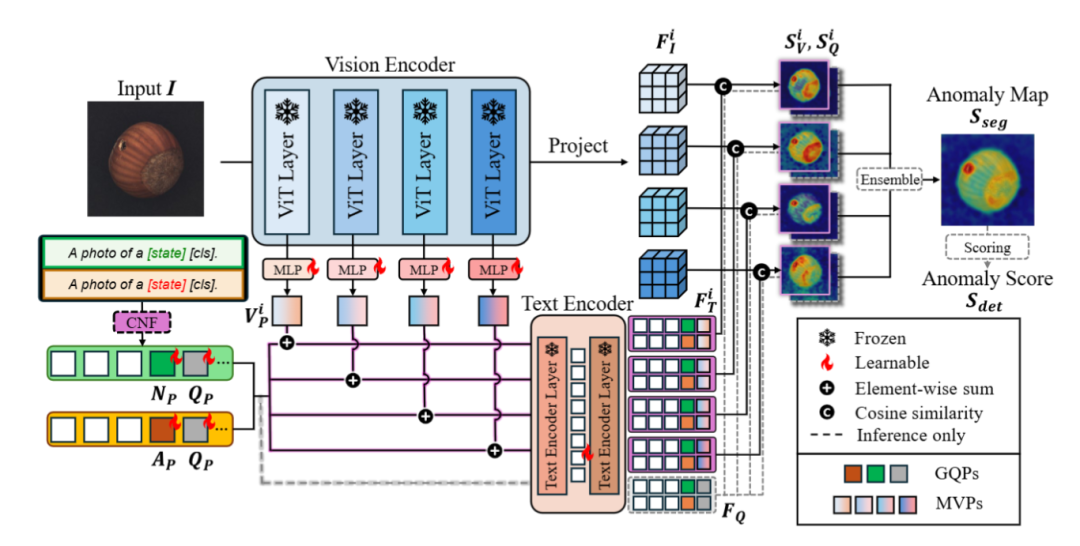

本文提出GenCLIP,一种用于零样本异常检测(ZSAD)的新框架,通过多层提示和双分支推理机制,更有效地学习和利用通用CLIP文本提示。该方法通过融合CLIP视觉编码器多个层次的视觉特征来增强文本提示,提升提示的稳定性与泛化能力。

同时,双分支结构在推理时分别侧重类别特异性(视觉增强分支)和跨类别泛化(查询专用分支),从而在未知类别上实现更稳定可靠的异常检测。此外,引入自适应文本提示过滤机制,剔除CLIP训练中未见的无效类别名称,优化视觉-语言对齐。

创新点

提出多层视觉提示机制,融合CLIP多层视觉特征以增强通用文本提示的表达能力。

设计双分支推理策略,平衡类别特异性与模型泛化能力。

引入自适应类别名称过滤机制,提升文本输入的有效性与语义对齐质量。

通过多层特征融合自然正则化通用查询提示,提升其鲁棒性与稳定性。

实现通用提示在零样本异常检测中的高效学习与部署。

研究方法

利用CLIP视觉编码器的多层特征生成多层视觉提示(MVPs),用于增强可学习的通用查询提示(GQPs)。

在训练中通过多层视觉提示与共享查询提示的融合,增强正常与异常文本嵌入的语义表达。

推理阶段采用双分支结构:视觉增强分支结合多层视觉特征与过滤后的类别名称,查询专用分支仅使用泛化的GQPs进行检测。

设计类别名称过滤(CNF)模块,去除CLIP未见过的不相关或异常类别名称。

通过对比学习优化文本-图像匹配,提升异常检测与分割性能。

研究结论

GenCLIP在六个基准数据集上实现了优于现有方法的零样本异常检测与分割性能。

多层提示机制有效提升了文本提示的丰富性与鲁棒性。

双分支推理策略显著增强了模型在未知类别上的稳定性与可靠性。

自适应文本过滤机制确保了语言输入的质量,提升了视觉-语言对齐效果。

GenCLIP为CLIP在工业异常检测中的零样本应用提供了高效且通用的解决方案。

COOkeD:Ensemble-based OOD detection in the era of zero-shot CLIP

文章解析

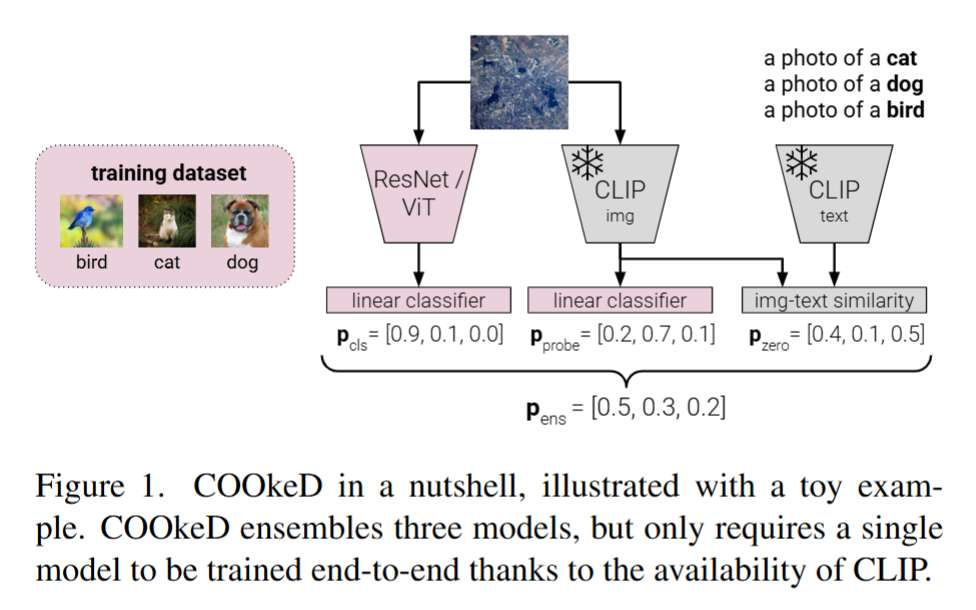

本文提出COOkeD,一种基于集成的Out-of-Distribution(OOD)检测框架,结合了闭集分类器、零样本CLIP分类器和基于CLIP特征的线性探针分类器。

该方法利用预训练视觉语言模型(VLM)的通用语义能力,同时保留任务特定分类器的优势,提升OOD检测的鲁棒性和准确性。COOkeD在多种现实挑战场景下(如标签噪声、协变量偏移、零样本偏移)表现出色,且无需额外训练多个模型,具有模块化和后处理优势。

创新点

首次将闭集分类器、零样本CLIP和线性探针分类器统一为异构集成框架用于OOD检测。

提出COOkeD框架,在无需重新训练CLIP的前提下实现多模型优势互补。

系统评估了OOD检测在训练时标签噪声、测试时协变量偏移和零样本偏移等现实挑战下的鲁棒性。

证明了集成策略在保持ID分类准确性的同时显著提升OOD检测性能。

框架模块化、可后处理,易于部署且计算开销低。

研究方法

使用在特定ID数据集上端到端训练的闭集分类器(如ResNet)作为集成成员之一。

利用预训练CLIP模型进行零样本分类,通过文本提示生成类别预测。

在CLIP图像特征上训练线性探针分类器,冻结图像编码器以保留通用表征。

将三种分类器的预测结果进行集成,设计统一的OOD评分机制。

通过在CIFAR100和ImageNet等基准及多种偏移场景下进行实验验证方法有效性。

研究结论

COOkeD在标准和挑战性OOD检测任务上均达到当前最优性能。

集成策略显著提升了模型对标签噪声和分布偏移的鲁棒性。

零样本CLIP在远离其训练分布的任务中表现受限,需与任务特定模型结合。

异构集成在不增加过多训练成本的情况下有效平衡了准确性与泛化能力。

COOkeD为未来OOD检测提供了简单但强大的基线框架。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)