【AI行业观察】AI大模型云厂商技术栈盘点

本文梳理了国内主流云厂商的AI大模型技术栈框架,涵盖阿里云、华为云、腾讯云、火山方舟和百度智能云五大平台。各平台均提供从模型训练(支持TensorFlow/PyTorch等主流框架)、推理加速到MLOps的全流程工具,并推出自研大模型(如通义千问、盘古等)及配套开发组件。在基础设施层,均采用NVIDIA GPU/国产芯片,基于Kubernetes实现容器化资源调度,形成涵盖IaaS到PaaS的完整

AI大模型技术栈

技术栈盘点

|

板块 |

aliyun |

huaweicloud |

tencentcloud |

火山方舟 |

baidu智能云 |

|

AI应用开发 |

阿里云百炼 |

ModelArts Studio |

TI平台 |

火山方舟 |

AppBuilder和AgentBuilder组件 |

|

大模型 |

通义千问 |

盘古大模型 |

混元大模型 |

豆包大模型 |

文心一言 |

|

模型框架与加速 |

PAI平台深度集成TensorFlow、PyTorch、JAX主流框架 |

自研ModelSpore 一款全场景AI框架,支持端、边、云的统一架构 |

支持TensorFlow、PyTorch、MXNet等主流框架 |

支持PyTorch、TensorFlow等主流框架 |

自研飞浆PaddlePaddle |

|

MLOps平台 |

人工智能平台PAI+ 百炼大模型平台 |

ModelArts |

TI平台 |

机器学习平台+火山方舟 |

千帆大模型平台+ BML+EasyDL |

|

AI资源调度管理 |

容器ACK+云原生AI套件 |

容器引擎CCE+ 深度集成Volcano调度框架 |

TKE |

VKE+基于K8S大规模GPU集群弹性调度 |

基于Kubernetes的AI容器化方案 |

|

AI基础设施层 |

NVIDIA GPU/升腾NPU/国产GPU等,高性能网络RDMA,高性能存储 |

||||

1.AI基础设施层

1.1 AI芯片计算单元

AI计算单元是模型运算的核心硬件,目前主流的AI计算芯片包含GPU、TPU及NPU

|

GPU |

TPU |

NPU |

|

|

厂商 |

NVIDIA |

|

华为、寒武纪 |

|

代表型号 |

A100/H100 A800/H800 |

第一代至第四代TPU |

华为昇腾910系列 |

|

特点 |

GPU拥有数千个计算核心,加上成熟的CUDA生态,当前训练和推理市场主导力量 |

谷歌专门为AI任务推出的AI芯片,有较高的能效比,对TensorFlow框架友好 |

国产针对AI特定计算模式(神经网络运算、卷积、点积)设计的专用处理器,承载AI算力自主可控的期望,当前成熟度与GPU仍有差距 |

|

生态成熟度 |

NVIDIA CUDA生态完善 |

TPU与TensorFlow深度绑定 |

国产NPU快速发展中 |

|

大模型适用 |

大模型训练和推理首选 |

Google内部及云上大规模应用 |

国产NPU在特定模型和场景下表现不错,尤其在推理端 |

2.AI资源调度管理平台

2.1 主流调度平台

业界主流的资源管理调度平台主要是Kubernetes,作为容器编排领域的事实标准,K8S有强大的声明式API、服务发现和自我修复能力,成为云原生AI平台的基石。

通过CRD和调度器扩展,可更好支持GPU/NPU等异构资源管理和AI工作负载调度。

2.2 面向AI的调度优化

|

Gang调度 |

拓扑感知调度 |

共享GPU |

任务调度 |

|

|

AI工作负载调度策略 |

分布式训练所有Pod同时被调度和启动,避免部分Pod无法获取资源导致死锁活资源浪费 |

考虑节点、GPU卡、NVLink、NVSwitch等物理拓扑 支持NVLink/PCIe拓扑 |

GPU昂贵,通过GPU虚拟化技术,将物理GPU切分成多个虚拟GPU(vGPU),提升资源利用率 |

多租户多任务场景,GPU资源配额和成本管理问题 均衡调度 抢占式调度 |

3.AI模型开发训练平台

3.1 MLOps平台关键功能模块

一个完整的MLPos平台需覆盖以下关键功能模块

-

数据准备与管理

-

模型开发与实验

-

模型训练

-

模型版本管理

-

模型评估与验证

-

模型部署与服务

-

模型监控运维

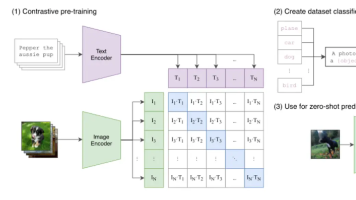

4.AI大模型基础框架

AI模型基础框架是深度学习的“操作系统”

4.1 主流AI模型框架对比

|

平台 |

TenSorFlow |

PyTorch |

|

AI模型基础框架 |

Google,动态计算图,整合Keras作为高级API,工业界使用经验较多 |

Meta,以动态计算图为核心,API设计简洁直观,与Python深度融合 拥有TorchVision,TorchText,PyTorch Lighting丰富库 |

4.2 模型推理服务推理服务框架

推理服务框架负责管理模型的生命周期、处理客户端请求、进行负载均衡和资源调度,将训练好的模型封装成可供调用的服务

|

平台 |

NVIDIA Triton Inference Server |

TorchServe(PyTorch) |

TenSorFlow Serving |

|

推理服务框架 |

NVIDIA开源,支持多种AI框架的模型 |

专为PyTorch模型部署而设计 |

专为TensorFlow模型设计,支持TF标准的SavedModel格式 |

5.AI大模型

5.1 海外大模型代表

|

平台 |

OpenAI |

Mate |

|

|

大模型 |

GPT系列 |

LLaMA系列 |

Gemini系列 |

5.2 国内大模型代表

|

平台 |

阿里云 |

华为云 |

腾讯云 |

火山引擎 |

百度云 |

|

大模型 |

通义千问 |

盘古 |

混元 |

豆包 |

文心一言 |

6.大模型AI应用开发平台

6.1 主流应用开发工具平台

|

平台 |

LangChain |

Agent框架 |

AI开发平台 |

|

应用开发 |

LangChain |

AutoGEN |

Dify,Coze |

小结

经过前述对大模型技术栈各层级的逐一解析,我们对AI基础设施、资源调度、MLOps平台、基础框架、加速框架、推理服务以及大模型本身和应用开发平台等关键环节有了大致了解。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)