HarmonyOS如何集成机器学习能力进行本地推理?

随着智能设备的发展和人工智能(AI)技术的不断进步,机器学习(ML)能力已经成为现代应用的核心组成部分。在HarmonyOS平台中,集成机器学习能力可以为设备带来强大的智能推理功能。无论是图像分类、语音识别,还是其他复杂任务,机器学习都可以大大提升设备的智能化水平。在HarmonyOS中,开发者可以通过MLFoundation框架来集成机器学习能力,支持多种机器学习模型的推理和部署。

👋 你好,欢迎来到我的博客!我是【菜鸟不学编程】

我是一个正在奋斗中的职场码农,步入职场多年,正在从“小码农”慢慢成长为有深度、有思考的技术人。在这条不断进阶的路上,我决定记录下自己的学习与成长过程,也希望通过博客结识更多志同道合的朋友。

🛠️ 主要方向包括 Java 基础、Spring 全家桶、数据库优化、项目实战等,也会分享一些踩坑经历与面试复盘,希望能为还在迷茫中的你提供一些参考。

💡 我相信:写作是一种思考的过程,分享是一种进步的方式。

如果你和我一样热爱技术、热爱成长,欢迎关注我,一起交流进步!

全文目录:

前言

随着智能设备的发展和人工智能(AI)技术的不断进步,机器学习(ML)能力已经成为现代应用的核心组成部分。在HarmonyOS平台中,集成机器学习能力可以为设备带来强大的智能推理功能。无论是图像分类、语音识别,还是其他复杂任务,机器学习都可以大大提升设备的智能化水平。

在HarmonyOS中,开发者可以通过MLFoundation框架来集成机器学习能力,支持多种机器学习模型的推理和部署。本文将介绍如何在HarmonyOS中集成机器学习能力,进行本地推理,并详细讲解模型的转换、部署方式、推理调用API,以及如何进行性能优化和模型瘦身。

MLFoundation简介与支持的模型格式

MLFoundation是HarmonyOS中的机器学习框架,提供了一个统一的接口来帮助开发者在设备上进行机器学习推理。它支持多种常见的机器学习模型格式,能够在设备端执行本地推理任务。

1. MLFoundation的主要功能

- 本地推理:支持在本地设备上进行机器学习推理,无需依赖云端服务,从而提高响应速度并保护用户隐私。

- 多种框架支持:支持TensorFlow Lite、Caffe、ONNX等流行的深度学习框架的模型,能够在不同的硬件平台上执行高效的推理。

- 推理优化:通过硬件加速和软件优化,MLFoundation在设备上提供了高效的推理性能,适合嵌入式系统和低功耗设备。

2. 支持的模型格式

MLFoundation支持多种机器学习模型格式,其中最常用的包括:

- .om文件(Ascend Model):这是华为自有的Ascend AI处理器专用的机器学习模型格式。使用Ascend设备进行推理时,建议将模型转换为

.om格式。 - .tflite文件(TensorFlow Lite):TensorFlow Lite是Google推出的轻量级机器学习推理框架,适用于移动端和嵌入式设备。HarmonyOS同样支持

.tflite格式,方便TensorFlow模型的部署。

模型转换与部署方式(.om/.tflite)

在将机器学习模型部署到HarmonyOS设备之前,通常需要将模型转换为HarmonyOS支持的格式。对于大多数深度学习模型,转换为.om或.tflite格式是常见的做法。以下是两种模型格式的转换和部署方式:

1. .om文件格式的转换

.om格式是华为Ascend处理器专用的模型格式。要将其他框架(如TensorFlow或PyTorch)的模型转换为.om文件,需要使用华为提供的**Model Compiler(模型编译器)**工具。

-

转换流程:

- 使用

TensorFlow、PyTorch等框架训练模型。 - 使用Model Converter工具将训练好的模型转换为

.onnx格式。 - 使用Ascend Model Compiler将

.onnx格式的模型转换为.om格式。

- 使用

例如,使用TensorFlow模型转换为ONNX格式后,再将其转换为.om格式:

# 将TensorFlow模型转换为ONNX

python -m tf2onnx.convert --saved-model tensorflow_model --output model.onnx

# 使用Ascend Model Compiler将ONNX模型转换为.om

atc --model=model.onnx --framework=5 --output=model.om --input_format=NHWC --input_shape="input:1,224,224,3"

2. .tflite文件格式的转换

对于TensorFlow Lite模型,直接使用TensorFlow框架进行转换:

# 使用TensorFlow将模型转换为TFLite格式

import tensorflow as tf

model = tf.keras.models.load_model('model.h5')

converter = tf.lite.TFLiteConverter.from_keras_model(model)

tflite_model = converter.convert()

# 保存为tflite文件

with open('model.tflite', 'wb') as f:

f.write(tflite_model)

推理调用API:输入、输出Tensor管理

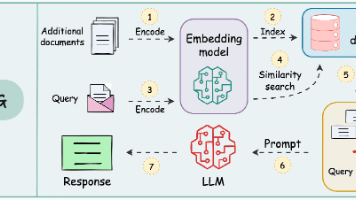

在完成模型转换后,下一步是通过MLFoundation API进行推理调用。推理过程主要包括输入Tensor的准备、模型加载、推理执行和输出Tensor的获取。

1. 加载模型并准备推理

在应用程序中,首先需要加载模型并初始化推理引擎。对于.om格式模型,使用Ascend AI引擎进行加载,而对于.tflite模型,可以直接使用TensorFlow Lite进行加载。

// 载入OM格式模型

ModelManager modelManager = ModelManager.getInstance();

Model model = modelManager.loadModel("model.om");

// 获取输入Tensor

Tensor inputTensor = model.getInputTensor(0);

对于.tflite模型,使用TensorFlow Lite的API:

Interpreter.Options options = new Interpreter.Options();

Interpreter interpreter = new Interpreter(loadModelFile(), options);

2. 输入Tensor的管理

Tensor是神经网络计算的基本数据结构,输入Tensor的管理对于模型推理至关重要。在HarmonyOS中,通过API将输入数据(如图像、音频等)转换为Tensor,并喂入模型进行推理。

// 将图像转换为输入Tensor

Bitmap bitmap = BitmapFactory.decodeFile(imagePath);

float[] inputData = convertBitmapToFloatArray(bitmap);

inputTensor.setData(inputData);

3. 输出Tensor的管理

模型推理完成后,需要从输出Tensor中获取推理结果。输出Tensor包含了模型预测的结果,例如分类概率、回归值等。

// 获取输出Tensor

Tensor outputTensor = model.getOutputTensor(0);

float[] outputData = new float[outputTensor.size()];

outputTensor.getData(outputData);

示例:本地图像分类、语音识别

为了帮助理解如何在HarmonyOS中使用机器学习能力,以下是图像分类和语音识别的实际示例。

1. 本地图像分类

假设我们已经训练并转换了一个图像分类模型,接下来可以通过BackgroundTaskManager进行推理任务的调用。使用.tflite模型或.om模型加载并进行推理操作:

public void classifyImage(String imagePath) {

// 加载图像分类模型

Interpreter interpreter = new Interpreter(loadModelFile("model.tflite"));

// 加载并处理图像

Bitmap bitmap = BitmapFactory.decodeFile(imagePath);

float[] inputData = convertBitmapToFloatArray(bitmap);

// 输入Tensor

Tensor inputTensor = interpreter.getInputTensor(0);

inputTensor.setData(inputData);

// 执行推理

interpreter.run(inputData, outputData);

// 处理输出结果

String result = processOutput(outputData);

Log.i("Classification Result", result);

}

2. 本地语音识别

语音识别模型通常使用.tflite格式的轻量级模型。可以将语音输入转换为特征,并通过模型进行推理。假设已将语音转录为特征数据:

public void recognizeSpeech(byte[] audioData) {

// 加载语音识别模型

Interpreter interpreter = new Interpreter(loadModelFile("speech_model.tflite"));

// 处理音频数据,转换为模型输入

float[] inputData = preprocessAudioData(audioData);

// 输入Tensor

Tensor inputTensor = interpreter.getInputTensor(0);

inputTensor.setData(inputData);

// 执行推理

interpreter.run(inputData, outputData);

// 处理输出结果

String recognizedText = processSpeechOutput(outputData);

Log.i("Speech Recognition", recognizedText);

}

性能优化与模型瘦身技巧

机器学习模型的推理性能和内存占用是移动设备中非常关键的因素。以下是一些优化技巧,用于提高模型的推理效率,并减小模型的体积。

1. 模型量化

量化是减小模型大小的常用方法,它将浮点数权重转换为低精度整数。通过量化,模型的存储空间和计算开销都能显著降低。

# 使用TensorFlow Lite转换工具进行量化

tflite_convert --graph_def_file=model.pb --output_file=model_quant.tflite --inference_type=QUANTIZED_UINT8 --input_arrays=input --output_arrays=output --default_ranges_min=0 --default_ranges_max=6

2. 模型裁剪

模型裁剪通过删除冗余的神经元和连接来减小模型的体积,并提高推理效率。这种方法可以通过训练过程中进行动态裁剪,减少计算量。

3. 使用高效的网络架构

选择轻量级、高效的神经网络架构,例如MobileNet、SqueezeNet等。这些网络架构在保证准确度的前提下,能显著降低模型的计算量和内存占用。

4. 使用硬件加速

在HarmonyOS设备上,可以通过利用硬件加速(如GPU、NPU)来提高推理性能。华为Ascend处理器、NPU等硬件加速器可以显著提升推理速度。

结语

通过在HarmonyOS中集成机器学习能力,开发者能够实现本地推理,提升应用的智能化水平。MLFoundation提供了强大的支持,允许开发者轻松加载和执行多种机器学习模型。通过合理的模型转换、优化和硬件加速,我们可以在移动设备上实现高效、快速的推理,满足用户的实时需求。希望本文的讲解能够帮助你在实际开发中顺利实现机器学习能力的集成,提升应用的智能化与性能。

📝 写在最后

如果你觉得这篇文章对你有帮助,或者有任何想法、建议,欢迎在评论区留言交流!你的每一个点赞 👍、收藏 ⭐、关注 ❤️,都是我持续更新的最大动力!

我是一个在代码世界里不断摸索的小码农,愿我们都能在成长的路上越走越远,越学越强!

感谢你的阅读,我们下篇文章再见~👋

✍️ 作者:某个被流“治愈”过的 Java 老兵

📅 日期:2025-07-25

🧵 本文原创,转载请注明出处。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)